Слабое супервизирование — парадигма в машинном обучении , актуальность и заметность которой возросли с появлением больших языковых моделей из-за большого объёма данных, необходимых для их обучения. Он характеризуется использованием комбинации небольшого количества данных, размеченных человеком (используемых исключительно в более дорогой и трудоемкой парадигме обучения с учителем ), за которым следует большой объем немаркированных данных (используемых исключительно в парадигме обучения без учителя ). Другими словами, желаемые выходные значения предоставляются только для подмножества обучающих данных. Остальные данные не помечены или помечены неточно. Интуитивно это можно рассматривать как экзамен, а данные помечать как примеры задач, которые учитель решает для класса в качестве помощи в решении другого набора задач. В трансдуктивной обстановке эти нерешенные проблемы действуют как экзаменационные вопросы. В индуктивной обстановке они превращаются в практические задачи, подобные экзамену. Технически это можно рассматривать как выполнение кластеризации с последующей маркировкой кластеров помеченными данными, отодвигание границы принятия решения от областей с высокой плотностью или изучение базового одномерного многообразия, в котором находятся данные.

Для получения размеченных данных для задачи обучения часто требуется квалифицированный человек (например, для расшифровки аудиосегмента) или физический эксперимент (например, определение трехмерной структуры белка или определение наличия масла в определенном месте). Таким образом, стоимость, связанная с процессом маркировки, может сделать невозможным создание больших, полностью маркированных обучающих наборов, тогда как получение немаркированных данных обходится относительно недорого. В таких ситуациях полуконтролируемое обучение может иметь большую практическую ценность. Обучение с полуконтролем также представляет теоретический интерес в машинном обучении и в качестве модели человеческого обучения.

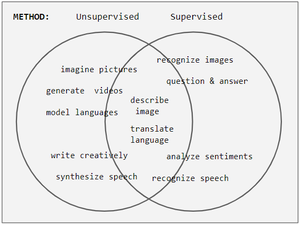

Более формально, полу-контролируемое обучение предполагает обработку набора независимо одинаково распределенных примеров с соответствующими метками и немаркированных примеров . Полуконтролируемое обучение объединяет эту информацию, чтобы превзойти эффективность классификации , которую можно получить либо путем отбрасывания немаркированных данных и выполнения контролируемого обучения, либо путем отказа от меток и выполнения неконтролируемого обучения.

Обучение с полуконтролем может относиться либо к трансдуктивному обучению , либо к индуктивному обучению . [1] Цель трансдуктивного обучения — найти правильные метки только для данных немаркированных данных. Цель индуктивного обучения — вывести правильное отображение от до .

Нет необходимости (и, согласно принципу Вапника , неосмотрительно) выполнять трансдуктивное обучение путем вывода правила классификации по всему входному пространству; однако на практике алгоритмы, формально разработанные для трансдукции или индукции, часто используются как взаимозаменяемые.

Чтобы можно было использовать немаркированные данные, должна существовать некоторая связь с основным распределением данных. Алгоритмы полуконтролируемого обучения используют по крайней мере одно из следующих допущений: [2]

Точки, расположенные близко друг к другу, с большей вероятностью будут иметь одну и ту же метку. Это также обычно предполагается при обучении с учителем и дает предпочтение геометрически простым границам решений . В случае полуконтролируемого обучения предположение о гладкости дополнительно дает предпочтение границам решений в регионах с низкой плотностью, поэтому несколько точек находятся близко друг к другу, но в разных классах. [3]

Данные имеют тенденцию образовывать дискретные кластеры, и точки в одном кластере с большей вероятностью будут иметь общую метку (хотя данные, имеющие общую метку, могут распространяться по нескольким кластерам). Это частный случай предположения о гладкости, который приводит к обучению признаков с помощью алгоритмов кластеризации.

Данные лежат приблизительно на многообразии гораздо меньшей размерности, чем входное пространство. В этом случае изучение многообразия с использованием как размеченных, так и неразмеченных данных может избежать проклятия размерности . Затем обучение может продолжиться с использованием расстояний и плотностей, определенных на многообразии.

Предположение о многообразии практично, когда многомерные данные генерируются каким-либо процессом, который сложно смоделировать напрямую, но который имеет лишь несколько степеней свободы. Например, человеческий голос контролируется несколькими голосовыми связками [4] , а изображения различных выражений лица контролируются несколькими мышцами. В этих случаях расстояния и гладкость лучше рассматривать в естественном пространстве порождающей задачи, а не в пространстве всех возможных акустических волн или изображений соответственно.

Эвристический подход самообучения (также известный как самообучение или самомаркировка ) исторически является старейшим подходом к полуконтролируемому обучению [2] , примеры его применения начались в 1960-х годах. [5]

Трансдуктивная система обучения была официально представлена Владимиром Вапником в 1970-х годах. [6] Интерес к индуктивному обучению с использованием генеративных моделей также возник в 1970-х годах. Вероятно, приблизительно правильное обучение для полуконтролируемого обучения гауссовской смеси было продемонстрировано Рацаби и Венкатешем в 1995 году. [7]

Генеративные подходы к статистическому обучению в первую очередь направлены на оценку , [ оспаривается ] распределение точек данных, принадлежащих к каждому классу. Тогда вероятность того, что данная точка имеет метку, пропорциональна по правилу Байеса . Обучение с полуконтролем с помощью генеративных моделей можно рассматривать либо как расширение обучения с учителем (классификация плюс информация о ), либо как расширение обучения без учителя (кластеризация плюс некоторые метки).

Генеративные модели предполагают, что распределения принимают некоторую конкретную форму , параметризованную вектором . Если эти предположения неверны, неразмеченные данные могут фактически снизить точность решения по сравнению с тем, что было бы получено только из размеченных данных. [8] Однако, если предположения верны, то немаркированные данные обязательно улучшат производительность. [7]

Немаркированные данные распределяются в соответствии со смесью распределений отдельных классов. Чтобы узнать распределение смеси по немаркированным данным, оно должно быть идентифицируемым, то есть разные параметры должны давать разные суммарные распределения. Распределения гауссовской смеси легко идентифицировать и обычно используются для генеративных моделей.

Параметризованное совместное распределение можно записать, используя правило цепочки . Каждый вектор параметров связан с функцией решения . Затем параметр выбирается на основе соответствия как помеченным, так и неразмеченным данным с весом :

Другой основной класс методов пытается разместить границы в регионах с небольшим количеством точек данных (помеченных или неразмеченных). Одним из наиболее часто используемых алгоритмов является трансдуктивная машина опорных векторов , или TSVM (которая, несмотря на свое название, также может использоваться для индуктивного обучения). В то время как машины опорных векторов для контролируемого обучения ищут границу решения с максимальным запасом по помеченным данным, целью TSVM является маркировка немаркированных данных так, чтобы граница решения имела максимальный запас по всем данным. В дополнение к стандартным потерям шарнира для помеченных данных, функция потерь вводится для неразмеченных данных, позволяя . Затем TSVM выбирает из воспроизводящего ядра гильбертова пространства , минимизируя регуляризованный эмпирический риск :

Точное решение трудно найти из-за невыпуклости члена , поэтому исследования сосредоточены на полезных приближениях. [9]

Другие подходы, реализующие разделение с низкой плотностью, включают модели гауссовских процессов, регуляризацию информации и минимизацию энтропии (особым случаем которых является TSVM).

К регуляризации Лапласа исторически подходили через граф-лапласиан. Методы на основе графов для полуконтролируемого обучения используют графовое представление данных с узлом для каждого помеченного и неразмеченного примера. Граф может быть построен с использованием знаний предметной области или подобия примеров; Два распространенных метода — соединить каждую точку данных с ее ближайшими соседями или с примерами, находящимися на некотором расстоянии . Затем вес ребра между и устанавливается равным .

В рамках регуляризации многообразия [10] [11] граф служит заместителем многообразия. К стандартной задаче регуляризации Тихонова добавляется термин , обеспечивающий гладкость решения относительно многообразия (во внутреннем пространстве задачи), а также относительно окружающего входного пространства. Задача минимизации становится

где – гильбертово пространство с воспроизводящим ядром, а – многообразие, на котором лежат данные. Параметры регуляризации и гладкость управления в окружающем и внутреннем пространствах соответственно. График используется для аппроксимации внутреннего члена регуляризации. Определив лапласиан графа, где и - вектор , мы имеем

Основанный на графах подход к регуляризации Лапласа должен быть сопоставлен с методом конечных разностей . [ нужны разъяснения ] [ нужна ссылка ]

Лапласиан также можно использовать для расширения алгоритмов обучения с учителем: регуляризованных методов наименьших квадратов и машин опорных векторов (SVM) до полуконтролируемых версий регуляризованных наименьших квадратов Лапласа и лапласианских SVM.

Некоторые методы полуконтролируемого обучения по своей сути не предназначены для обучения как на немаркированных, так и на маркированных данных, а вместо этого используют немаркированные данные в рамках контролируемого обучения. Например, помеченные и неразмеченные примеры могут служить основой для выбора представления, метрики расстояния или ядра для данных на неконтролируемом первом этапе. Тогда обучение с учителем происходит только на отмеченных примерах. В этом ключе некоторые методы изучают низкоразмерное представление с использованием контролируемых данных, а затем применяют к изученному представлению либо разделение с низкой плотностью, либо методы на основе графов. [12] [13] Итеративное уточнение представления и последующее полуконтролируемое обучение указанного представления могут еще больше повысить производительность.

Самообучение — это метод-оболочка полуконтролируемого обучения. [14] Сначала алгоритм контролируемого обучения обучается только на основе помеченных данных. Затем этот классификатор применяется к немаркированным данным для создания большего количества помеченных примеров в качестве входных данных для алгоритма обучения с учителем. Обычно на каждом этапе добавляются только те метки, в которых классификатор наиболее уверен. [15] При обработке естественного языка распространенным алгоритмом самообучения является алгоритм Яровского для решения таких задач, как устранение неоднозначности смысла слов, восстановление акцента и исправление правописания. [16]

Совместное обучение — это расширение самообучения, при котором несколько классификаторов обучаются на разных (в идеале непересекающихся) наборах функций и генерируют помеченные примеры друг для друга. [17]

Реакция человека на формальные проблемы обучения с полуконтролем привела к различным выводам о степени влияния немаркированных данных. [18] Более естественные проблемы обучения также можно рассматривать как примеры обучения под учителем. Большая часть обучения человеческим понятиям включает в себя небольшое количество прямых инструкций (например, навешивание родительскими ярлыками объектов в детстве) в сочетании с большим объемом немаркированного опыта (например, наблюдение за объектами без их называния или подсчета или, по крайней мере, без обратной связи).

Человеческие младенцы чувствительны к структуре немаркированных природных категорий, таких как изображения собак и кошек или мужских и женских лиц. [19] Младенцы и дети принимают во внимание не только немаркированные примеры, но и процесс отбора проб , в результате которого возникают маркированные примеры. [20] [21]

{{cite journal}}: CS1 maint: multiple names: authors list (link)