В компьютерном зрении совместная сегментация объектов является частным случаем сегментации изображений , которая определяется как совместная сегментация семантически схожих объектов на нескольких изображениях или видеокадрах. [2] [3]

Часто бывает сложно извлечь маски сегментации цели/объекта из шумной коллекции изображений или видеокадров, что включает обнаружение объектов в сочетании с сегментацией . Шумная коллекция подразумевает, что объект/цель присутствует спорадически в наборе изображений или объект/цель периодически исчезает на протяжении всего интересующего видео. Ранние методы [4] [5] обычно включают представления среднего уровня, такие как предложения объектов .

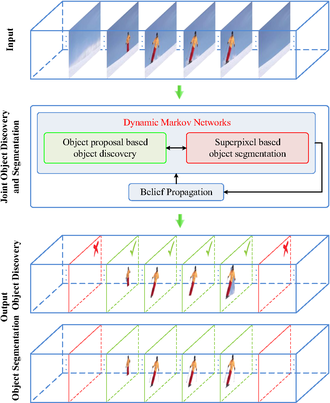

Недавно был предложен метод совместного обнаружения объектов и совместной сегментации на основе связанных динамических сетей Маркова [1] , который, как утверждается, обеспечивает значительное повышение устойчивости к нерелевантным/шумным видеокадрам.

В отличие от предыдущих попыток, которые удобно предполагали постоянное присутствие целевых объектов во всем входном видео, этот связанный алгоритм на основе двойной динамической сети Маркова одновременно выполняет задачи обнаружения и сегментации с двумя соответствующими сетями Маркова, совместно обновляемыми посредством распространения убеждений.

В частности, сеть Маркова, отвечающая за сегментацию, инициализируется суперпикселями и предоставляет информацию для своего марковского аналога, отвечающего за задачу обнаружения объектов. Наоборот, сеть Маркова, отвечающая за обнаружение, строит граф предложения объектов с входными данными, включая трубки пространственно-временной сегментации.

Оптимизация разреза графа является популярным инструментом в компьютерном зрении, особенно в более ранних приложениях сегментации изображений . В качестве расширения обычных разрезов графа предлагается многоуровневый разрез гиперграфа [6] для учета более сложных соответствий высокого порядка среди видеогрупп за пределами типичных парных корреляций.

При таком расширении гиперграфа множественные модальности соответствий, включая низкоуровневый внешний вид, заметность, когерентное движение и высокоуровневые характеристики, такие как области объектов, могут быть бесшовно включены в вычисление гиперребер. Кроме того, в качестве основного преимущества по сравнению с подходом, основанным на совместном появлении , гиперграф неявно сохраняет более сложные соответствия между своими вершинами, при этом веса гиперребер удобно вычисляются путем разложения собственных значений матриц Лапласа .

В приложениях локализации действий косегментация объектов также реализуется как пространственно-временной детектор сегментной трубки . [7] Вдохновленные недавними усилиями по локализации пространственно-временных действий с помощью трубочек (последовательностей ограничивающих рамок), Ли и др. представляют новый детектор локализации пространственно-временных действий Segment-tube, который состоит из последовательностей масок сегментации по кадрам. Этот детектор Segment-tube может временно определять начальный/конечный кадр каждой категории действий при наличии предшествующих/последующих интерференционных действий в необрезанных видео. Одновременно детектор Segment-tube создает маски сегментации по кадрам вместо ограничивающих рамок, предлагая превосходную пространственную точность для трубочек. Это достигается путем чередования итеративной оптимизации между локализацией временного действия и сегментацией пространственного действия.

Предлагаемый детектор сегментной трубки показан на блок-схеме справа. Образец входных данных — это необрезанное видео, содержащее все кадры в видео парного фигурного катания, только часть из которых относится к соответствующей категории (например, DeathSpirals). Инициализированный с сегментацией изображения на основе значимости на отдельных кадрах, этот метод сначала выполняет шаг локализации временного действия с каскадной 3D CNN и LSTM и определяет начальный кадр и конечный кадр целевого действия с помощью стратегии «грубо-точно». Затем детектор сегментной трубки уточняет пространственную сегментацию по кадрам с помощью разреза графа , фокусируясь на соответствующих кадрах, идентифицированных шагом локализации временного действия. Оптимизация чередует локализацию временного действия и сегментацию пространственного действия итеративным образом. При практической конвергенции окончательные результаты локализации пространственно-временного действия получаются в формате последовательности масок сегментации по кадрам (нижняя строка на блок-схеме) с точными начальными/конечными кадрами.