В вычислительной технике мультитач — это технология, которая позволяет поверхности ( тачпаду или сенсорному экрану ) распознавать наличие более чем одной точки контакта с поверхностью одновременно. Истоки мультитач начались в ЦЕРНе , [1] Массачусетском технологическом институте , Университете Торонто , Университете Карнеги-Меллон и лабораториях Белла в 1970-х годах. [2] ЦЕРН начал использовать мультисенсорные экраны еще в 1976 году для управления суперпротонным синхротроном . [3] [4] Емкостные мультитач-дисплеи были популяризированы благодаря iPhone от Apple в 2007 году. [5] [6] Мультитач можно использовать для реализации дополнительных функций, таких как масштабирование или активация определенных подпрограмм , прикрепленных к предопределенные жесты с использованием распознавания жестов .

Несколько вариантов использования термина «мультитач» возникли в результате быстрого развития в этой области, и многие компании использовали этот термин для продвижения на рынок более старой технологии, которая называется « одиночное касание с улучшенными жестами» или некоторых других терминов другими компаниями и исследователями. Несколько других подобных или родственных терминов пытаются определить, может ли устройство точно определить или только приблизительно определить местоположение различных точек контакта, чтобы еще больше разграничить различные технологические возможности, но они часто используются в маркетинге как синонимы.

Мультитач обычно реализуется с использованием технологии емкостных датчиков в мобильных устройствах и интеллектуальных устройствах . Емкостный сенсорный экран обычно состоит из емкостного сенсорного датчика , контроллера специализированной интегральной схемы (ASIC) и цифрового сигнального процессора (DSP), изготовленного по технологии CMOS (комплементарный металл-оксид-полупроводник ). Более поздний альтернативный подход — это оптическая сенсорная технология, основанная на технологии датчиков изображения .

В вычислительной технике мультитач — это технология, которая позволяет сенсорной панели или сенсорному экрану распознавать более одной [7] [8] или более двух [9] точек контакта с поверхностью. Apple популяризировала термин «мультитач» в 2007 году, с помощью которого она реализовала дополнительные функции, такие как масштабирование пальцами или активация определенных подпрограмм , прикрепленных к предопределенным жестам .

Два различных использования этого термина возникли в результате быстрого развития в этой области, и многие компании использовали этот термин для продвижения на рынок более старой технологии, которую другие компании и исследователи называют «одним касанием с улучшенными жестами» или некоторыми другими терминами. [10] [11] Несколько других похожих или родственных терминов пытаются определить, может ли устройство точно определить или только приблизительно определить местоположение различных точек контакта, чтобы дополнительно различать различные технологические возможности, [11] но они часто используются как синонимы в маркетинге.

Использование технологии сенсорного экрана предшествовало как технологии мультитач, так и персональному компьютеру. Первые производители синтезаторов и электронных инструментов, такие как Хью Ле Кейн и Роберт Муг, экспериментировали с использованием сенсорных емкостных датчиков для управления звуками, издаваемыми их инструментами. [12] IBM начала создавать первые сенсорные экраны в конце 1960-х годов. В 1972 году компания Control Data выпустила компьютер PLATO IV, инфракрасный терминал, используемый в образовательных целях, в котором использовались точки одного касания в пользовательском интерфейсе с массивом 16 × 16. Эти ранние сенсорные экраны регистрировали только одну точку касания за раз. Таким образом, экранными клавиатурами (хорошо известная сегодня функция) было неудобно пользоваться, поскольку одновременное нажатие клавиши и удержание клавиши Shift во время набора другой было невозможно. [13]

Исключениями из них были «перекрестная» мультисенсорная реконфигурируемая сенсорная клавиатура/дисплей, разработанная в Массачусетском технологическом институте в начале 1970-х годов [14] и емкостный мультисенсорный экран с 16 кнопками, разработанный в ЦЕРН в 1972 году для управления строящийся суперпротонный синхротрон . [15]

В 1976 году в ЦЕРНе был разработан новый емкостный экран xy , основанный на емкостных сенсорных экранах, разработанных в 1972 году датским инженером-электронщиком Бентом Штумпе . [1] [17] Эта технология, позволяющая точно определять местоположение различных точек соприкосновения, была использована для разработки нового типа человеко-машинного интерфейса (HMI) для диспетчерской суперпротонного синхротронного ускорителя частиц. [18] [19] [20] В рукописной заметке от 11 марта 1972 года [21] Стампе представил предложенное им решение – емкостный сенсорный экран с фиксированным количеством программируемых кнопок, представленных на дисплее. Экран должен был состоять из набора конденсаторов, выгравированных на медной пленке на листе стекла, причем каждый конденсатор был сконструирован таким образом, чтобы близлежащий плоский проводник, например поверхность пальца, значительно увеличивал емкость. Конденсаторы должны были состоять из тонких линий, выгравированных медью на листе стекла – достаточно тонких (80 мкм) и достаточно удаленных друг от друга (80 мкм), чтобы их нельзя было увидеть. [22] В конечном устройстве простое лаковое покрытие не позволяло пальцам касаться конденсаторов. В том же году MIT описал клавиатуру с изменяемой графикой, способную обнаруживать мультитач. [14]

В начале 1980-х годов группа исследования ввода Университета Торонто была одной из первых, кто исследовал программную часть систем мультисенсорного ввода. [23] В системе 1982 года в Университете Торонто использовалась панель из матового стекла, за стеклом которой располагалась камера. Когда палец или несколько пальцев нажимали на стекло, камера распознавала действие как одно или несколько черных пятен на белом фоне, что позволяло зарегистрировать его как входные данные. Поскольку размер точки зависел от давления (насколько сильно человек нажимал на стекло), система также была в некоторой степени чувствительна к давлению. [12] Следует отметить, что эта система была только системой ввода и не могла отображать графику.

В 1983 году лаборатория Bell Labs в Мюррей-Хилл опубликовала подробное описание интерфейсов на основе сенсорного экрана, хотя в нем не упоминается несколько пальцев. [24] В том же году основанная на видео система Video Place/Video Desk Майрона Крюгера оказала влияние на разработку мультитач-жестов, таких как масштабирование, хотя сама эта система не имела сенсорного взаимодействия. [25] [26]

К 1984 году и в лабораториях Белла, и в Университете Карнеги-Меллон уже были рабочие прототипы мультисенсорных экранов (как ввода, так и графики), которые могли интерактивно реагировать на нажатие нескольких пальцев. [27] [28] Система Bell Labs была основана на емкостной связи пальцев, тогда как система CMU была оптической. В 1985 году в системе CMU был продемонстрирован канонический мультитач-жест масштабирования с скоординированной графикой. [29] [30] В октябре 1985 года Стив Джобс подписал соглашение о неразглашении информации и совершил поездку по лаборатории мультитач Sensor Frame компании CMU. [31] В 1990 году Sears et al. опубликовал обзор академических исследований взаимодействия человека и компьютера с одним и несколькими сенсорными экранами того времени, описывая жесты одним касанием, такие как вращение ручек, проведение по экрану для активации переключателя (или U-образный жест для тумблера), и клавиатуры с сенсорным экраном (включая исследование, которое показало, что пользователи могут печатать со скоростью 25 слов в минуту на клавиатуре с сенсорным экраном по сравнению с 58 словами в минуту на стандартной клавиатуре, при этом предполагается, что мультитач улучшает скорость ввода данных); Также описаны мультисенсорные жесты, такие как выбор диапазона линии, соединение объектов и жест «касание-щелчок» для выбора с сохранением местоположения другим пальцем. [32]

В 1991 году Пьер Веллнер выдвинул тему публикации о своем мультисенсорном «цифровом столе», который поддерживал движения несколькими пальцами и сжимание. [33] [34] Различные компании расширили эти изобретения в начале двадцать первого века.

В период с 1999 по 2005 год компания Fingerworks разработала различные технологии мультитач, в том числе клавиатуры Touchstream и iGesture Pad. В начале 2000-х годов Алан Хедж, профессор человеческого фактора и эргономики Корнелльского университета, опубликовал несколько исследований об этой технологии. [35] [36] [37] В 2005 году Apple приобрела Fingerworks и ее технологию мультитач. [38]

В 2004 году французский стартап JazzMutant разработал устройство ввода Lemur , музыкальный контроллер, который стал в 2005 году первым коммерческим продуктом с запатентованным прозрачным мультисенсорным экраном, позволяющим напрямую манипулировать дисплеем десятью пальцами. [39] [40]

В январе 2007 года технология мультитач стала мейнстримом в iPhone , и в анонсе iPhone Apple даже заявила, что «изобрела мультитач», [41] однако и функция, и термин появились до объявления или патентных заявок, за исключением области емкостных мобильных экранов, которых не существовало до появления технологии Fingerworks/Apple (Fingerworks подала патенты в 2001–2005 годах, [42] последующие усовершенствования мультитач были запатентованы Apple [43] ).

Однако Бюро по патентам и товарным знакам США заявило, что функция «масштабирования» была предсказана патентом США № 7,844,915 [44] [45] , касающимся жестов на сенсорных экранах, поданным Браном Ферреном и Дэниелом Хиллисом в 2005 году, как была инерционная прокрутка, [46] таким образом лишила законной силы ключевые утверждения патента Apple.

В 2001 году началась разработка настольной сенсорной платформы Microsoft PixelSense (ранее Surface), которая взаимодействует как с прикосновениями пользователя, так и с его электронными устройствами, и стала коммерческой 29 мая 2007 года. Аналогичным образом в 2001 году компания Mitsubishi Electric Research Laboratories (MERL) ) начал разработку мультитач, многопользовательской системы под названием DiamondTouch .

В 2008 году Diamondtouch стал коммерческим продуктом и также основан на емкости, но способен различать нескольких одновременных пользователей или, скорее, стулья, на которых сидит каждый пользователь, или напольную подкладку, на которой пользователь стоит. В 2007 году лаборатория NORTD labs предложила систему с открытым исходным кодом CUBIT (мультитач) .

В 2008 году небольшие сенсорные устройства быстро стали обычным явлением. Ожидалось, что количество телефонов с сенсорным экраном увеличится с 200 000, поставленных в 2006 году, до 21 миллиона в 2012 году. [47]

В мае 2015 года Apple получила патент на «клавиатуру Fusion», которая превращает отдельные физические клавиши в мультисенсорные кнопки. [48]

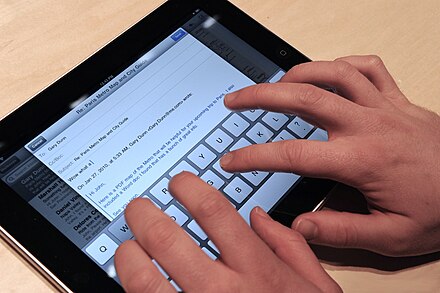

Apple продавала и распространяла множество продуктов с использованием технологии мультитач, в первую очередь смартфон iPhone и планшет iPad . Кроме того, Apple также владеет несколькими патентами , связанными с реализацией мультитач в пользовательских интерфейсах, [49] однако легитимность некоторых патентов оспаривается. [50] Apple также попыталась зарегистрировать «Multi-touch» в качестве товарного знака в США, однако ее запрос был отклонен Ведомством по патентам и товарным знакам США, поскольку оно сочло этот термин родовым . [51]

Мультисенсорное распознавание и обработка происходят с помощью датчика ASIC , прикрепленного к сенсорной поверхности. Обычно отдельные компании производят ASIC и экран, которые объединяются в сенсорный экран; и наоборот, поверхность тачпада и ASIC обычно производятся одной и той же компанией. В последние годы появились крупные компании, которые внедрились в растущую индустрию мультитач, предлагая системы, предназначенные для всех: от обычного пользователя до многонациональных организаций.

В настоящее время производители ноутбуков обычно включают в свои ноутбуки сенсорные панели с несколькими касаниями , а планшетные компьютеры реагируют на сенсорный ввод, а не на традиционный ввод с помощью стилуса, и это поддерживается многими современными операционными системами .

Некоторые компании фокусируются на крупномасштабных поверхностных вычислениях, а не на персональной электронике, будь то большие мультисенсорные столы или настенные поверхности. Эти системы обычно используются государственными организациями, музеями и компаниями в качестве средства информации или демонстрации выставок. [ нужна цитата ]

Мультитач реализован несколькими способами, в зависимости от размера и типа интерфейса. Наиболее популярной формой являются мобильные устройства, планшеты , сенсорные столы и стены. И сенсорные столы, и сенсорные стены проецируют изображение через акрил или стекло, а затем подсвечивают изображение светодиодами.

Сенсорные поверхности также можно сделать чувствительными к давлению, добавив чувствительное к давлению покрытие, которое изгибается по-разному в зависимости от того, насколько сильно на него нажимают, изменяя отражение. [52]

В портативных технологиях используется панель, несущая электрический заряд. Когда палец касается экрана, это прикосновение нарушает электрическое поле панели. Нарушение регистрируется как компьютерное событие (жест) и может быть отправлено в программное обеспечение, которое затем может инициировать ответ на событие жеста. [53]

За последние несколько лет несколько компаний выпустили продукты, использующие мультитач. Пытаясь сделать дорогую технологию более доступной, любители также опубликовали методы создания сенсорных экранов своими руками . [54]

К емкостным технологиям относятся: [55]

К резистивным технологиям относятся: [55]

Оптическая сенсорная технология основана на технологии датчика изображения . Он срабатывает, когда палец или какой-либо предмет касается поверхности, вызывая рассеивание света, отражение которого улавливается датчиками или камерами, которые отправляют данные в программное обеспечение, которое определяет реакцию на прикосновение, в зависимости от типа измеренного отражения.

К оптическим технологиям относятся: [55]

К акустическим и радиочастотным технологиям относятся: [55]

Мультисенсорные жесты на сенсорном экране позволяют использовать заранее заданные движения для взаимодействия с устройством и программным обеспечением. Все большее число устройств, таких как смартфоны , планшетные компьютеры , ноутбуки и настольные компьютеры, имеют функции, которые запускаются с помощью мультитач-жестов.

За годы до того, как технология мультитач стала жизнеспособным потребительским продуктом, популярная культура изображала потенциальное использование технологии мультитач в будущем, в том числе в нескольких частях франшизы « Звездный путь» .

В диснеевском научно-фантастическом фильме «Трон» 1982 года было показано устройство, похожее на Microsoft Surface. Он занимал весь стол руководителя и использовался для связи с главным управляющим компьютером .

В фильме 2002 года «Особое мнение» Том Круз использует набор перчаток, напоминающих мультитач-интерфейс, для просмотра информации. [57]

В фильме 2005 года «Остров» была показана другая форма мультисенсорного компьютера, где у профессора, которого играет Шон Бин , есть мультисенсорный рабочий стол для организации файлов, основанный на ранней версии Microsoft Surface [2] (не путают с планшетными компьютерами , которые теперь носят это название).

В 2007 году в шестом сезоне телесериала «CSI: Майами» были представлены как поверхностные, так и настенные мультисенсорные дисплеи.

Технологию мультитач можно увидеть в фильме о Джеймсе Бонде 2008 года «Квант милосердия» , где МИ-6 использует сенсорный интерфейс для просмотра информации о преступнике Доминике Грине. [58]

В фильме 2008 года « День, когда Земля остановилась» использовалась поверхность Microsoft. [59]

В телесериале «Морская полиция: Лос-Анджелес» , премьера которого состоялась в 2009 году, используются мультисенсорные поверхности и настенные панели в качестве инициативы по переходу на цифровые технологии.

В эпизоде телесериала «Симпсоны» 2008 года Лиза Симпсон отправляется в подводную штаб-квартиру Mapple, чтобы навестить Стива Моббса, который, как показано, выполняет несколько мультитач-жестов руками на большой сенсорной стене.

В фильме 2009 года « Район 9» интерфейс, используемый для управления инопланетным кораблем, использует аналогичную технологию. [60]

10/GUI — это предлагаемая новая парадигма пользовательского интерфейса . Созданный в 2009 году Р. Клейтоном Миллером, он сочетает в себе мультисенсорный ввод с новым оконным менеджером .

Он отделяет сенсорную поверхность от экрана, поэтому утомляемость пользователя снижается, а руки пользователей не загораживают дисплей. [61] Вместо размещения окон по всему экрану оконный менеджер Con10uum использует линейную парадигму с мультитач, используемым для навигации между окнами и их расположения. [62] Область в правой части сенсорного экрана вызывает глобальное контекстное меню, а аналогичная полоса в левой части вызывает меню для конкретных приложений.

Предварительная версия оконного менеджера Con10uum с открытым исходным кодом была доступна в ноябре 2009 года .

{{cite book}}: CS1 maint: date and year (link) CS1 maint: multiple names: authors list (link)And we have invented a new technology called Multi-touch