Обучение без учителя — это метод машинного обучения , при котором, в отличие от обучения с учителем , алгоритмы изучают закономерности исключительно на основе немаркированных данных. Есть надежда, что посредством мимикрии, которая является важным способом обучения людей, машина будет вынуждена построить краткое представление своего мира, а затем генерировать из него образный контент.

Другими методами в спектре контроля являются обучение с подкреплением , при котором машине в качестве руководства присваивается только числовая оценка производительности, а также слабый или полуконтроль , при котором помечается небольшая часть данных, и самоконтроль .

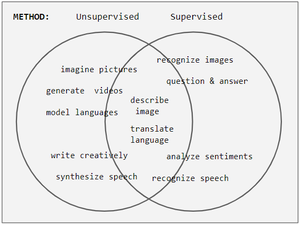

Задачи нейронной сети часто подразделяются на дискриминационные (распознавание) или генеративные (воображение). Часто, но не всегда, в различительных задачах используются контролируемые методы, а в генеративных задачах — неконтролируемые (см. диаграмму Венна ); однако разделение очень размыто. Например, распознавание объектов способствует обучению с учителем, но обучение без учителя также может группировать объекты в группы. Более того, по мере продвижения вперед в некоторых задачах используются оба метода, а в некоторых задачах меняется один на другой. Например, распознавание изображений началось с жесткого контроля, но стало гибридным из-за использования неконтролируемого предварительного обучения, а затем снова перешло к контролю с появлением отсева , ReLU и адаптивных скоростей обучения .

На этапе обучения неконтролируемая сеть пытается имитировать предоставленные ей данные и использует ошибку в имитируемых выходных данных, чтобы исправить себя (т. е. исправить свои веса и смещения). Иногда ошибка выражается как низкая вероятность возникновения ошибочного вывода или как нестабильное состояние с высокой энергией в сети.

В отличие от доминирующего использования обратного распространения ошибки в методах с учителем , в обучении без учителя также используются другие методы, в том числе: правило обучения Хопфилда, правило обучения Больцмана, контрастное расхождение , бодрствование во сне , вариационный вывод , максимальное правдоподобие , максимум апостериори , выборка Гиббса и ошибки реконструкции с обратным распространением ошибки. или скрытые репараметризации состояния. Более подробную информацию смотрите в таблице ниже.

Энергетическая функция — это макроскопическая мера состояния активации сети. В машинах Больцмана она играет роль функции стоимости. Эта аналогия с физикой навеяна анализом Людвигом Больцманом макроскопической энергии газа на основе микроскопических вероятностей движения частиц , где k — постоянная Больцмана, а T — температура. В сети RBM соотношение , [1] где и варьируются по каждому возможному шаблону активации и . Точнее, , где – закономерность активации всех нейронов (видимых и скрытых). Следовательно, некоторые ранние нейронные сети носят название «Машина Больцмана». Павел Смоленский называет Гармонию . Сеть ищет низкую энергию, которая является высокой Гармонией.

В этой таблице приведены схемы подключения различных неконтролируемых сетей, подробности о которых будут приведены в разделе «Сравнение сетей». Круги — это нейроны, а ребра между ними — веса связей. По мере изменения конструкции сети функции добавляются, чтобы обеспечить новые возможности, или удаляются, чтобы ускорить обучение. Например, нейроны меняются между детерминированными (Хопфилд) и стохастическими (Больцманн), чтобы обеспечить устойчивый вывод, веса удаляются внутри слоя (RBM), чтобы ускорить обучение, или соединениям позволяют стать асимметричными (Гельмгольц).

Из сетей, носящих имена людей, только Хопфилд работал напрямую с нейронными сетями. Больцман и Гельмгольц появились раньше искусственных нейронных сетей, но их работы в области физики и физиологии вдохновили на использование аналитических методов.

Здесь мы выделим некоторые характеристики избранных сетей. Подробности о каждом из них приведены в сравнительной таблице ниже.

Классическим примером обучения без учителя при изучении нейронных сетей является принцип Дональда Хебба , то есть нейроны, которые срабатывают вместе, соединяются вместе. [4] При обучении Хебба связь усиливается независимо от ошибки, но является исключительно функцией совпадения потенциалов действия между двумя нейронами. [5] Аналогичная версия, которая изменяет синаптические веса, учитывает время между потенциалами действия ( пластичность, зависящая от времени спайка, или STDP). Было высказано предположение, что хеббианское обучение лежит в основе ряда когнитивных функций, таких как распознавание образов и экспериментальное обучение.

Среди моделей нейронных сетей в алгоритмах обучения без учителя обычно используются самоорганизующаяся карта (SOM) и теория адаптивного резонанса (ART). SOM — это топографическая организация, в которой близлежащие места на карте представляют собой входные данные со схожими свойствами. Модель ART позволяет изменять количество кластеров в зависимости от размера проблемы и позволяет пользователю контролировать степень сходства между членами одних и тех же кластеров с помощью определяемой пользователем константы, называемой параметром бдительности. Сети ART используются для многих задач распознавания образов, таких как автоматическое распознавание целей и обработка сейсмических сигналов. [6]

Двумя основными методами, используемыми в обучении без учителя, являются анализ главных компонентов и кластерный анализ . Кластерный анализ используется при обучении без учителя для группировки или сегментирования наборов данных с общими атрибутами для экстраполяции алгоритмических связей. [7] Кластерный анализ — это отрасль машинного обучения , которая группирует данные, которые не были помечены , классифицированы или категоризированы. Вместо реагирования на обратную связь кластерный анализ выявляет общие черты в данных и реагирует на основе наличия или отсутствия таких общих черт в каждой новой части данных. Этот подход помогает обнаружить аномальные точки данных, которые не вписываются ни в одну группу.

Основное применение обучения без учителя находится в области оценки плотности в статистике [8] , хотя обучение без учителя охватывает множество других областей, включающих обобщение и объяснение особенностей данных. Его можно противопоставить обучению с учителем, сказав, что обучение с учителем направлено на вывод условного распределения вероятностей , обусловленного меткой входных данных; Обучение без учителя направлено на получение априорного распределения вероятностей.

Некоторые из наиболее распространенных алгоритмов, используемых в обучении без учителя, включают: (1) Кластеризация, (2) Обнаружение аномалий, (3) Подходы к обучению моделей со скрытыми переменными. Каждый подход использует несколько методов, а именно:

Одним из статистических подходов к обучению без учителя является метод моментов . В методе моментов неизвестные параметры (интересующие) в модели связаны с моментами одной или нескольких случайных величин, и, таким образом, эти неизвестные параметры могут быть оценены с учетом моментов. Моменты обычно оцениваются по выборкам эмпирическим путем. Базовыми моментами являются моменты первого и второго порядка. Для случайного вектора момент первого порядка — это средний вектор, а момент второго порядка — ковариационная матрица (когда среднее значение равно нулю). Моменты более высокого порядка обычно представляются с помощью тензоров , которые представляют собой обобщение матриц до более высоких порядков в виде многомерных массивов.

В частности, показана эффективность метода моментов при изучении параметров моделей со скрытыми переменными . Модели со скрытыми переменными — это статистические модели, в которых помимо наблюдаемых переменных существует также набор скрытых переменных, которые не наблюдаются. Весьма практичным примером моделей скрытых переменных в машинном обучении является тематическое моделирование , которое представляет собой статистическую модель для генерации слов (наблюдаемых переменных) в документе на основе темы (латентной переменной) документа. При тематическом моделировании слова в документе генерируются в соответствии с различными статистическими параметрами при изменении темы документа. Показано, что метод моментов (методы тензорной декомпозиции) последовательно восстанавливают параметры большого класса моделей со скрытыми переменными при некоторых предположениях. [11]

Алгоритм ожидания-максимизации (EM) также является одним из наиболее практичных методов изучения моделей со скрытыми переменными. Однако он может застрять в локальных оптимумах, и нет гарантии, что алгоритм сходится к истинным неизвестным параметрам модели. Напротив, для метода моментов глобальная сходимость гарантируется при некоторых условиях.