В статистике коэффициент детерминации , обозначаемый R 2 или r 2 и произносимый как «R в квадрате», представляет собой долю изменения зависимой переменной, которую можно предсказать на основе независимой переменной (переменных).

Это статистика, используемая в контексте статистических моделей , основной целью которых является либо прогнозирование будущих результатов, либо проверка гипотез на основе другой соответствующей информации. Он обеспечивает оценку того, насколько хорошо наблюдаемые результаты воспроизводятся моделью, на основе доли общей вариации результатов, объясненной моделью. [1] [2] [3]

Существует несколько определений R2 , которые лишь иногда эквивалентны. Один класс таких случаев включает в себя простую линейную регрессию , где вместо R 2 используется r 2 . Когда включен только перехват , тогда r 2 представляет собой просто квадрат выборочного коэффициента корреляции (т. е. r ) между наблюдаемыми результатами и наблюдаемыми значениями предикторов. [4] Если включены дополнительные регрессоры , R 2 представляет собой квадрат коэффициента множественной корреляции . В обоих случаях коэффициент детерминации обычно находится в диапазоне от 0 до 1.

Есть случаи, когда R 2 может давать отрицательные значения. Это может возникнуть, когда прогнозы, которые сравниваются с соответствующими результатами, не были получены в результате процедуры подбора модели с использованием этих данных. Даже если использовалась процедура подбора модели, R 2 все равно может быть отрицательным, например, когда линейная регрессия проводится без включения точки пересечения [5] или когда для подбора данных используется нелинейная функция. [6] В случаях, когда возникают отрицательные значения, среднее значение данных обеспечивает лучшее соответствие результатам, чем значения подобранной функции, согласно этому конкретному критерию.

Коэффициент детерминации может быть более (интуитивно) информативным, чем MAE , MAPE , MSE и RMSE при оценке регрессионного анализа , поскольку первый может быть выражен в процентах, тогда как вторые меры имеют произвольные диапазоны. Он также оказался более устойчивым к плохим соответствиям по сравнению с SMAPE на тестовых наборах данных в статье. [7]

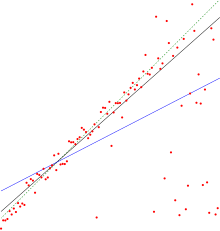

При оценке согласия смоделированных ( Y pred ) и измеренных ( Y obs ) значений нецелесообразно основывать это на R 2 линейной регрессии (т. е. Y obs = m · Y pred + b ). [ нужна ссылка ] R 2 количественно определяет степень любой линейной корреляции между Y obs и Y pred , в то время как для оценки согласия следует принимать во внимание только одну конкретную линейную корреляцию: Y obs = 1 · Y pred + 0 (т.е. линия 1:1). [8] [9]

Набор данных имеет n значений, отмеченных y 1 ,..., y n (вместе известных как y i или вектор y = [ y 1 ,..., y n ] T ), каждое из которых связано с подобранным (или смоделированным) , или предсказанное) значение f 1 ,..., f n (известное как fi , или иногда ŷ i , как вектор f ).

Определите остатки как e i = y i - f i (образуя вектор e ).

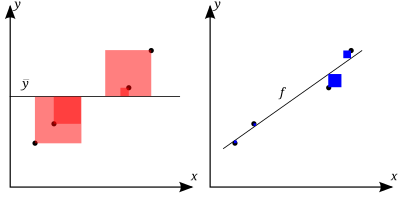

Если – среднее значение наблюдаемых данных:

Наиболее общее определение коэффициента детерминации:

В лучшем случае смоделированные значения точно соответствуют наблюдаемым значениям, что приводит к и . Базовая модель, которая всегда предсказывает , будет иметь . Модели, прогнозы которых хуже этого базового уровня, будут иметь отрицательный результат .

В общей форме можно увидеть, что R 2 связан с долей необъяснимой дисперсии (FVU), поскольку второй член сравнивает необъяснимую дисперсию (дисперсию ошибок модели) с общей дисперсией (данных):

Большее значение R 2 подразумевает более успешную регрессионную модель. [4] : 463 Предположим, R 2 = 0,49. Это означает, что 49% изменчивости зависимой переменной в наборе данных учтено, а оставшийся 51% изменчивости все еще не учтен. Для регрессионных моделей сумма квадратов регрессии, также называемая объясненной суммой квадратов , определяется как

В некоторых случаях, как в простой линейной регрессии , общая сумма квадратов равна сумме двух других сумм квадратов, определенных выше:

См. Разделение в общей модели МНК для получения этого результата для одного случая, когда это соотношение выполняется. Когда это соотношение действительно выполняется, приведенное выше определение R 2 эквивалентно

где n — количество наблюдений (случаев) над переменными.

В этой форме R 2 выражается как отношение объясненной дисперсии (дисперсии предсказаний модели, которая равна SS reg / n ) к общей дисперсии (выборочной дисперсии зависимой переменной, которая равна SS tot / n ).

Это разделение суммы квадратов справедливо, например, когда значения модели ƒ i были получены с помощью линейной регрессии . Более мягкое достаточное условие имеет вид: Модель имеет вид

где q i - произвольные значения, которые могут зависеть или не зависеть от i или других свободных параметров (обычный выбор q i = x i - это всего лишь один частный случай), а оценки коэффициентов и получаются путем минимизации остаточной суммы квадратов .

Этот набор условий является важным и имеет ряд последствий для свойств подобранных остатков и смоделированных значений. В частности, в этих условиях:

В линейной множественной регрессии по методу наименьших квадратов с оценкой члена пересечения R 2 равен квадрату коэффициента корреляции Пирсона между наблюдаемыми и смоделированными (прогнозируемыми) значениями данных зависимой переменной.

В линейной регрессии наименьших квадратов с одним объяснителем, но без члена-члена , это также равно квадрату коэффициента корреляции Пирсона зависимой переменной и объясняющей переменной.

Его не следует путать с коэффициентом корреляции между двумя объясняющими переменными , определяемым как

где ковариация между двумя оценками коэффициентов, а также их стандартные отклонения получаются из ковариационной матрицы оценок коэффициентов .

В более общих условиях моделирования, когда прогнозируемые значения могут быть сгенерированы на основе модели, отличной от линейной регрессии наименьших квадратов, значение R 2 может быть рассчитано как квадрат коэффициента корреляции между исходными и смоделированными значениями данных. В этом случае значение не является прямой мерой того, насколько хороши смоделированные значения, а скорее мерой того, насколько хорош предиктор может быть построен на основе смоделированных значений (путем создания пересмотренного предиктора формы α + βƒ i ). [ нужна цитата ] Согласно Эверитту, [10] это использование представляет собой определение термина «коэффициент детерминации»: квадрат корреляции между двумя (общими) переменными.

R 2 является мерой соответствия модели. [11] В регрессии коэффициент детерминации R 2 является статистической мерой того, насколько хорошо прогнозы регрессии приближаются к реальным точкам данных. R 2 из 1 указывает на то, что прогнозы регрессии идеально соответствуют данным.

Значения R 2 вне диапазона от 0 до 1 возникают, когда модель соответствует данным хуже, чем худший возможный предиктор наименьших квадратов (эквивалент горизонтальной гиперплоскости на высоте, равной среднему значению наблюдаемых данных). Это происходит, когда была выбрана неверная модель или по ошибке были применены бессмысленные ограничения. Если используется уравнение 1 Кволсета [12] (это уравнение используется чаще всего), R 2 может быть меньше нуля. Если используется уравнение 2 Кволсета, R 2 может быть больше единицы.

Во всех случаях, когда используется R 2 , предикторы рассчитываются с помощью обычной регрессии наименьших квадратов, то есть путем минимизации SS res . В этом случае R 2 увеличивается с увеличением количества переменных в модели ( R 2 монотонно увеличивается с увеличением количества включенных переменных — он никогда не уменьшится). Это иллюстрирует недостаток одного из возможных вариантов использования R 2 , когда можно продолжать добавлять переменные ( регрессия кухонной мойки ) для увеличения значения R 2 . Например, если кто-то пытается спрогнозировать продажи модели автомобиля, исходя из расхода бензина, цены и мощности двигателя, можно включить такие несущественные факторы, как первая буква названия модели или рост ведущего инженера, проектирующего модель. автомобиль, потому что R 2 никогда не уменьшится при добавлении переменных и, скорее всего, увеличится только по случайности.

Это приводит к альтернативному подходу рассмотрения скорректированного R2. Объяснение этой статистики почти такое же, как и R 2 , но оно ухудшает статистику, поскольку в модель включены дополнительные переменные. Для случаев, отличных от аппроксимации обычным методом наименьших квадратов, статистика R 2 может быть рассчитана, как указано выше, и все равно может быть полезной мерой. Если аппроксимация осуществляется методом взвешенных наименьших квадратов или обобщенным методом наименьших квадратов , альтернативные версии R 2 могут быть рассчитаны в соответствии с этими статистическими основами, в то время как «необработанный» R 2 все еще может быть полезен, если его легче интерпретировать. Значения R 2 можно рассчитать для любого типа прогнозной модели, которая не обязательно должна иметь статистическую основу.

Рассмотрим линейную модель с более чем одной объясняющей переменной вида

где для i- го случая – переменная ответа, – p- регрессоры, и – средний член с нулевой ошибкой . Величины представляют собой неизвестные коэффициенты, значения которых оцениваются методом наименьших квадратов . Коэффициент детерминации R 2 является мерой глобального соответствия модели. В частности, R 2 является элементом [0, 1] и представляет собой долю изменчивости в Y i , которую можно отнести к некоторой линейной комбинации регрессоров ( объяснительных переменных ) в X. [13]

R 2 часто интерпретируется как доля вариации ответа, «объясняемая» регрессорами в модели. Таким образом, R 2 = 1 указывает на то, что подобранная модель объясняет всю изменчивость в , тогда как R 2 = 0 указывает на отсутствие «линейной» зависимости (для регрессии по прямой это означает, что модель прямой линии представляет собой постоянную линию (наклон = 0, пересечение = ) между переменной ответа и регрессорами). Внутреннее значение, такое как R 2 = 0,7, можно интерпретировать следующим образом: «Семьдесят процентов дисперсии переменной отклика можно объяснить объясняющими переменными. Остальные тридцать процентов можно отнести к неизвестным, скрытым переменным или внутренней изменчивости».

Предостережение, которое применимо к R 2 , как и к другим статистическим описаниям корреляции и ассоциации, заключается в том, что « корреляция не подразумевает причинно-следственную связь ». Другими словами, хотя корреляции иногда могут дать ценные подсказки для выявления причинно-следственных связей между переменными, ненулевая предполагаемая корреляция между двумя переменными сама по себе не является свидетельством того, что изменение значения одной переменной приведет к изменениям значений других переменных. другие переменные. Например, практика ношения спичек (или зажигалки) коррелирует с заболеваемостью раком легких, но ношение спичек не вызывает рак (в стандартном смысле «причины»).

В случае одного регрессора, аппроксимируемого методом наименьших квадратов, R 2 представляет собой квадрат коэффициента корреляции момента произведения Пирсона, связывающего регрессор и переменную отклика. В более общем смысле, R 2 представляет собой квадрат корреляции между построенным предиктором и переменной ответа. При наличии более чем одного регрессора R 2 можно назвать коэффициентом множественной детерминации .

В регрессии наименьших квадратов с использованием типичных данных R 2 как минимум слабо возрастает с увеличением числа регрессоров в модели. Поскольку увеличение количества регрессоров увеличивает значение R 2 , сам по себе R 2 не может использоваться для значимого сравнения моделей с очень разным количеством независимых переменных. Для значимого сравнения двух моделей можно провести F-тест по остаточной сумме квадратов [ нужна ссылка ] , аналогичный F-тестам в причинности Грейнджера , хотя это не всегда уместно [ нужны дальнейшие объяснения ] . Напоминая об этом, некоторые авторы обозначают R 2 через R q 2 , где q — количество столбцов в X (количество объяснителей, включая константу).

Чтобы продемонстрировать это свойство, сначала вспомните, что целью линейной регрессии по методу наименьших квадратов является

где X i - вектор-строка значений объясняющих переменных для случая i, а b - вектор-столбец коэффициентов соответствующих элементов X i .

Оптимальное значение цели немного меньше по мере того, как добавляется больше объясняющих переменных и, следовательно, добавляются дополнительные столбцы (матрицы объяснительных данных, i -я строка которой равна X i ), поскольку менее ограниченная минимизация приводит к оптимальной стоимости, которая равна немного меньше, чем более ограниченная минимизация. Учитывая предыдущий вывод и учитывая, что оно зависит только от y , свойство неубывания R 2 следует непосредственно из определения, приведенного выше.

Интуитивная причина того, что использование дополнительной объясняющей переменной не может снизить R2 , заключается в следующем: минимизация эквивалентна максимизации R2 . Когда включена дополнительная переменная, данные всегда имеют возможность присвоить ей расчетный коэффициент, равный нулю, оставив прогнозируемые значения и R 2 неизменными. Единственный способ, при котором задача оптимизации даст ненулевой коэффициент, — это улучшить R 2 .

Вышеизложенное дает аналитическое объяснение инфляции R 2 . Далее ниже показан пример, основанный на обычном методе наименьших квадратов с геометрической точки зрения. [14]

Простой случай, который следует рассмотреть в первую очередь:

Это уравнение описывает обычную модель регрессии наименьших квадратов с одним регрессором. Прогноз показан красным вектором на рисунке справа. Геометрически это проекция истинного значения на пространство модели (без пересечения). Остаток показан красной линией.

Это уравнение соответствует обычной модели регрессии наименьших квадратов с двумя регрессорами. Прогноз показан синим вектором на рисунке справа. Геометрически это проекция истинного значения на большее пространство модели (без пересечения). Примечательно, что значения и не такие, как в уравнении для меньшего модельного пространства, если и не являются нулевыми векторами. Следовательно, ожидается, что уравнения будут давать разные предсказания (т. е. ожидается, что синий вектор будет отличаться от красного вектора). Критерий регрессии наименьших квадратов гарантирует минимизацию остатка. На рисунке синяя линия, представляющая остаток, ортогональна пространству модели в , что указывает на минимальное расстояние от пространства.

Меньшее модельное пространство является подпространством большего, поэтому остаток меньшей модели гарантированно будет больше. Если сравнить красную и синюю линии на рисунке, то можно увидеть, что синяя линия ортогональна пространству, а любая другая линия будет больше синей. Учитывая расчет для R 2 , меньшее значение приведет к большему значению R 2 , а это означает, что добавление регрессоров приведет к инфляции R 2 .

R 2 не указывает,:

Использование скорректированного R 2 (одно распространенное обозначение произносится как «R bar в квадрате»; другое — или ) является попыткой объяснить явление автоматического увеличения R 2 при добавлении в модель дополнительных объясняющих переменных. Есть много разных способов регулировки. [15] Безусловно, наиболее часто используемым, вплоть до того, что его обычно называют просто скорректированным R , является исправление, предложенное Мордехаем Иезекиилем . [15] [16] [17] Скорректированный R 2 определяется как

где df res — это степени свободы оценки дисперсии совокупности вокруг модели, а df tot — это степени свободы оценки дисперсии совокупности вокруг среднего значения. df res определяется размером выборки n и количеством переменных p в модели: df res = n − p . df tot задается таким же образом, но при этом p равно единице для среднего значения, т.е. df tot = n - 1.

Подставляя степени свободы и используя определение R 2 , его можно переписать как:

где p — общее количество объясняющих переменных в модели, [18] и n — размер выборки.

Скорректированный R 2 может быть отрицательным, и его значение всегда будет меньше или равно значению R 2 . В отличие от R 2 , скорректированный R 2 увеличивается только тогда, когда увеличение R 2 (из-за включения новой объясняющей переменной) больше, чем можно было бы ожидать случайно. Если набор объясняющих переменных с заранее определенной иерархией важности вводится в регрессию по одной, при этом скорректированный R 2 вычисляется каждый раз, то уровень, на котором скорректированный R 2 достигает максимума, а затем снижается, будет регрессией. с идеальным сочетанием наилучшего соответствия без лишних/ненужных условий.

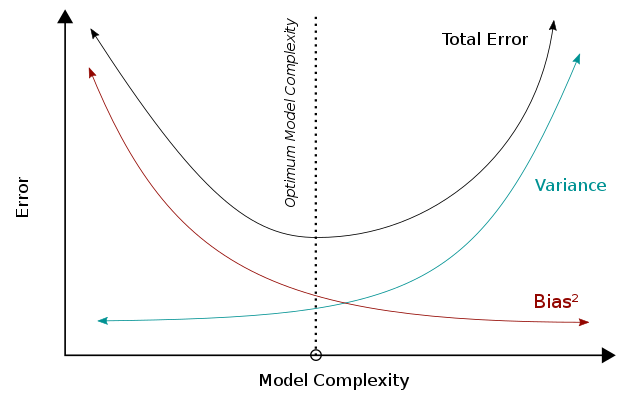

Скорректированный R 2 можно интерпретировать как пример компромисса между смещением и дисперсией . Когда мы рассматриваем производительность модели, меньшая ошибка означает лучшую производительность. Когда модель становится более сложной, дисперсия будет увеличиваться, тогда как квадрат смещения будет уменьшаться, и эти две метрики в сумме образуют общую ошибку. Сочетая эти две тенденции, компромисс между смещением и дисперсией описывает взаимосвязь между производительностью модели и ее сложностью, которая показана в виде U-образной кривой справа. В частности, для скорректированного R 2 сложность модели (т.е. количество параметров) влияет на R 2 и термин/разрыв и тем самым отражает их атрибуты в общей производительности модели.

R 2 можно интерпретировать как дисперсию модели, на которую влияет сложность модели. Высокий R 2 указывает на меньшую ошибку смещения, поскольку модель может лучше объяснить изменение Y с помощью предикторов. По этой причине мы делаем меньше (ошибочных) предположений, и это приводит к меньшей ошибке смещения. Между тем, чтобы учесть меньше предположений, модель имеет тенденцию быть более сложной. Исходя из компромисса смещения и дисперсии, более высокая сложность приведет к уменьшению смещения и лучшей производительности (ниже оптимальной линии). В , член (1- R 2 ) будет ниже с высокой сложностью и приведет к более высокому значению , что постоянно указывает на лучшую производительность.

С другой стороны, на термин/член гидроразрыва обратное влияние оказывает сложность модели. Срок/разрыв увеличится при добавлении регрессоров (т. е. увеличится сложность модели) и приведет к ухудшению производительности. На основании компромисса между смещением и дисперсией более высокая сложность модели (за пределами оптимальной линии) приводит к увеличению ошибок и снижению производительности.

Учитывая расчет , большее количество параметров приведет к увеличению R 2 и приведет к увеличению . Тем не менее, добавление большего количества параметров приведет к увеличению срока/разрыва и, следовательно, уменьшению . Эти две тенденции создают обратную U-образную зависимость между сложностью модели и , которая согласуется с U-образной тенденцией зависимости сложности модели от общей производительности. В отличие от R 2 , который всегда будет увеличиваться при увеличении сложности модели, он будет увеличиваться только тогда, когда смещение, устраняемое добавленным регрессором, превышает дисперсию, вносимую одновременно. Таким образом , использование вместо R 2 может предотвратить переобучение.

Следуя той же логике, скорректированный R 2 можно интерпретировать как менее смещенную оценку генеральной совокупности R 2 , тогда как наблюдаемая выборка R 2 представляет собой положительно смещенную оценку стоимости генеральной совокупности. [19] Скорректированный R 2 более подходит при оценке соответствия модели (дисперсия зависимой переменной, учитываемая независимыми переменными) и при сравнении альтернативных моделей на этапе выбора признаков при построении модели. [19]

Принцип скорректированной статистики R 2 можно увидеть, переписав обычный R 2 как

где и представляют собой выборочные дисперсии оцененных остатков и зависимой переменной соответственно, которые можно рассматривать как смещенные оценки генеральных дисперсий ошибок и зависимой переменной. Эти оценки заменяются статистически несмещенными версиями: и .

Несмотря на использование несмещенных оценок генеральной дисперсии ошибки и зависимой переменной, скорректированный R 2 не является несмещенной оценкой генеральной совокупности R 2 , [19] что является результатом использования генеральной дисперсии ошибок и зависимой переменной вместо оценки их. Ингрэм Олкин и Джон В. Пратт получили несмещенную оценку минимальной дисперсии для совокупности R 2 , [20] которая известна как оценка Олкина-Пратта. Сравнение различных подходов к корректировке R 2 пришло к выводу, что в большинстве ситуаций либо приблизительная версия оценки Олкина-Пратта [19] , либо точная версия оценки Олкина-Пратта [21] должна быть предпочтительнее скорректированного (Иезекииля) R 2 .

Коэффициент частичной детерминации можно определить как долю вариации, которую невозможно объяснить в сокращенной модели, но можно объяснить с помощью предикторов, указанных в полной (полной) модели. [22] [23] [24] Этот коэффициент используется для определения того, могут ли один или несколько дополнительных предикторов быть полезны в более подробной регрессионной модели.

Расчет частичного R 2 относительно прост после оценки двух моделей и создания для них таблиц ANOVA . Расчет для частичного R 2 следующий:

что аналогично обычному коэффициенту детерминации:

Как объяснялось выше, эвристики выбора модели, такие как скорректированный критерий и F-тест, проверяют, достаточно ли увеличивается общая сумма , чтобы определить, следует ли добавить в модель новый регрессор. Если к модели добавляется регрессор, который сильно коррелирует с другими уже включенными регрессорами, то общая сумма вряд ли увеличится, даже если новый регрессор имеет значение. В результате вышеупомянутые эвристики будут игнорировать соответствующие регрессоры, когда взаимная корреляция высока. [25]

В качестве альтернативы можно разложить обобщенную версию, чтобы количественно оценить релевантность отклонения от гипотезы. [25] Как показывает Хорнвег (2018), некоторые средства оценки усадки , такие как байесовская линейная регрессия , гребневая регрессия и (адаптивное) лассо , используют это разложение, когда они постепенно сокращают параметры от неограниченных решений OLS до гипотетических значений. . Давайте сначала определим модель линейной регрессии как

Предполагается, что матрица стандартизирована с помощью Z-показателей и что вектор-столбец центрирован так, чтобы иметь нулевое среднее значение. Пусть вектор-столбец относится к предполагаемым параметрам регрессии, а вектор-столбец обозначает оцененные параметры. Затем мы можем определить

Значение 75 % означает, что точность в выборке повышается на 75 %, если вместо гипотетических значений используются решения, оптимизированные для данных . В частном случае, когда вектор нулей, мы снова получаем традиционное решение.

Индивидуальный эффект отклонения от гипотезы можно вычислить с помощью («R-outer»). Эта матрица времен определяется выражением

где . Диагональные элементы точно в сумме составляют . Если регрессоры некоррелированы и представляют собой вектор нулей, то диагональный элемент просто соответствует значению между и . Когда регрессоры и коррелируют, может увеличиться за счет уменьшения . В результате диагональные элементы могут быть меньше 0 и, в более исключительных случаях, больше 1. Чтобы справиться с такими неопределенностями, некоторые средства оценки усадки неявно берут средневзвешенное значение диагональных элементов для количественной оценки релевантности отклонения от предполагаемое значение. [25] Нажмите на лассо , чтобы увидеть пример.

В случае логистической регрессии , обычно подходящей по максимальному правдоподобию , существует несколько вариантов псевдо-R 2 .

Одним из них является обобщенный R2 , первоначально предложенный Коксом и Снеллом [26] и независимо Маги: [27]

где — правдоподобие модели только с отрезком, — правдоподобие оцененной модели (т. е. модели с заданным набором оценок параметров), а n — размер выборки. Его легко переписать так:

где D — тестовая статистика теста отношения правдоподобия .

Нико Нагелькерке отметил, что он обладает следующими свойствами: [28] [23]

Однако в случае логистической модели, где значение R 2 не может быть больше 1, R 2 находится в диапазоне от 0 до : таким образом, Нагелькерке предложил возможность определить масштабированный R 2 как R 2 / R 2 max . [23]

Иногда для определения степени соответствия используется норма остатков. Этот член рассчитывается как квадратный корень из суммы квадратов остатков :

И R 2 , и норма остатков имеют свои относительные преимущества. Для анализа методом наименьших квадратов R 2 варьируется от 0 до 1, причем большие числа указывают на лучшее соответствие, а 1 — на идеальное соответствие. Норма остатков варьируется от 0 до бесконечности, при этом меньшие числа указывают на лучшее соответствие, а ноль — на идеальное соответствие. Одним из преимуществ и недостатков R 2 является то, что термин действует для нормализации значения. Если все значения y i умножить на константу, норма остатков также изменится на эту константу, но R 2 останется прежним. В качестве базового примера для линейного метода наименьших квадратов, подходящего к набору данных:

R 2 = 0,998, норма остатков = 0,302.

Если все значения у умножить на 1000 (например, при смене префикса СИ ), то R 2 останется прежним, но норма остатков = 302.

Еще одним однопараметрическим индикатором соответствия является среднеквадратическое отклонение остатков или стандартное отклонение остатков. Для приведенного выше примера это значение будет равно 0,135, учитывая, что подгонка была линейной с непринудительным пересечением. [29]

Создание коэффициента детерминации приписывается генетику Сьюэллу Райту и впервые было опубликовано в 1921 году. [30]