Подгонка распределения вероятностей или просто подгонка распределения — это подгонка распределения вероятностей к ряду данных, касающихся повторных измерений переменного явления. Цель подгонки распределения — предсказать вероятность или прогнозировать частоту появления величины явления в определенном интервале.

Существует множество распределений вероятностей (см. список распределений вероятностей ), некоторые из которых могут быть более точно подобраны к наблюдаемой частоте данных, чем другие, в зависимости от характеристик явления и распределения. Распределение, дающее близкое соответствие, должно приводить к хорошим прогнозам. Поэтому при подгонке распределения необходимо выбрать распределение, которое хорошо подходит к данным.

Выбор подходящего распределения зависит от наличия или отсутствия симметрии набора данных относительно центральной тенденции .

Симметричное распределение

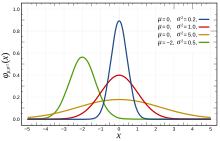

Когда данные симметрично распределены вокруг среднего значения, а частота появления данных, более удаленных от среднего, уменьшается, можно, например, выбрать нормальное распределение , логистическое распределение или распределение Стьюдента . Первые два очень похожи, тогда как последнее, с одной степенью свободы, имеет «более тяжелые хвосты», что означает, что значения, более удаленные от среднего, встречаются относительно чаще (т. е. эксцесс выше). Распределение Коши также симметрично.

Распределения смещены вправо

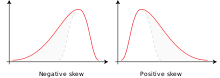

Когда большие значения имеют тенденцию быть дальше от среднего, чем меньшие значения, то имеем асимметричное распределение вправо (т. е. имеет место положительная асимметрия ), можно, например, выбрать логнормальное распределение (т. е. логарифмические значения данных распределены нормально ), логлогистическое распределение (т. е. логарифмические значения данных следуют логистическому распределению ), распределение Гумбеля , экспоненциальное распределение , распределение Парето , распределение Вейбулла , распределение Берра или распределение Фреше . Последние четыре распределения ограничены слева.

Распределения смещены влево

Когда меньшие значения, как правило, находятся дальше от среднего, чем большие значения, то имеет место смещение распределения влево (т. е. отрицательная асимметрия). Например, можно выбрать квадратично-нормальное распределение (т. е. нормальное распределение, примененное к квадрату значений данных), [1] инвертированное (зеркальное) распределение Гумбеля, [1] распределение Дагума (зеркальное распределение Берра) или распределение Гомпертца , которое ограничено слева.

Существуют следующие методы подбора распределения: [2]

Обычно данные преобразуются логарифмически, чтобы подогнать симметричные распределения (например, нормальное и логистическое ) к данным, подчиняющимся распределению, которое имеет положительную асимметрию (т. е. асимметрию вправо, со средним значением > моды и с правым хвостом, который длиннее левого хвоста), см. логнормальное распределение и логлогистическое распределение . Аналогичного эффекта можно добиться, извлекая квадратный корень из данных.

Чтобы подобрать симметричное распределение к данным, подчиняющимся отрицательно скошенному распределению (т.е. скошенным влево, со средним значением < моды и с правым хвостом, который короче левого), можно использовать квадраты значений данных для выполнения подгонки.

В более общем случае можно возвести данные в степень p, чтобы подогнать симметричные распределения к данным, подчиняющимся распределению любой асимметрии, при этом p < 1, когда асимметрия положительная, и p > 1, когда асимметрия отрицательная. Оптимальное значение p должно быть найдено численным методом . Численный метод может состоять из предположения о диапазоне значений p , затем многократного применения процедуры подгонки распределения для всех предполагаемых значений p и, наконец, выбора значения p, для которого сумма квадратов отклонений вычисленных вероятностей от измеренных частот ( хи-квадрат ) минимальна, как это делается в CumFreq .

Обобщение повышает гибкость распределений вероятностей и увеличивает их применимость при подгонке распределений. [6]

Универсальность обобщения позволяет, например, подогнать приблизительно нормально распределенные наборы данных под большое количество различных распределений вероятностей [7] , в то время как отрицательно скошенные распределения можно подогнать под квадратично-нормальные и зеркальные распределения Гумбеля [8] .

Перекошенные распределения можно инвертировать (или зеркально отобразить), заменив в математическом выражении кумулятивную функцию распределения (F) ее дополнением: F'=1-F, получив дополнительную функцию распределения (также называемую функцией выживания ), которая дает зеркальное изображение. Таким образом, распределение, перекошенное вправо, преобразуется в распределение, перекошенное влево, и наоборот.

Метод инверсии асимметрии увеличивает количество распределений вероятностей, доступных для подгонки распределения, и расширяет возможности подгонки распределения.

Некоторые распределения вероятностей, такие как экспоненциальное , не поддерживают отрицательные значения данных ( X ). Тем не менее, когда присутствуют отрицательные данные, такие распределения все еще можно использовать, заменяя X на Y = X - Xm , где Xm - минимальное значение X. Эта замена представляет собой сдвиг распределения вероятностей в положительном направлении, т. е. вправо, поскольку Xm отрицательно. После завершения подгонки распределения Y соответствующие значения X находятся из X = Y + Xm , что представляет собой обратный сдвиг распределения в отрицательном направлении, т. е. влево.

Техника сдвига распределения увеличивает шанс найти правильно подходящее распределение вероятностей.

Существует возможность использовать два различных распределения вероятностей, одно для нижнего диапазона данных, а другое для верхнего, как, например, распределение Лапласа . Диапазоны разделены точкой разрыва. Использование таких составных (прерывных) распределений вероятностей может быть уместным, когда данные изучаемого явления были получены при двух наборах различных условий. [6]

Прогнозы событий, основанные на подобранных распределениях вероятностей, подвержены неопределенности , которая возникает из-за следующих условий:

Оценку неопределенности в первом и втором случае можно получить с помощью биномиального распределения вероятностей, используя, например, вероятность превышения Pe (т. е. вероятность того, что событие X больше, чем опорное значение Xr для X ) и вероятность непревышения Pn (т. е. вероятность того, что событие X меньше или равно опорному значению Xr , это также называется кумулятивной вероятностью ). В этом случае есть только две возможности: либо есть превышение, либо есть непревышение. Эта двойственность является причиной того, что биномиальное распределение применимо.

С помощью биномиального распределения можно получить интервал прогнозирования . Такой интервал также оценивает риск неудачи, т.е. вероятность того, что предсказанное событие все еще останется за пределами доверительного интервала. Анализ достоверности или риска может включать период повторяемости T=1/Pe, как это делается в гидрологии .

Байесовский подход может быть использован для подгонки модели , имеющей априорное распределение для параметра . Когда есть выборки , которые независимо взяты из базового распределения, то можно вывести так называемое апостериорное распределение . Это апостериорное распределение может быть использовано для обновления функции массы вероятности для новой выборки с учетом наблюдений , получаем

.

Дисперсия вновь полученной функции массы вероятности также может быть определена. Дисперсия для байесовской функции массы вероятности может быть определена как

.

Это выражение для дисперсии можно существенно упростить (предполагая, что выборки взяты независимо). Определение "функции массы собственной вероятности" как

,

получаем для дисперсии [12]

.

Выражение для дисперсии включает дополнительную подгонку, включающую интересующую выборку.

Оценивая степень соответствия различных распределений, можно получить представление о том, какое распределение приемлемо, а какое нет.

Из кумулятивной функции распределения (CDF) можно вывести гистограмму и функцию плотности вероятности (PDF).