Обучение с подкреплением ( RL ) — это междисциплинарная область машинного обучения и оптимального управления , связанная с тем, как интеллектуальный агент должен действовать в динамической среде, чтобы максимизировать совокупное вознаграждение . Обучение с подкреплением — одна из трех основных парадигм машинного обучения , наряду с обучением с учителем и обучением без учителя .

Обучение с подкреплением отличается от обучения с учителем тем, что не требует представления помеченных пар входных/выходных данных и не требует явного исправления неоптимальных действий. Вместо этого основное внимание уделяется поиску баланса между исследованием (неизведанной территории) и использованием (текущих знаний) с целью максимизации долгосрочного вознаграждения, чья обратная связь может быть неполной или отложенной. [1]

Среда обычно описывается в форме марковского процесса принятия решений (MDP), поскольку многие алгоритмы обучения с подкреплением для этого контекста используют методы динамического программирования . [2] Основное различие между классическими методами динамического программирования и алгоритмами обучения с подкреплением заключается в том, что последние не предполагают знание точной математической модели марковского процесса принятия решений и нацелены на большие марковские процессы принятия решений, где точные методы становятся невозможными. [3]

Из-за своей общности обучение с подкреплением изучается во многих дисциплинах, таких как теория игр , теория управления , исследование операций , теория информации , оптимизация на основе моделирования , многоагентные системы , роевой интеллект и статистика . В литературе по исследованию операций и управлению обучение с подкреплением называется приближенным динамическим программированием или нейродинамическим программированием. Проблемы, представляющие интерес для обучения с подкреплением, также изучались в теории оптимального управления , которая занимается главным образом существованием и характеристикой оптимальных решений, а также алгоритмами их точного вычисления, и в меньшей степени обучением или аппроксимацией, особенно в отсутствие математическая модель окружающей среды.

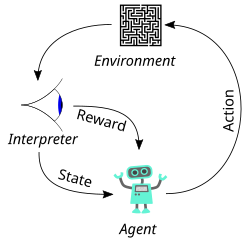

Базовое обучение с подкреплением моделируется как марковский процесс принятия решений :

Цель обучения с подкреплением состоит в том, чтобы агент выучил оптимальную или почти оптимальную политику, которая максимизирует «функцию вознаграждения» или другой сигнал подкрепления, предоставляемый пользователем, который накапливается из немедленных вознаграждений. Это похоже на процессы, которые происходят в психологии животных. Например, биологический мозг запрограммирован интерпретировать такие сигналы, как боль и голод, как отрицательное подкрепление, а удовольствие и прием пищи — как положительное подкрепление. В некоторых обстоятельствах животные могут научиться вести себя так, чтобы оптимизировать эти вознаграждения. Это говорит о том, что животные способны к обучению с подкреплением. [4] [5]

Базовый ИИ-агент обучения с подкреплением взаимодействует со своей средой дискретными шагами по времени. В каждый момент времени t агент получает текущее состояние и вознаграждение . Затем он выбирает действие из набора доступных действий, которое впоследствии отправляется в среду. Окружающая среда переходит в новое состояние и определяется вознаграждение , связанное с переходом . Целью агента обучения с подкреплением является изучение политики , которая максимизирует ожидаемое совокупное вознаграждение.

Формулировка проблемы в виде марковского процесса принятия решений предполагает, что агент непосредственно наблюдает за текущим состоянием окружающей среды; в этом случае говорят, что задача имеет полную наблюдаемость . Если агент имеет доступ только к подмножеству состояний или если наблюдаемые состояния искажаются шумом, говорят, что агент имеет частичную наблюдаемость , и формально проблема должна быть сформулирована как частично наблюдаемый марковский процесс принятия решений . В обоих случаях набор доступных агенту действий может быть ограничен. Например, состояние баланса счета может быть ограничено положительным; если текущее значение состояния равно 3 и переход между состояниями пытается уменьшить значение на 4, переход не будет разрешен.

Когда эффективность агента сравнивается с эффективностью агента, действующего оптимально, разница в производительности порождает понятие сожаления . Чтобы действовать почти оптимально, агент должен рассуждать о долгосрочных последствиях своих действий (т. е. максимизировать будущий доход), хотя связанное с этим немедленное вознаграждение может быть отрицательным.

Таким образом, обучение с подкреплением особенно хорошо подходит для решения задач, которые включают в себя компромисс между долгосрочным и краткосрочным вознаграждением. Он успешно применялся для решения различных задач, включая эксплуатацию накопителей энергии, [6] управление роботами, [7] диспетчеризацию фотоэлектрических генераторов, [8] нарды , шашки , [9] Го ( AlphaGo ) и системы автономного вождения. [10]

Два элемента делают обучение с подкреплением мощным: использование выборок для оптимизации производительности и использование аппроксимации функций для работы с большими средами. Благодаря этим двум ключевым компонентам обучение с подкреплением можно использовать в больших средах в следующих ситуациях:

Первые две из этих проблем можно считать проблемами планирования (поскольку доступна некоторая форма модели), а последнюю можно считать настоящей проблемой обучения. Однако обучение с подкреплением превращает обе проблемы планирования в проблемы машинного обучения .

Компромисс между разведкой и эксплуатацией наиболее тщательно изучался с помощью проблемы многорукого бандита и марковских процессов принятия решений с конечным пространством состояний в Бернетасе и Катехакисе (1997). [12]

Обучение с подкреплением требует умных механизмов исследования; случайный выбор действий без привязки к предполагаемому распределению вероятностей показывает плохую производительность. Случай (малых) конечных марковских процессов принятия решений относительно хорошо изучен. Однако из-за отсутствия алгоритмов, которые хорошо масштабируются в зависимости от количества состояний (или масштабируются для задач с бесконечными пространствами состояний), наиболее практичными являются простые методы исследования.

Одним из таких методов является -greedy, где это параметр, контролирующий объем исследования и эксплуатации. С вероятностью выбирается эксплуатация, и агент выбирает действие, которое, по его мнению, имеет наилучший долгосрочный эффект (связь между действиями разрывается равномерно и случайным образом). Альтернативно, с вероятностью выбирается исследование, а действие выбирается равномерно случайным образом. обычно является фиксированным параметром, но его можно корректировать либо по расписанию (заставляя агента все меньше исследовать), либо адаптивно на основе эвристики. [13]

Даже если вопрос исследования игнорируется и даже если состояние было наблюдаемым (предполагается ниже), остается проблема использования прошлого опыта, чтобы выяснить, какие действия приводят к более высоким совокупным вознаграждениям.

Выбор действий агента моделируется в виде карты, называемой политикой :

Карта политики дает вероятность принятия мер в состоянии . [14] : 61 Существуют также детерминистские политики.

Функция стоимости состояния определяется как ожидаемая дисконтированная доходность , начиная с состояния , т. е . и последовательно следуя политике . Следовательно, грубо говоря, функция ценности оценивает, «насколько хорошо» находиться в данном состоянии. [14] : 60

где случайная величина обозначает дисконтированный доход и определяется как сумма будущих дисконтированных вознаграждений:

где – вознаграждение за переход из состояния в , – ставка дисконтирования . меньше 1, поэтому вознаграждения в отдаленном будущем имеют меньший вес, чем вознаграждения в ближайшем будущем.

Алгоритм должен найти политику с максимальной ожидаемой дисконтированной доходностью. Из теории марковских процессов принятия решений известно, что без ограничения общности поиск можно ограничить множеством так называемых стационарных политик. Политика является стационарной , если возвращаемое ею распределение действий зависит только от последнего посещенного состояния (из истории агента наблюдения). Поиск может быть дополнительно ограничен детерминистской стационарной политикой. Детерминированная стационарная политика детерминированно выбирает действия на основе текущего состояния. Поскольку любую такую политику можно идентифицировать с помощью отображения набора состояний на набор действий, эти политики можно идентифицировать с помощью таких отображений без потери общности.

Метод грубой силы включает в себя два этапа:

Одна из проблем заключается в том, что количество политик может быть большим или даже бесконечным. Другая причина заключается в том, что дисперсия доходности может быть большой, что требует большого количества выборок для точной оценки дисконтированной доходности каждого полиса.

Эти проблемы можно решить, если мы предположим некоторую структуру и позволим выборкам, полученным на основе одной политики, влиять на оценки, сделанные для других. Двумя основными подходами для достижения этой цели являются оценка функции стоимости и прямой поиск политики.

Подходы с использованием функции стоимости пытаются найти политику, которая максимизирует дисконтированную доходность, поддерживая набор оценок ожидаемой дисконтированной доходности для некоторой политики (обычно либо «текущей» [в соответствии с политикой], либо оптимальной [вне политики]).

Эти методы основаны на теории марковских процессов принятия решений, где оптимальность определяется в более строгом смысле, чем приведенный выше: политика оптимальна, если она обеспечивает наилучший ожидаемый дисконтированный доход от любого начального состояния (т. е. начальные распределения не играют никакой роли в это определение). Опять же, оптимальную политику всегда можно найти среди стационарных политик.

Чтобы формально определить оптимальность, определите государственную ценность политики с помощью

где обозначает дисконтированную доходность, связанную с следованием из исходного состояния . Определяя как максимально возможное значение состояния , где разрешено изменяться,

Политика, которая достигает этих оптимальных значений состояния в каждом штате, называется оптимальной . Очевидно, что политика, оптимальная в этом строгом смысле, также оптимальна в том смысле, что она максимизирует ожидаемый дисконтированный доход , поскольку , где – состояние, случайно выбранное из распределения начальных состояний (так что ).

Хотя значений состояния достаточно для определения оптимальности, полезно определить значения действия. Учитывая состояние , действие и политику , значение действия пары ниже определяется формулой

где теперь обозначает случайный дисконтированный доход, связанный с первым действием в состоянии и последующими действиями .

Теория марковских процессов принятия решений утверждает, что если это оптимальная политика, мы действуем оптимально (принимаем оптимальное действие), выбирая действие с наибольшим значением действия в каждом состоянии . Функция значения действия такой оптимальной политики ( ) называется оптимальной функцией значения действия и обычно обозначается . Таким образом, одного только знания оптимальной функции «действие-ценность» достаточно, чтобы знать, как действовать оптимально.

Предполагая полное знание марковского процесса принятия решений, можно выделить два основных подхода к вычислению оптимальной функции «действие-ценность»: итерация значения и итерация политики . Оба алгоритма вычисляют последовательность функций ( ), сходящихся к . Вычисление этих функций включает в себя вычисление ожиданий по всему пространству состояний, что непрактично для всех, кроме самых маленьких (конечных) марковских процессов принятия решений. В методах обучения с подкреплением ожидания аппроксимируются путем усреднения по выборкам и использования методов аппроксимации функций, чтобы справиться с необходимостью представления функций значения в больших пространствах состояний и действий.

Методы Монте-Карло можно использовать в алгоритме, имитирующем итерацию политики. Итерация политики состоит из двух этапов: оценка политики и улучшение политики .

Монте-Карло используется на этапе оценки политики. На этом этапе, учитывая стационарную, детерминированную политику , цель состоит в том, чтобы вычислить значения функции (или хорошее приближение к ним) для всех пар состояние-действие . Предположим (для простоты), что процесс решения Маркова конечен, что доступно достаточно памяти для размещения значений действия, и что проблема носит эпизодический характер, и после каждого эпизода новый начинается с некоторого случайного начального состояния. Затем оценку значения данной пары состояние-действие можно вычислить путем усреднения выборочных доходов, полученных за определенный период времени. Таким образом, при наличии достаточного времени эта процедура может построить точную оценку функции действие-ценность . На этом заканчивается описание этапа оценки политики.

На этапе улучшения политики следующая политика получается путем вычисления жадной политики относительно : Учитывая состояние , эта новая политика возвращает действие, которое максимизирует . На практике ленивая оценка может отложить вычисление максимизирующих действий до того момента, когда они потребуются.

Проблемы с этой процедурой включают в себя:

Первая проблема решается путем разрешения процедуре изменять политику (в некоторых или всех состояниях) до того, как значения установятся. Это также может быть проблематичным, поскольку может помешать конвергенции. Большинство современных алгоритмов делают это, создавая класс алгоритмов итерации обобщенной политики . Многие актерско-критические методы относятся к этой категории.

Вторую проблему можно исправить, разрешив траекториям вносить вклад в любую пару состояние-действие в них. Это также может в некоторой степени помочь в решении третьей проблемы, хотя лучшим решением, когда доходность имеет высокую дисперсию, является метод временной разницы (TD) Саттона, основанный на рекурсивном уравнении Беллмана . [15] [16] Вычисления в методах TD могут быть инкрементальными (когда после каждого перехода память меняется и переход выбрасывается) или пакетными (когда переходы группируются и оценки вычисляются один раз на основе пакета) . Пакетные методы, такие как метод временной разницы наименьших квадратов [17] , могут лучше использовать информацию в выборках, в то время как инкрементные методы являются единственным выбором, когда пакетные методы неосуществимы из-за их высокой вычислительной сложности или сложности памяти. Некоторые методы пытаются объединить два подхода. Методы, основанные на временных различиях, также решают четвертую проблему.

Другая проблема, характерная для TD, связана с тем, что они полагаются на рекурсивное уравнение Беллмана. Большинство методов TD имеют так называемый параметр , который может непрерывно интерполировать между методами Монте-Карло, не основанными на уравнениях Беллмана, и базовыми методами TD, которые полностью полагаются на уравнения Беллмана. Это может быть эффективным решением этой проблемы.

Для решения пятой задачи используются методы аппроксимации функций . Аппроксимация линейной функции начинается с отображения , которое присваивает конечномерный вектор каждой паре состояние-действие. Затем значения действия пары состояние-действие получаются путем линейного объединения компонентов с некоторыми весами :

Затем алгоритмы корректируют веса вместо корректировки значений, связанных с отдельными парами состояние-действие. Были изучены методы, основанные на идеях непараметрической статистики (которые, как видно, создают свои собственные функции).

Итерацию значений также можно использовать в качестве отправной точки, что дает начало алгоритму Q-обучения и его многочисленным вариантам. [18] Включая методы глубокого Q-обучения, когда для представления Q используется нейронная сеть, с различными приложениями в задачах стохастического поиска. [19]

Проблема с использованием значений действий заключается в том, что им могут потребоваться очень точные оценки конкурирующих значений действий, которые может быть трудно получить, когда результаты зашумлены, хотя эта проблема в некоторой степени смягчается методами временной разницы. Использование так называемого метода аппроксимации совместимых функций снижает общность и эффективность.

Альтернативным методом является поиск непосредственно в (некотором подмножестве) политического пространства, и в этом случае проблема становится случаем стохастической оптимизации . Доступны два подхода: градиентный и безградиентный.

Градиентные методы ( методы градиента политики ) начинаются с отображения конечномерного пространства (параметров) в пространство политик: учитывая вектор параметров , пусть обозначает политику, связанную с . Определив функцию производительности, в мягких условиях эта функция будет дифференцируемой как функция вектора параметров . Если бы градиент был известен, можно было бы использовать градиентное восхождение . Поскольку аналитическое выражение для градиента недоступно, доступна только зашумленная оценка. Такая оценка может быть построена разными способами, что приводит к появлению таких алгоритмов, как метод REINFORCE Уильямса [20] (который в литературе по оптимизации на основе моделирования известен как метод отношения правдоподобия ). [21]

Большой класс методов избегает использования информации о градиенте. К ним относятся моделирование отжига , перекрестный энтропийный поиск или методы эволюционных вычислений . Многие безградиентные методы могут достичь (теоретически и в пределе) глобального оптимума.

Методы поиска политики могут медленно сходиться при наличии зашумленных данных. Например, это происходит в эпизодических задачах, когда траектории длинные и дисперсия доходностей велика. В этом случае могут помочь методы, основанные на функции стоимости, основанные на временных различиях. В последние годы методы актер-критик были предложены и хорошо зарекомендовали себя при решении различных проблем. [22]

Методы поиска политики использовались в контексте робототехники . [23] Многие методы поиска политик могут застрять в локальных оптимах (поскольку они основаны на локальном поиске ).

Наконец, все вышеперечисленные методы можно объединить с алгоритмами, которые сначала изучают модель марковского процесса принятия решений , вероятность каждого следующего состояния с учетом действия, предпринятого из существующего состояния. Например, алгоритм Dyna [24] изучает модель на основе опыта и использует его для обеспечения более смоделированных переходов для функции значения в дополнение к реальным переходам. Такие методы иногда можно расширить за счет использования непараметрических моделей, например, когда переходы просто сохраняются и «воспроизводятся» [25] в алгоритме обучения.

Методы, основанные на моделях, могут быть более интенсивными в вычислительном отношении, чем подходы без моделей, и их полезность может быть ограничена степенью, в которой можно изучить марковский процесс принятия решений. [26]

Существуют и другие способы использования моделей, кроме обновления функции значения. [27] Например, в прогнозирующем управлении моделью модель используется для непосредственного обновления поведения.

Как асимптотическое, так и конечно-выборочное поведение большинства алгоритмов хорошо изучено. Алгоритмы с доказуемо хорошей онлайновой производительностью (решающие проблему разведки) известны.

Эффективное исследование марковских процессов принятия решений дано в Burnetas and Katehakis (1997). [12] Для многих алгоритмов также появились границы производительности за конечное время, но ожидается, что эти границы будут довольно расплывчатыми, и поэтому требуется дополнительная работа, чтобы лучше понять относительные преимущества и ограничения.

Для инкрементных алгоритмов проблемы асимптотической сходимости решены [ необходимы пояснения ] . Алгоритмы, основанные на временной разности, сходятся при более широком наборе условий, чем это было возможно ранее (например, при использовании произвольной плавной аппроксимации функции).

Темы исследований включают в себя:

Задачи ассоциативного обучения с подкреплением сочетают в себе аспекты задач автоматов стохастического обучения и задач классификации моделей обучения с учителем. В задачах ассоциативного обучения с подкреплением система обучения взаимодействует со своей средой в замкнутом цикле. [44]

Этот подход расширяет обучение с подкреплением за счет использования глубокой нейронной сети без явного проектирования пространства состояний. [45] Работа Google DeepMind над изучением игр ATARI повысила внимание к глубокому обучению с подкреплением или сквозному обучению с подкреплением . [46]

Состязательное глубокое обучение с подкреплением — это активная область исследований в области обучения с подкреплением, в которой основное внимание уделяется уязвимостям изученных политик. Некоторые исследования в этой области исследований изначально показали, что политика обучения с подкреплением подвержена незаметным состязательным манипуляциям. [47] [48] [49] Хотя были предложены некоторые методы для преодоления этой уязвимости, в самых последних исследованиях было показано, что эти предлагаемые решения далеки от обеспечения точного представления текущих уязвимостей политики глубокого обучения с подкреплением. [50]

Путем введения нечеткого вывода в обучение с подкреплением [51] становится возможным аппроксимировать функцию ценности состояния-действия нечеткими правилами в непрерывном пространстве. Форма нечетких правил ЕСЛИ-ТО делает этот подход пригодным для выражения результатов в форме, близкой к естественному языку. Расширение FRL с помощью интерполяции нечетких правил [52] позволяет использовать разреженные нечеткие базы правил уменьшенного размера, чтобы подчеркнуть кардинальные правила (наиболее важные значения действий состояния).

В обратном обучении с подкреплением (IRL) функция вознаграждения не задается. Вместо этого функция вознаграждения выводится с учетом наблюдаемого поведения эксперта. Идея состоит в том, чтобы имитировать наблюдаемое поведение, которое часто является оптимальным или близким к оптимальному. [53]

Безопасное обучение с подкреплением (SRL) можно определить как процесс политики обучения, которая максимизирует ожидание отдачи в проблемах, в которых важно обеспечить разумную производительность системы и/или соблюдать ограничения безопасности во время процессов обучения и/или развертывания. [54]

{{cite book}}: CS1 maint: location missing publisher (link){{cite book}}: CS1 maint: location missing publisher (link){{cite book}}: CS1 maint: multiple names: authors list (link)