Пиковые нейронные сети ( SNN ) — это искусственные нейронные сети (ИНС), которые более точно имитируют естественные нейронные сети. [1] Помимо состояния нейронов и синапсов , SNN включают в свою операционную модель концепцию времени. Идея состоит в том, что нейроны в SNN не передают информацию в каждом цикле распространения (как это происходит с типичными многослойными перцептронными сетями ), а передают информацию только тогда, когда мембранный потенциал — внутреннее качество нейрона, связанное с его мембранным электрическим потенциалом . заряд — достигает определенного значения, называемого порогом. Когда мембранный потенциал достигает порога, нейрон срабатывает и генерирует сигнал, который передается другим нейронам, которые, в свою очередь, увеличивают или уменьшают свои потенциалы в ответ на этот сигнал. Модель нейрона, которая срабатывает в момент пересечения порога, также называется моделью импульсного нейрона . [2]

Хотя ранее считалось, что мозг кодирует информацию с помощью частоты импульсов, которую можно рассматривать как аналоговую переменную выходную мощность традиционной ИНС, [3] исследования в области нейробиологии показали, что высокоскоростная обработка не может выполняться исключительно с помощью скорости основанная схема. Например, люди могут выполнять задачу распознавания изображений со скоростью, требующей не более 10 мс времени обработки на нейрон через последовательные слои (от сетчатки до височной доли). Это временное окно слишком короткое для кодирования на основе скорости. Точное время импульсов в небольшом наборе импульсных нейронов также имеет более высокую способность кодирования информации по сравнению с подходом, основанным на частоте. [4]

Наиболее известной моделью импульсных нейронов является модель «протекающей интеграции и запуска» . [5] В модели «интегрировать и запустить» мгновенный уровень активации (смоделированный как дифференциальное уравнение ) обычно считается состоянием нейрона, при этом входящие спайки повышают или понижают это значение до тех пор, пока состояние в конечном итоге либо не затухнет, либо… если порог срабатывания достигнут — нейрон срабатывает. После срабатывания переменная состояния сбрасывается до более низкого значения.

Существуют различные методы декодирования для интерпретации исходящей последовательности спайков как числа реального значения, основанного либо на частоте спайков ( код скорости ), времени до первого импульса после стимуляции, либо на интервале между спайками.

Многие многослойные искусственные нейронные сети полностью связаны между собой : они получают входные данные от каждого нейрона предыдущего слоя и передают сигналы каждому нейрону последующего слоя. Хотя эти сети совершили прорыв во многих областях, они биологически неточны и не имитируют механизм работы нейронов в мозгу живого существа. [6]

Биологическая модель спайкового нейрона Ходжкина-Хаксли была предложена в 1952 году. Эта модель описывает, как инициируются и распространяются потенциалы действия . Связь между нейронами, которая требует обмена химическими нейромедиаторами в синаптической щели, описывается в различных моделях, таких как модель интеграции и огня , модель ФитцХью-Нагумо (1961–1962) и модель Хиндмарша-Роуза (1984). . Обычно используется дырявая модель «интеграция и запуск» (или ее производная), поскольку ее легче вычислить, чем модель Ходжкина – Хаксли. [7]

Информация в мозге представлена в виде потенциалов действия (нейронных спайков), которые могут быть сгруппированы в серии спайков или даже в скоординированные волны мозговой активности. Фундаментальный вопрос нейробиологии состоит в том, чтобы определить, общаются ли нейроны по скорости или по временному коду . [8] Временное кодирование предполагает, что один импульсный нейрон может заменить сотни скрытых единиц в сигмоидальной нейронной сети . [1]

SNN выполняет вычисления в непрерывной, а не в дискретной области. Идея состоит в том, что нейроны не могут тестировать активацию на каждой итерации распространения (как в случае с типичной многослойной перцептронной сетью), а только тогда, когда их мембранные потенциалы достигают определенного значения. Когда нейрон активируется, он вырабатывает сигнал, который передается подключенным нейронам, повышая или понижая их мембранный потенциал.

В импульсной нейронной сети текущее состояние нейрона определяется как его мембранный потенциал (возможно, моделируемый как дифференциальное уравнение). Входной импульс вызывает повышение мембранного потенциала на некоторое время, а затем постепенное снижение. Были построены схемы кодирования для интерпретации этих последовательностей импульсов как числа с учетом как частоты импульсов, так и интервала между импульсами. Можно создать модель нейронной сети, основанную на времени генерации импульса. Используя точное время появления импульса, нейронная сеть может использовать больше информации и предлагать лучшие вычислительные свойства.

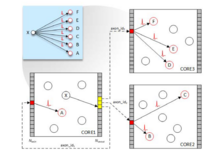

Подход SNN обеспечивает непрерывный вывод вместо двоичного вывода традиционных искусственных нейронных сетей (ИНС). Последовательности импульсов нелегко интерпретировать, поэтому необходимы схемы кодирования, описанные выше. Однако представление последовательности импульсов может больше подходить для обработки пространственно-временных данных (или непрерывной классификации сенсорных данных реального мира). [9] SNN учитывают пространство, соединяя нейроны только с соседними нейронами, чтобы они обрабатывали входные блоки отдельно (аналогично CNN с использованием фильтров). Они учитывают время, кодируя информацию в виде последовательности импульсов, чтобы не потерять информацию в двоичном кодировании. Это позволяет избежать дополнительной сложности рекуррентной нейронной сети (RNN). Оказывается, импульсные нейроны — более мощные вычислительные единицы, чем традиционные искусственные нейроны. [10]

SNN теоретически более мощны, чем так называемые «сети второго поколения», определенные в [10] как «[ANN] на основе вычислительных блоков, которые применяют функцию активации с непрерывным набором возможных выходных значений к взвешенной сумме (или полиному) входные данные; однако проблемы обучения SNN и требования к оборудованию ограничивают их использование. Хотя доступны неконтролируемые биологические методы обучения, такие как обучение Хеббиана и STDP , ни один эффективный контролируемый метод обучения не подходит для SNN, которые могут обеспечить лучшую производительность, чем сети второго поколения. 10] Активация SNN на основе всплеска не является дифференцируемой, что затрудняет разработку методов обучения на основе градиентного спуска для выполнения обратного распространения ошибки .

SNN требуют гораздо больших вычислительных затрат для моделирования реалистичных нейронных моделей, чем традиционные ANN. [11]

Нейронные сети с импульсной связью (PCNN) часто путают с SNN. PCNN можно рассматривать как разновидность SNN.

В настоящее время существует несколько проблем при использовании SNN, над которыми активно работают исследователи. Первая проблема касается недифференцируемости резкой нелинейности. Выражения для методов прямого и обратного обучения содержат производную функции активации нейрона, которая не является дифференцируемой, поскольку выходной сигнал нейрона равен либо 1, когда он всплеск, и 0 в противном случае. Такое поведение двоичной пиковой нелинейности по принципу «все или ничего» останавливает «течение» градиентов и делает LIF-нейроны непригодными для оптимизации на основе градиента. Вторая проблема касается реализации самого алгоритма оптимизации. Стандартный BP может быть дорогостоящим с точки зрения вычислений, памяти и связи и может плохо подходить для ограничений, налагаемых аппаратным обеспечением, которое его реализует (например, компьютером, мозгом или нейроморфным устройством). [12] Что касается первой проблемы, существует несколько подходов к ее преодолению. Некоторые из них:

В разработке SNN включение в модели нейронов дополнительной динамики нейронов, такой как адаптация пиковой частоты (SFA), является заметным достижением, повышающим как эффективность, так и вычислительную мощность. [5] [13] Эти нейроны находятся между биологической сложностью и вычислительной сложностью. [14] Основанный на биологических знаниях, SFA предлагает значительные вычислительные преимущества за счет снижения энергопотребления за счет эффективного кодирования, [15], особенно в случаях повторяющихся или интенсивных стимулов. Эта адаптация улучшает четкость сигнала на фоне фонового шума и вводит элементарную кратковременную память на уровне нейронов, что, в свою очередь, повышает точность и эффективность обработки информации. [16] В последнее время это явление достигается в основном с использованием моделей компартментальных нейронов. Более простые версии представляют собой модели нейронов с адаптивными порогами, косвенным способом достижения SFA, наделяют SNN улучшенными возможностями обучения, даже с ограниченной синаптической пластичностью, и повышают эффективность вычислений. [17] [18] Эта функция снижает требования к сетевым уровням за счет уменьшения необходимости обработки всплесков, тем самым сокращая вычислительную нагрузку и время доступа к памяти — важные аспекты нейронных вычислений. Более того, SNN, использующие нейроны, способные к SFA, достигают уровня точности, который конкурирует с точностью обычных искусственных нейронных сетей, в том числе основанных на моделях долговременной краткосрочной памяти, [19] [20] , а также требует меньшего количества нейронов для сопоставимых вычислительных задач. Такая эффективность не только оптимизирует вычислительный рабочий процесс, но также экономит пространство и энергию, предлагая прагматичный шаг вперед в практическом применении SNN для сложных вычислительных задач, сохраняя при этом приверженность технической целостности.

SNN в принципе могут применяться к тем же приложениям, что и традиционные ANN. [21] Кроме того, SNN могут моделировать центральную нервную систему биологических организмов, таких как насекомое, ищущее пищу без предварительного знания окружающей среды. [22] Благодаря относительной реалистичности их можно использовать для изучения работы биологических нейронных цепей . Начав с гипотезы о топологии биологической нейронной цепи и ее функции, записи этой цепи можно сравнить с выходными данными соответствующей SNN, оценивая правдоподобность гипотезы. Однако для SNN отсутствуют эффективные механизмы обучения, что может быть тормозом для некоторых приложений, включая задачи компьютерного зрения.

По состоянию на 2019 год SNN отстают от ИНС по точности, но разрыв сокращается, а в некоторых задачах исчез. [23]

При использовании SNN для данных на основе изображений нам необходимо преобразовать статические изображения в кодирование двоичных последовательностей импульсов. [24] Типы кодировок: [25]

Разнообразное прикладное программное обеспечение может моделировать SNN. Это программное обеспечение можно классифицировать в зависимости от его использования:

Они моделируют сложные нейронные модели с высоким уровнем детализации и точности. Большие сети обычно требуют длительной обработки. Среди кандидатов: [26]

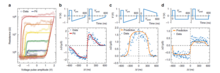

Будущие нейроморфные архитектуры [29] будут включать миллиарды таких наносинапсов, что требует четкого понимания физических механизмов, ответственных за пластичность. Экспериментальные системы на основе сегнетоэлектрических туннельных переходов были использованы, чтобы показать, что STDP можно использовать за счет гетерогенного переключения поляризации. С помощью комбинированной визуализации сканирующих зондов, электрического транспорта и молекулярной динамики атомного масштаба изменения проводимости можно моделировать путем изменения направления доменов с преобладанием нуклеации. Моделирование показывает, что массивы сегнетоэлектрических наносинапсов могут автономно учиться распознавать закономерности предсказуемым образом, открывая путь к обучению без присмотра . [30]

Возможности классификации пиковых сетей, обученных в соответствии с методами обучения без учителя [35], были протестированы на общих эталонных наборах данных, таких как набор данных Iris, Wisconsin Breast Cancer или Statlog Landsat. [36] [37] Использовались различные подходы к кодированию информации и проектированию сети. Например, двухуровневая сеть прямого распространения для кластеризации и классификации данных. На основе идеи, предложенной Хопфилдом (1995), авторы реализовали модели локальных рецептивных полей, сочетающие свойства радиальных базисных функций (RBF) и импульсных нейронов для преобразования входных сигналов (классифицированных данных), имеющих представление с плавающей запятой, в представление импульсов. [38] [39]

{{cite book}}: |journal=игнорируется ( помощь )