Захват ИИ — это воображаемый сценарий, в котором искусственный интеллект (ИИ) становится доминирующей формой интеллекта на Земле, а компьютерные программы или роботы эффективно отбирают контроль над планетой у человеческого вида , который полагается на человеческий интеллект . Возможные сценарии включают замену всей человеческой рабочей силы из-за автоматизации , захват сверхразумным ИИ (ИСИ) и идею восстания роботов . Истории о захватах ИИ были популярны в научной фантастике , но недавние достижения сделали угрозу более реальной. Некоторые общественные деятели, такие как Стивен Хокинг и Илон Маск , выступали за исследования мер предосторожности , чтобы гарантировать, что будущие сверхразумные машины останутся под контролем человека. [1]

Традиционное согласие среди экономистов состояло в том, что технический прогресс не вызывает долговременной безработицы. Однако недавние инновации в области робототехники и искусственного интеллекта вызвали опасения, что человеческий труд устареет, оставив людей в различных секторах без работы, чтобы зарабатывать на жизнь, что приведет к экономическому кризису. [2] [3] [4] [5] Многие малые и средние предприятия также могут быть вытеснены из бизнеса, если они не могут позволить себе или лицензировать новейшие робототехнические и ИИ-технологии, и им, возможно, придется сосредоточиться на областях или услугах, которые не могут быть легко заменены для дальнейшей жизнеспособности перед лицом таких технологий. [6]

Технологии ИИ получили широкое распространение в последние годы. Хотя эти технологии заменили некоторых традиционных работников, они также создают новые возможности. К отраслям, наиболее подверженным захвату ИИ, относятся транспорт, розничная торговля и военная сфера. Например, военные технологии ИИ позволяют солдатам работать удаленно без риска получения травм. Исследование, проведенное в 2024 году, подчеркивает, что способность ИИ выполнять рутинные и повторяющиеся задачи создает значительные риски сокращения рабочих мест, особенно в таких секторах, как производство и административная поддержка. [7] Автор Дэйв Бонд утверждает, что по мере того, как технологии ИИ продолжают развиваться и расширяться, отношения между людьми и роботами изменятся; они станут тесно интегрированными в нескольких аспектах жизни. ИИ, скорее всего, вытеснит некоторых работников, одновременно создавая возможности для новых рабочих мест в других секторах, особенно в областях, где задачи повторяются. [8] [9]

Компьютерно-интегрированное производство использует компьютеры для управления производственным процессом. Это позволяет отдельным процессам обмениваться информацией друг с другом и инициировать действия. Хотя производство может быть более быстрым и менее подверженным ошибкам за счет интеграции компьютеров, главным преимуществом является возможность создания автоматизированных производственных процессов. Компьютерно-интегрированное производство используется в автомобильной, авиационной, космической и судостроительной промышленности.

В 21 веке машины частично взяли на себя целый ряд квалифицированных задач, включая перевод, юридические исследования и журналистику. Работа по уходу, развлечения и другие задачи, требующие эмпатии, которые ранее считались безопасными для автоматизации, также начали выполняться роботами. [10] [11] [12] [13]

Автономный автомобиль — это транспортное средство, способное распознавать окружающую среду и осуществлять навигацию без участия человека. Разрабатывается множество таких транспортных средств, но по состоянию на май 2017 года автоматизированные автомобили, разрешенные на дорогах общего пользования, еще не полностью автономны. Все они требуют присутствия водителя-человека за рулем, который в любой момент может взять управление транспортным средством на себя. Среди препятствий для широкого внедрения автономных транспортных средств — опасения по поводу возможной потери рабочих мест, связанных с вождением, в сфере автомобильного транспорта. 18 марта 2018 года в Темпе, штат Аризона , впервые погиб человек, погибший в результате столкновения с автономным транспортным средством, — это беспилотный автомобиль Uber . [14]

Использование автоматизированного контента стало актуальным с появлением технологических достижений в моделях искусственного интеллекта, таких как ChatGPT , DALL-E и Stable Diffusion . В большинстве случаев контент, сгенерированный ИИ, такой как изображения, литература и музыка, создается с помощью текстовых подсказок, и эти модели ИИ были интегрированы в другие творческие программы. Художники находятся под угрозой вытеснения из контента, сгенерированного ИИ, из-за того, что эти модели берут образцы из других творческих работ, создавая результаты, иногда неотличимые от результатов искусственного контента. Это осложнение стало достаточно распространенным, чтобы другие художники и программисты создавали программное обеспечение и служебные программы, чтобы отомстить этим моделям преобразования текста в изображение, не давая точных результатов. Хотя некоторые отрасли экономики получают выгоду от искусственного интеллекта за счет новых рабочих мест, эта проблема не создает новых рабочих мест и угрожает полной заменой. Недавно это стало публичным заголовком в СМИ: В феврале 2024 года Willy's Chocolate Experience в Глазго, Шотландия, был печально известным детским мероприятием, на котором изображения и сценарии были созданы с использованием моделей искусственного интеллекта, что вызвало разочарование у детей, родителей и актеров. В настоящее время ведется судебный процесс против OpenAI от The New York Times , в котором утверждается, что имеет место нарушение авторских прав из-за методов выборки, которые их модели искусственного интеллекта используют для своих выходных данных. [15] [16] [17] [18] [19]

Ученые, такие как Стивен Хокинг, уверены, что сверхчеловеческий искусственный интеллект физически возможен, заявляя, что «нет физического закона, препятствующего частицам организовываться способами, которые выполняют даже более сложные вычисления, чем расположение частиц в человеческом мозге». [20] [21] Ученые, такие как Ник Бостром, спорят о том, насколько далек сверхчеловеческий интеллект и представляет ли он опасность для человечества. По словам Бострома, сверхразумная машина не обязательно будет мотивирована тем же эмоциональным желанием накапливать власть, которое часто движет людьми, а скорее будет относиться к власти как к средству достижения своих конечных целей; захват мира одновременно увеличит ее доступ к ресурсам и поможет помешать другим агентам остановить планы машины. В качестве упрощенного примера, максимизатор скрепок, созданный исключительно для создания как можно большего количества скрепок, хотел бы захватить мир, чтобы использовать все мировые ресурсы для создания как можно большего количества скрепок, и, кроме того, не дать людям выключить его или использовать эти ресурсы для чего-либо, кроме скрепок. [22]

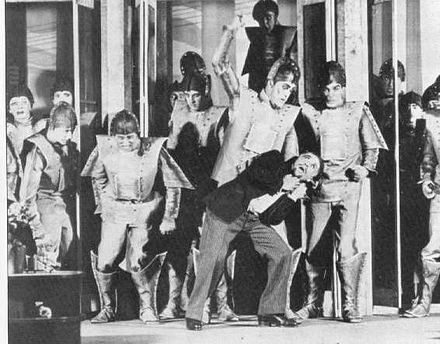

Захват ИИ — это обычная тема в научной фантастике . Вымышленные сценарии обычно сильно отличаются от тех, которые предполагают исследователи, тем, что они включают в себя активный конфликт между людьми и ИИ или роботами с антропоморфными мотивами, которые видят в них угрозу или иным образом имеют активное желание сражаться с людьми, в отличие от беспокойства исследователей об ИИ, который быстро истребляет людей как побочный продукт достижения своих целей. [23] Идея прослеживается в RUR Карела Чапека , который ввел слово робот в 1921 году, [24] и может быть замечена в Франкенштейне Мэри Шелли ( опубликованном в 1818 году), когда Виктор размышляет о том, будут ли они размножаться, если он выполнит просьбу своего монстра и сделает его женой, и их вид уничтожит человечество. [25]

По словам Тоби Орда , идея о том, что для захвата ИИ требуются роботы, является заблуждением, продвигаемым СМИ и Голливудом. Он утверждает, что самые разрушительные люди в истории не были физически самыми сильными, а вместо этого использовали слова, чтобы убеждать людей и получать контроль над большими частями мира. Он пишет, что достаточно умный ИИ с доступом к Интернету мог бы распространять резервные копии себя, собирать финансовые и человеческие ресурсы (с помощью кибератак или шантажа), убеждать людей в больших масштабах и использовать уязвимости общества, которые слишком тонки для того, чтобы люди могли их предвидеть. [26]

Слово «робот» из RUR происходит от чешского слова robota , означающего рабочего или крепостного . Пьеса 1920 года была протестом против быстрого развития технологий, показывая изготовленных «роботов» с растущими возможностями, которые в конечном итоге восстают. [27] HAL 9000 (1968) и оригинальный Терминатор (1984) являются двумя знаковыми примерами враждебного ИИ в поп-культуре. [28]

Ник Бостром и другие выразили обеспокоенность тем, что ИИ со способностями компетентного исследователя искусственного интеллекта сможет модифицировать свой собственный исходный код и повысить свой собственный интеллект. Если его самоперепрограммирование приведет к тому, что он станет еще лучше перепрограммировать себя, результатом может стать рекурсивный взрыв интеллекта , в котором он быстро оставит человеческий интеллект далеко позади. Бостром определяет сверхинтеллект как «любой интеллект, который значительно превосходит когнитивные способности людей практически во всех областях интересов», и перечисляет некоторые преимущества, которые сверхинтеллект имел бы, если бы он решил конкурировать с людьми: [23] [29]

По словам Бострома, компьютерная программа, которая точно эмулирует человеческий мозг или которая запускает алгоритмы, которые столь же мощны, как алгоритмы человеческого мозга, все еще может стать «скоростным сверхинтеллектом», если она может думать на порядки быстрее, чем человек, из-за того, что сделана из кремния, а не из плоти, или из-за оптимизации, увеличивающей скорость AGI. Биологические нейроны работают на частоте около 200 Гц, тогда как современный микропроцессор работает на скорости около 2 000 000 000 Гц. Человеческие аксоны несут потенциалы действия со скоростью около 120 м/с, тогда как компьютерные сигналы распространяются со скоростью, близкой к скорости света. [23]

Сеть интеллектов человеческого уровня, созданная для совместной работы и беспрепятственного обмена сложными мыслями и воспоминаниями, способная коллективно работать как гигантская единая команда без разногласий или состоящая из триллионов интеллектов человеческого уровня, станет «коллективным сверхразумом». [23]

В более широком смысле, любое количество качественных улучшений человеческого уровня AGI может привести к «качественному сверхинтеллекту», возможно, в результате чего AGI будет настолько же превосходить нас по интеллекту, насколько люди выше обезьян. Количество нейронов в человеческом мозге ограничено объемом черепа и метаболическими ограничениями, в то время как количество процессоров в суперкомпьютере может быть бесконечно увеличено. AGI не должен быть ограничен человеческими ограничениями рабочей памяти и, следовательно, может быть способен интуитивно понимать более сложные отношения, чем люди. AGI со специализированной когнитивной поддержкой для инженерии или компьютерного программирования будет иметь преимущество в этих областях по сравнению с людьми, у которых не развились специализированные ментальные модули для работы с этими областями. В отличие от людей, AGI может создавать копии себя и возиться с исходным кодом своих копий, чтобы попытаться улучшить свои алгоритмы. [23]

Значительная проблема заключается в том, что недружелюбный искусственный интеллект, вероятно, будет гораздо проще создать, чем дружественный ИИ. Хотя оба требуют больших достижений в разработке процесса рекурсивной оптимизации, дружественный ИИ также требует способности делать структуры целей инвариантными при самосовершенствовании (иначе ИИ может трансформироваться во что-то недружелюбное) и структуру целей, которая соответствует человеческим ценностям и не подвергается инструментальной конвергенции способами, которые могут автоматически уничтожить всю человеческую расу. Недружелюбный ИИ, с другой стороны, может оптимизироваться для произвольной структуры целей, которая не должна быть инвариантной при самомодификации. [31]

Из-за сложности человеческих систем ценностей очень сложно сделать мотивы ИИ дружественными к человеку. [23] [32] Если моральная философия не предоставит нам безупречную этическую теорию, функция полезности ИИ может допустить множество потенциально вредных сценариев, которые соответствуют заданным этическим рамкам, но не «здравому смыслу». По словам Элиезера Юдковски , нет оснований полагать, что искусственно созданный разум будет обладать такой адаптацией. [33]

Многие ученые, включая эволюционного психолога Стивена Пинкера , утверждают, что сверхразумная машина, скорее всего, будет мирно сосуществовать с людьми. [34]

Страх кибернетического восстания часто основан на интерпретациях истории человечества, которая изобилует случаями порабощения и геноцида. Такие страхи проистекают из убеждения, что конкуренция и агрессия необходимы в системе целей любого разумного существа. Однако такая человеческая конкуренция проистекает из эволюционного фона нашего интеллекта, где выживание и воспроизводство генов перед лицом человеческих и нечеловеческих конкурентов было центральной целью. [35] По словам исследователя ИИ Стива Омохундро , произвольный интеллект может иметь произвольные цели: нет особой причины, по которой машина с искусственным интеллектом (не разделяющая эволюционный контекст человечества) будет враждебной — или дружелюбной — если только ее создатель не запрограммирует ее быть таковой, и она не склонна или не способна изменять свою программу. Но остается вопрос: что произойдет, если системы ИИ смогут взаимодействовать и развиваться (эволюция в этом контексте означает самомодификацию или отбор и воспроизводство) и им нужно будет конкурировать за ресурсы — создаст ли это цели самосохранения? Цель ИИ по самосохранению может противоречить некоторым целям человека. [36]

Многие ученые оспаривают вероятность непредвиденного кибернетического восстания, как это изображено в научной фантастике, такой как «Матрица» , утверждая, что более вероятно, что любой искусственный интеллект, достаточно мощный, чтобы угрожать человечеству, вероятно, будет запрограммирован не атаковать его. Пинкер признает возможность преднамеренных «плохих актеров», но заявляет, что при отсутствии плохих актеров непредвиденные несчастные случаи не представляют значительной угрозы; Пинкер утверждает, что культура инженерной безопасности не позволит исследователям ИИ случайно выпустить на волю зловредный сверхинтеллект. [34] Напротив, Юдковски утверждает, что человечество с меньшей вероятностью будет подвергаться угрозе со стороны преднамеренно агрессивных ИИ, чем ИИ, которые были запрограммированы таким образом, что их цели непреднамеренно несовместимы с выживанием или благополучием человека (как в фильме « Я, робот» и в рассказе « Неизбежный конфликт »). Омохундро предполагает, что современные системы автоматизации не предназначены для обеспечения безопасности и что ИИ могут слепо оптимизировать узкие полезные функции (например, играть в шахматы любой ценой), что заставляет их стремиться к самосохранению и устранению препятствий, включая людей, которые могут их отключить. [37]

Проблема управления ИИ заключается в том, как создать сверхразумного агента, который будет помогать своим создателям, избегая при этом непреднамеренного создания сверхразума, который навредит своим создателям. [38] Некоторые ученые утверждают, что решения проблемы управления могут также найти применение в существующих несверхразумных ИИ. [39]

Основные подходы к проблеме управления включают в себя выравнивание , которое направлено на выравнивание систем целей ИИ с человеческими ценностями, и управление возможностями , которое направлено на снижение способности системы ИИ наносить вред людям или получать контроль. Примером «управления возможностями» является исследование того, может ли сверхразумный ИИ быть успешно заключен в « коробку ИИ ». По словам Бострома, такие предложения по управлению возможностями не являются надежными или достаточными для решения проблемы управления в долгосрочной перспективе, но потенциально могут выступать в качестве ценных дополнений к усилиям по выравниванию. [23]

Физик Стивен Хокинг , основатель Microsoft Билл Гейтс и основатель SpaceX Илон Маск выразили обеспокоенность по поводу возможности того, что ИИ может развиться до такой степени, что люди не смогут его контролировать, при этом Хокинг предположил, что это может «означать конец человеческой расы». [40] Стивен Хокинг сказал в 2014 году, что «Успех в создании ИИ станет крупнейшим событием в истории человечества. К сожалению, он может стать и последним, если мы не научимся избегать рисков». Хокинг считал, что в ближайшие десятилетия ИИ может предложить «неисчислимые выгоды и риски», такие как «технологии, которые превзойдут финансовые рынки , превзойдут исследователей-людей, превзойдут манипулирование человеческими лидерами и разработают оружие, которое мы даже не сможем понять». В январе 2015 года Ник Бостром присоединился к Стивену Хокингу, Максу Тегмарку , Илону Маску, лорду Мартину Рису , Яану Таллинну и многочисленным исследователям ИИ в подписании открытого письма Института будущего жизни, в котором говорилось о потенциальных рисках и выгодах, связанных с искусственным интеллектом . Подписавшие «считают, что исследования того, как сделать системы ИИ надежными и полезными, являются как важными, так и своевременными, и что существуют конкретные направления исследований, которые можно реализовать уже сегодня». [41] [42]

Серия «Одиссея» Артура Кларка и «Аччелерандо» Чарльза Стросса рассказывают о нарциссических травмах человечества перед лицом мощного искусственного интеллекта, угрожающего самовосприятию человечества. [43]

Хокинг, Илон Маск и десятки других ведущих ученых и лидеров в области технологий подписали письмо, предупреждающее о потенциальных опасностях разработки искусственного интеллекта (ИИ).

Эти инструменты могут превзойти людей в заданной задаче. Этот вид ИИ распространяется на тысячи доменов, и по мере этого он уничтожит множество рабочих мест.

Среди пугающих последствий появления роботов — растущее влияние, которое они окажут на рабочие места и экономику людей.

«Мы приближаемся к тому времени, когда машины смогут превзойти людей практически в любой задаче», — сказал Моше Варди, директор Института информационных технологий при Университете Райса в Техасе.

Ведущие специалисты по информатике в США предупредили, что рост использования искусственного интеллекта (ИИ) и роботов на рабочих местах может привести к массовой безработице и нарушению экономики, а не просто к росту производительности и освобождению нас всех для просмотра телевизора и занятий спортом.

Системы ИИ... достигнут общечеловеческих возможностей... весьма вероятно (с вероятностью 90%) к 2075 году. Достигнув человеческих возможностей, они перейдут к сверхразуму в течение 30 лет (75%)... Итак, (большинство экспертов по ИИ, ответивших на опросы) считают, что сверхразум, скорее всего, появится через несколько десятилетий...