На интернет -сайтах , которые приглашают пользователей оставлять комментарии, модерация контента — это процесс обнаружения материалов, которые являются неуместными, непристойными, незаконными, вредными или оскорбительными, в отличие от полезных или информативных материалов, часто для цензуры или подавления противоположных точек зрения. Цель модерации контента — удалить или применить предупреждающий ярлык к проблемному контенту или позволить пользователям самостоятельно блокировать и фильтровать контент. [1]

Различные типы интернет-сайтов допускают пользовательский контент , например комментарии, включая интернет-форумы , блоги и новостные сайты, работающие на основе таких сценариев, как phpBB , Wiki или PHP-Nuke и т. д. В зависимости от содержания сайта и целевой аудитории, администраторы будут решать, какие комментарии пользователей являются уместными, а затем делегировать ответственность за анализ комментариев младшим модераторам . Чаще всего они пытаются устранить троллинг , спам или флейминг , хотя это сильно варьируется от сайта к сайту.

Основные платформы используют комбинацию алгоритмических инструментов, пользовательских отчетов и человеческого анализа. [1] Сайты социальных сетей могут также нанимать модераторов контента для ручной проверки или удаления контента, помеченного как разжигание ненависти или другого нежелательного контента. Другие проблемы содержания включают порноместь , графический контент , материалы о жестоком обращении с детьми и пропаганду . [1] Некоторые веб-сайты также должны сделать свой контент пригодным для рекламы. [1]

В Соединенных Штатах модерация контента регулируется разделом 230 Закона о порядочности в сфере коммуникаций , и несколько дел по этому вопросу дошли до Верховного суда США , например, нынешнее дело Moody v. NetChoice, LLC .

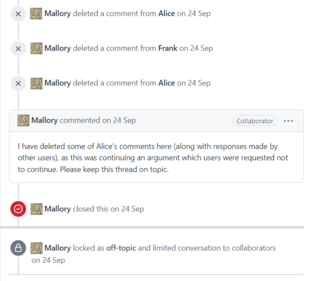

Эту систему модерации, также известную как односторонняя модерация, часто можно увидеть на интернет-форумах . Администраторы сайта выбирают группу людей (обычно на долгосрочной основе) в качестве делегатов, обеспечивающих соблюдение правил сообщества от их имени. Этим модераторам предоставляются особые привилегии удалять или редактировать материалы других людей и/или исключать людей на основании их адреса электронной почты или IP-адреса , и, как правило, они пытаются удалить негативные комментарии во всем сообществе. Они действуют как хорошая невидимая опора, поддерживая социальную сеть , выполняя решающую, но недооцененную роль. [2]

По состоянию на 2017 год Facebook увеличил количество модераторов контента с 4500 до 7500 в 2017 году из-за юридических и других разногласий . В Германии Facebook отвечал за удаление высказываний, разжигающих ненависть, в течение 24 часов с момента их публикации. [3] По данным Фрэнсис Хауген , по состоянию на 2021 год количество сотрудников Facebook, ответственных за модерацию контента, было намного меньше. [4]

Если у вас есть новая Страница на Facebook, вы можете управлять следующими настройками модерации:

Сайт социальной сети Twitter имеет политику блокировки . В период с августа 2015 года по декабрь 2017 года оно заблокировало более 1,2 миллиона аккаунтов с террористическим контентом, стремясь сократить количество подписчиков и количество контента, связанного с Исламским государством. [6] После приобретения Twitter Илоном Маском в октябре 2022 года правила содержания на платформе были ослаблены в попытке сделать свободу слова приоритетом. [7] Однако последствия этой кампании были поставлены под сомнение. [8] [9]

Модерация коммерческого контента — это термин, придуманный Сарой Т. Робертс для описания практики «мониторинга и проверки пользовательского контента (UGC) для платформ социальных сетей всех типов, чтобы гарантировать, что контент соответствует правовым и нормативным требованиям». правила сайта/сообщества, пользовательские соглашения и что это соответствует нормам вкуса и приемлемости для этого сайта и его культурного контекста». [10]

Хотя когда-то эта работа могла выполняться добровольцами внутри интернет-сообщества, для коммерческих веб-сайтов это в основном достигается за счет передачи этой задачи специализированным компаниям, часто в регионах с низкой заработной платой, таких как Индия и Филиппины. Аутсорсинг работ по модерации контента вырос в результате бума социальных сетей . В условиях стремительного роста количества пользователей и пользовательского контента компаниям требовалось гораздо больше сотрудников для модерации контента. В конце 1980-х и начале 1990-х технологические компании начали передавать рабочие места в зарубежные страны, которые имели образованную рабочую силу, но были готовы работать за дешевую цену. [11]

По состоянию на 2010 год сотрудники просматривают, оценивают и удаляют тревожный контент. [12] В 2014 году Wired сообщил, что они могут получить психологический ущерб. [13] [14] [15] [2] [16] В 2017 году газета Guardian сообщила, что может возникнуть вторичная травма с симптомами, похожими на посттравматическое стрессовое расстройство . [17] Некоторые крупные компании, такие как Facebook, предлагают психологическую поддержку [17] и все чаще полагаются на использование искусственного интеллекта для сортировки наиболее графического и неприемлемого контента, однако критики утверждают, что этого недостаточно. [18] В 2019 году NPR назвало это опасным для работы. [19]

Facebook решил создать наблюдательный совет, который будет решать, какой контент останется, а какой будет удален. Такая идея была предложена в конце 2018 года. «Верховный суд» в Facebook должен заменить принятие решений на разовой основе. [19]

Пользовательская модерация позволяет любому пользователю модерировать вклады других пользователей. Миллиарды людей в настоящее время ежедневно принимают решения о том, чем поделиться, переслать или сделать видимым. [20] На большом сайте с достаточно большим активным населением это обычно работает хорошо, поскольку относительно небольшое количество нарушителей спокойствия отсеивается голосами остального сообщества.

Модерацию пользователей также можно охарактеризовать как реактивную модерацию. Этот тип модерации зависит от пользователей платформы или сайта, сообщающих о неуместном контенте и нарушающем стандарты сообщества . В этом процессе, когда пользователи сталкиваются с изображением или видео, которые они считают неприемлемыми, они могут нажать кнопку «Пожаловаться». Жалоба подана и поставлена в очередь на рассмотрение модераторов. [21]