Анализ главных компонентов ( PCA ) — это метод уменьшения линейной размерности , который применяется в исследовательском анализе данных , визуализации и предварительной обработке данных .

Данные линейно преобразуются в новую систему координат, так что можно легко определить направления (главные компоненты), отражающие наибольшее изменение данных.

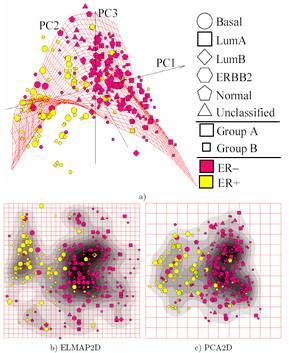

Основными компонентами набора точек в реальном координатном пространстве являются последовательность единичных векторов , где -й вектор — это направление линии, которая лучше всего соответствует данным и при этом ортогональна первым векторам. Здесь наиболее подходящая линия определяется как линия, которая минимизирует средний квадрат перпендикулярного расстояния от точек до линии . Эти направления (т.е. главные компоненты) составляют ортонормированный базис , в котором различные отдельные измерения данных линейно некоррелированы . Во многих исследованиях первые два основных компонента используются для отображения данных в двух измерениях и визуальной идентификации кластеров тесно связанных точек данных. [1]

Анализ главных компонентов находит применение во многих областях, таких как популяционная генетика , исследования микробиома и наука об атмосфере .

При выполнении PCA первым главным компонентом набора переменных, который, как предполагается, совместно нормально распределен, является производная переменная, сформированная как линейная комбинация исходных переменных, которая объясняет наибольшую дисперсию. Второй главный компонент объясняет наибольшую дисперсию в том, что остается после устранения влияния первого компонента, и мы можем продолжать итерации, пока не будет объяснена вся дисперсия. PCA чаще всего используется, когда многие переменные сильно коррелируют друг с другом и желательно сократить их количество до независимого набора.

Первый главный компонент эквивалентно можно определить как направление, которое максимизирует дисперсию прогнозируемых данных. -й главный компонент можно принять как направление, ортогональное первым главным компонентам, которое максимизирует дисперсию прогнозируемых данных.

Для любой цели можно показать, что главные компоненты являются собственными векторами ковариационной матрицы данных . Таким образом, главные компоненты часто вычисляются путем собственного разложения матрицы ковариации данных или разложения матрицы данных по сингулярным значениям. PCA — это самый простой из настоящих многомерных анализов на основе собственных векторов, который тесно связан с факторным анализом . Факторный анализ обычно включает в себя более специфичные для предметной области предположения о базовой структуре и решает собственные векторы немного другой матрицы. PCA также связан с каноническим корреляционным анализом (CCA) . CCA определяет системы координат, которые оптимально описывают взаимную ковариацию между двумя наборами данных, а PCA определяет новую ортогональную систему координат , которая оптимально описывает дисперсию в одном наборе данных. [2] [3] [4] [5] Также были предложены надежные и основанные на норме L1 варианты стандартного PCA. [6] [7] [8] [5]

PCA был изобретен в 1901 году Карлом Пирсоном [9] как аналог теоремы о главной оси в механике ; Позже он был независимо разработан и назван Гарольдом Хотеллингом в 1930-х годах. [10] В зависимости от области применения его также называют дискретным преобразованием Карунена-Лоэва (КЛТ) в обработке сигналов , преобразованием Хотеллинга в многомерном контроле качества, собственным ортогональным разложением (POD) в машиностроении, разложением по сингулярным значениям (SVD) . ) X (изобретен в последней четверти XIX века [11] ), разложение по собственным значениям (EVD) X T X в линейной алгебре, факторный анализ (обсуждение различий между PCA и факторным анализом см. в гл. 7 книги Анализ главных компонентов Джоллиффа ), [12] Теорема Эккарта-Янга (Харман, 1960) или эмпирические ортогональные функции (ЭОФ) в метеорологической науке (Лоренц, 1956), эмпирическое разложение собственных функций (Сирович, 1987), квазигармонические режимы (Брукс и др.) ., 1988), спектральное разложение в шуме и вибрации и эмпирический модальный анализ в динамике конструкций.

PCA можно рассматривать как подгонку p -мерного эллипсоида к данным, где каждая ось эллипсоида представляет собой главный компонент. Если какая-то ось эллипсоида мала, то и дисперсия вдоль этой оси также мала.

Чтобы найти оси эллипсоида, мы должны сначала центрировать значения каждой переменной в наборе данных на 0, вычитая среднее значение наблюдаемых значений переменной из каждого из этих значений. Эти преобразованные значения используются вместо исходных наблюдаемых значений для каждой из переменных. Затем мы вычисляем ковариационную матрицу данных и вычисляем собственные значения и соответствующие собственные векторы этой ковариационной матрицы. Затем мы должны нормализовать каждый из ортогональных собственных векторов, чтобы превратить их в единичные векторы. Как только это будет сделано, каждый из взаимно ортогональных единичных собственных векторов можно будет интерпретировать как ось эллипсоида, подобранного к данным. Этот выбор базиса преобразует ковариационную матрицу в диагональную форму, в которой диагональные элементы представляют дисперсию каждой оси. Доля дисперсии, которую представляет каждый собственный вектор, можно рассчитать путем деления собственного значения, соответствующего этому собственному вектору, на сумму всех собственных значений.

Биплоты и графики осыпей (степень объясненной дисперсии) используются для интерпретации результатов PCA.

PCA определяется как ортогональное линейное преобразование в реальном внутреннем пространстве продукта , которое преобразует данные в новую систему координат так, что наибольшая дисперсия некоторой скалярной проекции данных приходится на первую координату (называемую первым главным компонентом), второе по величине отклонение второй координаты и так далее. [12]

Рассмотрим матрицу данных X с нулевым эмпирическим средним значением по столбцам (выборочное среднее каждого столбца было сдвинуто к нулю), где каждая из n строк представляет собой различное повторение эксперимента, а каждый из p столбцов дает особенности определенного типа (скажем, результаты работы определенного датчика).

Математически преобразование определяется набором размеров p -мерных векторов весов или коэффициентов , которые отображают каждый вектор-строку X в новый вектор оценок главных компонентов , заданный формулой

таким образом, что отдельные переменные t , рассматриваемые в наборе данных , последовательно наследуют максимально возможную дисперсию от X , при этом каждый вектор коэффициентов w ограничен единичным вектором (где обычно выбирается строго меньше, чем для уменьшения размерности).

Таким образом , чтобы максимизировать дисперсию, первый весовой вектор w (1) должен удовлетворять

Аналогично, запись этого в матричной форме дает

Поскольку w (1) был определен как единичный вектор, он эквивалентно также удовлетворяет

Величину, которую необходимо максимизировать, можно определить как коэффициент Рэлея . Стандартный результат для положительной полуопределенной матрицы, такой как X T X, заключается в том, что максимально возможное значение фактора является наибольшим собственным значением матрицы, которое возникает, когда w является соответствующим собственным вектором .

Найдя w (1) , первый главный компонент вектора данных x ( i ) можно затем представить как оценку t 1( i ) = x ( i ) ⋅ w (1) в преобразованных координатах или как соответствующий вектор в исходных переменных, { x ( i ) ⋅ w (1) } w (1) .

k - й компонент можно найти, вычитая первые k - 1 главных компонент из X :

а затем найти вектор весов, который извлекает максимальную дисперсию из этой новой матрицы данных

Оказывается, это дает оставшиеся собственные векторы X T X с максимальными значениями величины в скобках, заданными соответствующими собственными значениями. Таким образом, весовые векторы являются собственными векторами X T X .

Таким образом, k -й главный компонент вектора данных x ( i ) может быть задан как оценка t k ( i ) = x ( i ) ⋅ w ( k ) в преобразованных координатах или как соответствующий вектор в пространстве исходные переменные, { x ( i ) ⋅ w ( k ) } w ( k ) , где w ( k ) - k- й собственный вектор X T X .

Таким образом , полное разложение X на главные компоненты можно представить как

где W — матрица весов p - x- p , столбцы которой являются собственными векторами X T X. Транспонирование W иногда называют преобразованием отбеливания или сферирования . Столбцы W , умноженные на квадратный корень из соответствующих собственных значений, то есть собственных векторов, увеличенных за счет дисперсий, называются нагрузками в PCA или в факторном анализе.

Сам X T X можно признать пропорциональным эмпирической выборочной ковариационной матрице набора данных X T . [12] : 30–31

Выборочная ковариация Q между двумя различными главными компонентами набора данных определяется следующим образом:

где свойство собственных значений w ( k ) использовалось для перехода от строки 2 к строке 3. Однако собственные векторы w ( j ) и w ( k ) , соответствующие собственным значениям симметричной матрицы, ортогональны (если собственные значения различны), или могут быть ортогональными (если векторы имеют одинаковое повторяющееся значение). Таким образом, произведение в последней строке равно нулю; в наборе данных нет выборочной ковариации между различными главными компонентами.

Таким образом, другой способ охарактеризовать преобразование главных компонентов - это преобразование в координаты, которые диагонализуют ковариационную матрицу эмпирической выборки.

В матричной форме эмпирическую ковариационную матрицу исходных переменных можно записать

Эмпирическая ковариационная матрица между главными компонентами принимает вид

где Λ — диагональная матрица собственных значений λ ( k ) оператора X T X. λ ( k ) равно сумме квадратов по набору данных, связанному с каждым компонентом k , то есть λ ( k ) = Σ я т k 2 ( я ) = Σ я ( Икс ( я ) ⋅ ш ( k ) ) 2 .

Преобразование T = X W отображает вектор данных x ( i ) из исходного пространства p переменных в новое пространство p переменных, которые не коррелируют в наборе данных. Однако не все основные компоненты должны быть сохранены. Сохранение только первых L главных компонентов, полученных с использованием только первых L собственных векторов, дает усеченное преобразование

где матрица T L теперь имеет n строк, но только L столбцов. Другими словами, PCA изучает линейное преобразование , при котором столбцы матрицы p × L образуют ортогональный базис для L признаков (компонентов представления t ), которые декоррелированы. [13] По своей конструкции из всех преобразованных матриц данных, содержащих только L столбцов, эта оценочная матрица максимизирует дисперсию исходных данных, которые были сохранены, одновременно минимизируя общую квадратичную ошибку реконструкции или .

Такое уменьшение размерности может быть очень полезным шагом для визуализации и обработки многомерных наборов данных, сохраняя при этом как можно большую дисперсию в наборе данных. Например, если выбрать L = 2 и сохранить только первые два главных компонента, в многомерном наборе данных будет найдена двумерная плоскость, в которой данные наиболее разбросаны, поэтому, если данные содержат кластеры , они тоже могут быть наиболее разбросаны. и поэтому наиболее наглядно их можно изобразить на двухмерной диаграмме; тогда как если два направления данных (или две исходные переменные) выбираются случайным образом, кластеры могут быть гораздо менее разбросаны друг от друга и фактически с гораздо большей вероятностью существенно перекроют друг друга, делая их неразличимыми.

Аналогичным образом, в регрессионном анализе , чем больше допустимое количество объясняющих переменных , тем выше вероятность переобучения модели, приводящего к выводам, которые не могут быть обобщены на другие наборы данных. Один из подходов, особенно когда существуют сильные корреляции между различными возможными объясняющими переменными, состоит в том, чтобы свести их к нескольким главным компонентам, а затем провести против них регрессию, метод, называемый регрессией главных компонентов .

Уменьшение размерности также может быть целесообразным, когда переменные в наборе данных зашумлены. Если каждый столбец набора данных содержит независимый одинаково распределенный гауссовский шум, то столбцы T также будут содержать одинаково одинаково распределенный гауссов шум (такое распределение инвариантно под воздействием матрицы W , которую можно рассматривать как многомерную вращение осей координат). Однако, поскольку большая часть общей дисперсии сосредоточена в первых нескольких главных компонентах по сравнению с той же дисперсией шума, пропорциональное влияние шума меньше — первые несколько компонентов достигают более высокого отношения сигнал/шум . Таким образом, PCA может привести к концентрации большей части сигнала на первых нескольких основных компонентах, которые можно с пользой уловить путем уменьшения размерности; в то время как более поздние основные компоненты могут подвергаться доминированию шума, и поэтому от них можно избавиться без больших потерь. Если набор данных не слишком велик, значимость основных компонентов можно проверить с помощью параметрической начальной загрузки , чтобы определить, сколько основных компонентов следует сохранить. [14]

Преобразование главных компонент также может быть связано с другой матричной факторизацией, разложением по сингулярным значениям (SVD) X ,

Здесь Σ — прямоугольная диагональная матрица размером n × p из положительных чисел σ ( k ) , называемая сингулярными значениями X ; U — матрица размером n × n , столбцы которой представляют собой ортогональные единичные векторы длины n, называемые левыми сингулярными векторами X ; и W — матрица p -x- p , столбцы которой являются ортогональными единичными векторами длины p и называются правыми сингулярными векторами X .

В терминах этой факторизации матрица X T X может быть записана

где – квадратная диагональная матрица с сингулярными значениями X и отрезанными лишними нулями, удовлетворяющая условию . Сравнение с факторизацией собственных векторов X T X устанавливает, что правые сингулярные векторы W X эквивалентны собственным векторам X T X , а сингулярные значения σ ( k ) равны квадратному корню из собственных значений λ ( k ) . ) из X T X .

Используя разложение по сингулярным значениям, матрицу оценок T можно записать

таким образом, каждый столбец T задается одним из левых сингулярных векторов X , умноженным на соответствующее сингулярное значение. Эта форма также является полярным разложением T .

Существуют эффективные алгоритмы для расчета SVD X без необходимости формирования матрицы X T X , поэтому вычисление SVD теперь является стандартным способом расчета анализа главных компонентов из матрицы данных [15] , если только не требуется только несколько компонентов. .

Как и в случае с собственным разложением, усеченная матрица оценок T L размера n × L может быть получена путем рассмотрения только первых L крупнейших сингулярных значений и их сингулярных векторов:

Усечение матрицы M или T с использованием усеченного разложения по сингулярным значениям таким образом дает усеченную матрицу, которая является ближайшей возможной матрицей ранга L к исходной матрице в том смысле, что разница между ними имеет наименьшую возможную норму Фробениуса. , результат, известный как теорема Эккарта – Янга [1936].

Сингулярные значения (в Σ ) являются квадратными корнями собственных значений матрицы X T X . Каждое собственное значение пропорционально части «дисперсии» (точнее, суммы квадратов расстояний точек от их многомерного среднего значения), которая связана с каждым собственным вектором. Сумма всех собственных значений равна сумме квадратов расстояний точек от их многомерного среднего значения. PCA по существу вращает набор точек вокруг их среднего значения, чтобы согласовать его с основными компонентами. Это переместит как можно большую часть дисперсии (с использованием ортогонального преобразования) в первые несколько измерений. Поэтому значения в остальных измерениях имеют тенденцию быть небольшими и могут быть отброшены с минимальной потерей информации (см. ниже ). PCA часто используется таким образом для уменьшения размерности . PCA отличается тем, что является оптимальным ортогональным преобразованием для сохранения подпространства с наибольшей «дисперсией» (как определено выше). Это преимущество, однако, достигается ценой более высоких вычислительных требований по сравнению, например, и, когда это применимо, с дискретным косинусным преобразованием и, в частности, с DCT-II, который просто известен как «DCT». Методы нелинейного уменьшения размерности, как правило, требуют больше вычислительных ресурсов, чем PCA.

PCA чувствителен к масштабированию переменных. Если у нас есть только две переменные, и они имеют одинаковую выборочную дисперсию и полностью коррелируют, то PCA повлечет за собой поворот на 45° и «веса» (они представляют собой косинусы вращения) для двух переменных относительно основной компоненты будут равны. Но если мы умножим все значения первой переменной на 100, то первый главный компонент будет почти таким же, как и эта переменная, с небольшим вкладом другой переменной, тогда как второй компонент будет почти совмещен со второй исходной переменной. Это означает, что всякий раз, когда разные переменные имеют разные единицы измерения (например, температура и масса), PCA является несколько произвольным методом анализа. (Другие результаты были бы получены, если бы мы использовали, например, градусы Фаренгейта, а не Цельсия.) Оригинальная статья Пирсона называлась «О линиях и плоскостях, наиболее близких к системам точек в пространстве» - «в пространстве» подразумевает физическое евклидово пространство, где подобные проблемы имеют место. не возникать. Один из способов сделать PCA менее произвольным — использовать переменные, масштабированные так, чтобы иметь единичную дисперсию, путем стандартизации данных и, следовательно, использовать матрицу автокорреляции вместо матрицы автоковариации в качестве основы для PCA. Однако это сжимает (или расширяет) флуктуации во всех измерениях сигнального пространства до единичной дисперсии.

Вычитание среднего значения (также известное как «центрирование среднего») необходимо для выполнения классического PCA, чтобы гарантировать, что первый главный компонент описывает направление максимальной дисперсии. Если вычитание среднего значения не выполняется, вместо этого первый главный компонент может более или менее соответствовать среднему значению данных. Среднее значение нуля необходимо для нахождения базиса, который минимизирует среднеквадратическую ошибку аппроксимации данных. [16]

Центрирование среднего значения не требуется при выполнении анализа главных компонентов корреляционной матрицы, поскольку данные уже центрированы после расчета корреляций. Корреляции получаются из перекрестного произведения двух стандартных оценок (Z-показателей) или статистических моментов (отсюда и название: корреляция продукта-момента Пирсона ). См. также статью Кромри и Фостера-Джонсона (1998) «Центрирование по среднему в умеренной регрессии: много шума из ничего» . Поскольку ковариации представляют собой корреляции нормализованных переменных ( Z- или стандартных показателей ), PCA, основанный на корреляционной матрице X , равен PCA , основанному на ковариационной матрице Z , стандартизированной версии X.

PCA — популярный основной метод распознавания образов . Однако он не оптимизирован для разделения классов. [17] Однако он использовался для количественной оценки расстояния между двумя или более классами путем расчета центра масс для каждого класса в пространстве главных компонентов и сообщения евклидова расстояния между центрами масс двух или более классов. [18] Линейный дискриминантный анализ является альтернативой, оптимизированной для разделения классов.

Некоторые свойства PCA включают: [12] [ нужна страница ]

Статистический смысл этого свойства заключается в том, что последние несколько ПК не являются просто неструктурированными остатками после удаления важных ПК. Поскольку эти последние ПК имеют дисперсию как можно меньше, они полезны сами по себе. Они могут помочь обнаружить неожиданные почти постоянные линейные связи между элементами x , а также могут быть полезны в регрессии , при выборе подмножества переменных из x и при обнаружении выбросов.

Прежде чем мы рассмотрим его использование, мы сначала рассмотрим диагональные элементы,

Тогда, возможно, главный статистический смысл результата состоит в том, что мы не только можем разложить совокупные дисперсии всех элементов x на уменьшающиеся вклады каждого ПК, но также можем разложить всю ковариационную матрицу на вклады от каждого ПК. Хотя это и не является строго уменьшением, элементы will имеют тенденцию уменьшаться по мере увеличения, как и не увеличиваются при увеличении , тогда как элементы имеют тенденцию оставаться примерно того же размера из-за ограничений нормализации: .

Как отмечалось выше, результаты PCA зависят от масштабирования переменных. Это можно исправить, масштабируя каждый признак по его стандартному отклонению, так что в итоге мы получаем безразмерные признаки с единичной дисперсией. [19]

Применимость PCA, как описано выше, ограничена некоторыми (неявными) предположениями [20] , сделанными при его выводе. В частности, PCA может фиксировать линейные корреляции между объектами, но терпит неудачу, когда это предположение нарушается (см. Рисунок 6a в ссылке). В некоторых случаях преобразования координат могут восстановить предположение о линейности и затем применить PCA (см. ядро PCA ).

Еще одним ограничением является процесс удаления среднего значения перед построением ковариационной матрицы для PCA. В таких областях, как астрономия, все сигналы неотрицательны, и процесс удаления среднего значения приводит к тому, что среднее значение некоторых астрофизических воздействий становится равным нулю, что, следовательно, создает нефизические отрицательные потоки, [21] и необходимо выполнять прямое моделирование, чтобы восстановить истинную величину сигналов. [22] В качестве альтернативного метода можно использовать неотрицательную матричную факторизацию , фокусирующуюся только на неотрицательных элементах в матрицах, что хорошо подходит для астрофизических наблюдений. [23] [24] [25] Дополнительную информацию см. в разделе «Связь между PCA и факторизацией неотрицательной матрицы».

PCA находится в невыгодном положении, если данные не были стандартизированы перед применением к ним алгоритма. PCA преобразует исходные данные в данные, соответствующие основным компонентам этих данных, а это означает, что новые переменные данных не могут интерпретироваться так же, как исходные. Они представляют собой линейную интерпретацию исходных переменных. Также при неправильном выполнении PCA существует высокая вероятность потери информации. [26]

PCA опирается на линейную модель. Если в наборе данных скрыта нелинейная закономерность, то PCA фактически может направить анализ в совершенно противоположном направлении прогресса. [27] [ нужна страница ] Исследователи из Университета штата Канзас обнаружили, что ошибка выборки в их экспериментах повлияла на погрешность результатов PCA. «Если количество субъектов или блоков меньше 30 и/или исследователя интересуют ПК, выходящие за пределы первого, возможно, лучше сначала внести поправку на серийную корреляцию, прежде чем проводить PCA». [28] Исследователи из штата Канзас также обнаружили, что PCA может быть «серьезно необъективным, если автокорреляционная структура данных не обрабатывается правильно». [28]

Уменьшение размерности в целом приводит к потере информации. Уменьшение размерности на основе PCA имеет тенденцию минимизировать потерю информации при определенных моделях сигнала и шума.

В предположении, что

то есть, что вектор данных представляет собой сумму желаемого информационного сигнала и шумового сигнала, можно показать, что PCA может быть оптимальным для уменьшения размерности с точки зрения теории информации.

В частности, Линскер показал, что если является гауссовым и является гауссовским шумом с ковариационной матрицей, пропорциональной единичной матрице, PCA максимизирует взаимную информацию между желаемой информацией и выходными данными с уменьшенной размерностью . [29]

Если шум по-прежнему является гауссовским и имеет ковариационную матрицу, пропорциональную единичной матрице (то есть компоненты вектора равны iid ), но информационный сигнал не является гауссовым (что является распространенным сценарием), PCA по крайней мере минимизирует верхнюю границу потери информации , которая определяется как [30] [31]

Оптимальность PCA также сохраняется, если шум является иидным и, по крайней мере, более гауссовым (с точки зрения расхождения Кульбака-Лейблера ), чем информационный сигнал . [32] В общем, даже если описанная выше модель сигнала справедлива, PCA теряет свою теоретико-информационную оптимальность, как только шум становится зависимым.

Ниже приводится подробное описание PCA с использованием ковариационного метода (см. также здесь), а не метода корреляции. [33]

Цель состоит в том, чтобы преобразовать данный набор данных X размерности p в альтернативный набор данных Y меньшего размера L. Эквивалентно, мы ищем матрицу Y , где Y — преобразование Карунена-Лоэва (KLT) матрицы X :

Предположим, у вас есть данные, содержащие набор наблюдений за p переменными, и вы хотите сократить данные так, чтобы каждое наблюдение можно было описать только с помощью L переменных, L < p . Предположим далее, что данные организованы как набор из n векторов данных , каждый из которых представляет одно сгруппированное наблюдение p переменных.

Вычитание среднего значения является неотъемлемой частью решения по поиску базиса главных компонент, который минимизирует среднеквадратическую ошибку аппроксимации данных. [34] Следовательно, мы действуем путем центрирования данных следующим образом:

В некоторых приложениях каждая переменная (столбец B ) также может быть масштабирована так, чтобы иметь дисперсию, равную 1 (см. Z-показатель ). [35] Этот шаг влияет на рассчитанные основные компоненты, но делает их независимыми от единиц, используемых для измерения различных переменных.

Пусть X — d -мерный случайный вектор, выраженный в виде вектора-столбца. Без ограничения общности предположим, что X имеет нулевое среднее значение.

Мы хотим найти матрицу ортонормированного преобразования P размером d × d так, чтобы PX имел диагональную ковариационную матрицу (то есть PX — это случайный вектор, все его отдельные компоненты попарно некоррелированы).

Быстрое вычисление при условии, что доходность будет унитарной:

Следовательно , выполняется тогда и только тогда, когда были диагонализуемы с помощью .

Это очень конструктивно, поскольку cov( X ) гарантированно будет неотрицательно определенной матрицей и, таким образом, гарантированно будет диагонализируемой некоторой унитарной матрицей.

В практических реализациях, особенно с данными большой размерности (большие p ), метод наивной ковариации используется редко, поскольку он неэффективен из-за высоких затрат вычислений и памяти на явное определение ковариационной матрицы. Безковариационный подход позволяет избежать np 2 операций явного вычисления и сохранения ковариационной матрицы X T X , вместо этого используя один из безматричных методов , например, основанный на функции, оценивающей произведение X T (X r) по стоимости 2 НП операций .

Один из способов эффективного вычисления первого главного компонента [40] показан в следующем псевдокоде для матрицы данных X с нулевым средним значением без вычисления ее ковариационной матрицы.

r = случайный вектор длины p r = r /norm( r )do c раз: s = 0 (вектор длины p ) для каждой строки x в X s = s + ( x ⋅ r ) x λ = r T s // λ — ошибка собственного значения = |λ ⋅ r − s | r = s /norm( s ) выход, если ошибка < допуск, возврат λ, r

Этот алгоритм итерации мощности просто вычисляет вектор X T (X r) , нормализует и помещает результат обратно в r . Собственное значение аппроксимируется r T (X T X) r , которое является фактором Рэлея единичного вектора r для ковариационной матрицы X T X . Если наибольшее сингулярное значение хорошо отделено от следующего по величине, вектор r приближается к первому главному компоненту X за количество итераций c , которое мало по сравнению с p , с общей стоимостью 2cnp . Сходимость степенных итераций можно ускорить, не жертвуя заметно небольшими затратами на итерацию, используя более совершенные безматричные методы , такие как алгоритм Ланцоша или метод локально оптимального блочного предварительно обусловленного сопряженного градиента ( LOBPCG ).

Последующие главные компоненты могут рассчитываться один за другим путем дефлятирования или одновременно блоком. В первом подходе неточности в уже вычисленных приближенных главных компонентах аддитивно влияют на точность вычисленных впоследствии главных компонент, тем самым увеличивая ошибку с каждым новым вычислением. Последний подход в блочном степенном методе заменяет одиночные векторы r и s блочными векторами, матрицами R и S. Каждый столбец R аппроксимирует один из ведущих главных компонентов, при этом все столбцы повторяются одновременно. Основным расчетом является оценка продукта X T (XR) . Реализованная, например, в LOBPCG , эффективная блокировка устраняет накопление ошибок, позволяет использовать высокоуровневые матрично-матричные функции произведения BLAS и обычно приводит к более быстрой сходимости по сравнению с одновекторным методом «один за другим».

Нелинейный итеративный метод частичных наименьших квадратов (NIPALS) — это вариант классической степенной итерации с дефляцией матрицы путем вычитания, реализованный для вычисления первых нескольких компонентов в анализе главного компонента или частичного метода наименьших квадратов . Для наборов данных очень большой размерности, например, созданных в области *омики (например, геномики , метаболомики ), обычно необходимо вычислить только первые несколько компьютеров. Нелинейный итеративный алгоритм частичных наименьших квадратов (NIPALS) обновляет итеративные аппроксимации ведущих оценок и нагрузок t 1 и r 1 T путем итерации степени , умножающей на каждой итерации на X слева и справа, то есть вычисление ковариационная матрица избегается, как и в безматрицной реализации итераций степени X TX , основанной на функции, оценивающей произведение X T (X r) = ((X r) TX ) T .

Дефляция матрицы путем вычитания выполняется путем вычитания внешнего продукта t 1 r 1 T из X , оставляя дефлированную остаточную матрицу, используемую для вычисления последующих ведущих PC. [41] Для больших матриц данных или матриц с высокой степенью коллинеарности столбцов NIPALS страдает от потери ортогональности ПК из-за ошибок округления машинной точности , накапливаемых на каждой итерации, и дефляции матрицы путем вычитания. [42] Алгоритм реортогонализации Грама-Шмидта применяется как к оценкам, так и к нагрузкам на каждом шаге итерации, чтобы устранить эту потерю ортогональности. [43] Зависимость NIPALS от одновекторных умножений не позволяет использовать преимущества высокоуровневого BLAS и приводит к медленной сходимости для кластеризованных ведущих сингулярных значений — оба этих недостатка устраняются в более сложных безматричных решателях блоков, таких как локально оптимальный блок с предварительным условием. Метод сопряженного градиента ( LOBPCG ).

В «онлайновой» или «потоковой» ситуации, когда данные поступают по частям, а не хранятся в одном пакете, полезно сделать оценку прогноза PCA, который может обновляться последовательно. Это можно сделать эффективно, но требуются другие алгоритмы. [44]

В PCA обычно мы хотим ввести качественные переменные в качестве дополнительных элементов. Например, многие количественные переменные были измерены на растениях. Для этих растений доступны некоторые качественные переменные, например, вид, к которому принадлежит растение. Эти данные были подвергнуты PCA для количественных переменных. При анализе результатов естественно связать главные компоненты с качественными переменными видами . Для этого получаются следующие результаты.

Эти результаты представляют собой то, что называется введением качественной переменной в качестве дополнительного элемента . Эта процедура подробно описана в Husson, Lê & Pages 2009 и Pages 2013. Немногие программы предлагают эту опцию «автоматическим» способом. Так обстоит дело со SPAD, который исторически, следуя за работой Людовика Лебарта , был первым, кто предложил этот вариант, и с пакетом R FactoMineR.

Самое раннее применение факторного анализа заключалось в обнаружении и измерении компонентов человеческого интеллекта. Считалось, что интеллект имеет различные некоррелированные компоненты, такие как пространственный интеллект, вербальный интеллект, индукция, дедукция и т. д., и что оценки по ним можно получить с помощью факторного анализа результатов различных тестов, чтобы получить единый индекс, известный как коэффициент интеллекта ( IQ). ). Пионер-статистический психолог Спирмен фактически разработал факторный анализ в 1904 году для своей двухфакторной теории интеллекта, добавив формальный метод к науке психометрии . В 1924 году Терстоун выявил 56 факторов интеллекта, разработав понятие умственного возраста. Сегодняшние стандартные тесты IQ основаны на этой ранней работе. [45]

В 1949 году Шевки и Уильямс представили теорию факторной экологии , которая доминировала в исследованиях жилищной дифференциации с 1950-х по 1970-е годы. [46] Районы в городе были узнаваемы или отличались друг от друга по различным характеристикам, которые можно было свести к трем с помощью факторного анализа. Они были известны как «социальный ранг» (индекс профессионального статуса), «семейство» или размер семьи и «этническая принадлежность»; Затем можно применить кластерный анализ для разделения города на кластеры или районы в соответствии со значениями трех ключевых факторных переменных. По факториальной экологии в городской географии сложилась обширная литература, но этот подход вышел из моды после 1980 года как методологически примитивный и имеющий мало места в постмодернистских географических парадигмах.

Одной из проблем факторного анализа всегда был поиск убедительных названий различных искусственных факторов. В 2000 году Флуд возродил подход факторной экологии, чтобы показать, что анализ главных компонентов фактически дает значимые ответы напрямую, не прибегая к ротации факторов. Основными компонентами на самом деле были двойные переменные или теневые цены «сил», сталкивающих людей вместе или друг от друга в городах. Первым компонентом была «доступность», классический компромисс между спросом на путешествия и спросом на пространство, на котором базируется классическая городская экономика. Следующими двумя компонентами были «недостаток», который удерживает людей с одинаковым статусом в отдельных кварталах (опосредованный планированием), и этническая принадлежность, где люди схожего этнического происхождения пытаются жить вместе. [47]

Примерно в то же время Австралийское статистическое бюро определило отдельные индексы преимуществ и недостатков, взяв первый главный компонент наборов ключевых переменных, которые считались важными. Эти индексы SEIFA регулярно публикуются для различных юрисдикций и часто используются в пространственном анализе. [48]

PCA был единственным формальным методом, доступным для разработки индексов, которые в противном случае представляли бы собой случайную задачу .

Индекс развития города был разработан PCA на основе примерно 200 показателей состояния городов в ходе исследования 1996 года, проведенного в 254 городах мира. Первый главный компонент подвергался итеративной регрессии с добавлением исходных переменных по отдельности до тех пор, пока не было учтено около 90% его вариаций. В конечном итоге в индексе использовалось около 15 индикаторов, но он был хорошим предсказателем многих других переменных. Его сравнительная ценность очень хорошо согласовывалась с субъективной оценкой состояния каждого города. Коэффициенты по объектам инфраструктуры были примерно пропорциональны средним затратам на предоставление основных услуг, что позволяет предположить, что Индекс на самом деле является мерой эффективных физических и социальных инвестиций в город.

Индекс человеческого развития (ИЧР) на уровне страны , разработанный ПРООН , который публикуется с 1990 года и очень широко используется в исследованиях развития, [49] имеет очень похожие коэффициенты для аналогичных показателей, что убедительно свидетельствует о том, что он изначально был построен с использованием PCA.

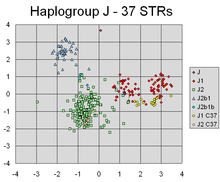

В 1978 году Кавалли-Сфорца и другие впервые применили анализ главных компонентов (PCA) для обобщения данных о вариациях частот человеческих генов в разных регионах. Компоненты демонстрировали характерные закономерности, включая градиенты и синусоидальные волны. Они интерпретировали эти закономерности как результат конкретных древних миграционных событий.

С тех пор PCA повсеместно используется в популяционной генетике: тысячи статей используют PCA в качестве механизма отображения. Генетика во многом варьируется в зависимости от близости, поэтому первые два основных компонента фактически отражают пространственное распределение и могут использоваться для картирования относительного географического положения различных групп населения, тем самым показывая людей, которые покинули свое первоначальное местонахождение. [50]

PCA в генетике был технически спорным, поскольку этот метод применялся к дискретным ненормальным переменным и часто к бинарным аллельным маркерам. Отсутствие каких-либо мер стандартной ошибки в PCA также является препятствием для более последовательного использования. В августе 2022 года молекулярный биолог Эран Эльхайк опубликовал в журнале Scientific Reports теоретическую статью, в которой анализируется 12 применений PCA. Он пришел к выводу, что этим методом легко манипулировать, что, по его мнению, приводит к «ошибочным, противоречивым и абсурдным» результатам. В частности, утверждал он, результаты, достигнутые в популяционной генетике, характеризуются избирательностью и круговым рассуждением . [51]

Исследования рынка активно используют PCA. Он используется для определения показателей удовлетворенности или лояльности клиентов для продуктов, а вместе с кластеризацией — для разработки сегментов рынка, на которые можно ориентироваться с помощью рекламных кампаний, во многом так же, как факторная экология позволяет определять географические области со схожими характеристиками. [52]

PCA быстро преобразует большие объемы данных в более мелкие и простые для понимания переменные, которые можно быстрее и проще анализировать. В любом потребительском опроснике есть ряд вопросов, призванных выявить потребительское отношение, а основные компоненты выявляют скрытые переменные, лежащие в основе этого отношения. Например, в ходе Оксфордского интернет-опроса в 2013 году 2000 человек опросили об их взглядах и убеждениях, и из этих опросов аналитики выделили четыре основных компонента, которые они определили как «побег», «социальные сети», «эффективность» и «создание проблем». . [53]

Другой пример, приведенный Джо Фладом в 2008 году, позволил получить индекс отношения к жилью из 28 вопросов об отношении в национальном опросе 2697 домохозяйств в Австралии. Первый главный компонент представлял собой общее отношение к собственности и домовладению. Индекс или вопросы отношения, которые он воплощает, могут быть включены в общую линейную модель выбора владения. Самым сильным фактором, определяющим частную аренду, безусловно, был индекс отношения, а не доход, семейное положение или тип домохозяйства. [54]

В количественных финансах PCA используется [55] для управления финансовыми рисками и применяется для решения других задач, таких как оптимизация портфеля .

PCA обычно используется в задачах, связанных с ценными бумагами и портфелями с фиксированным доходом , а также процентными деривативами . Оценки здесь зависят от всей кривой доходности , состоящей из множества сильно коррелирующих инструментов, а PCA используется для определения набора компонентов или факторов, которые объясняют движение ставок, [56] тем самым облегчая моделирование. Одним из распространенных приложений управления рисками является расчет стоимости риска , VaR, с применением PCA к моделированию Монте-Карло .[57] Здесь для каждой выборки моделирования компоненты подвергаются стрессу, а затем восстанавливаются ставки и, в свою очередь, значения вариантов ; и, наконец, VaR рассчитывается на протяжении всего периода. PCA также используется для хеджирования процентного риска , учитывая неполную дюрацию и другие чувствительные факторы.[56] В обоих случаях интерес представляют первые три, как правило, основные компоненты системы ( представляющие «сдвиг», «поворот» и «искривление»). Эти основные компоненты получаются в результате собственного разложения ковариационной матрицы доходности при заранее определенных сроках погашения; [58] и где дисперсия каждого компонента является его собственным значением (а поскольку компоненты ортогональны , в последующем моделировании не требуется учитывать корреляцию).

Для капитала оптимальным портфелем является портфель, в котором ожидаемая доходность максимизируется при заданном уровне риска или, альтернативно, где риск минимизируется при заданном доходе; см. обсуждение модели Марковица . Таким образом, один из подходов заключается в снижении портфельного риска, когда стратегии распределения применяются к «основным портфелям», а не к базовым акциям . Второй подход заключается в повышении доходности портфеля, используя основные компоненты для выбора акций с потенциалом роста.[59] [60] PCA также использовался для понимания отношений [55] между международными рынками акций и внутри рынков между группами компаний в отраслях или секторах .

PCA также может применяться для стресс-тестирования [61] , по существу, для анализа способности банка выдержать гипотетический неблагоприятный экономический сценарий . Его полезность заключается в «преобразовании информации, содержащейся в [нескольких] макроэкономических переменных , в более управляемый набор данных, который затем можно [использовать] для анализа». [61] Здесь результирующие факторы связаны, например, с процентными ставками – на основе крупнейших элементов собственного вектора фактора – и затем наблюдается, как «шок» каждого из факторов влияет на подразумеваемые активы каждого из банков.

Вариант анализа главных компонентов используется в нейробиологии для выявления специфических свойств стимула, повышающих вероятность генерации нейроном потенциала действия . [62] [63] Этот метод известен как ковариационный анализ, запускаемый пиками . В типичном приложении экспериментатор представляет процесс белого шума в качестве стимула (обычно либо как сенсорный входной сигнал для испытуемого, либо как ток, подаваемый непосредственно в нейрон) и записывает последовательность потенциалов действия или импульсов, создаваемых испытуемым. в результате нейрон. Предположительно, определенные особенности стимула повышают вероятность возникновения импульса у нейрона. Чтобы извлечь эти особенности, экспериментатор вычисляет ковариационную матрицу ансамбля, вызванного спайком , набора всех стимулов (определенных и дискретизированных в течение конечного временного окна, обычно порядка 100 мс), которые непосредственно предшествовали спайку. Собственные векторы разности между ковариационной матрицей, вызванной спайком, и ковариационной матрицей предшествующего ансамбля стимулов (набор всех стимулов, определенных в течение одного и того же временного окна) затем указывают направления в пространстве стимулов , вдоль которых дисперсия ансамбль, запускаемый спайком, больше всего отличался от ансамбля предшествующего стимула. В частности, собственные векторы с наибольшими положительными собственными значениями соответствуют направлениям, вдоль которых дисперсия ансамбля, запускаемого шипами, показала наибольшее положительное изменение по сравнению с дисперсией предыдущего. Поскольку это были направления, в которых изменение стимула приводило к всплеску, они часто являются хорошим приближением к искомым соответствующим характеристикам стимула.

В нейробиологии PCA также используется для определения личности нейрона по форме его потенциала действия. Сортировка спайков — важная процедура, поскольку методы внеклеточной регистрации часто улавливают сигналы от более чем одного нейрона. При сортировке спайков сначала используется PCA, чтобы уменьшить размерность пространства сигналов потенциала действия, а затем выполняется кластерный анализ , чтобы связать конкретные потенциалы действия с отдельными нейронами.

PCA как метод уменьшения размерности особенно подходит для обнаружения скоординированной деятельности больших ансамблей нейронов. Он использовался для определения коллективных переменных, то есть параметров порядка , во время фазовых переходов в мозге. [64]

Анализ соответствия (CA) был разработан Жаном-Полем Бензекри [65] и концептуально похож на PCA, но масштабирует данные (которые должны быть неотрицательными) так, чтобы строки и столбцы обрабатывались одинаково. Традиционно он применяется к таблицам непредвиденных обстоятельств . CA разлагает статистику хи-квадрат , связанную с этой таблицей, на ортогональные факторы. [66] Поскольку CA является описательным методом, его можно применять к таблицам, для которых статистика хи-квадрат подходит или нет. Доступно несколько вариантов CA, включая анализ соответствия без тренда и анализ канонического соответствия . Одним из специальных расширений является анализ множественных соответствий , который можно рассматривать как аналог анализа главных компонентов для категориальных данных. [67]

Анализ главных компонентов создает переменные, которые являются линейными комбинациями исходных переменных. Новые переменные обладают тем свойством, что все переменные ортогональны. Преобразование PCA может быть полезно в качестве этапа предварительной обработки перед кластеризацией. PCA — это подход, ориентированный на дисперсию, направленный на воспроизведение общей дисперсии переменной, в котором компоненты отражают как общую, так и уникальную дисперсию переменной. PCA обычно предпочтительнее для целей сокращения данных (то есть перевода пространства переменных в оптимальное пространство факторов), но не тогда, когда целью является обнаружение скрытой конструкции или факторов.

Факторный анализ аналогичен анализу главных компонентов, поскольку факторный анализ также включает в себя линейные комбинации переменных. В отличие от PCA, факторный анализ представляет собой подход, ориентированный на корреляцию, стремящийся воспроизвести взаимные корреляции между переменными, в котором факторы «представляют собой общую дисперсию переменных, исключая уникальную дисперсию». [68] С точки зрения корреляционной матрицы это соответствует объяснению недиагональных терминов (то есть общей ковариации), тогда как PCA фокусируется на объяснении терминов, которые находятся на диагонали. Однако, как побочный результат, при попытке воспроизвести диагональные члены PCA также имеет тенденцию относительно хорошо соответствовать недиагональным корреляциям. [12] : 158 Результаты, полученные с помощью PCA и факторного анализа, в большинстве ситуаций очень похожи, но это не всегда так, и есть некоторые проблемы, где результаты существенно различаются. Факторный анализ обычно используется, когда целью исследования является обнаружение структуры данных (то есть скрытых конструкций или факторов) или причинно-следственное моделирование . Если факторная модель сформулирована неправильно или предположения не выполняются, то факторный анализ даст ошибочные результаты. [69]

Утверждалось, что расслабленное решение кластеризации k - средних, заданное индикаторами кластера, задается главными компонентами, а подпространство PCA, охватываемое основными направлениями, идентично подпространству центроида кластера. [70] [71] Однако то, что PCA является полезным ослаблением кластеризации k -средних, не было новым результатом, [72] и легко найти контрпримеры к утверждению, что подпространство центроида кластера охватывается главными направлениями. [73]

Неотрицательная матричная факторизация (NMF) — это метод уменьшения размерности, при котором в матрицах используются только неотрицательные элементы, что, следовательно, является многообещающим методом в астрономии, [23] [24] [25] в том смысле, что астрофизические сигналы неотрицательный. Компоненты PCA ортогональны друг другу, тогда как все компоненты NMF неотрицательны и, следовательно, создают неортогональный базис.

В PCA вклад каждого компонента ранжируется на основе величины его соответствующего собственного значения, которое эквивалентно дробной остаточной дисперсии (FRV) при анализе эмпирических данных. [21] Для NMF его компоненты ранжируются только на основе эмпирических кривых FRV. [25] Графики остаточных дробных собственных значений, то есть в зависимости от количества компонентов при общем количестве компонентов, для PCA имеют плоское плато, где не собираются данные для удаления квазистатического шума, затем кривые быстро падают по мере того, как признак переобучения (случайный шум). [21] Кривые FRV для NMF непрерывно уменьшаются [25] , когда компоненты NMF строятся последовательно , [24] что указывает на непрерывное улавливание квазистатического шума; затем сходятся к более высоким уровням, чем PCA, [25] , что указывает на меньшую способность NMF переобучать.

Часто бывает трудно интерпретировать основные компоненты, когда данные включают множество переменных различного происхождения или когда некоторые переменные являются качественными. Это приводит пользователя PCA к деликатному исключению нескольких переменных. Если наблюдения или переменные оказывают чрезмерное влияние на направление осей, их следует удалить, а затем спроецировать как дополнительные элементы. Кроме того, необходимо избегать интерпретации близости между точками, близкими к центру факториальной плоскости.

Иконография корреляций , напротив, не являющаяся проекцией на систему осей, не имеет этих недостатков. Поэтому мы можем сохранить все переменные.

Принцип диаграммы состоит в том, чтобы подчеркнуть «замечательные» корреляции корреляционной матрицы сплошной линией (положительная корреляция) или пунктирной линией (отрицательная корреляция).

Сильная корреляция не является «примечательной», если она не является прямой, а вызвана влиянием третьей переменной. И наоборот, слабые корреляции могут быть «замечательными». Например, если переменная Y зависит от нескольких независимых переменных, корреляции Y с каждой из них слабы, но «замечательны».

Особым недостатком PCA является то, что основные компоненты обычно представляют собой линейные комбинации всех входных переменных. Разреженный PCA преодолевает этот недостаток, находя линейные комбинации, содержащие всего несколько входных переменных. Он расширяет классический метод анализа главных компонентов (PCA) для уменьшения размерности данных путем добавления ограничения разреженности входных переменных. Было предложено несколько подходов, в том числе

Методологические и теоретические разработки Sparse PCA, а также его применение в научных исследованиях были недавно рассмотрены в обзорной статье. [80]

Большинство современных методов нелинейного уменьшения размерности уходят своими теоретическими и алгоритмическими корнями в PCA или K-средние. Первоначальная идея Пирсона заключалась в том, чтобы взять прямую линию (или плоскость), которая будет «наилучшим образом соответствовать» набору точек данных. Тревор Хасти расширил эту концепцию, предложив «Основные кривые» [84] как естественное расширение геометрической интерпретации PCA, которая явно строит многообразие для аппроксимации данных с последующим проецированием на него точек, как показано на рис. алгоритм карты и принципиальный геодезический анализ . [85] Другим популярным обобщением является ядро PCA , которое соответствует PCA, выполняемому в воспроизводящем ядерном гильбертовом пространстве, связанном с положительно определенным ядром.

В мультилинейном обучении подпространств [ 86] [87] [88] PCA обобщается до полилинейного PCA (MPCA), который извлекает признаки непосредственно из тензорных представлений. MPCA решается путем итеративного выполнения PCA в каждом режиме тензора. MPCA применялся для распознавания лиц, распознавания походки и т. д. MPCA в дальнейшем расширяется до некоррелированного MPCA, неотрицательного MPCA и устойчивого MPCA.

N -сторонний анализ главных компонент может быть выполнен с использованием таких моделей, как разложение Такера , PARAFAC , многофакторный анализ, коинерционный анализ, STATIS и DISTATIS.

Хотя PCA находит математически оптимальный метод (например, минимизацию квадратичной ошибки), он по-прежнему чувствителен к выбросам в данных, которые приводят к большим ошибкам, чего метод пытается избежать в первую очередь. Поэтому обычной практикой является удаление выбросов перед вычислением PCA. Однако в некоторых контекстах выбросы бывает сложно выявить. Например, в алгоритмах интеллектуального анализа данных, таких как корреляционная кластеризация , назначение точек кластерам и выбросам заранее не известно. Недавно предложенное обобщение PCA [89] на основе взвешенного PCA повышает надежность за счет присвоения объектам данных разных весов на основе их предполагаемой релевантности.

Также были предложены устойчивые к выбросам варианты PCA, основанные на формулировках L1-нормы ( L1-PCA ). [6] [4]

Надежный анализ главных компонент (RPCA) посредством разложения в низкоранговых и разреженных матрицах представляет собой модификацию PCA, которая хорошо работает в отношении сильно искаженных наблюдений. [90] [91] [92]

Анализ независимых компонентов (ICA) направлен на решение тех же задач, что и анализ главных компонентов, но находит аддитивно разделяемые компоненты, а не последовательные приближения.

Учитывая матрицу , он пытается разложить ее на две матрицы так, что . Ключевое отличие от таких методов, как PCA и ICA, заключается в том, что некоторые записи ограничены значением 0. Здесь это называется регуляторным уровнем. Хотя в целом такое разложение может иметь несколько решений, они доказывают, что при выполнении следующих условий:

тогда разложение однозначно с точностью до умножения на скаляр. [93]

Дискриминантный анализ главных компонентов (DAPC) — это многомерный метод, используемый для идентификации и описания кластеров генетически связанных людей. Генетическая изменчивость разделена на два компонента: вариации между группами и внутри групп, и она максимизирует первую. Линейные дискриминанты — это линейные комбинации аллелей, которые лучше всего разделяют кластеры. Таким образом, аллели, которые больше всего способствуют этой дискриминации, — это те, которые наиболее заметно различаются между группами. Вклад аллелей в группы, идентифицированные с помощью DAPC, может позволить идентифицировать области генома, вызывающие генетическую дивергенцию между группами [94]. В DAPC данные сначала преобразуются с использованием анализа главных компонентов (PCA), а затем кластеры идентифицируются с помощью дискриминантного анализа ( ДА).

DAPC можно реализовать на R с помощью пакета Adegenet. (подробнее: сайт adegenet)

Анализ направленных компонентов (DCA) — это метод, используемый в науках об атмосфере для анализа многомерных наборов данных. [95] Как и PCA, он позволяет уменьшить размерность, улучшить визуализацию и улучшить интерпретируемость больших наборов данных. Как и PCA, он основан на ковариационной матрице, полученной из входного набора данных. Разница между PCA и DCA заключается в том, что DCA дополнительно требует ввода направления вектора, называемого воздействием. В то время как PCA максимизирует объясненную дисперсию, DCA максимизирует плотность вероятности с учетом воздействия. Целью DCA является поиск компонентов многомерного набора данных, которые одновременно вероятны (измеряются с использованием плотности вероятности) и важны (измеряются с использованием воздействия). DCA использовался для поиска наиболее вероятных и наиболее серьезных моделей волн тепла в ансамблях прогнозов погоды [96] , а также наиболее вероятных и наиболее влиятельных изменений количества осадков из-за изменения климата. [97]

pcaкоманды, либо с помощью princomp()функции.pcaфункции в пакете MultivariateStats.princompи pca(R2012b) дают главные компоненты, а функция pcaresдает остатки и восстановленную матрицу для аппроксимации PCA низкого ранга.g03aaпроцедуры (доступной в обеих версиях библиотеки для Фортрана).princompдает главный компонент.DBMS_DATA_MINING.SVDS_SCORING_MODEуказания значения параметра.SVDS_SCORING_PCAprincompи prcompвозможность использования для анализа главных компонент; prcompиспользует разложение по сингулярным значениям , что обычно дает лучшую числовую точность. Некоторые пакеты, реализующие PCA в R, включают, помимо прочего: ade4, vegan, ExPosition, dimRedи FactoMineR.princompвычисляет анализ главных компонентов, функция pcaвычисляет анализ главных компонентов со стандартизированными переменными.{{cite journal}}: CS1 maint: multiple names: authors list (link)