Теория вероятностей или исчисление вероятностей — это раздел математики, занимающийся вероятностью . Хотя существует несколько различных интерпретаций вероятности , теория вероятностей рассматривает эту концепцию в строгой математической манере, выражая ее через набор аксиом . Обычно эти аксиомы формализуют вероятность в терминах вероятностного пространства , которое назначает меру, принимающую значения от 0 до 1, называемую вероятностной мерой , набору результатов, называемому выборочным пространством . Любое указанное подмножество выборочного пространства называется событием .

Центральными предметами теории вероятностей являются дискретные и непрерывные случайные величины , распределения вероятностей и стохастические процессы (которые обеспечивают математические абстракции недетерминированных или неопределенных процессов или измеряемых величин , которые могут быть либо единичными событиями, либо развиваться с течением времени случайным образом). Хотя невозможно идеально предсказать случайные события, многое можно сказать об их поведении. Два основных результата теории вероятностей, описывающих такое поведение, — это закон больших чисел и центральная предельная теорема .

Как математическая основа статистики , теория вероятностей имеет важное значение для многих видов человеческой деятельности, которые включают количественный анализ данных. [1] Методы теории вероятностей также применяются к описанию сложных систем, имея лишь частичное знание их состояния, как в статистической механике или последовательной оценке . Великим открытием физики двадцатого века стала вероятностная природа физических явлений в атомных масштабах, описанная в квантовой механике . [2]

Современная математическая теория вероятностей берет свое начало в попытках анализа азартных игр Джероламо Кардано в шестнадцатом веке, а также Пьера де Ферма и Блеза Паскаля в семнадцатом веке (например, « проблема точек »). [3] Христиан Гюйгенс опубликовал книгу на эту тему в 1657 году. [4] В XIX веке то, что считается классическим определением вероятности, было завершено Пьером Лапласом . [5]

Первоначально теория вероятностей рассматривала в основном дискретные события, а ее методы были в основном комбинаторными . В конце концов, аналитические соображения вынудили включить в теорию непрерывные переменные.

Это достигло кульминации в современной теории вероятностей, на основе, заложенной Андреем Николаевичем Колмогоровым . Колмогоров объединил понятие выборочного пространства , введенное Рихардом фон Мизесом , и теорию меры и представил свою систему аксиом для теории вероятностей в 1933 году. Это стало в основном бесспорной аксиоматической основой для современной теории вероятностей; но существуют альтернативы, такие как принятие конечной, а не счетной аддитивности Бруно де Финетти . [6]

Большинство вступлений в теорию вероятностей рассматривают дискретные распределения вероятностей и непрерывные распределения вероятностей по отдельности. Рассмотрение вероятности на основе теории меры охватывает дискретные, непрерывные, их смесь и многое другое.

Рассмотрим эксперимент , который может дать несколько результатов. Набор всех результатов называется пространством выборки эксперимента. Множество мощности пространства выборки (или, что эквивалентно, пространство событий) формируется путем рассмотрения всех различных наборов возможных результатов. Например, бросание честной игральной кости дает один из шести возможных результатов. Один набор возможных результатов соответствует получению нечетного числа. Таким образом, подмножество {1,3,5} является элементом множества мощности пространства выборки бросков игральных костей. Эти наборы называются событиями . В этом случае {1,3,5} является событием, заключающимся в том, что кость выпадает на некоторое нечетное число. Если результаты, которые действительно происходят, приходятся на данное событие, говорят, что это событие произошло.

Вероятность — это способ присвоения каждому «событию» значения от нуля до единицы с требованием, чтобы событию, составленному из всех возможных результатов (в нашем примере, событию {1,2,3,4,5,6}), было присвоено значение единицы. Чтобы квалифицироваться как распределение вероятностей , присвоение значений должно удовлетворять требованию, что если вы смотрите на набор взаимоисключающих событий (событий, которые не содержат общих результатов, например, события {1,6}, {3} и {2,4} являются взаимоисключающими), вероятность того, что любое из этих событий произойдет, задается суммой вероятностей событий. [7]

Вероятность того, что произойдет любое из событий {1,6}, {3} или {2,4}, составляет 5/6. Это то же самое, что сказать, что вероятность события {1,2,3,4,6} составляет 5/6. Это событие охватывает возможность выпадения любого числа, кроме пяти. Взаимоисключающее событие {5} имеет вероятность 1/6, а событие {1,2,3,4,5,6} имеет вероятность 1, то есть абсолютную уверенность.

При выполнении вычислений с использованием результатов эксперимента необходимо, чтобы всем этим элементарным событиям был присвоен номер. Это делается с помощью случайной величины . Случайная величина — это функция, которая присваивает каждому элементарному событию в пространстве выборки действительное число . Эта функция обычно обозначается заглавной буквой. [8] В случае игральной кости присвоение числа определенным элементарным событиям может быть выполнено с помощью функции тождества . Это не всегда работает. Например, при подбрасывании монеты возможны два результата: «орел» и «решка». В этом примере случайная величина X может присвоить результату «орел» число «0» ( ), а результату «решка» число «1» ( ).

Дискретная теория вероятностей имеет дело с событиями, которые происходят в счетных выборочных пространствах.

Примеры: бросание игральных костей , эксперименты с колодами карт , случайное блуждание и подбрасывание монет .

Классическое определение : Первоначально вероятность наступления события определялась как число случаев, благоприятствующих событию, по отношению к числу всех возможных исходов в равновероятном выборочном пространстве: см. Классическое определение вероятности .

Например, если событием является «выпадение четного числа при бросании игральной кости», вероятность определяется по формуле , поскольку 3 грани из 6 имеют четные числа, и каждая грань имеет одинаковую вероятность появления.

Современное определение : Современное определение начинается с конечного или счетного множества , называемого пространством выборки , которое относится к множеству всех возможных результатов в классическом смысле, обозначаемому как . Затем предполагается, что для каждого элемента прилагается внутреннее значение «вероятности» , которое удовлетворяет следующим свойствам:

То есть, функция вероятности f ( x ) лежит между нулем и единицей для каждого значения x в пространстве выборки Ω , а сумма f ( x ) по всем значениям x в пространстве выборки Ω равна 1. Событие определяется как любое подмножество пространства выборки . Вероятность события определяется как

Таким образом, вероятность всего выборочного пространства равна 1, а вероятность нулевого события равна 0.

Функция, сопоставляющая точку в пространстве выборки со значением «вероятности», называется функцией массы вероятности, сокращенно pmf .

Непрерывная теория вероятностей имеет дело с событиями, которые происходят в непрерывном пространстве выборок.

Классическое определение : Классическое определение рушится при столкновении с непрерывным случаем. См. парадокс Бертрана .

Современное определение : Если выборочное пространство случайной величины X представляет собой множество действительных чисел ( ) или его подмножество, то существует функция, называемая кумулятивной функцией распределения ( CDF ) , определяемая как . То есть, F ( x ) возвращает вероятность того, что X будет меньше или равно x .

CDF обязательно удовлетворяет следующим свойствам.

Говорят, что случайная величина имеет непрерывное распределение вероятностей, если соответствующая CDF непрерывна. Если является абсолютно непрерывной , т. е. ее производная существует, и интегрирование производной возвращает нам CDF, тогда говорят, что случайная величина X имеет функцию плотности вероятности ( PDF ) или просто плотность

Для набора вероятность того, что случайная величина X находится в , равна

Если PDF существует, это можно записать как

В то время как функция плотности вероятности существует только для непрерывных случайных величин, функция распределения вероятности существует для всех случайных величин (включая дискретные случайные величины), которые принимают значения в

Эти концепции можно обобщить для многомерных случаев на и других непрерывных выборочных пространствах.

Полезность теоретико-мерной трактовки вероятности заключается в том, что она объединяет дискретные и непрерывные случаи и делает различие вопросом о том, какая мера используется. Кроме того, она охватывает распределения, которые не являются ни дискретными, ни непрерывными, ни смесями этих двух.

Примером таких распределений может быть смесь дискретных и непрерывных распределений, например, случайная величина, равная 0 с вероятностью 1/2 и принимающая случайное значение из нормального распределения с вероятностью 1/2. Ее все еще можно изучить в некоторой степени, рассматривая ее как имеющую PDF , где — дельта-функция Дирака .

Другие распределения могут даже не быть смесью, например, распределение Кантора не имеет положительной вероятности для любой отдельной точки, и не имеет плотности. Современный подход к теории вероятностей решает эти проблемы, используя теорию меры для определения вероятностного пространства :

Для любого множества (также называемого пространством выборок ) и σ-алгебры на нем мера , определенная на , называется вероятностной мерой, если

Если — борелевская σ-алгебра на множестве действительных чисел, то существует единственная вероятностная мера на для любого CDF, и наоборот. Говорят, что мера, соответствующая CDF, индуцируется CDF . Эта мера совпадает с pmf для дискретных переменных и PDF для непрерывных переменных, что делает подход теории меры свободным от заблуждений.

Вероятность множества в σ-алгебре определяется как

где интегрирование происходит по отношению к мере, индуцированной

Наряду с предоставлением лучшего понимания и объединения дискретных и непрерывных вероятностей, теоретико-мерное рассмотрение также позволяет нам работать с вероятностями вне , как в теории стохастических процессов . Например, для изучения броуновского движения вероятность определяется на пространстве функций.

Когда удобно работать с доминирующей мерой, теорема Радона-Никодима используется для определения плотности как производной Радона-Никодима интересующего распределения вероятностей относительно этой доминирующей меры. Дискретные плотности обычно определяются как эта производная относительно подсчитывающей меры по множеству всех возможных результатов. Плотности для абсолютно непрерывных распределений обычно определяются как эта производная относительно меры Лебега . Если теорему можно доказать в этой общей постановке, она справедлива как для дискретных, так и для непрерывных распределений, а также для других; для дискретных и непрерывных распределений отдельные доказательства не требуются.

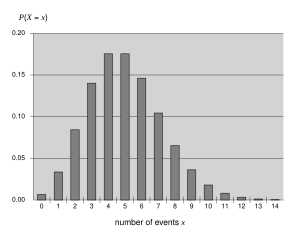

Некоторые случайные величины очень часто встречаются в теории вероятностей, поскольку они хорошо описывают многие естественные или физические процессы. Поэтому их распределения приобрели особое значение в теории вероятностей. Некоторые фундаментальные дискретные распределения — это дискретное равномерное , Бернулли , биномиальное , отрицательное биномиальное , Пуассона и геометрическое распределения . Важные непрерывные распределения включают непрерывное равномерное , нормальное , экспоненциальное , гамма- и бета-распределения .

В теории вероятностей существует несколько понятий сходимости для случайных величин . Они перечислены ниже в порядке возрастания силы, т. е. любое последующее понятие сходимости в списке подразумевает сходимость согласно всем предыдущим понятиям.

Как следует из названий, слабая сходимость слабее сильной сходимости. Фактически, сильная сходимость подразумевает сходимость по вероятности, а сходимость по вероятности подразумевает слабую сходимость. Обратные утверждения не всегда верны.

Обычная интуиция подсказывает, что если подбрасывать честную монету много раз, то примерно в половине случаев выпадет орел , а в другой половине — решка . Более того, чем чаще подбрасывается монета, тем больше вероятность того, что отношение числа выпавших орлов к числу решек будет приближаться к единице. Современная теория вероятностей дает формальную версию этой интуитивной идеи, известную как закон больших чисел . Этот закон примечателен тем, что он не предполагается в основах теории вероятностей, а вместо этого возникает из этих основ как теорема. Поскольку он связывает теоретически выведенные вероятности с их фактической частотой появления в реальном мире, закон больших чисел считается столпом в истории статистической теории и имеет широкое влияние. [9]

Закон больших чисел (ЗБЧ) гласит, что выборочное среднее

последовательности независимых и одинаково распределенных случайных величин сходится к их общему ожиданию (ожидаемому значению) при условии , что ожидание конечно.

Именно в различных формах сходимости случайных величин различаются слабый и сильный закон больших чисел [10]

Из ЗЛЧ следует, что если событие с вероятностью p наблюдается неоднократно в ходе независимых экспериментов, то отношение наблюдаемой частоты этого события к общему числу повторений стремится к p .

Например, если — независимые случайные величины Бернулли, принимающие значения 1 с вероятностью p и 0 с вероятностью 1- p , то для всех i , так что сходится к p почти наверняка .

Центральная предельная теорема (ЦПТ) объясняет повсеместное распространение нормального распределения в природе, и эта теорема, по словам Дэвида Уильямса, «является одним из величайших результатов математики». [11]

Теорема утверждает, что среднее значение многих независимых и одинаково распределенных случайных величин с конечной дисперсией стремится к нормальному распределению независимо от распределения, которому следуют исходные случайные величины. Формально, пусть будут независимыми случайными величинами со средним значением и дисперсией Тогда последовательность случайных величин

сходится по распределению к стандартной нормальной случайной величине.

Для некоторых классов случайных величин классическая центральная предельная теорема работает довольно быстро, как показано в теореме Берри–Эссеена . Например, распределения с конечным первым, вторым и третьим моментом из экспоненциального семейства ; с другой стороны, для некоторых случайных величин с тяжелым и толстым хвостом она работает очень медленно или может не работать вообще: в таких случаях можно использовать обобщенную центральную предельную теорему (GCLT).