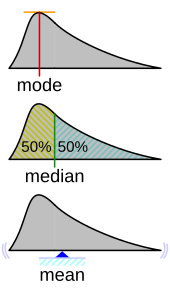

Медиана набора чисел — это значение, разделяющее верхнюю половину от нижней половины выборки данных , совокупности или распределения вероятностей . Для набора данных ее можно рассматривать как «среднее» значение. Основная особенность медианы при описании данных по сравнению со средним значением ( часто просто описываемым как «среднее») заключается в том, что она не искажена небольшой долей чрезвычайно больших или малых значений и, следовательно, обеспечивает лучшее представление центра. Например, медианный доход может быть лучшим способом описания центра распределения доходов, поскольку увеличение самых больших доходов само по себе не оказывает влияния на медиану. По этой причине медиана имеет центральное значение в надежной статистике .

Медиана конечного списка чисел — это «среднее» число, если эти числа перечислены в порядке от наименьшего к наибольшему.

Если набор данных имеет нечетное количество наблюдений, выбирается среднее (после упорядочивания по возрастанию). Например, следующий список из семи чисел,

имеет медиану 6 , что является четвертым значением.

Если набор данных содержит четное количество наблюдений, то четкого среднего значения не существует, и медиана обычно определяется как среднее арифметическое двух средних значений. [1] [2] Например, этот набор данных из 8 чисел

имеет медианное значение 4,5 , то есть . (Выражаясь более техническими терминами, это интерпретирует медиану как полностью урезанный средний диапазон ).

В общем случае, следуя этому соглашению, медиану можно определить следующим образом: для набора данных элементов , упорядоченных от наименьшего к наибольшему,

Формально медиана популяции — это любое значение, при котором по крайней мере половина популяции меньше или равна предложенной медиане и по крайней мере половина больше или равна предложенной медиане. Как показано выше, медианы могут быть не уникальными. Если каждый набор содержит более половины популяции, то некоторая часть популяции точно равна уникальной медиане.

Медиана четко определена для любых упорядоченных (одномерных) данных и не зависит от какой-либо метрики расстояния . Таким образом, медиану можно применять к школьным классам, которые ранжированы, но не числовые (например, вычисляя медианную оценку, когда результаты тестов учащихся ранжируются от F до A), хотя результат может быть посередине между классами, если есть четное количество классов. (Для нечетного количества классов один конкретный класс определяется как медиана.)

С другой стороны, геометрическая медиана определяется в любом количестве измерений. Связанная концепция, в которой результат принудительно соответствует члену выборки, — это медоид .

Не существует общепринятого стандартного обозначения для медианы, но некоторые авторы представляют медиану переменной x как med( x ), x͂ , [3] как μ 1/2 , [1] или как M . [3] [4] В любом из этих случаев использование этих или других символов для медианы должно быть явно определено при их введении.

Медиана — это частный случай других способов обобщения типичных значений, связанных со статистическим распределением : это 2-й квартиль , 5-й дециль и 50-й процентиль .

Медиану можно использовать в качестве меры местоположения , когда экстремальным значениям придается меньшее значение, как правило, из-за того, что распределение неравномерно , экстремальные значения неизвестны или выбросы не заслуживают доверия, т. е. могут быть ошибками измерения или транскрипции.

Например, рассмотрим мультимножество

Медиана в этом случае равна 2, как и мода , и ее можно рассматривать как лучшее указание на центр, чем среднее арифметическое 4, которое больше всех значений, кроме одного. Однако широко цитируемое эмпирическое соотношение, согласно которому среднее смещено «дальше в хвост» распределения, чем медиана, в целом неверно. Самое большее, можно сказать, что две статистики не могут быть «слишком далеки» друг от друга; см. § Неравенство, связывающее средние и медианы ниже. [5]

Поскольку медиана основана на средних данных в наборе, для ее вычисления не обязательно знать значение крайних результатов. Например, в психологическом тесте, исследующем время, необходимое для решения задачи, если небольшое количество людей вообще не смогли решить задачу за заданное время, медиану все равно можно вычислить. [6]

Поскольку медиана проста для понимания и расчета, а также является надежным приближением к среднему значению , медиана является популярной сводной статистикой в описательной статистике . В этом контексте существует несколько вариантов для измерения изменчивости : размах , межквартильный размах , среднее абсолютное отклонение и медианное абсолютное отклонение .

Для практических целей различные меры местоположения и дисперсии часто сравниваются на основе того, насколько хорошо соответствующие значения популяции могут быть оценены из выборки данных. Медиана, оцененная с использованием выборочной медианы, имеет хорошие свойства в этом отношении. Хотя она обычно не оптимальна, если предполагается заданное распределение популяции, ее свойства всегда достаточно хороши. Например, сравнение эффективности кандидатов на оценку показывает, что выборочное среднее более эффективно статистически, когда — и только когда — данные не загрязнены данными из распределений с тяжелыми хвостами или из смесей распределений. [ необходима цитата ] Даже в этом случае медиана имеет 64% эффективность по сравнению со средним с минимальной дисперсией (для больших нормальных выборок), то есть дисперсия медианы будет примерно на 50% больше, чем дисперсия среднего. [7] [8]

Для любого действительного распределения вероятностей с кумулятивной функцией распределения F медиана определяется как любое действительное число m , которое удовлетворяет неравенствам (ср. рисунок в определении ожидаемого значения для произвольных действительных случайных величин ). Эквивалентная формулировка использует случайную величину X, распределенную в соответствии с F :

Обратите внимание, что это определение не требует, чтобы X имел абсолютно непрерывное распределение (которое имеет функцию плотности вероятности f ), и не требует дискретного распределения . В первом случае неравенства можно улучшить до равенства: медиана удовлетворяет и

Любое распределение вероятностей на множестве действительных чисел имеет по крайней мере одну медиану, но в патологических случаях может быть более одной медианы: если F постоянна 1/2 на интервале (так что f = 0 там), то любое значение этого интервала является медианой.

Медианы некоторых типов распределений можно легко вычислить из их параметров; более того, они существуют даже для некоторых распределений, не имеющих четко определенного среднего значения, таких как распределение Коши :

Средняя абсолютная ошибка действительной величины c относительно случайной величины X равна

При условии, что распределение вероятностей X таково, что указанное выше ожидание существует, то m является медианой X тогда и только тогда, когда m является минимизатором средней абсолютной ошибки относительно X. [11] В частности, если m является выборочной медианой, то она минимизирует среднее арифметическое абсолютных отклонений. [12] Однако следует отметить, что в случаях , когда выборка содержит четное число элементов, этот минимизатор не является уникальным.

В более общем смысле медиана определяется как минимум

как обсуждается ниже в разделе о многомерных медианах (в частности, о пространственной медиане ).

Такое определение медианы, основанное на оптимизации, полезно в статистическом анализе данных, например, при кластеризации k -медиан .

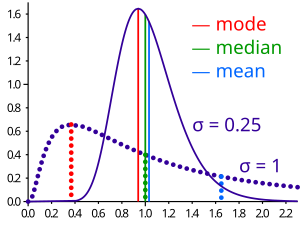

Если распределение имеет конечную дисперсию, то расстояние между медианой и средним значением ограничено одним стандартным отклонением .

Эта граница была доказана Буком и Шером в 1979 году для дискретных выборок, [13] и в более общем плане Пейджем и Мёрти в 1982 году. [14] В комментарии к последующему доказательству О'Синнеида, [15] Маллоуз в 1991 году представил компактное доказательство, которое использует неравенство Йенсена дважды, [16] следующим образом. Используя |·| для абсолютного значения , мы имеем

Первое и третье неравенства вытекают из неравенства Йенсена, примененного к функции абсолютного значения и квадратной функции, которые являются выпуклыми. Второе неравенство вытекает из того факта, что медиана минимизирует функцию абсолютного отклонения .

Доказательство Маллоуза можно обобщить, чтобы получить многомерную версию неравенства [17], просто заменив абсолютное значение нормой :

где m — пространственная медиана , то есть минимизатор функции. Пространственная медиана уникальна, когда размерность набора данных равна двум или более. [18] [19]

Альтернативное доказательство использует одностороннее неравенство Чебышева; оно появляется в неравенстве относительно параметров местоположения и масштаба . Эта формула также напрямую следует из неравенства Кантелли . [20]

В случае унимодальных распределений можно получить более точную границу расстояния между медианой и средним значением:

Аналогичное соотношение существует между медианой и модой:

Типичная эвристика заключается в том, что положительно скошенные распределения имеют среднее значение > медианы. Это верно для всех членов семейства распределений Пирсона . Однако это не всегда верно. Например, семейство распределений Вейбулла имеет члены с положительным средним значением, но средним значением < медианы. Нарушения правила особенно распространены для дискретных распределений. Например, любое распределение Пуассона имеет положительный перекос, но его среднее значение < медианы всякий раз, когда . [22] См. [23] для наброска доказательства.

Когда распределение имеет монотонно убывающую плотность вероятности, то медиана меньше среднего значения, как показано на рисунке.

Неравенство Йенсена утверждает, что для любой случайной величины X с конечным математическим ожиданием E [ X ] и для любой выпуклой функции f

Это неравенство распространяется и на медиану. Мы говорим, что функция f : R → R является функцией C , если для любого t

является замкнутым интервалом (допускающим вырожденные случаи одной точки или пустого множества ). Каждая выпуклая функция является функцией C, но обратное не выполняется. Если f является функцией C, то

Если медианы не являются уникальными, утверждение справедливо для соответствующих супремумов. [24]

Хотя сравнение-сортировка n элементов требует Ω ( n log n ) операций, алгоритмы выбора могут вычислить k -й наименьший из n элементов всего за Θ( n ) операций. Это включает медиану, которая является н/2 Статистика го порядка (или для четного числа выборок среднее арифметическое двух статистик среднего порядка). [25]

Алгоритмы выбора все еще имеют недостаток, требующий Ω( n ) памяти, то есть им необходимо иметь в памяти полную выборку (или ее линейную часть). Поскольку это, а также требование линейного времени, может быть непомерно, было разработано несколько процедур оценки для медианы. Простая из них — это правило медианы трех, которое оценивает медиану как медиану трехэлементной подвыборки; это обычно используется в качестве подпрограммы в алгоритме сортировки быстрой сортировки , который использует оценку медианы своего входа. Более надежной оценкой является девятый Тьюки , который является правилом медианы трех, применяемым с ограниченной рекурсией: [26] если A — выборка, представленная в виде массива , и

затем

Медиана — это оценка медианы, которая требует линейного времени, но сублинейной памяти, работающая за один проход по выборке. [27]

Распределения как выборочного среднего, так и выборочной медианы были определены Лапласом . [28] Распределение выборочной медианы из популяции с функцией плотности является асимптотически нормальным со средним и дисперсией [29]

где — медиана , а — размер выборки:

Ниже приведено современное доказательство. Результат Лапласа теперь понимается как частный случай асимптотического распределения произвольных квантилей .

Для нормальных выборок плотность равна , поэтому для больших выборок дисперсия медианы равна [7] (См. также раздел #Эффективность ниже.)

Мы принимаем размер выборки за нечетное число и предполагаем, что наша переменная непрерывна; формула для случая дискретных переменных приведена ниже в § Эмпирическая локальная плотность. Выборку можно обобщить как «ниже медианы», «на уровне медианы» и «выше медианы», что соответствует триномиальному распределению с вероятностями , и . Для непрерывной переменной вероятность того, что несколько значений выборки будут точно равны медиане, равна 0, поэтому можно вычислить плотность в точке непосредственно из триномиального распределения:

Теперь введем бета-функцию. Для целочисленных аргументов и это можно выразить как . Также напомним, что . Использование этих отношений и установка и равными позволяет записать последнее выражение как

Следовательно, функция плотности медианы представляет собой симметричное бета-распределение, сдвинутое вперед на . Его среднее значение, как и следовало ожидать, равно 0,5, а его дисперсия равна . По правилу цепи соответствующая дисперсия медианы выборки равна

Дополнительные 2 в пределе незначительны .

На практике функции и выше часто неизвестны или не предполагаются. Однако их можно оценить из наблюдаемого распределения частот. В этом разделе мы приводим пример. Рассмотрим следующую таблицу, представляющую выборку из 3800 (дискретнозначных) наблюдений:

Поскольку наблюдения являются дискретно-значными, построение точного распределения медианы не является непосредственным переводом приведенного выше выражения для ; можно (и обычно бывает) иметь несколько экземпляров медианы в выборке. Поэтому мы должны суммировать по всем этим возможностям:

Здесь i — число точек, строго меньших медианы, а k — число, строго большее медианы.

Используя эти предварительные данные, можно исследовать влияние размера выборки на стандартные ошибки среднего и медианы. Наблюдаемое среднее значение равно 3,16, наблюдаемая сырая медиана равна 3, а наблюдаемая интерполированная медиана равна 3,174. В следующей таблице приведены некоторые сравнительные статистики.

Ожидаемое значение медианы немного падает с увеличением размера выборки, в то время как, как и ожидалось, стандартные ошибки как медианы, так и среднего значения пропорциональны обратному квадратному корню размера выборки. Асимптотическое приближение ошибается в сторону осторожности, переоценивая стандартную ошибку.

Значение — асимптотическое значение , где — медиана популяции, — изучалось несколькими авторами. Стандартный метод складного ножа «удалить один» дает противоречивые результаты. [30] Альтернативный метод — метод «удалить k», где растет с размером выборки, как было показано, является асимптотически последовательным. [31] Этот метод может быть вычислительно затратным для больших наборов данных. Известно, что оценка бутстрапа является последовательной, [32] но сходится очень медленно ( порядок ). [33] Были предложены и другие методы, но их поведение может отличаться для больших и малых выборок. [34]

Эффективность выборочной медианы, измеряемая как отношение дисперсии среднего к дисперсии медианы, зависит от размера выборки и от базового распределения популяции. Для выборки размером из нормального распределения эффективность для больших N равна

Эффективность стремится к бесконечности.

Другими словами, относительная дисперсия медианы будет , или на 57% больше, чем дисперсия среднего значения – относительная стандартная ошибка медианы будет , или на 25% больше, чем стандартная ошибка среднего значения ( см. также раздел #Выборочное распределение выше.). [35]

Для одномерных распределений, симметричных относительно одной медианы, оценщик Ходжеса-Лемана является надежным и высокоэффективным оценщиком медианы популяции. [36]

Если данные представлены статистической моделью, определяющей определенное семейство распределений вероятностей , то оценки медианы могут быть получены путем подгонки этого семейства распределений вероятностей к данным и вычисления теоретической медианы подогнанного распределения. Интерполяция Парето является применением этого, когда предполагается, что популяция имеет распределение Парето .

Ранее в этой статье обсуждалась одномерная медиана, когда выборка или совокупность имели одно измерение. Когда измерение равно двум или больше, существует несколько концепций, которые расширяют определение одномерной медианы; каждая такая многомерная медиана согласуется с одномерной медианой, когда измерение равно точно одному. [36] [37] [38] [39]

Маргинальная медиана определяется для векторов, определенных относительно фиксированного набора координат. Маргинальная медиана определяется как вектор, компоненты которого являются одномерными медианами. Маргинальную медиану легко вычислить, и ее свойства были изучены Пури и Сеном. [36] [40]

Геометрическая медиана дискретного набора точек выборки в евклидовом пространстве — это точка [a] , минимизирующая сумму расстояний до точек выборки.

В отличие от маргинальной медианы, геометрическая медиана эквивариантна относительно евклидовых преобразований подобия, таких как переносы и вращения .

Если маргинальные медианы для всех систем координат совпадают, то их общее местоположение можно назвать «медианой во всех направлениях». [42] Эта концепция имеет отношение к теории голосования в силу теоремы о медианном избирателе . Когда она существует, медиана во всех направлениях совпадает с геометрической медианой (по крайней мере, для дискретных распределений).

Условная медиана возникает в ситуации, когда мы пытаемся оценить случайную величину из случайной величины , которая является шумовой версией . Условная медиана в этой ситуации задается как

где — обратная функция условного cdf (т.е. условная квантильная функция) . Например, популярная модель — это где — стандартное нормальное распределение, независимое от . Условная медиана — это оптимальная байесовская оценка:

Известно, что для модели , где является стандартным нормальным и не зависит от , оценка является линейной тогда и только тогда, когда является гауссовой. [43]

При работе с дискретной переменной иногда полезно рассматривать наблюдаемые значения как средние точки непрерывных интервалов. Примером этого является шкала Лайкерта , на которой мнения или предпочтения выражаются на шкале с заданным числом возможных ответов. Если шкала состоит из положительных целых чисел, наблюдение 3 можно рассматривать как представляющее интервал от 2,50 до 3,50. Можно оценить медиану базовой переменной. Если, скажем, 22% наблюдений имеют значение 2 или ниже, а 55,0% имеют значение 3 или ниже (то есть 33% имеют значение 3), то медиана равна 3, поскольку медиана является наименьшим значением для которого больше половины. Но интерполированная медиана находится где-то между 2,50 и 3,50. Сначала мы прибавляем половину ширины интервала к медиане, чтобы получить верхнюю границу интервала медианы. Затем мы вычитаем ту часть ширины интервала, которая равна доле 33%, которая лежит выше отметки 50%. Другими словами, мы делим ширину интервала пропорционально количеству наблюдений. В этом случае 33% делятся на 28% ниже медианы и 5% выше нее, поэтому мы вычитаем 5/33 ширины интервала из верхней границы 3,50, чтобы получить интерполированную медиану 3,35. Более формально, если значения известны, интерполированную медиану можно вычислить из

В качестве альтернативы, если в наблюдаемой выборке есть баллы выше медианной категории, баллы в ней и баллы ниже нее, то интерполированная медиана вычисляется по формуле

Для одномерных распределений, симметричных относительно одной медианы, оценщик Ходжеса-Лемана является надежной и высокоэффективной оценкой медианы популяции; для несимметричных распределений оценщик Ходжеса-Лемана является надежной и высокоэффективной оценкой псевдомедианы популяции , которая является медианой симметризованного распределения и которая близка к медиане популяции. [44] Оценщик Ходжеса-Лемана был обобщен на многомерные распределения. [45]

Оценка Тейла –Сена представляет собой метод надежной линейной регрессии, основанный на нахождении медиан наклонов . [46]

Медианный фильтр — важный инструмент обработки изображений , который позволяет эффективно удалять любые шумы типа «соль и перец» с изображений в оттенках серого .

В кластерном анализе алгоритм кластеризации k-медиан обеспечивает способ определения кластеров, в котором критерий максимизации расстояния между средними кластерами, используемый в кластеризации k-средних , заменяется критерием максимизации расстояния между медианами кластеров.

Это метод надежной регрессии. Идея восходит к Уолду в 1940 году, который предложил разделить набор двумерных данных на две половины в зависимости от значения независимого параметра : левую половину со значениями меньше медианы и правую половину со значениями больше медианы. [47] Он предложил взять средние значения зависимых и независимых переменных левой и правой половин и оценить наклон линии, соединяющей эти две точки. Затем линию можно было скорректировать, чтобы она соответствовала большинству точек в наборе данных.

Наир и Шривастава в 1942 году предложили похожую идею, но вместо этого рекомендовали разделить выборку на три равные части перед вычислением средних значений подвыборок. [48] Браун и Муд в 1951 году предложили идею использования медиан двух подвыборок вместо средних значений. [49] Тьюки объединил эти идеи и рекомендовал разделить выборку на три подвыборки равного размера и оценить линию на основе медиан подвыборок. [50]

Любая оценка без смещения среднего минимизирует риск ( ожидаемые потери ) относительно функции потерь квадрата ошибки , как заметил Гаусс . Оценка без смещения среднего минимизирует риск относительно функции потерь абсолютного отклонения , как заметил Лаплас . Другие функции потерь используются в статистической теории , особенно в надежной статистике .

Теория медианно-несмещенных оценок была возрождена Джорджем Брауном в 1947 году: [51]

Оценка одномерного параметра θ будет называться медианно-несмещенной, если при фиксированном θ медиана распределения оценки равна значению θ; т. е. оценка недооценивает так же часто, как и переоценивает. Это требование, по-видимому, для большинства целей достигает того же, что и требование среднего-несмещенного, и имеет дополнительное свойство, заключающееся в том, что оно инвариантно относительно преобразования один к одному.

— страница 584

Были описаны дополнительные свойства медианно-несмещенных оценок. [52] [53] [54] [55]

Существуют методы построения медианно-несмещенных оценок, которые являются оптимальными (в некотором смысле, аналогично свойству минимальной дисперсии для средне-несмещенных оценок). Такие конструкции существуют для распределений вероятностей, имеющих монотонные функции правдоподобия . [56] [57] Одна из таких процедур является аналогом процедуры Рао-Блэквелла для средне-несмещенных оценок: процедура справедлива для меньшего класса распределений вероятностей, чем процедура Рао-Блэквелла, но для большего класса функций потерь . [58]

Научные исследователи на древнем Ближнем Востоке, по-видимому, не использовали сводную статистику вообще, вместо этого выбирая значения, которые обеспечивали максимальную согласованность с более широкой теорией, которая интегрировала широкий спектр явлений. [59] В средиземноморском (а позднее и европейском) научном сообществе такие статистические данные, как среднее значение, по сути, являются развитием Средневековья и раннего Нового времени. (История медианы за пределами Европы и ее предшественников остается относительно неизученной.)

Идея медианы появилась в VI веке в Талмуде , чтобы справедливо проанализировать расходящиеся оценки . [60] [61] Однако эта концепция не получила распространения в широком научном сообществе.

Вместо этого ближайшим предком современной медианы является средний диапазон , изобретенный Аль-Бируни [62] : 31 [63] Передача его работы более поздним ученым неясна. Он применил свою технику для анализа валютных металлов, но после того, как он опубликовал свою работу, большинство пробирщиков по-прежнему принимали самое неблагоприятное значение из своих результатов, чтобы не показаться обманщиками . [ 62 ] : 35–8 [64] Однако рост навигации в море в эпоху Великих географических открытий означал, что штурманам все чаще приходилось пытаться определять широту в неблагоприятных погодных условиях по отношению к враждебным берегам, что привело к возобновлению интереса к сводной статистике. Независимо от того, был ли он заново открыт или изобретен независимо, средний диапазон рекомендуется мореплавателям в «Инструкциях для путешествия Рэли в Гвиану, 1595» Харриота. [62] : 45–8

Идея медианы, возможно, впервые появилась в книге Эдварда Райта 1599 года Certaine Errors in Navigation в разделе о навигации по компасу . [65] Райт не хотел отбрасывать измеренные значения и, возможно, считал, что медиана — включающая большую долю набора данных, чем средний диапазон — с большей вероятностью будет правильной. Однако Райт не привел примеров использования своей техники, что затрудняет проверку того, что он описал современное понятие медианы. [59] [63] [b] Медиана (в контексте вероятности) определенно появилась в переписке Христиана Гюйгенса , но как пример статистики, которая была неподходящей для актуарной практики . [59]

Самая ранняя рекомендация медианы датируется 1757 годом, когда Роджер Джозеф Боскович разработал метод регрессии, основанный на норме L 1 и, следовательно, неявно на медиане. [59] [66] В 1774 году Лаплас явно выразил это желание: он предложил использовать медиану в качестве стандартной оценки значения апостериорной PDF . Конкретным критерием была минимизация ожидаемой величины ошибки; где — оценка, а — истинное значение. С этой целью Лаплас определил распределения как выборочного среднего, так и выборочной медианы в начале 1800-х годов. [28] [67] Однако десятилетие спустя Гаусс и Лежандр разработали метод наименьших квадратов , который минимизирует для получения среднего; сильное обоснование этой оценки ссылкой на оценку максимального правдоподобия, основанную на нормальном распределении, означает, что она в основном заменила первоначальное предложение Лапласа. [68]

Антуан Огюстен Курно в 1843 году был первым [69] , кто использовал термин медиана ( valeur médiane ) для значения, которое делит распределение вероятностей на две равные половины. Густав Теодор Фехнер использовал медиану ( Centralwerth ) в социологических и психологических явлениях. [70] Ранее она использовалась только в астрономии и смежных областях. Густав Фехнер популяризировал медиану в формальном анализе данных, хотя ранее ее использовал Лаплас, [70] а медиана появилась в учебнике Ф. И. Эджворта . [71] Фрэнсис Гальтон использовал термин медиана в 1881 году, [72] [73] ранее использовав термины middle-most value в 1869 году и medium в 1880 году. [74] [75]

{{cite journal}}: CS1 maint: DOI inactive as of September 2024 (link)В данной статье использованы материалы из Median, размещенные на PlanetMath и лицензированные по лицензии Creative Commons Attribution/Share-Alike License .