Поисковая система — это программная система , которая находит веб-страницы, соответствующие запросу веб-поиска . [1] Он осуществляет систематический поиск во Всемирной паутине конкретной информации, указанной в текстовом поисковом запросе . Результаты поиска обычно представляются в виде строки результатов, часто называемой страницами результатов поисковой системы (SERP). Информация может представлять собой сочетание гиперссылок на веб - страницы , изображения, видео, инфографику , статьи и другие типы файлов. По состоянию на январь 2022 года Google является самой используемой поисковой системой в мире с долей рынка 90,6%, а другими наиболее часто используемыми поисковыми системами в мире были Bing , Yahoo! , Baidu , Яндекс и DuckDuckGo . [2][обновлять]

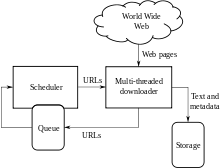

В отличие от веб-каталогов и сайтов социальных закладок , которые обслуживаются редакторами-людьми, поисковые системы также сохраняют информацию в режиме реального времени , запуская алгоритм на веб-сканере . Современные поисковые системы основаны на приемах и методах, разработанных в области поиска информации . Некоторые поисковые системы также анализируют данные , доступные в базах данных или открытых каталогах.

Интернет-контент, который не может быть проиндексирован и найден с помощью поисковой системы, подпадает под категорию глубокой сети .

Система поиска опубликованной информации, призванная преодолеть постоянно возрастающую трудность поиска информации в постоянно растущих централизованных указателях научной работы, была описана в 1945 году Ванневаром Бушем , написавшим в The Atlantic Monthly статью под названием « Как мы можем думать » [ 3] , в котором он представлял себе библиотеки исследований со связанными аннотациями, мало чем отличающимися от современных гиперссылок . [4] Анализ ссылок в конечном итоге стал важнейшим компонентом поисковых систем благодаря таким алгоритмам, как гиперпоиск и PageRank . [5] [6]

Первые поисковые системы Интернета появились еще до появления Интернета в декабре 1990 года: поиск пользователей WHOIS восходит к 1982 году, [7] а многосетевой поиск пользователей Knowbot Information Service был впервые реализован в 1989 году . [8] Первый хорошо документированный поиск. Механизмом поиска файлов содержимого, а именно файлов FTP , был Archie , который дебютировал 10 сентября 1990 года. [9]

До сентября 1993 года Всемирная паутина полностью индексировалась вручную. Был список веб-серверов , отредактированный Тимом Бернерсом-Ли и размещенный на веб-сервере ЦЕРН . Сохранился один снимок списка 1992 года, [10] но по мере того, как все больше и больше веб-серверов подключалось к сети, центральный список больше не успевал за ним. На сайте NCSA анонсированы новые сервера под заголовком «Что нового!». [11]

Первым инструментом, который использовался для поиска контента (в отличие от пользователей) в Интернете , был Archie . [12] Название означает «архив» без буквы «v». [13] Он был создан Аланом Эмтажем , [13] [14] [15] [16] студентом информатики Университета Макгилла в Монреале, Квебек , Канада. Программа загружала списки каталогов всех файлов, расположенных на общедоступных анонимных FTP-сайтах ( протокол передачи файлов ), создавая базу данных имен файлов с возможностью поиска; однако поисковая система Archie не индексировала содержимое этих сайтов, поскольку объем данных был настолько ограничен, что их можно было легко найти вручную.

Расцвет Gopher (созданный в 1991 году Марком МакКахиллом в Университете Миннесоты ) привел к появлению двух новых поисковых программ, Veronica и Jughead . Как и Арчи, они искали имена и заголовки файлов, хранящиеся в индексных системах Gopher. Veronica (Очень простой сетевой индекс компьютеризированных архивов, ориентированный на грызунов) обеспечила поиск по ключевым словам большинства заголовков меню Gopher во всех списках Gopher. Jughead (Jonzy's Universal Gopher Hierarchy Excavation And Display) был инструментом для получения информации меню с определенных серверов Gopher. Хотя название поисковой системы « Поисковая система Арчи » не было отсылкой к серии комиксов Арчи , « Вероника » и « Джагхед » являются персонажами серии, что является отсылкой к своему предшественнику.

Летом 1993 года в Интернете не существовало поисковой системы, хотя многочисленные специализированные каталоги велись вручную. Оскар Ниерстраз из Женевского университета написал серию скриптов Perl , которые периодически зеркально отображали эти страницы и переписывали их в стандартный формат. Это легло в основу W3Catalog , первой примитивной поисковой системы в сети, выпущенной 2 сентября 1993 года .

В июне 1993 года Мэтью Грей, работавший тогда в Массачусетском технологическом институте , создал, вероятно, первого веб-робота , основанного на Perl World Wide Web Wanderer , и использовал его для создания индекса под названием «Wandex». Целью Wanderer было измерение размера Всемирной паутины, что он и делал до конца 1995 года. Вторая поисковая система Aliweb появилась в ноябре 1993 года. Aliweb не использовал веб-робота , а вместо этого зависел от получения уведомлений от веб-сайта . администраторам наличие на каждом сайте индексного файла в определенном формате.

JumpStation (созданная в декабре 1993 года [18] Джонатоном Флетчером ) использовала веб-робота для поиска веб-страниц и построения индекса, а также использовала веб-форму в качестве интерфейса для своей программы запросов. Таким образом, это был первый инструмент обнаружения ресурсов WWW , сочетающий в себе три основные функции поисковой системы в Интернете (сканирование, индексирование и поиск), как описано ниже. Из-за ограниченности ресурсов, доступных на платформе, на которой он работал, его индексирование и, следовательно, поиск были ограничены заголовками и заголовками, найденными на веб-страницах, с которыми сталкивался сканер.

Одной из первых поисковых систем, основанных на «полностью текстовом» сканере, была WebCrawler , появившаяся в 1994 году. В отличие от своих предшественников, она позволяла пользователям искать любое слово на любой веб-странице, что с тех пор стало стандартом для всех основных поисковых систем. Это была также поисковая система, которая была широко известна публике. Кроме того, в 1994 году была запущена компания Lycos (основанная в Университете Карнеги-Меллона ), которая стала крупным коммерческим предприятием.

Первой популярной поисковой системой в Интернете была Yahoo! Поиск . [19] Первый продукт Yahoo! , основанный Джерри Янгом и Дэвидом Фило в январе 1994 года, представлял собой веб -каталог Yahoo! Каталог . В 1995 году была добавлена функция поиска, позволяющая пользователям искать Yahoo! Каталог. [20] [21] Он стал одним из самых популярных способов поиска интересующих веб-страниц, но его функция поиска работала в веб-каталоге, а не в полнотекстовых копиях веб-страниц.

Вскоре после этого появилось несколько поисковых систем, которые соперничали за популярность. В их число входили Magellan , Excite , Infoseek , Inktomi , Northern Light и AltaVista . Лица, ищущие информацию, также могут просматривать каталог вместо поиска по ключевым словам.

В 1996 году Робин Ли разработал алгоритм оценки сайта RankDex для ранжирования страниц в результатах поисковых систем [22] [23] [24] и получил патент США на эту технологию. [25] Это была первая поисковая система, которая использовала гиперссылки для измерения качества индексируемых ею веб-сайтов, [26] еще до получения очень похожего патента на алгоритм, поданного Google два года спустя, в 1998 году. [27] Ларри Пейдж ссылался на работу Ли в некоторых его американских патентов на PageRank. [28] Позже Ли использовал свою технологию Rankdex для поисковой системы Baidu , которая была основана им в Китае и запущена в 2000 году.

В 1996 году Netscape стремилась предоставить единственной поисковой системе эксклюзивную сделку в качестве основной поисковой системы в веб-браузере Netscape. Интерес был настолько велик, что вместо этого Netscape заключила сделки с пятью основными поисковыми системами: за 5 миллионов долларов в год каждая поисковая система будет поочередно отображаться на странице поисковой системы Netscape. Пятью платформами были Yahoo!, Magellan, Lycos, Infoseek и Excite. [29] [30]

Google перенял идею продажи поисковых запросов в 1998 году у небольшой поисковой компании goto.com . Этот шаг оказал существенное влияние на бизнес поисковых систем, который превратился из испытывающего трудности в один из самых прибыльных бизнесов в Интернете. [ нужна цитата ]

Поисковые системы также были известны как одни из самых ярких звезд интернет-инвестиционного безумия, произошедшего в конце 1990-х годов. [31] Несколько компаний эффектно вышли на рынок, получив рекордную прибыль во время своих первичных публичных размещений акций . Некоторые из них закрыли свою общедоступную поисковую систему и продают только корпоративные издания, такие как Northern Light. Многие компании, занимающиеся поисковыми системами, попали в пузырь доткомов — рыночный бум, вызванный спекуляциями, достигший пика в марте 2000 года.

Примерно в 2000 году поисковая система Google приобрела известность. [32] Компания добилась лучших результатов для многих поисковых запросов с помощью алгоритма под названием PageRank , как было объяснено в статье «Анатомия поисковой системы», написанной Сергеем Брином и Ларри Пейджем , более поздними основателями Google. [6] Этот итерационный алгоритм ранжирует веб-страницы на основе количества и PageRank других веб-сайтов и страниц, ссылающихся на них, исходя из того, что на хорошие или желательные страницы ссылается больше, чем на другие. В патенте Ларри Пейджа на PageRank упоминается, что на него оказал влияние более ранний патент Робина Ли на RankDex . [28] [24] Google также сохранил минималистичный интерфейс своей поисковой системы. Напротив, многие из ее конкурентов встроили поисковую систему в веб-портал . Фактически, поисковая система Google стала настолько популярной, что появились поддельные системы, такие как Mystery Seeker .

К 2000 году Yahoo! предоставляла поисковые услуги на основе поисковой системы Inktomi. Yahoo! приобрела Inktomi в 2002 году и Overture (которая владела AlltheWeb и AltaVista) в 2003 году. Yahoo! перешла на поисковую систему Google до 2004 года, когда она запустила собственную поисковую систему, основанную на объединении технологий своих приобретений.

Microsoft впервые запустила MSN Search осенью 1998 года, используя результаты поиска Inktomi. В начале 1999 года на сайте начали отображаться списки Looksmart , смешанные с результатами Inktomi. В течение короткого времени в 1999 году MSN Search вместо этого использовал результаты AltaVista. В 2004 году Microsoft начала переход на собственную технологию поиска, основанную на собственном веб-сканере (называемом msnbot ).

Поисковая система Microsoft с ребрендингом Bing была запущена 1 июня 2009 г. 29 июля 2009 г. Yahoo! и Microsoft заключили сделку, по которой Yahoo! Поиск будет осуществляться с помощью технологии Microsoft Bing.

По состоянию на 2019 год [обновлять]в число активных сканеров поисковых систем входят Google, Sogou , Baidu, Bing, Gigablast , Mojeek , DuckDuckGo и Yandex .

Поисковая система поддерживает следующие процессы практически в реальном времени:

Поисковые системы получают информацию путем сканирования с сайта на сайт. «Паук» проверяет стандартное имя файла robots.txt , адресованное ему. Файл robots.txt содержит директивы для поисковых роботов, указывающие, какие страницы сканировать, а какие нет. После проверки файла robots.txt и обнаружения его или нет, паук отправляет определенную информацию обратно для индексации в зависимости от многих факторов, таких как заголовки, содержимое страницы, JavaScript , каскадные таблицы стилей (CSS), заголовки или метаданные в файле. Метатеги HTML . После определенного количества просканированных страниц, объема проиндексированных данных или времени, проведенного на веб-сайте, паук перестает сканировать и движется дальше. «[Ни один веб-сканер не может фактически сканировать всю доступную сеть. Из-за бесконечного количества веб-сайтов, ловушек для пауков, спама и других потребностей реальной сети сканеры вместо этого применяют политику сканирования, чтобы определить, когда сканирование сайта следует считать достаточно. Некоторые веб-сайты сканируются полностью, в то время как другие сканируются лишь частично». [34]

Индексирование означает связывание слов и других определяемых токенов, найденных на веб-страницах, с их доменными именами и полями на основе HTML . Ассоциации заносятся в общедоступную базу данных, доступную для поисковых запросов в Интернете. Запрос пользователя может состоять из одного слова, нескольких слов или предложения. Индекс помогает максимально быстро найти информацию, относящуюся к запросу. [33] Некоторые методы индексирования и кэширования являются коммерческой тайной, тогда как сканирование веб-страниц представляет собой простой процесс систематического посещения всех сайтов.

Между посещениями паука кэшированная версия страницы (некоторая часть или весь контент, необходимый для ее отображения), хранящаяся в рабочей памяти поисковой системы, быстро отправляется запрашивающему . Если посещение просрочено, поисковая система может вместо этого выступать в качестве веб-прокси . В этом случае страница может отличаться от проиндексированных поисковых запросов. [33] Кэшированная страница сохраняет внешний вид версии, слова которой были ранее проиндексированы, поэтому кешированная версия страницы может быть полезна веб-сайту, когда фактическая страница была потеряна, но эта проблема также считается легкой формой линкрота . .

Обычно, когда пользователь вводит запрос в поисковую систему, это несколько ключевых слов . [35] В индексе уже есть названия сайтов, содержащие ключевые слова, и они мгновенно извлекаются из индекса. Реальная нагрузка на обработку заключается в создании веб-страниц, которые представляют собой список результатов поиска: каждая страница во всем списке должна иметь вес в соответствии с информацией в индексах. [33] Затем для верхнего элемента результатов поиска требуется поиск, реконструкция и разметка фрагментов, показывающих контекст совпадающих ключевых слов. Это лишь часть обработки, которую требует каждая веб-страница с результатами поиска, а дальнейшие страницы (следующие вверху) требуют дополнительной постобработки.

Помимо простого поиска по ключевым словам, поисковые системы предлагают свои собственные операторы с графическим интерфейсом или командами и параметры поиска для уточнения результатов поиска. Они обеспечивают необходимые элементы управления для пользователя, вовлеченного в цикл обратной связи, который пользователи создают путем фильтрации и взвешивания при уточнении результатов поиска, учитывая начальные страницы первых результатов поиска. Например, с 2007 года поисковая система Google.com позволяет фильтровать по дате, щелкнув «Показать инструменты поиска» в крайнем левом столбце начальной страницы результатов поиска, а затем выбрав желаемый диапазон дат. [36] Также возможно взвешивание по дате, поскольку каждая страница имеет время изменения. Большинство поисковых систем поддерживают использование логических операторов И, ИЛИ и НЕ, чтобы помочь конечным пользователям уточнить поисковый запрос . Логические операторы предназначены для буквального поиска, который позволяет пользователю уточнять и расширять условия поиска. Механизм ищет слова или фразы точно так, как они были введены. Некоторые поисковые системы предоставляют расширенную функцию, называемую поиском по близости , которая позволяет пользователям определять расстояние между ключевыми словами. [33] Существует также концептуальный поиск , при котором исследование включает использование статистического анализа страниц, содержащих искомые слова или фразы.

Полезность поисковой системы зависит от релевантности набора результатов, которые она возвращает. Хотя могут существовать миллионы веб-страниц, содержащих определенное слово или фразу, некоторые страницы могут быть более актуальными, популярными или авторитетными, чем другие. Большинство поисковых систем используют методы ранжирования результатов, чтобы в первую очередь предоставить «лучшие» результаты. То, как поисковая система решает, какие страницы наиболее соответствуют друг другу и в каком порядке следует отображать результаты, сильно различается от одной системы к другой. [33] Методы также меняются со временем по мере изменения использования Интернета и развития новых технологий. Существует два основных типа поисковых систем: один представляет собой систему заранее определенных и иерархически упорядоченных ключевых слов, которые люди тщательно запрограммировали. Другая — это система, которая генерирует « инвертированный индекс » путем анализа обнаруженных ею текстов. Эта первая форма в гораздо большей степени зависит от самого компьютера, выполняющего основную часть работы.

Большинство поисковых систем в Интернете являются коммерческими предприятиями, поддерживаемыми доходами от рекламы , и поэтому некоторые из них позволяют рекламодателям за определенную плату повышать рейтинг своих объявлений в результатах поиска. Поисковые системы, которые не принимают деньги за результаты поиска, зарабатывают деньги, размещая рекламу, связанную с поиском, рядом с обычными результатами поисковых систем. Поисковые системы зарабатывают деньги каждый раз, когда кто-то нажимает на одно из этих объявлений. [37]

Локальный поиск — это процесс, который оптимизирует усилия местного бизнеса. Они сосредоточены на изменениях, чтобы обеспечить единообразие всех поисков. Это важно, поскольку многие люди определяют, куда они планируют пойти и что купить, на основе своих поисков. [38]

По состоянию на январь 2022 года Google является самой используемой поисковой системой в мире с долей рынка 90,6%, а другими наиболее часто используемыми поисковыми системами в мире были Bing , Yahoo! , Baidu , Яндекс и DuckDuckGo . [2][обновлять]

В России доля рынка Яндекса составляет 62,6% по сравнению с 28,3% у Google. А Яндекс — вторая по популярности поисковая система на смартфонах в Азии и Европе. [39] В Китае Baidu является самой популярной поисковой системой. [40] Собственный поисковый портал Южной Кореи Naver используется для 62,8% онлайн-поиска в стране. [41] Yahoo! Япония и Yahoo! Тайвань является наиболее популярным местом для поиска в Интернете в Японии и Тайване соответственно. [42] Китай — одна из немногих стран, где Google не входит в тройку крупнейших поисковых систем по доле рынка. Google ранее был ведущей поисковой системой в Китае, но отказался от нее из-за разногласий с правительством по поводу цензуры и кибератаки. Но Bing входит в тройку лучших поисковых систем с долей рынка 14,95%. Baidu лидирует с долей рынка 49,1%. [43]

На рынках большинства стран Европейского Союза доминирует Google, за исключением Чехии , где Seznam является сильным конкурентом. [44]

Поисковая система Qwant базируется в Париже , Франция , откуда она привлекает большую часть своих 50 миллионов ежемесячно зарегистрированных пользователей.

Хотя поисковые системы запрограммированы ранжировать веб-сайты на основе определенного сочетания их популярности и релевантности, эмпирические исследования указывают на различные политические, экономические и социальные предвзятости в предоставляемой ими информации [45] [46] и основных предположениях об этой технологии. [47] Эти предубеждения могут быть прямым результатом экономических и коммерческих процессов (например, компании, которые размещают рекламу в поисковых системах, могут также стать более популярными в результатах обычного поиска ) и политических процессов (например, удаление результатов поиска в целях соблюдения требований). с местным законодательством). [48] Например, Google не будет отображать некоторые неонацистские веб-сайты во Франции и Германии, где отрицание Холокоста является незаконным.

Предвзятости также могут быть результатом социальных процессов, поскольку алгоритмы поисковых систем часто разрабатываются так, чтобы исключать ненормативные точки зрения в пользу более «популярных» результатов. [49] Алгоритмы индексирования основных поисковых систем ориентированы на охват сайтов из США, а не сайтов из стран за пределами США. [46]

Google Bombing — один из примеров попыток манипулировать результатами поиска по политическим, социальным или коммерческим причинам.

Несколько ученых изучали культурные изменения, вызванные поисковыми системами, [50] и представление некоторых спорных тем в их результатах, таких как терроризм в Ирландии , [51] отрицание изменения климата , [52] и теории заговора . [53]

Высказывались опасения, что поисковые системы, такие как Google и Bing, предоставляют персонализированные результаты на основе истории активности пользователя, что приводит к тому, что Эли Паризер в 2011 году назвал «эхо-камерами» или «пузырями фильтров» . [54] Аргумент заключается в том, что поисковые системы и Платформы социальных сетей используют алгоритмы , чтобы выборочно угадывать, какую информацию пользователь хотел бы видеть, на основе информации о пользователе (например, местоположения, поведения прошлых кликов и истории поиска). В результате веб-сайты, как правило, показывают только ту информацию, которая согласуется с прошлой точкой зрения пользователя. По словам Эли Паризера, пользователи меньше подвергаются воздействию противоречивых точек зрения и интеллектуально изолированы в своем собственном информационном пузыре. С тех пор, как эта проблема была выявлена, появились конкурирующие поисковые системы, которые стремятся избежать этой проблемы, не отслеживая и не «всплывая» пользователей, например DuckDuckGo . Однако многие ученые подвергли сомнению точку зрения Паризера, обнаружив, что доказательств существования пузыря фильтров мало. [55] [56] [57] Напротив, ряд исследований, пытающихся проверить существование пузырьков фильтров, обнаружили лишь незначительные уровни персонализации в поиске, [57] что большинство людей сталкиваются с диапазоном мнений при просмотре онлайн-страниц, и что новости Google имеют тенденцию продвигать популярные новостные агентства. [58] [56]

Глобальный рост Интернета и электронных средств массовой информации в арабском и мусульманском мире за последнее десятилетие побудил приверженцев ислама на Ближнем Востоке и на азиатском субконтиненте попытаться создать собственные поисковые системы, собственные поисковые порталы с фильтрацией, которые позволили бы пользователям выполнять безопасный поиск . Эти исламские веб-порталы представляют собой нечто большее, чем обычные безопасные поисковые фильтры. Они классифицируют веб-сайты на « халяльные » и « харамные » на основе интерпретации «Закона ислама» . ImHalal появился в сети в сентябре 2011 года. Halalgoogling появился в сети в июле 2013 года. Они используют харам- фильтры для коллекций Google и Bing (и других). [59]

В то время как отсутствие инвестиций и медленный темп развития технологий в мусульманском мире препятствовали прогрессу и препятствовали успеху исламской поисковой системы, ориентированной в качестве основных потребителей на приверженцев ислама, такие проекты, как Muxlim , сайт о мусульманском образе жизни, действительно получили миллионы долларов от таких инвесторов, как Rite Internet Ventures, и она тоже пошатнулась. Другими религиозными поисковыми системами являются Jewogle, еврейская версия Google, [60] и SeekFind.org, христианская. SeekFind фильтрует сайты, которые нападают на их веру или унижают ее. [61]

Отправка веб-поисковой системы — это процесс, при котором веб-мастер отправляет веб-сайт непосредственно в поисковую систему. Хотя представление в поисковых системах иногда представляется как способ продвижения веб-сайта, обычно в этом нет необходимости, поскольку основные поисковые системы используют веб-сканеры, которые в конечном итоге без посторонней помощи найдут большинство веб-сайтов в Интернете. Они могут отправлять либо одну веб-страницу за раз, либо весь сайт, используя карту сайта , но обычно необходимо отправлять только домашнюю страницу веб-сайта, поскольку поисковые системы могут сканировать хорошо спроектированный веб-сайт. Остаются две причины отправить веб-сайт или веб-страницу в поисковую систему: добавить совершенно новый веб-сайт, не дожидаясь, пока поисковая система его обнаружит, и обновить записи веб-сайта после существенного изменения дизайна.

Некоторые программы для отправки в поисковые системы не только отправляют веб-сайты в несколько поисковых систем, но также добавляют ссылки на веб-сайты со своих собственных страниц. Это может оказаться полезным для повышения рейтинга веб-сайта , поскольку внешние ссылки являются одним из наиболее важных факторов, определяющих рейтинг веб-сайта. Однако Джон Мюллер из Google заявил, что это «может привести к появлению огромного количества неестественных ссылок на вашем сайте», что отрицательно скажется на рейтинге сайта. [62]

По сравнению с поисковыми системами система социальных закладок имеет ряд преимуществ перед традиционным программным обеспечением для автоматического определения местоположения и классификации ресурсов, таким как « пауки » поисковых систем . Вся классификация интернет-ресурсов (например, веб-сайтов) на основе тегов выполняется людьми, которые понимают содержание ресурса, в отличие от программного обеспечения, которое алгоритмически пытается определить значение и качество ресурса. Кроме того, люди могут находить и добавлять в закладки веб-страницы, которые еще не были замечены или проиндексированы веб-пауками. [63] Кроме того, система социальных закладок может ранжировать ресурс на основе того, сколько раз пользователи добавляли его в закладки, что может быть более полезным показателем для конечных пользователей , чем системы, которые ранжируют ресурсы на основе количества внешних ссылок, указывающих на него. это. Однако оба типа ранжирования уязвимы для мошенничества (см. «Игры в систему »), и оба требуют технических мер противодействия этому.

Первой веб-поисковой системой была Archie , созданная в 1990 году [64] Аланом Эмтеджем , студентом Университета Макгилла в Монреале. Автор изначально хотел назвать программу «архивами», но был вынужден сократить ее, чтобы соответствовать мировому стандарту Unix присваивать программам и файлам короткие загадочные имена, такие как grep, cat, troff, sed, awk, perl и т. д. .

Основным методом хранения и получения файлов был протокол передачи файлов (FTP). Это была (и остается) система, которая определяла общий способ обмена файлами между компьютерами через Интернет. Это работает следующим образом: какой-то администратор решает, что он хочет сделать файлы доступными со своего компьютера. Он устанавливает на своем компьютере программу, называемую FTP-сервером. Когда кто-то в Интернете хочет получить файл с этого компьютера, он или она подключается к нему через другую программу, называемую FTP-клиентом. Любая клиентская программа FTP может соединяться с любой программой FTP-сервера, если клиентская и серверная программы полностью соответствуют спецификациям, изложенным в протоколе FTP.

Первоначально любой, кто хотел поделиться файлом, должен был настроить FTP-сервер, чтобы сделать файл доступным для других. Позже «анонимные» FTP-сайты стали хранилищами файлов, что позволило всем пользователям публиковать и получать их.

Даже при наличии архивных сайтов многие важные файлы по-прежнему были разбросаны по небольшим FTP-серверам. Эти файлы можно было найти только с помощью интернет-эквивалента устной речи: кто-то отправлял электронное письмо в список сообщений или на дискуссионный форум, объявляя о доступности файла.

Арчи все изменил. Он объединил сборщик данных на основе сценариев, который получал списки анонимных FTP-файлов на сайтах, со средством сопоставления регулярных выражений для получения имен файлов, соответствующих запросу пользователя. (4) Другими словами, сборщик Арчи просмотрел FTP-сайты в Интернете и проиндексировал все найденные файлы. Его средство сопоставления регулярных выражений предоставило пользователям доступ к своей базе данных. [65]

В 1993 году группа System Computing Services Университета Невады разработала Veronica . [64] Он был создан как поисковое устройство, похожее на «Арчи», но для файлов Gopher. Чуть позже появился еще один поисковый сервис Gopher, под названием Jughead, вероятно, с единственной целью дополнить триумвират комиксов. Джагхед — это аббревиатура от «Раскопки и показы универсальной иерархии сусликов Джонзи», хотя, как и в случае с Вероникой, вероятно, можно с уверенностью предположить, что создатель поддержал эту аббревиатуру. Функциональность Джагхеда была практически идентична функциональности Вероники, хотя по краям она кажется немного более грубой. [65]

World Wide Web Wanderer , разработанный Мэтью Греем в 1993 году [66], был первым роботом в сети и предназначался для отслеживания роста сети. Первоначально Wanderer считал только веб-серверы, но вскоре после своего появления он начал захватывать URL-адреса. База данных захваченных URL-адресов стала Wandex, первой веб-базой данных.

Wanderer Мэтью Грея вызвал в то время немало споров, отчасти потому, что ранние версии программного обеспечения широко распространялись по Сети и вызывали заметное снижение производительности всей сети. Эта деградация произошла потому, что Странник обращался к одной и той же странице сотни раз в день. Вскоре Wanderer изменил свою позицию, но споры о том, приносят ли роботы пользу или вред Интернету, остались.

В ответ на Wanderer Мартейн Костер в октябре 1993 года создал Archie-Like Indexing of the Web, или ALIWEB. Как следует из названия, ALIWEB был HTTP-эквивалентом Archie, и из-за этого он до сих пор уникален во многих отношениях.

У ALIWEB нет робота для поиска в Интернете. Вместо этого веб-мастера участвующих сайтов публикуют собственную индексную информацию для каждой страницы, которую они хотят включить в список. Преимущество этого метода заключается в том, что пользователи могут описывать свой собственный сайт, а робот не бегает, поглощая пропускную способность сети. Недостатки ALIWEB сегодня представляют собой большую проблему. Основным недостатком является необходимость предоставления специального индексного файла. Большинство пользователей не понимают, как создать такой файл, и поэтому не отправляют свои страницы. Это приводит к относительно небольшой базе данных, а это означает, что пользователи с меньшей вероятностью будут искать на ALIWEB, чем на одном из крупных сайтов, основанных на ботах. Эта «Уловка-22» была в некоторой степени компенсирована включением других баз данных в поиск ALIWEB, но она по-прежнему не пользуется массовой популярностью среди поисковых систем, таких как Yahoo! или Ликос. [65]

Excite , первоначально называвшаяся Architext, была основана шестью студентами Стэнфорда в феврале 1993 года. Их идея заключалась в использовании статистического анализа отношений слов для обеспечения более эффективного поиска в большом объеме информации в Интернете. Их проект был полностью профинансирован к середине 1993 года. Как только финансирование было обеспечено. они выпустили версию своего поискового программного обеспечения, которую веб-мастера могли использовать на своих веб-сайтах. В то время программа называлась Architext, но теперь она называется Excite for Web Servers. [65]

Excite была первой серьезной коммерческой поисковой системой, запущенной в 1995 году. [67] Она была разработана в Стэнфорде и была куплена за 6,5 миллиардов долларов компанией @Home. В 2001 году Excite и @Home обанкротились, и InfoSpace купила Excite за 10 миллионов долларов.

Некоторые из первых анализов веб-поиска были проведены на основе журналов поиска Excite [68] [69].

В апреле 1994 года два доктора философии Стэнфордского университета. кандидаты Дэвид Фило и Джерри Янг создали несколько страниц, которые стали довольно популярными. Они назвали коллекцию страниц Yahoo! Официальное объяснение выбора имени заключалось в том, что они считали себя парой йеху.

Когда количество ссылок выросло, а их страницы стали получать тысячи посещений в день, команда нашла способы лучше организовать данные. Чтобы облегчить поиск данных, Yahoo! (www.yahoo.com) стал каталогом с возможностью поиска. Функция поиска представляла собой простую поисковую систему по базе данных. Потому что Yahoo! записи вводились и классифицировались вручную, Yahoo! на самом деле не был классифицирован как поисковая система. Вместо этого обычно считалось, что это каталог с возможностью поиска. Yahoo! с тех пор автоматизировал некоторые аспекты процесса сбора и классификации, стирая различие между механизмом и каталогом.

Wanderer фиксировал только URL-адреса, что затрудняло поиск вещей, которые не были явно описаны в их URL-адресах. Поскольку URL-адреса изначально довольно загадочны, обычному пользователю это не помогло. Поиск Yahoo! или Galaxy были гораздо более эффективными, поскольку содержали дополнительную описательную информацию об индексируемых сайтах.

В июле 1994 года в Университете Карнеги-Меллон Майкл Молдин, находясь в отпуске из CMU, разработал поисковую систему Lycos .

Поисковые системы в Интернете — это сайты, оснащенные возможностью поиска контента, хранящегося на других сайтах. Существуют различия в работе различных поисковых систем, но все они выполняют три основные задачи. [70]

Процесс начинается, когда пользователь вводит запрос в систему через предоставленный интерфейс.

В основном существует три типа поисковых систем: те, которые работают на роботах (называемые сканерами ; муравьями или пауками), и те, которые работают на основе информации, представленной человеком; и те, которые являются гибридом этих двух.

Поисковые системы на основе краулеров — это те, которые используют автоматизированные программные агенты (называемые сканерами), которые посещают веб-сайт, читают информацию на реальном сайте, читают метатеги сайта, а также переходят по ссылкам, которые сайт соединяет, выполняя индексацию всех связанных Веб-сайты тоже. Сканер возвращает всю эту информацию обратно в центральное хранилище, где данные индексируются. Сканер будет периодически возвращаться на сайты, чтобы проверить наличие измененной информации. Частота, с которой это происходит, определяется администраторами поисковой системы.

Поисковые системы, управляемые человеком, полагаются на то, что люди предоставляют информацию, которая впоследствии индексируется и каталогизируется. В индекс помещается только предоставленная информация.

В обоих случаях, когда вы запрашиваете поисковую систему для поиска информации, вы на самом деле выполняете поиск по индексу, созданному поисковой системой, а не ищете в Интернете. Эти индексы представляют собой гигантские базы данных информации, которая собирается, хранится и впоследствии ищется. Это объясняет, почему иногда поиск в коммерческой поисковой системе, такой как Yahoo! или Google вернут результаты, которые на самом деле являются неработающими ссылками. Поскольку результаты поиска основаны на индексе, если индекс не обновлялся с тех пор, как веб-страница стала недействительной, поисковая система рассматривает страницу как все еще активную ссылку, даже если она больше не является таковой. Так будет до тех пор, пока индекс не будет обновлен.

Так почему же один и тот же поиск в разных поисковых системах дает разные результаты? Частично ответ на этот вопрос заключается в том, что не все индексы будут одинаковыми. Это зависит от того, что найдут пауки или что предоставили люди. Но что еще более важно, не все поисковые системы используют один и тот же алгоритм для поиска по индексам. Алгоритм — это то, что поисковые системы используют для определения соответствия информации в индексе тому, что ищет пользователь.

Одним из элементов, которые сканирует алгоритм поисковой системы, является частота и расположение ключевых слов на веб-странице. Те, которые встречаются чаще, обычно считаются более актуальными. Но технологии поисковых систем становятся все более изощренными в попытках предотвратить так называемое наполнение ключевыми словами или спамдексирование.

Еще один общий элемент, который анализируют алгоритмы, — это то, как страницы ссылаются на другие страницы в Интернете. Анализируя то, как страницы ссылаются друг на друга, движок может определить, о чем страница (если ключевые слова связанных страниц аналогичны ключевым словам на исходной странице), а также считается ли эта страница «важной» и заслуживает оценки. повышение рейтинга. Так же, как технология становится все более изощренной, чтобы игнорировать наполнение ключевыми словами, она также становится все более сообразительной для веб-мастеров, которые встраивают искусственные ссылки на свои сайты, чтобы создать искусственный рейтинг.

Современные поисковые системы в Интернете представляют собой очень сложные программные системы, в которых используются технологии, развивавшиеся с годами. Существует ряд подкатегорий программного обеспечения поисковых систем, которые по отдельности применимы к конкретным потребностям «просмотра». К ним относятся поисковые системы в Интернете (например, Google ), системы поиска по базам данных или структурированным данным (например, Dieselpoint ), а также смешанные поисковые системы или корпоративный поиск. Более распространенные поисковые системы, такие как Google и Yahoo! , используют сотни тысяч компьютеров для обработки триллионов веб-страниц, чтобы получить довольно точные результаты. Из-за большого объема запросов и обработки текста программное обеспечение должно работать в сильно рассредоточенной среде с высокой степенью избыточности.

Другая категория поисковых систем — научные поисковые системы. Это поисковые системы, которые ищут научную литературу. Самый известный пример — Google Scholar. Исследователи работают над улучшением технологии поисковых систем, помогая им понять элемент содержания статей, например, извлекая теоретические конструкции или ключевые результаты исследований. [71]