Глобальный катастрофический риск или сценарий конца света — это гипотетическое событие, которое может нанести ущерб благополучию человека в глобальном масштабе [2] даже поставить под угрозу или уничтожить современную цивилизацию . [3] Событие, которое может привести к исчезновению человечества или навсегда и резко ограничить существование или потенциал человечества, известно как « экзистенциальный риск ». [4]

За последние два десятилетия [ когда? ] Был создан ряд академических и некоммерческих организаций для исследования глобальных катастрофических и экзистенциальных рисков, разработки потенциальных мер по смягчению последствий и либо пропаганды, либо реализации этих мер. [5] [6] [7] [8]

Термину «глобальный катастрофический риск» «не хватает четкого определения» и обычно относится (в общих чертах) к риску, который может нанести «серьезный ущерб благополучию человека в глобальном масштабе». [10]

Человечество и раньше переживало крупные катастрофы. Некоторые из них нанесли серьезный ущерб, но носили лишь локальный характер – например, Черная смерть могла привести к гибели трети населения Европы, [11] 10% мирового населения в то время. [12] Некоторые из них были глобальными, но не такими серьезными — например, пандемия гриппа 1918 года унесла жизни примерно 3–6% населения мира. [13] Большинство глобальных катастрофических рисков не будут настолько интенсивными, чтобы уничтожить большую часть жизни на Земле, но даже если бы они это сделали, экосистема и человечество в конечном итоге восстановились бы (в отличие от экзистенциальных рисков ).

Точно так же в книге «Катастрофа: риск и ответ» Ричард Познер выделяет и группирует события, которые приводят к «полному свержению или разорению» в глобальном, а не «локальном или региональном» масштабе. Познер подчеркивает, что такие события заслуживают особого внимания с точки зрения затрат и выгод , поскольку они могут прямо или косвенно поставить под угрозу выживание человечества в целом. [14]

Экзистенциальные риски определяются как «риски, которые угрожают разрушением долгосрочного потенциала человечества». [15] Реализация экзистенциального риска ( экзистенциальной катастрофы [16] ) либо приведет к полному исчезновению человечества, либо необратимо зафиксирует радикально худшее положение дел. [9] [17] Экзистенциальные риски представляют собой подкласс глобальных катастрофических рисков, где ущерб носит не только глобальный , но и окончательный и постоянный характер, препятствуя восстановлению и тем самым затрагивая как нынешнее, так и все будущие поколения. [9]

Хотя вымирание является наиболее очевидным способом уничтожения долгосрочного потенциала человечества, существуют и другие, в том числе невосстановимый коллапс и невосстановимая антиутопия . [18] Катастрофа, достаточно серьезная, чтобы вызвать перманентный, необратимый коллапс человеческой цивилизации, будет представлять собой экзистенциальную катастрофу, даже если она не достигнет исчезновения. [18] Точно так же, если бы человечество попало под тоталитарный режим и не было бы шансов на выздоровление, то такая антиутопия также была бы экзистенциальной катастрофой. [19] Брайан Каплан пишет, что «возможно, вечность тоталитаризма была бы хуже, чем вымирание». [19] ( Роман Джорджа Оруэлла «Девятнадцать восемьдесят четыре» предлагает [20] пример. [21] ) Антиутопический сценарий разделяет ключевые черты вымирания и невосстановимого краха цивилизации: перед катастрофой человечество столкнулось с огромным диапазоном светлых будущих. выбирать из; после катастрофы человечество навсегда оказывается в ужасном состоянии. [18]

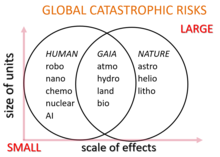

Потенциальные глобальные катастрофические риски условно классифицируются как антропогенные и неантропогенные опасности. Примерами неантропогенных рисков являются событие столкновения с астероидом или кометой , извержение супервулкана , природная пандемия , смертельный гамма-всплеск , геомагнитная буря в результате выброса корональной массы , разрушающая электронное оборудование, естественное долгосрочное изменение климата , враждебные инопланетяне. жизнь или Солнце , превратившееся в красную гигантскую звезду и поглотившее Землю через миллиарды лет в будущем .

Антропогенные риски – это риски, вызванные деятельностью человека, включая риски, связанные с технологиями, управлением и изменением климата. Технологические риски включают создание искусственного интеллекта, несовместимого с человеческими целями, биотехнологии и нанотехнологии . Недостаточное или вредоносное глобальное управление создает риски в социальной и политической сфере, такие как глобальная война и ядерный холокост , биологическая война и биотерроризм с использованием генетически модифицированных организмов , кибервойна и кибертерроризм , разрушающие критически важную инфраструктуру , такую как электрические сети , или радиологическая война с использованием такого оружия, как большие кобальтовые бомбы . Глобальные катастрофические риски в сфере управления системой Земли включают глобальное потепление , деградацию окружающей среды , исчезновение видов , голод в результате несправедливого распределения ресурсов, человеческое перенаселение , неурожаи и неустойчивое сельское хозяйство .

Исследования природы и смягчения глобальных катастрофических рисков и экзистенциальных рисков сталкиваются с уникальным набором проблем и, как следствие, нелегко подчиняются обычным стандартам научной строгости. [18] Например, экспериментальное изучение этих рисков нецелесообразно и неэтично. Карл Саган выразил это по поводу ядерной войны: «Понимание долгосрочных последствий ядерной войны не является проблемой, поддающейся экспериментальной проверке». [22] Более того, многие катастрофические риски быстро меняются по мере развития технологий и изменения фоновых условий, таких как геополитические условия. Еще одной проблемой является общая сложность точного прогнозирования будущего в длительных временных масштабах, особенно в отношении антропогенных рисков, которые зависят от сложных политических, экономических и социальных систем человека. [18] В дополнение к известным и ощутимым рискам, могут произойти непредвиденные события исчезновения черного лебедя , что представляет собой дополнительную методологическую проблему. [18] [23]

Человечество никогда не переживало экзистенциальную катастрофу, и если бы она произошла, она обязательно была бы беспрецедентной. [18] Таким образом, экзистенциальные риски создают уникальные проблемы для прогнозирования, даже более серьезные, чем другие долгосрочные события, из-за эффектов отбора наблюдений . [24] В отличие от большинства событий, неспособность полного вымирания произойти в прошлом не является свидетельством против их вероятности в будущем, потому что в каждом мире, который пережил такое событие вымирания, нет наблюдателей, поэтому независимо от их частоты, ни одна цивилизация в своей истории не наблюдала экзистенциальных рисков. [24] Этих антропных проблем можно частично избежать, рассматривая доказательства, которые не имеют таких эффектов отбора, такие как кратеры от ударов астероидов на Луне, или непосредственно оценивая вероятное воздействие новых технологий. [9]

Чтобы понять динамику беспрецедентного, необратимого глобального цивилизационного коллапса (разновидность экзистенциального риска), может быть полезно изучить различные локальные цивилизационные коллапсы , которые происходили на протяжении всей истории человечества. [25] Например, такие цивилизации, как Римская империя, закончились утратой централизованного управления и крупной общецивилизационной потерей инфраструктуры и передовых технологий. Однако эти примеры показывают, что общества кажутся достаточно устойчивыми к катастрофам; например, средневековая Европа пережила Черную смерть , не пережив ничего, напоминающего коллапс цивилизации , несмотря на потерю от 25 до 50 процентов своего населения. [26]

Существуют экономические причины, которые могут объяснить, почему так мало усилий уделяется снижению экзистенциального риска. Это глобальное общественное благо , поэтому нам следует ожидать, что рынки будут его недостаточно обеспечивать. [9] Даже если большая страна инвестирует в меры по снижению рисков, эта страна получит лишь небольшую часть выгод от этого. Более того, снижение экзистенциального риска является глобальным общественным благом, передаваемым из поколения в поколение, поскольку большинством выгод от снижения экзистенциального риска будут пользоваться будущие поколения, и хотя эти будущие люди теоретически, возможно, будут готовы платить значительные суммы за снижение экзистенциального риска, никакого механизма не существует. для такой транзакции существует. [9]

Многочисленные когнитивные искажения могут влиять на суждения людей о важности экзистенциальных рисков, включая нечувствительность к масштабу , гиперболическое дисконтирование , эвристику доступности , ошибку конъюнкции , эвристику аффекта и эффект чрезмерной уверенности . [27]

Нечувствительность к масштабу влияет на то, насколько плохими людьми считают вымирание человеческой расы. Например, когда люди мотивированы жертвовать деньги на альтруистические цели, сумма, которую они готовы пожертвовать, не увеличивается линейно с масштабом проблемы: люди примерно одинаково готовы предотвратить гибель 200 000 или 2000 птиц. [28] Точно так же люди часто больше обеспокоены угрозами для отдельных лиц, чем для более крупных групп. [27]

Элиэзер Юдковский предполагает, что пренебрежение масштабами играет роль в восприятии общественностью экзистенциальных рисков: [29] [30]

Существенно большие цифры, такие как 500 миллионов смертей, и особенно качественно иные сценарии, такие как вымирание всего человеческого вида, похоже, вызывают другой образ мышления... Люди, которые никогда не мечтали бы причинить вред ребенку, слышат о экзистенциальном риске. и сказать: «Ну, возможно, человеческий вид на самом деле не заслуживает выживания».

Все прошлые предсказания о вымирании человечества оказались ложными. Некоторым это делает будущие предупреждения менее достоверными. Ник Бостром утверждает, что отсутствие вымирания человечества в прошлом является слабым доказательством того, что в будущем не будет вымирания человечества из-за предвзятости выживших и других антропогенных эффектов . [31]

Социобиолог Э. О. Уилсон утверждал, что: «Причина этого близорукого тумана, как утверждают биологи-эволюционисты, заключается в том, что на самом деле он был выгоден на протяжении всех, кроме последних нескольких тысячелетий из двух миллионов лет существования рода Homo ... Премия была сделана за пристальное внимание к ближайшему будущему и раннему воспроизводству, и мало что еще. Катастрофы такого масштаба, которые случаются только раз в несколько столетий, были забыты или превращены в миф». [32]

Глубокоэшелонированная защита — это полезная основа для разделения мер по снижению риска на три уровня защиты: [33]

Вымирание человечества наиболее вероятно, когда все три защиты слабы, то есть «из-за рисков, которые мы вряд ли сможем предотвратить, вряд ли сможем успешно отреагировать и вряд ли будем устойчивы к ним». [33]

Беспрецедентный характер экзистенциальных рисков создает особую проблему при разработке мер по снижению рисков, поскольку человечество не сможет извлечь уроки из истории предыдущих событий. [18]

Некоторые исследователи утверждают, что как исследования, так и другие инициативы, связанные с экзистенциальным риском, недостаточно финансируются. Ник Бостром утверждает, что больше исследований было проведено по «Звездному пути» , сноуборду или навозным жукам, чем по экзистенциальным рискам. Сравнения Бострома подверглись критике как «свободные». [34] [35] По состоянию на 2020 год годовой бюджет организации Конвенции по биологическому оружию составлял 1,4 миллиона долларов США. [36]

Некоторые ученые предлагают создать на Земле одно или несколько самодостаточных, отдаленных, постоянно заселенных поселений, специально созданных с целью выживания при глобальной катастрофе. [37] [38] [39] Экономист Робин Хэнсон утверждает, что убежище, в котором постоянно проживают всего 100 человек, значительно повысит шансы человечества на выживание во время ряда глобальных катастроф. [37] [40]

Хранение продуктов питания предлагается во всем мире, но денежная стоимость будет высокой. Более того, это, вероятно, будет способствовать нынешним миллионам смертей в год из-за недоедания . [41] В 2022 году группа под руководством Дэвида Денкенбергера смоделировала экономическую эффективность устойчивых продуктов питания с учетом безопасности искусственного общего интеллекта (AGI) и обнаружила «~ 98-99% уверенности» в более высоком предельном влиянии работы над устойчивыми продуктами питания. [42] Некоторые специалисты по выживанию снабжают места выживания запасами еды на несколько лет.

Глобальное семенное хранилище Шпицбергена находится на глубине 400 футов (120 м) внутри горы на острове в Арктике . Он предназначен для хранения 2,5 миллиардов семян из более чем 100 стран в качестве меры предосторожности для сохранения мирового урожая. Температура окружающей породы -6 °C (21 °F) (по состоянию на 2015 год), но в хранилище поддерживается температура -18 °C (0 °F) благодаря холодильникам, работающим на угле местного производства. [43] [44]

Более умозрительно, если общество продолжит функционировать и если биосфера останется пригодной для жизни, потребности нынешнего населения в калориях теоретически могут быть удовлетворены во время длительного отсутствия солнечного света при условии достаточного предварительного планирования. Предполагаемые решения включают выращивание грибов на биомассе мертвых растений, оставшихся после катастрофы, преобразование целлюлозы в сахар или подачу природного газа бактериям, переваривающим метан. [45] [46]

Недостаточное глобальное управление создает риски в социальной и политической сфере, но механизмы управления развиваются медленнее, чем технологические и социальные изменения. Правительства, частный сектор, а также широкая общественность обеспокоены отсутствием механизмов управления, позволяющих эффективно справляться с рисками, вести переговоры и выносить решения между различными и конфликтующими интересами. Это дополнительно подчеркивается пониманием взаимосвязанности глобальных системных рисков. [47] В отсутствие или в ожидании глобального управления национальные правительства могут действовать индивидуально, чтобы лучше понять, смягчить последствия и подготовиться к глобальным катастрофам. [48]

В 2018 году Римский клуб призвал к более активным действиям по изменению климата и опубликовал свой Чрезвычайный климатический план, в котором предлагаются десять пунктов действий по ограничению повышения глобальной средней температуры до 1,5 градусов по Цельсию. [49] Кроме того, в 2019 году Клуб опубликовал более подробный Планетарный план действий в чрезвычайной ситуации. [50]

Есть данные, позволяющие предположить, что коллективное участие в эмоциональных переживаниях, возникающих во время размышлений об уязвимости человеческого вида в контексте изменения климата, позволяет этому опыту быть адаптивным. Когда коллективное взаимодействие и обработка эмоциональных переживаний оказывают поддержку, это может привести к росту устойчивости, психологической гибкости, терпимости к эмоциональным переживаниям и участию в сообществе. [51]

Колонизация космоса — предлагаемая альтернатива, позволяющая повысить шансы на выживание в случае сценария вымирания. [52] Решения такого масштаба могут потребовать крупномасштабных инженерных разработок .

Астрофизик Стивен Хокинг выступал за колонизацию других планет Солнечной системы, как только технологии достигнут достаточного прогресса, чтобы повысить шансы человечества на выживание в случае общепланетных событий, таких как глобальная термоядерная война. [53] [54]

Миллиардер Илон Маск пишет, что человечество должно стать многопланетным видом, чтобы избежать вымирания. [55] Маск использует свою компанию SpaceX для разработки технологий, которые, как он надеется, будут использоваться при колонизации Марса .

Через несколько миллиардов лет Солнце превратится в красного гиганта , поглотив Землю. Этого можно избежать, переместив Землю дальше от Солнца, поддерживая температуру примерно постоянной. Этого можно достичь, изменив орбиты комет и астероидов так, чтобы они проходили близко к Земле и добавляли энергию на орбиту Земли. [56] Поскольку расширение Солнца происходит медленно, примерно одного такого столкновения каждые 6000 лет будет достаточно. [ нужна цитата ]

Психолог Стивен Пинкер назвал экзистенциальный риск «бесполезной категорией», которая может отвлечь от реальных угроз, таких как изменение климата и ядерная война. [34]

« Бюллетень ученых-атомщиков» (основан в 1945 году) — одна из старейших глобальных организаций по управлению рисками, основанная после того, как общественность была встревожена потенциалом атомной войны после Второй мировой войны. Он изучает риски, связанные с ядерной войной и энергетикой, и, как известно, поддерживает Часы Судного дня , установленные в 1947 году. Институт Форсайта (основан в 1986 году) исследует риски нанотехнологий и их преимущества. Это была одна из первых организаций, изучавших непредвиденные последствия выхода безобидных технологий из строя в глобальном масштабе. Ее основал К. Эрик Дрекслер , постулировавший « серую слизь ». [57] [58]

Начиная с 2000 года, все большее число ученых, философов и технологических миллиардеров создавали организации, занимающиеся изучением глобальных рисков как внутри, так и за пределами академических кругов. [59]

В число независимых неправительственных организаций (НПО) входит Научно-исследовательский институт машинного интеллекта (основан в 2000 г.), целью которого является снижение риска катастрофы, вызванной искусственным интеллектом, [60] с донорами, в том числе Питером Тилем и Джедом Маккалебом . [61] Инициатива по борьбе с ядерной угрозой (основана в 2001 г.) направлена на снижение глобальных угроз, связанных с ядерными, биологическими и химическими угрозами, а также на сдерживание ущерба после события. [8] Он поддерживает индекс безопасности ядерного материала. [62] Фонд «Спасательная шлюпка» (основан в 2009 г.) финансирует исследования по предотвращению технологической катастрофы. [63] Большая часть исследовательских денег финансирует проекты в университетах. [64] Глобальный институт катастрофических рисков (основан в 2011 г.) — это базирующийся в США некоммерческий беспартийный аналитический центр, основанный Сетом Баумом и Тони Барреттом. GCRI проводит исследования и разрабатывает политику в отношении различных рисков, включая искусственный интеллект, ядерную войну, изменение климата и воздействие астероидов. [65] Фонд «Глобальные вызовы» (основан в 2012 г.), базирующийся в Стокгольме и основанный Ласло Сомбатфалви , публикует ежегодный отчет о состоянии глобальных рисков. [66] [67] Институт будущего жизни (основан в 2014 г.) работает над снижением экстремальных и крупномасштабных рисков, связанных с преобразующими технологиями, а также направляет развитие и использование этих технологий на благо всей жизни посредством выделения грантов и пропаганды политики. в Соединенных Штатах, Европейском Союзе и Организации Объединенных Наций, а также образовательная деятельность. [7] Илон Маск , Виталик Бутерин и Яан Таллинн являются одними из крупнейших спонсоров. [68] Центр долгосрочных рисков (основан в 2016 г.), ранее известный как Институт фундаментальных исследований, — британская организация, занимающаяся снижением рисков астрономических страданий ( s-рисков ) от новых технологий. [69]

Университетские организации включают Институт будущего человечества (основан в 2005 г.), который исследует вопросы долгосрочного будущего человечества, особенно экзистенциального риска. [5] Он был основан Ником Бостромом и базируется в Оксфордском университете. [5] Центр изучения экзистенциального риска (основан в 2012 г.) — это организация на базе Кембриджского университета, которая изучает четыре основных технологических риска: искусственный интеллект, биотехнологии, глобальное потепление и военные действия. [6] Все риски созданы человеком, как объяснил Хью Прайс информационному агентству AFP: «Кажется разумным предсказание, что когда-нибудь в этом или следующем столетии интеллект вырвется из-под ограничений биологии». Он добавил, что когда это произойдет, «мы перестанем быть самыми умными существами в мире» и рискуем оказаться во власти «не вредоносных машин, а машин, чьи интересы не включают нас». [70] Стивен Хокинг был исполняющим обязанности советника. Альянс тысячелетия для человечества и биосферы — это организация, базирующаяся в Стэнфордском университете, которая занимается многими вопросами, связанными с глобальной катастрофой, объединяя представителей академических кругов в области гуманитарных наук. [71] [72] Он был основан Паулем Эрлихом , среди других. [73] В Стэнфордском университете также есть Центр международной безопасности и сотрудничества, который занимается политическим сотрудничеством в целях снижения риска глобальных катастроф. [74] Центр безопасности и новейших технологий был создан в январе 2019 года в Школе дипломатической службы Уолша в Джорджтауне. Он будет заниматься политическими исследованиями новых технологий с первоначальным упором на искусственный интеллект. [75] Они получили грант в размере 55 миллионов долларов США от Good Ventures по предложению Open Philanthropy . [75]

Другие группы оценки рисков базируются на правительственных организациях или являются их частью. Всемирная организация здравоохранения (ВОЗ) включает в себя подразделение под названием «Глобальное оповещение и реагирование» (GAR), которое отслеживает глобальный эпидемический кризис и реагирует на него. [76] GAR помогает государствам-членам в обучении и координации мер реагирования на эпидемии. [77] Агентство США по международному развитию (USAID) осуществляет Программу борьбы с возникающими пандемическими угрозами, целью которой является предотвращение и сдерживание естественно возникающих пандемий в их источнике. [78] В Ливерморской национальной лаборатории Лоуренса есть подразделение, называемое Главным управлением глобальной безопасности, которое от имени правительства исследует такие вопросы, как биологическая безопасность и борьба с терроризмом. [79]

Это эквивалент, хотя и более четкий, определения Ника Бострома : «Экзистенциальный риск — это риск, который угрожает преждевременным вымиранием разумной жизни, зародившейся на Земле, или постоянным и радикальным разрушением ее потенциала для желаемого будущего развития». Источник: Бостром, Ник (2013). «Предотвращение экзистенциального риска как глобальный приоритет». Глобальная политика. 4:15-31.

Создатель Уинстона, Джордж Оруэлл, верил, что свобода в конечном итоге победит искажающий правду тоталитаризм, изображенный в «Девятнадцать восемьдесят четыре».

Европа выжила, потеряв от 25 до 50 процентов своего населения во время Черной смерти, сохранив при этом цивилизацию в неприкосновенности.

Международный орган, ответственный за постоянный запрет биологического оружия (Конвенция о биологическом оружии), имеет годовой бюджет в 1,4 миллиона долларов - меньше, чем средний ресторан McDonald's.

Научно-исследовательский институт машинного интеллекта стремится снизить риск катастрофы, если такое событие в конечном итоге произойдет.

В настоящее время мы сосредоточены на усилиях по снижению наихудших рисков астрономических страданий (s-рисков) от новых технологий, уделяя особое внимание преобразующему искусственному интеллекту.

Ищете ли вы лекарство от рака, делаете ли вы научную или творческую карьеру или занимаетесь созданием более справедливых институтов, угроза будущему человечества также представляет собой угрозу значимости того, что вы делаете.