T -тест Стьюдента — это статистический тест, используемый для проверки того, является ли разница между ответами двух групп статистически значимой или нет. Это любой статистический тест гипотезы , в котором тестовая статистика следует t -распределению Стьюдента при нулевой гипотезе . Чаще всего он применяется, когда тестовая статистика следовала бы нормальному распределению , если бы значение масштабирующего члена в тестовой статистике было известно (обычно масштабирующий член неизвестен и, следовательно, является мешающим параметром ). Когда масштабирующий член оценивается на основе данных , тестовая статистика — при определенных условиях — следует t- распределению Стьюдента . Наиболее распространенное применение t -теста — это проверка того, являются ли средние значения двух популяций существенно разными. Во многих случаях Z-тест даст очень похожие результаты на t -тест, поскольку последний сходится к первому по мере увеличения размера набора данных.

Термин « t -статистика» является сокращением от «hypothesis test statistic» (статистика проверки гипотез). [1] В статистике t -распределение было впервые выведено как апостериорное распределение в 1876 году Гельмертом [2] [3] [4] и Люротом . [5] [6] [7] t -распределение также появилось в более общей форме как распределение Пирсона типа IV в статье Карла Пирсона 1895 года. [8] Однако t - распределение, также известное как t -распределение Стьюдента , получило свое название от Уильяма Сили Госсета , который впервые опубликовал его на английском языке в 1908 году в научном журнале Biometrika, используя псевдоним «Студент» [9] [10], поскольку его работодатель предпочитал, чтобы сотрудники использовали псевдонимы при публикации научных статей. [11] Госсет работал на пивоварне Guinness Brewery в Дублине , Ирландия , и интересовался проблемами малых образцов — например, химическими свойствами ячменя с малыми размерами образцов. Отсюда вторая версия этимологии термина Student заключается в том, что Guinness не хотел, чтобы их конкуренты знали, что они используют t -тест для определения качества сырья. Хотя именно Уильям Госсет был автором термина «Student», на самом деле именно благодаря работе Рональда Фишера распределение стало широко известно как «распределение Стьюдента» [12] и « t -тест Стьюдента ».

Госсет разработал t -тест как экономичный способ контроля качества стаута . Работа по t -тесту была представлена и принята в журнале Biometrika и опубликована в 1908 году. [9]

В журнале Guinness существовала политика предоставления техническому персоналу отпуска для учебы (так называемый «учебный отпуск»), который Госсет использовал в течение первых двух семестров 1906–1907 учебного года в биометрической лаборатории профессора Карла Пирсона в Университетском колледже Лондона . [13] Личность Госсета тогда была известна коллегам-статистикам и главному редактору Карлу Пирсону. [14]

Одновыборочный t -тест Стьюдента — это локационный тест того, имеет ли среднее значение совокупности значение, указанное в нулевой гипотезе . При проверке нулевой гипотезы о том, что среднее значение совокупности равно указанному значению μ 0 , используется статистика

где — выборочное среднее, s — стандартное отклонение выборки , а n — размер выборки. В этом тесте используются следующие степени свободы : n − 1. Хотя родительская популяция не обязательно должна быть распределена нормально, распределение выборочных средних в популяции предполагается нормальным.

По центральной предельной теореме , если наблюдения независимы и существует второй момент, то будет приблизительно нормальным .

Двухвыборочный локационный тест нулевой гипотезы, такой, что средние значения двух совокупностей равны. Все такие тесты обычно называются t -тестами Стьюдента , хотя, строго говоря , это название следует использовать только в том случае, если дисперсии двух совокупностей также предполагаются равными; форма теста, используемая при отказе от этого предположения, иногда называется t -тестом Уэлча . Эти тесты часто называют t -тестами непарных или независимых выборок , поскольку они обычно применяются, когда статистические единицы, лежащие в основе двух сравниваемых выборок, не перекрываются. [15]

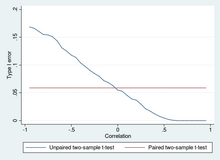

Двухвыборочные t -тесты для разницы в средних значениях включают независимые выборки (непарные выборки) или парные выборки . Парные t -тесты являются формой блокирования и имеют большую мощность (вероятность избежания ошибки типа II, также известной как ложноотрицательный результат), чем непарные тесты, когда парные единицы схожи в отношении «шумовых факторов» (см. конфаундер ), которые не зависят от членства в двух сравниваемых группах. [16] В другом контексте парные t -тесты могут использоваться для уменьшения влияния конфаундирующих факторов в наблюдательном исследовании .

Независимый выборочный t -тест используется, когда получены два отдельных набора независимых и одинаково распределенных выборок, и сравнивается одна переменная из каждой из двух популяций. Например, предположим, что мы оцениваем эффект медицинского лечения и регистрируем 100 субъектов в нашем исследовании, затем случайным образом назначаем 50 субъектов в группу лечения и 50 субъектов в контрольную группу. В этом случае у нас есть две независимые выборки, и мы будем использовать непарную форму t - теста.

Парные выборки t -тестов обычно состоят из выборки подобранных пар схожих единиц или одной группы единиц, которая была протестирована дважды ( t -тест «повторных измерений»).

Типичным примером t -теста с повторными измерениями может быть случай, когда субъекты тестируются до лечения, скажем, на высокое кровяное давление, и те же субъекты снова тестируются после лечения лекарством, снижающим кровяное давление. Сравнивая показатели одного и того же пациента до и после лечения, мы фактически используем каждого пациента в качестве его собственного контроля. Таким образом, правильное отклонение нулевой гипотезы (здесь: об отсутствии разницы, вызванной лечением) может стать гораздо более вероятным, при этом статистическая мощность увеличивается просто потому, что случайная вариация между пациентами теперь устранена. Однако увеличение статистической мощности имеет свою цену: требуется больше тестов, каждый субъект должен быть протестирован дважды. Поскольку половина выборки теперь зависит от другой половины, парная версия t -теста Стьюдента имеет только н/2 − 1 степень свободы (где n — общее число наблюдений). Пары становятся отдельными тестовыми единицами, и выборку приходится удваивать, чтобы достичь того же числа степеней свободы. Обычно имеется n − 1 степень свободы (где n — общее число наблюдений). [17]

Парный выборочный t -тест, основанный на «выборке сопоставляемых пар», получается из непарной выборки, которая впоследствии используется для формирования парной выборки с использованием дополнительных переменных, которые были измерены вместе с интересующей переменной. [18] Сопоставление осуществляется путем идентификации пар значений, состоящих из одного наблюдения из каждой из двух выборок, где пара похожа с точки зрения других измеренных переменных. Этот подход иногда используется в наблюдательных исследованиях для уменьшения или устранения эффектов мешающих факторов.

T -тесты для парных выборок часто называют « t -тестами для зависимых выборок».

[ сомнительный – обсудить ]

Большинство тестовых статистик имеют вид t = Z / s , где Z и s являются функциями данных.

Z может быть чувствителен к альтернативной гипотезе (т.е. его величина имеет тенденцию быть больше, когда альтернативная гипотеза верна), тогда как s является параметром масштабирования , который позволяет определить распределение t .

Например, в одновыборочном t -тесте

где — выборочное среднее значение из выборки X 1 , X 2 , …, X n , размером n , s — стандартная ошибка среднего значения , — оценка стандартного отклонения генеральной совокупности, а μ — среднее значение генеральной совокупности .

Предположения, лежащие в основе t -теста в простейшей форме, приведенной выше, следующие:

При сравнении средних значений двух независимых выборок с помощью t -теста должны выполняться следующие предположения:

Большинство двухвыборочных t -тестов устойчивы ко всем отклонениям от предположений, кроме больших. [22]

Для точности t - тест и Z -тест требуют нормальности выборочных средних значений, а t -тест дополнительно требует, чтобы выборочная дисперсия следовала масштабированному распределению χ2 , и чтобы выборочное среднее и выборочная дисперсия были статистически независимы . Нормальность отдельных значений данных не требуется , если эти условия выполняются. Согласно центральной предельной теореме , выборочные средние значения умеренно больших выборок часто хорошо аппроксимируются нормальным распределением, даже если данные не распределены нормально. Однако размер выборки, необходимый для сходимости выборочных средних значений к нормальности, зависит от асимметрии распределения исходных данных. Выборка может варьироваться от 30 до 100 или более значений в зависимости от асимметрии. [23] [24] F

Для ненормальных данных распределение выборочной дисперсии может существенно отклоняться от распределения χ2 .

Однако, если размер выборки большой, теорема Слуцкого подразумевает, что распределение дисперсии выборки мало влияет на распределение тестовой статистики. То есть, по мере увеличения размера выборки:

Ниже приведены явные выражения, которые можно использовать для проведения различных t -тестов. В каждом случае дана формула для тестовой статистики, которая либо точно следует, либо близко приближается к t -распределению при нулевой гипотезе. Также в каждом случае даны соответствующие степени свободы . Каждая из этих статистик может использоваться для проведения одностороннего или двустороннего теста .

После определения значения t и степеней свободы можно найти значение p с помощью таблицы значений из распределения Стьюдента t . Если рассчитанное значение p ниже порога, выбранного для статистической значимости (обычно это уровень 0,10, 0,05 или 0,01), то нулевая гипотеза отклоняется в пользу альтернативной гипотезы.

Предположим, что кто-то подгоняет модель

где x известен, α и β неизвестны, ε — нормально распределенная случайная величина со средним значением 0 и неизвестной дисперсией σ 2 , а Y — интересующий нас результат. Мы хотим проверить нулевую гипотезу о том, что наклон β равен некоторому указанному значению β 0 (часто принимаемому за 0, в этом случае нулевая гипотеза заключается в том, что x и y некоррелированы).

Позволять

Затем

имеет t -распределение с n − 2 степенями свободы, если нулевая гипотеза верна. Стандартная ошибка коэффициента наклона :

можно записать в терминах остатков. Пусть

Тогда оценка t определяется как

Другой способ определения t - критерия —

где r — коэффициент корреляции Пирсона .

Значение t- критерия, отсекаемое осью, можно определить из значения t- критерия, наклона :

где s x 2 — выборочная дисперсия.

Учитывая две группы (1, 2), этот тест применим только в следующих случаях:

Нарушения этих предположений обсуждаются ниже.

Статистику t для проверки различия средних значений можно рассчитать следующим образом:

где

Здесь s p — это объединенное стандартное отклонение для n = n 1 = n 2 , а s 2

х 1и с 2

х 2являются несмещенными оценками дисперсии популяции. Знаменатель t является стандартной ошибкой разности между двумя средними.

Для проверки значимости степени свободы для этого теста составляют 2 n − 2 , где n — размер выборки.

Этот тест используется только тогда, когда можно предположить, что два распределения имеют одинаковую дисперсию (когда это предположение нарушается, см. ниже). Предыдущие формулы являются частным случаем формул ниже, их можно восстановить, когда обе выборки равны по размеру: n = n 1 = n 2 .

Статистику t для проверки различия средних значений можно рассчитать следующим образом:

где

— это объединенное стандартное отклонение двух выборок: оно определяется таким образом, что его квадрат является несмещенной оценкой общей дисперсии, независимо от того, одинаковы ли средние значения совокупности. В этих формулах n i − 1 — это число степеней свободы для каждой группы, а общий размер выборки минус два (то есть n 1 + n 2 − 2 ) — это общее число степеней свободы, которое используется при проверке значимости.

Этот тест, также известный как t -тест Уэлча , используется только тогда, когда две дисперсии совокупности не считаются равными (два размера выборки могут быть равными или нет) и, следовательно, должны оцениваться отдельно. Статистика t для проверки того, различаются ли средние значения совокупности, рассчитывается как

где

Здесь s i 2 — несмещенная оценка дисперсии каждой из двух выборок с n i = числом участников в группе i ( i = 1 или 2). В этом случае — это не объединенная дисперсия. Для использования в тестировании значимости распределение тестовой статистики аппроксимируется как обычное t -распределение Стьюдента со степенями свободы, рассчитанными с использованием

Это известно как уравнение Уэлча–Саттертуэйта . Истинное распределение тестовой статистики на самом деле зависит (немного) от двух неизвестных дисперсий популяции (см. задачу Беренса–Фишера ).

Тест [25] имеет дело со знаменитой проблемой Беренса–Фишера , то есть сравнением разницы между средними значениями двух нормально распределенных совокупностей, когда дисперсии двух совокупностей не предполагаются равными, на основе двух независимых выборок.

Тест разработан как точный тест , который допускает неравные размеры выборки и неравные дисперсии двух совокупностей. Точное свойство сохраняется даже при малых, чрезвычайно малых и несбалансированных размерах выборки (например, ).

Статистику для проверки различия средних значений можно рассчитать следующим образом:

Пусть и будут независимыми векторами выборки ( ) из и по отдельности.

Пусть — ортогональная матрица, все элементы первой строки которой равны , аналогично, пусть — первые n строк ортогональной матрицы (все элементы первой строки которой равны ).

Тогда — n-мерный нормальный случайный вектор.

Из вышеприведенного распределения мы видим, что

Этот тест используется, когда образцы зависимы; то есть, когда есть только один образец, который был протестирован дважды (повторные измерения) или когда есть два образца, которые были сопоставлены или «спарены». Это пример парного теста на разницу . Статистика t рассчитывается как

где и — среднее значение и стандартное отклонение различий между всеми парами. Пары — это, например, либо результаты одного человека до и после теста, либо результаты между парами людей, объединенных в значимые группы (например, взятые из одной семьи или возрастной группы: см. таблицу). Константа μ 0 равна нулю, если мы хотим проверить, является ли среднее значение разницы существенно различным. Используемая степень свободы — n − 1 , где n представляет собой количество пар.

Пусть A 1 обозначает набор, полученный путем случайной выборки из шести измерений:

и пусть A 2 обозначает второй набор, полученный аналогично:

Это может быть, например, вес винтов, изготовленных на двух разных станках.

Мы проведем проверку нулевой гипотезы о том, что средние значения популяций, из которых были взяты две выборки, равны.

Разница между двумя средними значениями выборки, каждая из которых обозначена как X i , которая появляется в числителе для всех рассмотренных выше подходов к двухвыборочному тестированию, равна

Стандартные отклонения выборки для двух выборок составляют приблизительно 0,05 и 0,11 соответственно. Для таких небольших выборок тест равенства между двумя дисперсиями генеральной совокупности не будет очень мощным. Поскольку размеры выборок равны, две формы двухвыборочного t -теста будут работать одинаково в этом примере.

Если следовать подходу для неравных дисперсий (обсуждавшемуся выше), результаты будут следующими:

и степени свободы

Статистика теста составляет приблизительно 1,959, что дает двустороннее тестовое p -значение 0,09077.

Если следовать подходу для равных дисперсий (обсуждавшемуся выше), результаты будут следующими:

и степени свободы

Тестовая статистика приблизительно равна 1,959, что дает двустороннее p -значение 0,07857.

T - тест обеспечивает точный тест на равенство средних значений двух независимых нормальных совокупностей с неизвестными, но равными дисперсиями. ( T -тест Уэлча является почти точным тестом для случая, когда данные являются нормальными, но дисперсии могут различаться.) Для умеренно больших выборок и одностороннего теста T -тест относительно устойчив к умеренным нарушениям предположения о нормальности. [26] В достаточно больших выборках T -тест асимптотически приближается к z -тесту и становится устойчивым даже к большим отклонениям от нормальности. [19]

Если данные существенно ненормальны, а размер выборки мал, t -тест может дать вводящие в заблуждение результаты. См. Тест местоположения для гауссовых шкал смешанных распределений для некоторой теории, связанной с одним конкретным семейством ненормальных распределений.

Когда предположение о нормальности не выполняется, непараметрическая альтернатива t -тесту может иметь лучшую статистическую мощность . Однако, когда данные не являются нормальными с различными дисперсиями между группами, t -тест может иметь лучший контроль ошибок типа 1 , чем некоторые непараметрические альтернативы. [27] Кроме того, непараметрические методы, такие как U-тест Манна-Уитни , обсуждаемый ниже, обычно не проверяют разницу средних значений, поэтому их следует использовать осторожно, если разница средних значений представляет основной научный интерес. [19] Например, U-тест Манна-Уитни сохранит ошибку типа 1 на желаемом уровне альфа, если обе группы имеют одинаковое распределение. Он также будет иметь мощность в обнаружении альтернативы, при которой группа B имеет такое же распределение, как A, но после некоторого сдвига на константу (в этом случае действительно будет разница в средних значениях двух групп). Однако могут быть случаи, когда группы A и B будут иметь разные распределения, но с одинаковыми средними значениями (например, два распределения, одно с положительной асимметрией, а другое с отрицательной, но смещенные так, чтобы иметь одинаковые средние значения). В таких случаях MW может иметь больше, чем альфа-уровень мощности при отклонении нулевой гипотезы, но приписывать интерпретацию разницы в средних значениях такому результату было бы неверно.

При наличии выброса t - тест не является надежным. Например, для двух независимых выборок, когда распределения данных асимметричны (то есть распределения перекошены ) или распределения имеют большие хвосты, тогда тест суммы рангов Вилкоксона (также известный как U - тест Манна-Уитни ) может иметь в три-четыре раза большую мощность, чем t -тест. [26] [28] [29] Непараметрическим аналогом t -теста парных выборок является тест знаковых рангов Вилкоксона для парных выборок. Для обсуждения выбора между t -тестом и непараметрическими альтернативами см. Lumley, et al. (2002). [19]

Однофакторный дисперсионный анализ (ANOVA) обобщает двухвыборочный t -тест, когда данные принадлежат более чем двум группам.

Когда в двухвыборочном проекте присутствуют как парные наблюдения, так и независимые наблюдения, предполагая, что данные отсутствуют полностью случайным образом (MCAR), парные наблюдения или независимые наблюдения могут быть отброшены, чтобы продолжить стандартные тесты выше. В качестве альтернативы, используя все доступные данные, предполагая нормальность и MCAR, можно использовать обобщенный частично перекрывающийся выборочный t -тест. [30]

Обобщение t- статистики Стьюдента, называемое t -квадратной статистикой Хотеллинга , позволяет проверять гипотезы по нескольким (часто коррелированным) показателям в пределах одной выборки. Например, исследователь может отправить несколько субъектов на личностный тест, состоящий из нескольких личностных шкал (например, Minnesota Multiphasic Personality Inventory ). Поскольку показатели этого типа обычно положительно коррелируют, не рекомендуется проводить отдельные одномерные t -тесты для проверки гипотез, так как они будут игнорировать ковариацию между показателями и увеличивать вероятность ложного отклонения по крайней мере одной гипотезы ( ошибка типа I ). В этом случае для проверки гипотез предпочтительнее использовать один многомерный тест. Метод Фишера для объединения нескольких тестов с альфа- уменьшением для положительной корреляции между тестами является одним из них. Другим является статистика Хотеллинга T 2 , которая следует распределению T 2 . Однако на практике это распределение используется редко, поскольку табличные значения для T 2 трудно найти. Обычно T 2 преобразуется в F -статистику.

Для одновыборочного многомерного теста гипотеза заключается в том, что средний вектор ( μ ) равен заданному вектору ( μ0 ). Тестовая статистика — t2 Хотеллинга :

где n — размер выборки, x — вектор средних значений столбцов, а S — выборочная ковариационная матрица размером m × m .

Для двухвыборочного многомерного теста гипотеза заключается в том, что средние векторы ( μ 1 , μ 2 ) двух выборок равны. Тестовая статистика — двухвыборочный t 2 Хотеллинга :

Двухвыборочный t -тест представляет собой частный случай простой линейной регрессии , что иллюстрируется следующим примером.

В клиническом исследовании изучаются 6 пациентов, которым давали лекарство или плацебо. Три (3) пациента получают 0 единиц лекарства (группа плацебо). Три (3) пациента получают 1 единицу лекарства (группа активного лечения). В конце лечения исследователи измеряют изменение по сравнению с исходным уровнем количества слов, которые каждый пациент может вспомнить в тесте на память.

Ниже представлена таблица показателей запоминания слов пациентами и доз препаратов.

Данные и код приведены для анализа с использованием языка программирования R с функциями t.testи lmдля t-теста и линейной регрессии. Вот те же (фиктивные) данные выше, сгенерированные в R.

> слово.отзыв.данные = данные.фрейм ( доза.препарата = c ( 0 , 0 , 0 , 1 , 1 , 1 ), слово.отзыв = c ( 1 , 2 , 3 , 5 , 6 , 7 )) Выполните t -тест. Обратите внимание, что предположение о равной дисперсии, var.equal=Tнеобходимо для того, чтобы сделать анализ точно эквивалентным простой линейной регрессии.

> с ( слово.вспомнить.данные , t.тест ( слово.вспомнить ~ лекарство.доза , var.равно = T )) Выполнение кода R дает следующие результаты.

Выполнить линейную регрессию тех же данных. Расчеты могут быть выполнены с использованием функции R lm()для линейной модели.

> слово.вспомнить.данные.lm = lm ( слово.вспомнить ~ доза.препарата , данные = слово.вспомнить.данные ) > резюме ( слово.вспомнить.данные.lm ) Линейная регрессия дает таблицу коэффициентов и p-значений.

Таблица коэффициентов дает следующие результаты.

Коэффициенты линейной регрессии определяют наклон и точку пересечения линии, соединяющей два средних значения группы, как показано на графике. Точка пересечения равна 2, а точка пересечения равна 4.

Сравните результат линейной регрессии с результатом t -теста.

Этот пример показывает, что для особого случая простой линейной регрессии, где есть единственная x-переменная, которая имеет значения 0 и 1, t -тест дает те же результаты, что и линейная регрессия. Связь также может быть показана алгебраически.

Распознавание этой связи между t -тестом и линейной регрессией облегчает использование множественной линейной регрессии и многофакторного дисперсионного анализа . Эти альтернативы t -тестам позволяют включать дополнительные объясняющие переменные , которые связаны с ответом. Включение таких дополнительных объясняющих переменных с использованием регрессии или ANOVA уменьшает иначе необъяснимую дисперсию и обычно дает большую мощность для обнаружения различий, чем двухвыборочные t -тесты.

Многие программы для работы с электронными таблицами и статистические пакеты, такие как QtiPlot , LibreOffice Calc , Microsoft Excel , SAS , SPSS , Stata , DAP , gretl , R , Python , PSPP , Wolfram Mathematica , MATLAB и Minitab , включают в себя реализации t -критерия Стьюдента.

{{cite book}}: CS1 maint: DOI inactive as of June 2024 (link)