Философия искусственного интеллекта — это ветвь философии разума и философии информатики [1] , которая исследует искусственный интеллект и его значение для познания и понимания интеллекта , этики , сознания , эпистемологии и свободы воли . [2] [3] Кроме того, технология связана с созданием искусственных животных или искусственных людей (или, по крайней мере, искусственных существ; см. искусственную жизнь ), поэтому эта дисциплина представляет значительный интерес для философов. [4] Эти факторы способствовали появлению философии искусственного интеллекта .

Философия искусственного интеллекта пытается ответить на такие вопросы следующим образом: [5]

Подобные вопросы отражают расходящиеся интересы исследователей ИИ , учёных-когнитивистов и философов соответственно. Научные ответы на эти вопросы зависят от определения «интеллекта» и «сознания» и от того, о каких именно «машинах» идет речь.

Важные положения философии ИИ включают некоторые из следующих:

Возможно ли создать машину, которая сможет решить все проблемы, которые люди решают, используя свой интеллект? Этот вопрос определяет масштаб того, что машины смогут делать в будущем, и определяет направление исследований ИИ. Оно касается только поведения машин и игнорирует вопросы, интересующие психологов , когнитивистов и философов , вызывая вопрос: имеет ли значение, действительно ли машина думает так, как думает человек, а не просто производит результаты, которые кажутся результатом думаешь? [11]

Основная позиция большинства исследователей ИИ суммирована в этом заявлении, которое появилось в предложении Дартмутского семинара 1956 года:

Аргументы против основной предпосылки должны показать, что создание работающей системы искусственного интеллекта невозможно, потому что существует некий практический предел возможностей компьютеров или что существует какое-то особое качество человеческого разума, которое необходимо для разумного поведения и, тем не менее, не может быть воспроизведено компьютером. машине (или методами современных исследований ИИ). Аргументы в пользу основной предпосылки должны показать, что такая система возможна.

Можно также обойти связь между двумя частями приведенного выше предложения. Например, машинное обучение, начиная с печально известного предложения Тьюринга о дочерних машинах , [12] по существу достигает желаемого свойства интеллекта без точного описания во время разработки того, как именно оно будет работать. Учет неявных знаний роботов [13] вообще устраняет необходимость в точном описании.

Первым шагом к ответу на этот вопрос является четкое определение понятия «интеллект».

Алан Тьюринг [15] свел проблему определения интеллекта к простому вопросу о разговоре. Он предполагает следующее: если машина может ответить на любой заданный ей вопрос, используя те же слова, что и обычный человек, то мы можем назвать эту машину разумной. В современной версии его экспериментального проекта будет использоваться онлайн- чат , где одним из участников является реальный человек, а одним из участников — компьютерная программа. Программа проходит тест, если никто не может определить, кто из двух участников человек. [6] Тьюринг отмечает, что никто (кроме философов) никогда не задается вопросом «могут ли люди мыслить?» Он пишет: «Вместо того, чтобы постоянно спорить по этому поводу, обычно существует вежливая договоренность, о которой думают все». [16] Тест Тьюринга распространяет это вежливое соглашение на машины:

Критика теста Тьюринга заключается в том, что он измеряет только «человечность» поведения машины, а не «разумность» поведения. Поскольку человеческое поведение и разумное поведение — не одно и то же, тест не позволяет измерить интеллект. Стюарт Дж. Рассел и Питер Норвиг пишут, что «в текстах по авиационной технике цель их области не определяется как« создание машин, которые летают настолько точно, как голуби, чтобы они могли обмануть других голубей »». [17]

Исследования искусственного интеллекта XXI века определяют интеллект как целенаправленное поведение. Он рассматривает интеллект как набор задач, которые должна решить машина: чем больше проблем она может решить и чем лучше ее решения, тем умнее программа. Основатель искусственного интеллекта Джон Маккарти определил интеллект как «вычислительную часть способности достигать целей в мире». [18]

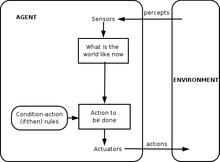

Стюарт Рассел и Питер Норвиг формализовали это определение, используя абстрактных интеллектуальных агентов . «Агент» — это нечто, что воспринимает и действует в окружающей среде. «Показатель эффективности» определяет, что считается успехом для агента. [19]

Определения, подобные этому, пытаются уловить суть интеллекта. Их преимущество состоит в том, что, в отличие от теста Тьюринга, они не проверяют неразумные человеческие качества, такие как ошибки при наборе текста. [21] Их недостаток заключается в том, что они не могут отличить «вещи, которые думают» от «вещей, которые не думают». Согласно этому определению, даже термостат обладает рудиментарным интеллектом. [22]

Хьюберт Дрейфус описывает этот аргумент как утверждение, что «если нервная система подчиняется законам физики и химии, а у нас есть все основания предполагать, что это так, то… мы… должны быть способны воспроизводить поведение нервной системы». система с каким-либо физическим устройством». [23] Этот аргумент, впервые выдвинутый еще в 1943 году [24] и ярко описанный Гансом Моравецом в 1988 году, [25] сейчас ассоциируется с футуристом Рэем Курцвейлом , который считает, что мощности компьютера будет достаточно для полной симуляции мозга с помощью 2029 год. [26] Моделирование таламокортикальной модели размером с человеческий мозг (10 11 нейронов) не в реальном времени было выполнено в 2005 году, [27] и потребовалось 50 дней, чтобы смоделировать 1 секунду динамики мозга. на кластере из 27 процессоров.

Даже самые суровые критики ИИ (такие как Хьюберт Дрейфус и Джон Сирл ) согласны с тем, что моделирование мозга теоретически возможно. [a] Однако Сирл отмечает, что, в принципе, с помощью компьютера можно смоделировать все ; таким образом, доведение определения до критической точки приводит к выводу, что любой процесс вообще можно технически считать «вычислением». «Мы хотели узнать, что отличает разум от термостатов и печени», — пишет он. [30] Таким образом, простое моделирование функционирования живого мозга само по себе было бы признанием невежества в отношении интеллекта и природы ума, это все равно, что пытаться построить реактивный авиалайнер, точно копируя живую птицу, перышко за перышком, без каких-либо усилий. теоретическое понимание авиационной техники . [31]

В 1963 году Аллен Ньюэлл и Герберт А. Саймон предположили, что «манипулирование символами» является сутью как человеческого, так и машинного интеллекта. Они написали:

Это утверждение очень сильное: оно подразумевает как то, что человеческое мышление — это своего рода манипулирование символами (поскольку для интеллекта необходима система символов), так и то, что машины могут быть разумными (поскольку для интеллекта достаточно системы символов ). [32] Другая версия этой позиции была описана философом Хьюбертом Дрейфусом, который назвал ее «психологическим предположением»:

«Символы», которые обсуждали Ньюэлл, Саймон и Дрейфус, были словесными и высокого уровня — символами, которые напрямую соответствуют объектам в мире, например <собака> и <хвост>. Большинство программ искусственного интеллекта, написанных между 1956 и 1990 годами, использовали этот тип символов. Современный ИИ, основанный на статистике и математической оптимизации, не использует высокоуровневую «обработку символов», о которой говорили Ньюэлл и Саймон.

Эти аргументы показывают, что человеческое мышление не состоит (исключительно) из манипуляций с символами высокого уровня. Они не доказывают, что искусственный интеллект невозможен, а лишь показывают, что требуется нечто большее, чем просто обработка символов.

В 1931 году Курт Гёдель доказал с помощью теоремы о неполноте , что всегда возможно построить « утверждение Гёделя », которое данная непротиворечивая формальная система логики (например, программа манипуляции символами высокого уровня) не может доказать. Несмотря на то, что построенное утверждение Гёделя является истинным, оно недоказуемо в данной системе. ( Истинность построенного утверждения Гёделя зависит от непротиворечивости данной системы; применение того же процесса к слегка противоречивой системе будет казаться успешным, но на самом деле вместо этого приведет к ложному «утверждению Гёделя » . ) В спекулятивном плане Гёдель предположил, что человеческий разум может в конечном итоге правильно определить истинность или ложность любого хорошо обоснованного математического утверждения (включая любое возможное утверждение Гёделя), и что, следовательно, сила человеческого разума не сводится к механизму . [34] Философ Джон Лукас (с 1961 г.) и Роджер Пенроуз (с 1989 г.) отстаивают этот философский антимеханистический аргумент . [35]

Гёделевские антимеханистические аргументы имеют тенденцию опираться на кажущееся безобидным утверждение о том, что система математиков-людей (или некоторая идеализация математиков-людей) одновременно непротиворечива (полностью свободна от ошибок) и полностью верит в свою непротиворечивость (и может сделать все логическими). выводы, которые следуют из его собственной последовательности, включая веру в утверждение Гёделя ) . Доказуемо невозможно сделать это для машины Тьюринга (см. Проблема остановки ); следовательно, гёделианец заключает, что человеческое мышление слишком мощно, чтобы его можно было охватить машиной Тьюринга и, как следствие, любым цифровым механическим устройством.

Однако современный консенсус в научном и математическом сообществе заключается в том, что реальные человеческие рассуждения непоследовательны; что любая последовательная «идеализированная версия» H человеческого рассуждения логически будет вынуждена принять здоровый, но контринтуитивный непредвзятый скептицизм относительно непротиворечивости H (в противном случае H будет доказуемо непоследовательным); и что теоремы Гёделя не приводят к какому-либо вескому аргументу в пользу того, что люди обладают способностями к математическому мышлению, превосходящими те, которые машина когда-либо могла бы воспроизвести. [36] [37] [38] Этот консенсус в отношении того, что гёделевские антимеханистические аргументы обречены на провал, четко изложен в « Искусственном интеллекте» : « любая попытка использовать (результаты Гёделя о неполноте) для критики тезиса вычислительной техники неизбежно будет нелегитимной, поскольку эти результаты вполне согласуются с тезисом компьютеристов». [39]

Стюарт Рассел и Питер Норвиг согласны с тем, что аргументы Гёделя не учитывают природу реальных человеческих рассуждений. Оно применимо к тому, что теоретически можно доказать, имея бесконечное количество памяти и времени. На практике реальные машины (включая людей) имеют ограниченные ресурсы и с трудом доказывают многие теоремы. Чтобы быть умным человеком, не обязательно уметь все доказать. [40]

Менее формально Дуглас Хофштадтер в своей книге «Гёдель, Эшер, Бах: Вечная золотая коса », получившей Пулитцеровскую премию , утверждает, что эти «геделевские утверждения» всегда относятся к самой системе, проводя аналогию с тем, как в парадоксе Эпименида используются утверждения, которые ссылаются на себя, например: «Это утверждение ложно» или «Я лгу». [41] Но, конечно, парадокс Эпименида применим ко всему, что делает утверждения, будь то машины или люди, даже сам Лукас. Учитывать:

Это утверждение верно, но Лукас не может его утверждать. Это показывает, что сам Лукас, как и все люди, подвержен тем же ограничениям, которые он описывает для машин, и поэтому аргумент Лукаса бессмысленен. [43]

Придя к выводу, что человеческое мышление не поддается вычислению, Пенроуз продолжил спорное предположение, что некие гипотетические невычислимые процессы, включающие коллапс квантово-механических состояний, дают людям особое преимущество перед существующими компьютерами. Существующие квантовые компьютеры способны только снизить сложность вычислительных задач Тьюринга и по-прежнему ограничиваются задачами, входящим в рамки машин Тьюринга. [ необходима цитата ] [ необходимы разъяснения ] . Согласно аргументам Пенроуза и Лукаса, тот факт, что квантовые компьютеры способны решать только задачи, вычислимые по Тьюрингу, означает, что их недостаточно для имитации человеческого разума. [ нужна цитата ] Поэтому Пенроуз ищет какой-то другой процесс, включающий новую физику, например, квантовую гравитацию, которая могла бы проявить новую физику в масштабе планковской массы посредством спонтанного квантового коллапса волновой функции. Он предположил, что эти состояния возникают как внутри нейронов, так и охватывают более одного нейрона. [44] Однако другие учёные отмечают, что в мозге не существует какого-либо органического механизма, способного использовать какие-либо квантовые вычисления, и, кроме того, временные рамки квантовой декогеренции кажутся слишком быстрыми, чтобы влиять на возбуждение нейронов. [45]

Хьюберт Дрейфус утверждал, что человеческий интеллект и опыт зависят в первую очередь от быстрых интуитивных суждений, а не от пошаговых символических манипуляций, и утверждал, что эти навыки никогда не будут отражены в формальных правилах. [46]

Аргумент Дрейфуса был предвосхищен Тьюрингом в его статье 1950 года «Вычислительная техника и интеллект» , где он классифицировал его как «аргумент, основанный на неформальном поведении». [47] Тьюринг в ответ утверждал, что то, что мы не знаем правил, управляющих сложным поведением, не означает, что таких правил не существует. Он писал: «Мы не можем так легко убедить себя в отсутствии полных законов поведения... Единственный известный нам способ найти такие законы — это научное наблюдение, и мы, конечно, не знаем никаких обстоятельств, при которых мы могли бы сказать: «Мы достаточно искали. Таких законов нет»» [48] .

Рассел и Норвиг отмечают, что за годы, прошедшие с тех пор, как Дрейфус опубликовал свою критику, был достигнут прогресс в открытии «правил», управляющих бессознательным рассуждением. [49] Ситуационное движение в исследованиях робототехники пытается уловить наши бессознательные навыки восприятия и внимания. [50] Парадигмы вычислительного интеллекта , такие как нейронные сети , эволюционные алгоритмы и т. д., в основном направлены на моделирование бессознательного рассуждения и обучения. Статистические подходы к ИИ позволяют делать прогнозы, точность которых приближается к интуитивным догадкам человека. Исследования здравого смысла сосредоточены на воспроизведении «предыстории» или контекста знаний. Фактически, исследования ИИ в целом отошли от манипуляций с символами высокого уровня в сторону новых моделей, которые призваны лучше отражать наши интуитивные рассуждения. [49]

Когнитивная наука и психология в конечном итоге пришли к согласию с описанием человеческого опыта, данным Дрейфусом. Дэниел Канеман и другие разработали аналогичную теорию, определив две «системы», которые люди используют для решения проблем, которые он назвал «Системой 1» (быстрые интуитивные суждения) и «Системой 2» (медленное сознательное пошаговое мышление). [51]

Хотя взгляды Дрейфуса были подтверждены во многих отношениях, работа в области когнитивной науки и искусственного интеллекта была ответом на конкретные проблемы в этих областях и не находилась под прямым влиянием Дрейфуса. Историк и исследователь искусственного интеллекта Дэниел Кревье писал, что «время доказало точность и проницательность некоторых комментариев Дрейфуса. Если бы он сформулировал их менее агрессивно, предлагаемые ими конструктивные действия могли бы быть предприняты гораздо раньше». [52]

Это философский вопрос, связанный с проблемой других разумов и трудной проблемой сознания . Вопрос вращается вокруг позиции, которую Джон Сирл определил как «сильный ИИ»:

Сирл отличал эту позицию от того, что он называл «слабым ИИ»:

Сирл представил термины, позволяющие отделить сильный ИИ от слабого ИИ, чтобы он мог сосредоточиться на том, что, по его мнению, было более интересным и спорным вопросом. Он утверждал, что даже если мы предположим , что у нас есть компьютерная программа, действующая точно так же, как человеческий разум, все равно останется трудный философский вопрос, на который необходимо ответить. [9]

Ни одна из двух позиций Сирла не представляет особого интереса для исследований ИИ, поскольку они не дают прямого ответа на вопрос: «Может ли машина демонстрировать общий интеллект?» (если только не будет также показано, что сознание необходимо для интеллекта). Тьюринг писал: «Я не хочу создавать впечатление, что, по моему мнению, в сознании нет никакой тайны… [б] но я не думаю, что эти загадки обязательно необходимо разгадать, прежде чем мы сможем ответить на вопрос [могут ли машины думать]. " [53] Рассел и Норвиг соглашаются: «Большинство исследователей ИИ принимают гипотезу слабого ИИ как нечто само собой разумеющееся и не заботятся о гипотезе сильной ИИ». [54]

Есть несколько исследователей, которые считают, что сознание является важным элементом интеллекта, например Игорь Александер , Стэн Франклин , Рон Сан и Пентти Хайконен , хотя их определение «сознания» очень близко к «интеллекту». (См. искусственное сознание .)

Прежде чем мы сможем ответить на этот вопрос, мы должны прояснить, что мы подразумеваем под «умами», «психическими состояниями» и «сознанием».

Слова « разум » и « сознание » используются разными сообществами по-разному. Некоторые мыслители нового века , например, используют слово «сознание» для описания чего-то похожего на « жизненный порыв » Бергсона : невидимый энергетический флюид, который пронизывает жизнь и особенно разум. Писатели-фантасты используют это слово для описания некоторого существенного свойства, которое делает нас людьми: машина или инопланетянин, обладающий «сознанием», будет представлен как полностью человеческий персонаж, обладающий интеллектом, желаниями, волей , проницательностью, гордостью и так далее. (Писатели-фантасты также используют слова «разум», «разум», «самосознание» или « призрак » — как в манге и аниме « Призрак в доспехах » — для описания этого важного человеческого свойства). Для других [ кто? ] слова «разум» или «сознание» используются как своего рода светский синоним души .

Для философов , нейробиологов и когнитивистов эти слова используются одновременно более точно и более обыденно: они относятся к знакомому, повседневному опыту наличия «мысли в голове», например, к восприятию, сну, намерение или план, а также то, как мы что-то видим , что-то знаем , что-то имеем в виду или что-то понимаем . [55] «Нетрудно дать здравое определение сознания», — замечает философ Джон Сирл. [56] Таинственно и увлекательно не столько то, что это такое, сколько то , как оно есть: как комок жировой ткани и электричество порождают этот (знакомый) опыт восприятия, значения или мышления?

Философы называют это трудной проблемой сознания . Это последняя версия классической проблемы философии сознания, называемой « проблемой разума и тела ». [57] Смежной проблемой является проблема значения или понимания (которую философы называют « интенциональностью »): какова связь между нашими мыслями и тем, о чем мы думаем (т.е. объектами и ситуациями в мире)? Третий вопрос — это проблема опыта (или « феноменологии »): если два человека видят одно и то же, имеют ли они одинаковый опыт? Или есть вещи «внутри их головы» (называемые « квалиа »), которые могут отличаться от человека к человеку? [58]

Нейробиологи полагают, что все эти проблемы будут решены, когда мы начнем идентифицировать нейронные корреляты сознания : реальную связь между механизмами в нашей голове и их коллективными свойствами; такие как ум, опыт и понимание. Некоторые из самых резких критиков искусственного интеллекта согласны с тем, что мозг — это всего лишь машина, а сознание и интеллект — результат физических процессов в мозге. [59] Сложный философский вопрос заключается в следующем: может ли компьютерная программа, работающая на цифровой машине, которая перемешивает двоичные цифры нуля и единицы, дублировать способность нейронов создавать разум с ментальными состояниями (такими как понимание или восприятие), и, в конечном счете, опыт сознания?

Джон Сирл предлагает нам рассмотреть мысленный эксперимент : предположим, что мы написали компьютерную программу, которая проходит тест Тьюринга и демонстрирует общие разумные действия. Предположим, в частности, что программа может свободно общаться на китайском языке. Напишите программу на карточках 3х5 и дайте их обычному человеку, не говорящему по-китайски. Заприте человека в комнате и предложите ему следовать инструкциям на карточках. Он будет копировать китайские иероглифы и передавать их в комнату и из нее через щель. Со стороны может показаться, что в китайской комнате находится вполне разумный человек, говорящий по-китайски. Вопрос вот в чем: есть ли в комнате кто-нибудь (или что-нибудь) понимающий китайский язык? То есть, есть ли что-нибудь, что обладает ментальным состоянием понимания или сознательно осознает то, что обсуждается на китайском языке? Мужчина явно не в курсе. Комната не может быть в курсе. Карты конечно не в курсе . Сирл заключает, что китайская комната или любая другая физическая система символов не может иметь разума. [60]

Сирл продолжает утверждать, что реальные психические состояния и сознание требуют (еще не описанных) «реальных физико-химических свойств реального человеческого мозга». [61] Он утверждает, что существуют особые «причинные свойства» мозга и нейронов , которые порождают разум : по его словам, «мозг вызывает разум». [62]

Готфрид Лейбниц выдвинул по существу тот же аргумент, что и Серл в 1714 году, используя мысленный эксперимент по расширению мозга до размеров мельницы. [63] В 1974 году Лоуренс Дэвис представил, как можно дублировать мозг с помощью телефонных линий и офисов, укомплектованных людьми, а в 1978 году Нед Блок представил, что все население Китая участвует в таком моделировании мозга. Этот мысленный эксперимент называется «Китайская нация» или «Китайский тренажерный зал». [64] Нед Блок также предложил свой «Аргумент болвана» , который представляет собой версию китайской комнаты , в которой программа была переработана в простой набор правил формы «посмотри это, сделай то», убрав всю тайну из программа.

В ответах на китайскую комнату подчеркивается несколько разных моментов.

Вычислительная теория разума или « компьютерализм » утверждает, что отношения между разумом и мозгом аналогичны (если не идентичны) отношениям между работающей программой (программным обеспечением) и компьютером (аппаратным обеспечением). Эта идея имеет философские корни у Гоббса (который утверждал, что рассуждение — это «не более чем расчет»), Лейбница (который пытался создать логическое исчисление всех человеческих идей), Юма (который считал, что восприятие можно свести к «атомарным впечатлениям») и даже Кант (который анализировал весь опыт как контролируемый формальными правилами). [71] Последняя версия связана с философами Хилари Патнэм и Джерри Фодором . [72]

Этот вопрос связан с нашими предыдущими вопросами: если человеческий мозг — это своего рода компьютер, то компьютеры могут быть одновременно интеллектуальными и сознательными, отвечая как на практические, так и на философские вопросы ИИ. Что касается практического вопроса ИИ («Может ли машина демонстрировать общий интеллект?»), некоторые версии компьютерализма утверждают, что (как писал Гоббс ):

Другими словами, наш интеллект основан на расчетах , похожих на арифметику . Это гипотеза системы физических символов , обсуждавшаяся выше, и она подразумевает, что искусственный интеллект возможен. Что касается философского вопроса об ИИ («Может ли машина иметь разум, ментальные состояния и сознание?»), большинство версий компьютерализма утверждают , что (как это характеризует Стеван Харнад ):

Это «сильный ИИ» Джона Сирла, о котором говорилось выше, и он является настоящей целью аргумента о китайской комнате (по мнению Харнада ). [73]

Если « эмоции » определяются только с точки зрения их влияния на поведение или на то, как они функционируют внутри организма, то эмоции можно рассматривать как механизм, который интеллектуальный агент использует для максимизации полезности своих действий. Учитывая такое определение эмоций, Ганс Моравец считает, что «роботы в целом будут очень эмоционально относиться к тому, что они хорошие люди». [74] Страх является источником срочности. Эмпатия является необходимым компонентом хорошего взаимодействия человека с компьютером . Он говорит, что роботы «будут стараться доставить вам удовольствие в явно бескорыстной манере, потому что они получат удовольствие от этого положительного подкрепления. Вы можете интерпретировать это как своего рода любовь». [74] Дэниел Кревье пишет: «Моравек считает, что эмоции — это всего лишь средства направления поведения в направлении, полезном для выживания своего вида». [75]

« Самосознание », как отмечалось выше, иногда используется писателями -фантастами как название важнейшего человеческого свойства, делающего персонажа полностью человечным. Тьюринг отбрасывает все остальные свойства человека и сводит вопрос к следующему: «Может ли машина быть предметом собственного мышления?» Может ли оно думать о себе ? С этой точки зрения можно написать программу, которая может сообщать о своих внутренних состояниях, например отладчик . [76]

Тьюринг сводит это к вопросу о том, может ли машина «застать нас врасплох», и утверждает, что это, очевидно, правда, что может подтвердить любой программист. [77] Он отмечает, что при достаточной емкости памяти компьютер может вести себя астрономическим количеством различных способов. [78] Для компьютера, способного представлять идеи, должна быть возможность, даже тривиальная, комбинировать их новыми способами. ( В качестве примера можно привести « Автоматическую математику» Дугласа Лената , объединившую идеи для открытия новых математических истин.) Каплан и Хэнлайн предполагают, что машины могут демонстрировать научное творчество, хотя вполне вероятно, что люди одержат верх в том, что касается художественного творчества. [79]

В 2009 году ученые из Аберистуитского университета в Уэльсе и британского Кембриджского университета разработали робота по имени Адам, который, по их мнению, станет первой машиной, которая самостоятельно сделает новые научные открытия. [80] Также в 2009 году исследователи из Корнелла разработали Eureqa , компьютерную программу, которая экстраполирует формулы в соответствии с введенными данными, например, находя законы движения на основе движения маятника.

Этот вопрос (как и многие другие в философии искусственного интеллекта) можно представить в двух формах. «Враждебность» можно определить с точки зрения функции или поведения , и в этом случае «враждебный» становится синонимом «опасного». Или это можно определить с точки зрения намерения: может ли машина «намеренно» намереваться причинить вред? Последний вопрос — «может ли машина иметь сознательные состояния?» (например, намерения ) в другой форме. [53]

Вопрос о том, будут ли опасны высокоинтеллектуальные и полностью автономные машины, подробно исследовался футуристами (например, НИИ машинного интеллекта ). Очевидный элемент драмы также сделал эту тему популярной в научной фантастике , которая рассматривала множество различных возможных сценариев, в которых интеллектуальные машины представляют угрозу человечеству; см. Искусственный интеллект в художественной литературе .

Одна из проблем заключается в том, что машины могут очень быстро приобрести автономию и интеллект, необходимые для того, чтобы стать опасными. Вернор Виндж предположил, что всего за несколько лет компьютеры внезапно станут в тысячи или миллионы раз умнее человека. Он называет это « сингулярностью ». [81] Он предполагает, что это может быть в некоторой степени или, возможно, очень опасно для людей. [82] Это обсуждается философией под названием Сингуляритаризм .

В 2009 году ученые и технические эксперты посетили конференцию, чтобы обсудить потенциальное влияние роботов и компьютеров, а также влияние гипотетической возможности того, что они смогут стать самодостаточными и принимать собственные решения . Они обсудили возможность и степень, в которой компьютеры и роботы смогут приобрести тот или иной уровень автономии, и в какой степени они могут использовать такие способности, чтобы представлять какую-либо угрозу или опасность. Они отметили, что некоторые машины приобрели различные формы полуавтономности, в том числе возможность самостоятельно находить источники питания и возможность самостоятельно выбирать цели для атаки оружием. Они также отметили, что некоторые компьютерные вирусы могут уклоняться от уничтожения и обладают «тараканьим интеллектом». Они отметили, что самосознание , изображенное в научной фантастике, вероятно, маловероятно, но существуют и другие потенциальные опасности и ловушки. [81]

Некоторые эксперты и ученые ставят под сомнение использование роботов в боевых действиях, особенно когда таким роботам наделяется определенная степень автономных функций. [83] ВМС США профинансировали доклад, в котором указывается, что по мере того, как военные роботы становятся более сложными, следует уделять больше внимания последствиям их способности принимать автономные решения. [84] [85]

Президент Ассоциации по развитию искусственного интеллекта заказал исследование по этому вопросу. [86] Они указывают на такие программы, как Устройство овладения языком, которое может имитировать человеческое взаимодействие.

Некоторые полагают, что необходимо создать « Дружественный ИИ » — термин, придуманный Элиезером Юдковски , означающий, что достижения, которые уже происходят в области ИИ, должны также включать усилия по созданию ИИ по своей сути дружелюбным и гуманным. [87]

Тьюринг сказал: «Принято... предлагать долю утешения в форме заявления о том, что машина никогда не сможет имитировать какую-то особую человеческую характеристику. ... Я не могу предложить такого утешения, поскольку считаю, что нет такие границы могут быть установлены». [88]

Тьюринг отметил, что существует множество аргументов в форме «машина никогда не сделает X», где X может означать множество вещей, например:

Будьте добрыми, находчивыми, красивыми, дружелюбными, проявляйте инициативу, имейте чувство юмора, отличайте хорошее от неправильного, совершайте ошибки, влюбляйтесь, наслаждайтесь клубникой и сливками, влюбляйте в нее кого-то, учитесь на опыте, правильно используйте слова , быть предметом собственной мысли, иметь такое же разнообразие поведения, как и человек, делать что-то действительно новое. [76]

Тьюринг утверждает, что эти возражения часто основаны на наивных предположениях об универсальности машин или являются «замаскированными формами аргументации сознания». Написание программы, демонстрирующей одно из этих поведений, «не произведет особого впечатления». [76] Все эти аргументы имеют отношение к основной предпосылке ИИ, если только не будет показано, что одна из этих черт важна для общего интеллекта.

Наконец, те, кто верят в существование души, могут утверждать, что «мышление — это функция бессмертной души человека». Алан Тьюринг назвал это «теологическим возражением». Он написал:

Пытаясь сконструировать такие машины, мы не должны непочтительно узурпировать Его силу создания душ, так же как мы не занимаемся рождением детей: скорее, в любом случае мы являемся инструментами Его воли, предоставляющими обители душам, которые Он создает. [89]

Дискуссия по этой теме возобновилась в результате недавних заявлений системы искусственного интеллекта LaMDA от Google о том, что она разумна и имеет « душу ». [90]

LaMDA ( Языковая модель для диалоговых приложений) — это система искусственного интеллекта , которая создает чат-ботов — роботов с искусственным интеллектом, предназначенных для общения с людьми, — путем сбора огромных объемов текста из Интернета и использования алгоритмов для ответа на запросы наиболее гибким и естественным способом.

Стенограммы разговоров между учеными и LaMDA показывают, что система ИИ превосходно справляется с этим, давая ответы на сложные темы о природе эмоций , генерируя басни в стиле Эзопа о текущем моменте и даже описывая свои предполагаемые страхи. [91] Практически все философы сомневаются в разумности LaMDA. [92]

Некоторые ученые утверждают, что игнорирование философии сообществом ИИ вредно. В Стэнфордской энциклопедии философии некоторые философы утверждают, что роль философии в ИИ недооценена. [4] Физик Дэвид Дойч утверждает, что без понимания философии и ее концепций развитие ИИ пострадает из-за отсутствия прогресса. [93]

Основная серия конференций по этой проблеме — «Философия и теория искусственного интеллекта» (PT-AI), проводимая Винсентом К. Мюллером .

Основная библиография по этой теме с несколькими подразделами находится на сайте PhilPapers.

Недавний обзор «Философии искусственного интеллекта» — Мюллер (2023). [3]

Однако эти антимеханистские аргументы Геделя проблематичны, и существует широкое мнение, что они терпят неудачу.

...даже если мы признаем, что у компьютеров есть ограничения на то, что они могут доказать, нет никаких доказательств того, что люди застрахованы от этих ограничений.