В математике матрица ( мн. ч .: матрицы ) — это прямоугольный массив или таблица чисел , символов или выражений , элементы или записи которых расположены в строках и столбцах, которая используется для представления математического объекта или свойства такого объекта.

Например, — это матрица с двумя строками и тремя столбцами. Ее часто называют «матрицей два на три», « матрицей» или матрицей размерности .

Матрицы обычно связаны с линейной алгеброй . Известные исключения включают матрицы инцидентности и матрицы смежности в теории графов . [1] В этой статье основное внимание уделяется матрицам, связанным с линейной алгеброй, и, если не указано иное, все матрицы представляют собой линейные отображения или могут рассматриваться как таковые.

Квадратные матрицы , матрицы с одинаковым числом строк и столбцов, играют важную роль в теории матриц. Квадратные матрицы заданной размерности образуют некоммутативное кольцо , которое является одним из наиболее распространенных примеров некоммутативного кольца. Определитель квадратной матрицы — это число, связанное с матрицей, что является фундаментальным для изучения квадратной матрицы; например, квадратная матрица обратима тогда и только тогда, когда ее определитель не равен нулю, а собственные значения квадратной матрицы являются корнями полиномиального определителя .

В геометрии матрицы широко используются для задания и представления геометрических преобразований (например, вращений ) и изменений координат . В численном анализе многие вычислительные задачи решаются путем сведения их к матричному вычислению, и это часто включает вычисления с матрицами огромных размеров. Матрицы используются в большинстве областей математики и научных дисциплин, либо напрямую, либо посредством их использования в геометрии и численном анализе.

Теория матриц — это раздел математики , который фокусируется на изучении матриц. Первоначально это был подраздел линейной алгебры , но вскоре он разросся и включил в себя предметы, связанные с теорией графов , алгеброй , комбинаторикой и статистикой .

Матрица — это прямоугольный массив чисел (или других математических объектов), называемых записями матрицы. Матрицы подлежат стандартным операциям, таким как сложение и умножение. [2] Чаще всего матрица над полем F представляет собой прямоугольный массив элементов F . [3] [ 4] Действительная матрица и комплексная матрица — это матрицы, записи которых являются соответственно действительными числами или комплексными числами . Более общие типы записей обсуждаются ниже. Например, это действительная матрица:

Числа, символы или выражения в матрице называются ее записями или ее элементами . Горизонтальные и вертикальные линии записей в матрице называются строками и столбцами соответственно.

Размер матрицы определяется числом строк и столбцов, которые она содержит. Нет ограничений на число строк и столбцов, которые может иметь матрица (в обычном смысле), если они являются положительными целыми числами. Матрица со строками и столбцами называется матрицей , или -by- матрицей, где и называются ее размерами . Например, матрица выше является матрицей.

Матрицы с одной строкой называются векторами-строками , а с одним столбцом — векторами-столбцами . Матрица с одинаковым количеством строк и столбцов называется квадратной матрицей . [5] Матрица с бесконечным количеством строк или столбцов (или и того, и другого) называется бесконечной матрицей. В некоторых контекстах, таких как программы компьютерной алгебры , полезно рассматривать матрицу без строк или столбцов, называемую пустой матрицей.

Специфика символической записи матриц сильно различается, с некоторыми преобладающими тенденциями. Матрицы обычно записываются в квадратных скобках или круглых скобках , так что матрица представляется как Это может быть сокращено путем записи только одного родового термина, возможно, вместе с индексами, как в или в случае, когда .

Матрицы обычно обозначаются заглавными буквами (как в приведенных выше примерах), в то время как соответствующие строчные буквы с двумя нижними индексами (например, , или ) представляют записи. Помимо использования заглавных букв для обозначения матриц, многие авторы используют специальный типографский стиль , обычно полужирный римский (не курсив), чтобы еще больше отличать матрицы от других математических объектов. Альтернативная нотация предполагает использование двойного подчеркивания с именем переменной, с полужирным начертанием или без него, как в .

Запись в i -й строке и j -м столбце матрицы A иногда называют записью или матрицы и обычно обозначают как или . Альтернативные обозначения для этой записи — и . Например, запись следующей матрицы — 5 (также обозначается , , или ):

Иногда элементы матрицы можно определить с помощью формулы, например . Например, каждый из элементов следующей матрицы определяется с помощью формулы .

В этом случае сама матрица иногда определяется этой формулой, в квадратных скобках или двойных круглых скобках. Например, матрица выше определяется как или . Если размер матрицы равен , вышеупомянутая формула действительна для любого и любого . Это можно указать отдельно или указать с помощью нижнего индекса. Например, матрица выше равна , и может быть определена как или .

Некоторые языки программирования используют дважды индексированные массивы (или массивы массивов) для представления матрицы размером m на n . Некоторые языки программирования начинают нумерацию индексов массива с нуля, в этом случае элементы матрицы размером m на n индексируются с помощью и . [6] В этой статье мы придерживаемся более распространенного соглашения в математической литературе, где нумерация начинается с 1 .

Множество всех действительных матриц размером m на n часто обозначается или Множество всех матриц размером m на n над другим полем или над кольцом R аналогично обозначается или Если m = n , как в случае квадратных матриц , размерность не повторяется: или [7] Часто вместо , или , используется

Несколько основных операций могут быть применены к матрицам. Некоторые, такие как транспонирование и подматрица, не зависят от природы записей. Другие, такие как сложение матриц , скалярное умножение , матричное умножение и операции со строками, включают операции над записями матрицы и, следовательно, требуют, чтобы записи матрицы были числами или принадлежали полю или кольцу . [ 8]

В этом разделе предполагается, что элементы матрицы принадлежат фиксированному кольцу, которое обычно представляет собой поле чисел.

Сумма A + B двух матриц A и B размером m × n вычисляется поэлементно: Например,

Произведение c A числа c (также называемого скаляром в этом контексте) и матрицы A вычисляется путем умножения каждого элемента A на c : Эта операция называется скалярным умножением , но ее результат не называется «скалярным произведением», чтобы избежать путаницы, поскольку «скалярное произведение» часто используется как синоним « внутреннего произведения ». Например:

Вычитание двух матриц m × n определяется путем сложения матриц со скалярным умножением на –1 :

Транспонированная матрица A размером m × n представляет собой матрицу A T размером n × m (также обозначаемую как A tr или t A ), образованную путем преобразования строк в столбцы и наоборот. Например:

Знакомые свойства чисел распространяются на эти операции над матрицами: например, сложение коммутативно , то есть сумма матриц не зависит от порядка слагаемых: A + B = B + A. [9] Транспонирование совместимо со сложением и скалярным умножением, как выражается формулами ( c A ) T = c ( A T ) и ( A + B ) T = A T + B T . Наконец, ( A T ) T = A .

Умножение двух матриц определено тогда и только тогда, когда число столбцов левой матрицы совпадает с числом строк правой матрицы. Если A — матрица m × n , а B — матрица n × p , то их матричное произведение AB — это матрица m × p, элементы которой задаются скалярным произведением соответствующей строки A и соответствующего столбца B : [10]

где 1 ≤ i ≤ m и 1 ≤ j ≤ p . [11] Например, подчеркнутая запись 2340 в произведении вычисляется как (2 × 1000) + (3 × 100) + (4 × 10) = 2340:

Умножение матриц удовлетворяет правилам ( AB ) C = A ( BC ) ( ассоциативность ), и ( A + B ) C = AC + BC , а также C ( A + B ) = CA + CB ( левая и правая дистрибутивность ), всякий раз, когда размер матриц таков, что определены различные произведения. [12] Произведение AB может быть определено без определения BA , а именно, если A и B являются матрицами m × n и n × k соответственно, и m ≠ k . Даже если оба произведения определены, они, как правило, не обязаны быть равными, то есть:

Другими словами, умножение матриц не является коммутативным , в отличие от (рациональных, действительных или комплексных) чисел, произведение которых не зависит от порядка множителей. [10] Пример двух матриц, не коммутирующих друг с другом:

тогда как

Помимо обычного умножения матриц, описанного выше, существуют и другие, менее часто используемые операции над матрицами, которые можно считать формами умножения, например, произведение Адамара и произведение Кронекера . [13] Они возникают при решении матричных уравнений, таких как уравнение Сильвестра .

Существует три типа операций со строками:

Эти операции используются несколькими способами, включая решение линейных уравнений и нахождение обратных матриц .

Подматрица матрицы — это матрица, полученная путем удаления любого набора строк и/или столбцов. [ 14] [15] [16] Например, из следующей матрицы размером 3 на 4 мы можем построить подматрицу размером 2 на 3, удалив строку 3 и столбец 2:

Миноры и кофакторы матрицы находятся путем вычисления определителя определенных подматриц. [16] [17 ]

Главная подматрица — это квадратная подматрица, полученная путем удаления определенных строк и столбцов. Определение варьируется от автора к автору. По мнению некоторых авторов, главная подматрица — это подматрица, в которой набор индексов строк, которые остаются, совпадает с набором индексов столбцов, которые остаются. [18] [19] Другие авторы определяют главную подматрицу как такую, в которой первые k строк и столбцов, для некоторого числа k , являются теми, которые остаются; [20] этот тип подматрицы также называется ведущей главной подматрицей . [21]

Матрицы можно использовать для компактной записи и работы с несколькими линейными уравнениями, то есть системами линейных уравнений. Например, если A — матрица размером m × n , x обозначает вектор-столбец (то есть матрицу размером n × 1 ) из n переменных x 1 , x 2 , ..., x n , а b — вектор-столбец размером m × 1 , то матричное уравнение

эквивалентно системе линейных уравнений [22]

Используя матрицы, это можно решить более компактно, чем это было бы возможно, выписав все уравнения по отдельности. Если n = m и уравнения независимы , то это можно сделать, записав

где A −1 — обратная матрица для A. Если A не имеет обратной матрицы, решения — если таковые имеются — можно найти с помощью ее обобщенной обратной матрицы .

Матрицы и матричное умножение раскрывают свои существенные особенности, когда они связаны с линейными преобразованиями , также известными как линейные отображения . Действительная матрица A размером m на n порождает линейное преобразование R n → R m, отображающее каждый вектор x в R n в (матричное) произведение Ax , которое является вектором в R m . Наоборот, каждое линейное преобразование f : R n → R m возникает из уникальной матрицы A размером m на n : явно, ( i , j )-элемент матрицы A является i -й координатой f ( e j ), где e j = (0,...,0,1,0,...,0) является единичным вектором с 1 в j -й позиции и 0 в остальных местах. Говорят , что матрица A представляет линейное отображение f , а A называется матрицей преобразования f .

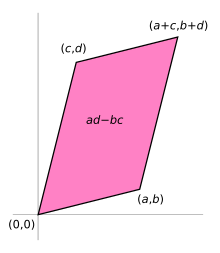

Например, матрица 2×2

можно рассматривать как преобразование единичного квадрата в параллелограмм с вершинами в (0, 0) , ( a , b ) , ( a + c , b + d ) и ( c , d ) . Параллелограмм, изображенный справа, получен путем умножения A на каждый из векторов-столбцов , и по очереди. Эти векторы определяют вершины единичного квадрата.

В следующей таблице показано несколько действительных матриц 2×2 с соответствующими линейными отображениями R 2 . Синий оригинал отображается на зеленую сетку и формы. Начало координат (0,0) отмечено черной точкой.

При соответствии один к одному между матрицами и линейными отображениями умножение матриц соответствует композиции отображений: [23] если матрица B размером k на m представляет другое линейное отображение g : R m → R k , то композиция g ∘ f представляется как BA, поскольку

Последнее равенство следует из отмеченной выше ассоциативности умножения матриц.

Ранг матрицы A — это максимальное число линейно независимых векторов-строк матрицы, которое равно максимальному числу линейно независимых векторов-столбцов. [24] Эквивалентно это размерность образа линейной карты, представленной A. [ 25 ] Теорема о ранге–нуле утверждает, что размерность ядра матрицы плюс ранг равна числу столбцов матрицы. [26]

Квадратная матрица — это матрица с одинаковым числом строк и столбцов. [5] Матрица n на n известна как квадратная матрица порядка n. Любые две квадратные матрицы одного порядка можно складывать и умножать. Элементы a ii образуют главную диагональ квадратной матрицы. Они лежат на воображаемой прямой, которая проходит из верхнего левого угла в нижний правый угол матрицы.

Если все элементы A ниже главной диагонали равны нулю, A называется верхней треугольной матрицей . Аналогично, если все элементы A выше главной диагонали равны нулю, A называется нижней треугольной матрицей . Если все элементы вне главной диагонали равны нулю, A называется диагональной матрицей .

Единичная матрица I n размера n — это матрица размером n на n , в которой все элементы на главной диагонали равны 1, а все остальные элементы равны 0, например,

Это квадратная матрица порядка n , а также особый вид диагональной матрицы . Она называется единичной матрицей, потому что умножение на нее оставляет матрицу неизменной:

Ненулевое скалярное кратное единичной матрицы называется скалярной матрицей. Если элементы матрицы поступают из поля, скалярные матрицы образуют группу при умножении матриц, которая изоморфна мультипликативной группе ненулевых элементов поля.

Квадратная матрица A , равная своей транспонированной матрице, то есть A = A T , является симметричной матрицей . Если же A равна отрицательной своей транспонированной матрице, то есть A = − A T , то A является кососимметричной матрицей . В комплексных матрицах симметрия часто заменяется понятием эрмитовых матриц , которая удовлетворяет A ∗ = A , где звездочка или астериск обозначает сопряженную транспонированную матрицу, то есть транспонирование комплексно сопряженной матрицы A .

По спектральной теореме , действительные симметричные матрицы и комплексные эрмитовы матрицы имеют собственный базис ; то есть, каждый вектор выражается как линейная комбинация собственных векторов. В обоих случаях все собственные значения действительны. [27] Эту теорему можно обобщить на бесконечномерные ситуации, связанные с матрицами с бесконечным числом строк и столбцов, см. ниже.

Квадратная матрица A называется обратимой или невырожденной, если существует матрица B такая, что

где I n — единичная матрица n × n с единицами на главной диагонали и нулями в остальных местах. Если B существует , она уникальна и называется обратной матрицей A , обозначаемой A −1 .

Симметричная действительная матрица A называется положительно определенной, если соответствующая ей квадратичная форма

имеет положительное значение для каждого ненулевого вектора x в R n . Если f ( x ) дает только отрицательные значения, то A является отрицательно определенной ; если f дает как отрицательные, так и положительные значения, то A является неопределенной . [30] Если квадратичная форма f дает только неотрицательные значения (положительные или ноль), симметричная матрица называется положительно-полуопределенной (или если только неположительные значения, то отрицательно-полуопределенной); следовательно, матрица является неопределенной в точности тогда, когда она не является ни положительно-полуопределенной, ни отрицательно-полуопределенной.

Симметричная матрица является положительно определенной тогда и только тогда, когда все ее собственные значения положительны, то есть матрица является положительно полуопределенной и обратимой. [31] Таблица справа показывает две возможности для матриц 2 на 2.

Разрешение вместо этого использовать два разных вектора в качестве входных данных приводит к билинейной форме, связанной с A : [32]

В случае комплексных матриц применяются та же терминология и результат, при этом симметричная матрица , квадратичная форма , билинейная форма и транспонированная x T заменяются соответственно эрмитовой матрицей , эрмитовой формой , полуторалинейной формой и сопряженной транспонированной x H .

Ортогональная матрица — это квадратная матрица с вещественными элементами, столбцы и строки которой являются ортогональными единичными векторами (то есть ортонормальными векторами). Эквивалентно, матрица A является ортогональной, если ее транспонирование равно ее инверсии :

что влечет за собой

где I n — единичная матрица размера n .

Ортогональная матрица A обязательно обратима (с обратным A −1 = A T ), унитарна ( A −1 = A * ) и нормальна ( A * A = AA * ). Определитель любой ортогональной матрицы равен либо +1 , либо −1 . Специальная ортогональная матрица — это ортогональная матрица с определителем +1. Как линейное преобразование , каждая ортогональная матрица с определителем +1 является чистым поворотом без отражения, т. е. преобразование сохраняет ориентацию преобразованной структуры, в то время как каждая ортогональная матрица с определителем -1 меняет ориентацию на обратную, т. е. является композицией чистого отражения и (возможно, нулевого) поворота. Единичные матрицы имеют определитель 1 и являются чистыми поворотами на нулевой угол.

Комплексным аналогом ортогональной матрицы является унитарная матрица .

След , tr( A ) квадратной матрицы A — это сумма ее диагональных элементов. Хотя умножение матриц не является коммутативным, как упоминалось выше, след произведения двух матриц не зависит от порядка множителей:

Это следует непосредственно из определения умножения матриц:

Из этого следует, что след произведения более чем двух матриц не зависит от циклических перестановок матриц, однако это, как правило, не применяется для произвольных перестановок (например, tr( ABC ) ≠ tr( BAC ), в общем случае). Кроме того, след матрицы равен следу ее транспонированной матрицы, то есть,

The determinant of a square matrix A (denoted det(A) or |A|) is a number encoding certain properties of the matrix. A matrix is invertible if and only if its determinant is nonzero. Its absolute value equals the area (in R2) or volume (in R3) of the image of the unit square (or cube), while its sign corresponds to the orientation of the corresponding linear map: the determinant is positive if and only if the orientation is preserved.

The determinant of 2-by-2 matrices is given by

The determinant of 3-by-3 matrices involves 6 terms (rule of Sarrus). The more lengthy Leibniz formula generalizes these two formulae to all dimensions.[34]

The determinant of a product of square matrices equals the product of their determinants:

Adding a multiple of any row to another row, or a multiple of any column to another column does not change the determinant. Interchanging two rows or two columns affects the determinant by multiplying it by −1.[36] Using these operations, any matrix can be transformed to a lower (or upper) triangular matrix, and for such matrices, the determinant equals the product of the entries on the main diagonal; this provides a method to calculate the determinant of any matrix. Finally, the Laplace expansion expresses the determinant in terms of minors, that is, determinants of smaller matrices.[37] This expansion can be used for a recursive definition of determinants (taking as starting case the determinant of a 1-by-1 matrix, which is its unique entry, or even the determinant of a 0-by-0 matrix, which is 1), that can be seen to be equivalent to the Leibniz formula. Determinants can be used to solve linear systems using Cramer's rule, where the division of the determinants of two related square matrices equates to the value of each of the system's variables.[38]

A number and a non-zero vector v satisfying

are called an eigenvalue and an eigenvector of A, respectively.[39][40] The number λ is an eigenvalue of an n×n-matrix A if and only if A−λIn is not invertible, which is equivalent to

The polynomial pA in an indeterminate X given by evaluation of the determinant det(XIn−A) is called the characteristic polynomial of A. It is a monic polynomial of degree n. Therefore the polynomial equation pA(λ) = 0 has at most n different solutions, that is, eigenvalues of the matrix.[42] They may be complex even if the entries of A are real. According to the Cayley–Hamilton theorem, pA(A) = 0, that is, the result of substituting the matrix itself into its characteristic polynomial yields the zero matrix.

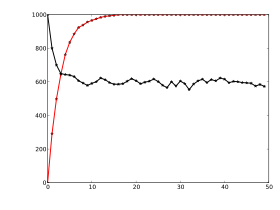

Matrix calculations can be often performed with different techniques. Many problems can be solved by both direct algorithms and iterative approaches. For example, the eigenvectors of a square matrix can be obtained by finding a sequence of vectors xn converging to an eigenvector when n tends to infinity.[43]

To choose the most appropriate algorithm for each specific problem, it is important to determine both the effectiveness and precision of all the available algorithms. The domain studying these matters is called numerical linear algebra.[44] As with other numerical situations, two main aspects are the complexity of algorithms and their numerical stability.

Determining the complexity of an algorithm means finding upper bounds or estimates of how many elementary operations such as additions and multiplications of scalars are necessary to perform some algorithm, for example, multiplication of matrices. Calculating the matrix product of two n-by-n matrices using the definition given above needs n3 multiplications, since for any of the n2 entries of the product, n multiplications are necessary. The Strassen algorithm outperforms this "naive" algorithm; it needs only n2.807 multiplications.[45] A refined approach also incorporates specific features of the computing devices.

In many practical situations, additional information about the matrices involved is known. An important case is sparse matrices, that is, matrices most of whose entries are zero. There are specifically adapted algorithms for, say, solving linear systems Ax = b for sparse matrices A, such as the conjugate gradient method.[46]

An algorithm is, roughly speaking, numerically stable if little deviations in the input values do not lead to big deviations in the result. For example, calculating the inverse of a matrix via Laplace expansion (adj(A) denotes the adjugate matrix of A)

may lead to significant rounding errors if the determinant of the matrix is very small. The norm of a matrix can be used to capture the conditioning of linear algebraic problems, such as computing a matrix's inverse.[47]

Most computer programming languages support arrays but are not designed with built-in commands for matrices. Instead, available external libraries provide matrix operations on arrays, in nearly all currently used programming languages. Matrix manipulation was among the earliest numerical applications of computers.[48] The original Dartmouth BASIC had built-in commands for matrix arithmetic on arrays from its second edition implementation in 1964. As early as the 1970s, some engineering desktop computers such as the HP 9830 had ROM cartridges to add BASIC commands for matrices. Some computer languages such as APL were designed to manipulate matrices, and various mathematical programs can be used to aid computing with matrices.[49] As of 2023, most computers have some form of built-in matrix operations at a low level implementing the standard BLAS specification, upon which most higher-level matrix and linear algebra libraries (e.g., EISPACK, LINPACK, LAPACK) rely. While most of these libraries require a professional level of coding, LAPACK can be accessed by higher-level (and user-friendly) bindings such as NumPy/SciPy, R, GNU Octave, MATLAB.

There are several methods to render matrices into a more easily accessible form. They are generally referred to as matrix decomposition or matrix factorization techniques. The interest of all these techniques is that they preserve certain properties of the matrices in question, such as determinant, rank, or inverse, so that these quantities can be calculated after applying the transformation, or that certain matrix operations are algorithmically easier to carry out for some types of matrices.

The LU decomposition factors matrices as a product of lower (L) and an upper triangular matrices (U).[50] Once this decomposition is calculated, linear systems can be solved more efficiently, by a simple technique called forward and back substitution. Likewise, inverses of triangular matrices are algorithmically easier to calculate. The Gaussian elimination is a similar algorithm; it transforms any matrix to row echelon form.[51] Both methods proceed by multiplying the matrix by suitable elementary matrices, which correspond to permuting rows or columns and adding multiples of one row to another row. Singular value decomposition expresses any matrix A as a product UDV∗, where U and V are unitary matrices and D is a diagonal matrix.

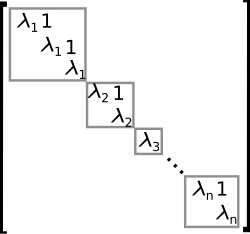

The eigendecomposition or diagonalization expresses A as a product VDV−1, where D is a diagonal matrix and V is a suitable invertible matrix.[52] If A can be written in this form, it is called diagonalizable. More generally, and applicable to all matrices, the Jordan decomposition transforms a matrix into Jordan normal form, that is to say matrices whose only nonzero entries are the eigenvalues λ1 to λn of A, placed on the main diagonal and possibly entries equal to one directly above the main diagonal, as shown at the right.[53] Given the eigendecomposition, the nth power of A (that is, n-fold iterated matrix multiplication) can be calculated via

and the power of a diagonal matrix can be calculated by taking the corresponding powers of the diagonal entries, which is much easier than doing the exponentiation for A instead. This can be used to compute the matrix exponential eA, a need frequently arising in solving linear differential equations, matrix logarithms and square roots of matrices.[54] To avoid numerically ill-conditioned situations, further algorithms such as the Schur decomposition can be employed.[55]

Matrices can be generalized in different ways. Abstract algebra uses matrices with entries in more general fields or even rings, while linear algebra codifies properties of matrices in the notion of linear maps. It is possible to consider matrices with infinitely many columns and rows. Another extension is tensors, which can be seen as higher-dimensional arrays of numbers, as opposed to vectors, which can often be realized as sequences of numbers, while matrices are rectangular or two-dimensional arrays of numbers.[56] Matrices, subject to certain requirements tend to form groups known as matrix groups. Similarly under certain conditions matrices form rings known as matrix rings. Though the product of matrices is not in general commutative certain matrices form fields known as matrix fields. In general, matrices and their multiplication also form a category, the category of matrices.

This article focuses on matrices whose entries are real or complex numbers. However, matrices can be considered with much more general types of entries than real or complex numbers. As a first step of generalization, any field, that is, a set where addition, subtraction, multiplication, and division operations are defined and well-behaved, may be used instead of R or C, for example rational numbers or finite fields. For example, coding theory makes use of matrices over finite fields. Wherever eigenvalues are considered, as these are roots of a polynomial they may exist only in a larger field than that of the entries of the matrix; for instance, they may be complex in the case of a matrix with real entries. The possibility to reinterpret the entries of a matrix as elements of a larger field (for example, to view a real matrix as a complex matrix whose entries happen to be all real) then allows considering each square matrix to possess a full set of eigenvalues. Alternatively one can consider only matrices with entries in an algebraically closed field, such as C, from the outset.

More generally, matrices with entries in a ring R are widely used in mathematics.[57] Rings are a more general notion than fields in that a division operation need not exist. The very same addition and multiplication operations of matrices extend to this setting, too. The set M(n, R) (also denoted Mn(R)[7]) of all square n-by-n matrices over R is a ring called matrix ring, isomorphic to the endomorphism ring of the left R-module Rn.[58] If the ring R is commutative, that is, its multiplication is commutative, then the ring M(n, R) is also an associative algebra over R. The determinant of square matrices over a commutative ring R can still be defined using the Leibniz formula; such a matrix is invertible if and only if its determinant is invertible in R, generalizing the situation over a field F, where every nonzero element is invertible.[59] Matrices over superrings are called supermatrices.[60]

Matrices do not always have all their entries in the same ring – or even in any ring at all. One special but common case is block matrices, which may be considered as matrices whose entries themselves are matrices. The entries need not be square matrices, and thus need not be members of any ring; but their sizes must fulfill certain compatibility conditions.

Linear maps Rn → Rm are equivalent to m-by-n matrices, as described above. More generally, any linear map f: V → W between finite-dimensional vector spaces can be described by a matrix A = (aij), after choosing bases v1, ..., vn of V, and w1, ..., wm of W (so n is the dimension of V and m is the dimension of W), which is such that

In other words, column j of A expresses the image of vj in terms of the basis vectors w I of W; thus this relation uniquely determines the entries of the matrix A. The matrix depends on the choice of the bases: different choices of bases give rise to different, but equivalent matrices.[61] Many of the above concrete notions can be reinterpreted in this light, for example, the transpose matrix AT describes the transpose of the linear map given by A, concerning the dual bases.[62]

These properties can be restated more naturally: the category of matrices with entries in a field with multiplication as composition is equivalent to the category of finite-dimensional vector spaces and linear maps over this field.[63]

More generally, the set of m×n matrices can be used to represent the R-linear maps between the free modules Rm and Rn for an arbitrary ring R with unity. When n = m composition of these maps is possible, and this gives rise to the matrix ring of n×n matrices representing the endomorphism ring of Rn.

A group is a mathematical structure consisting of a set of objects together with a binary operation, that is, an operation combining any two objects to a third, subject to certain requirements.[64] A group in which the objects are matrices and the group operation is matrix multiplication is called a matrix group.[65][66] Since a group of every element must be invertible, the most general matrix groups are the groups of all invertible matrices of a given size, called the general linear groups.

Any property of matrices that is preserved under matrix products and inverses can be used to define further matrix groups. For example, matrices with a given size and with a determinant of 1 form a subgroup of (that is, a smaller group contained in) their general linear group, called a special linear group.[67] Orthogonal matrices, determined by the condition

form the orthogonal group.[68] Every orthogonal matrix has determinant 1 or −1. Orthogonal matrices with determinant 1 form a subgroup called special orthogonal group.

Every finite group is isomorphic to a matrix group, as one can see by considering the regular representation of the symmetric group.[69] General groups can be studied using matrix groups, which are comparatively well understood, using representation theory.[70]

It is also possible to consider matrices with infinitely many rows and/or columns[71] even though, being infinite objects, one cannot write down such matrices explicitly. All that matters is that for every element in the set indexing rows, and every element in the set indexing columns, there is a well-defined entry (these index sets need not even be subsets of the natural numbers). The basic operations of addition, subtraction, scalar multiplication, and transposition can still be defined without problem; however, matrix multiplication may involve infinite summations to define the resulting entries, and these are not defined in general.

If R is any ring with unity, then the ring of endomorphisms of as a right R module is isomorphic to the ring of column finite matrices whose entries are indexed by , and whose columns each contain only finitely many nonzero entries. The endomorphisms of M considered as a left R module result in an analogous object, the row finite matrices whose rows each only have finitely many nonzero entries.

If infinite matrices are used to describe linear maps, then only those matrices can be used all of whose columns have but a finite number of nonzero entries, for the following reason. For a matrix A to describe a linear map f: V→W, bases for both spaces must have been chosen; recall that by definition this means that every vector in the space can be written uniquely as a (finite) linear combination of basis vectors, so that written as a (column) vector ve of coefficients, only finitely many entries v I are nonzero. Now the columns of A describe the images by f of individual basis vectors of V in the basis of W, which is only meaningful if these columns have only finitely many nonzero entries. There is no restriction on the rows of A however: in the product A·v there are only finitely many nonzero coefficients of v involved, so every one of its entries, even if it is given as an infinite sum of products, involves only finitely many nonzero terms and is therefore well defined. Moreover, this amounts to forming a linear combination of the columns of A that effectively involves only finitely many of them, whence the result has only finitely many nonzero entries because each of those columns does. Products of two matrices of the given type are well defined (provided that the column-index and row-index sets match), are of the same type, and correspond to the composition of linear maps.

If R is a normed ring, then the condition of row or column finiteness can be relaxed. With the norm in place, absolutely convergent series can be used instead of finite sums. For example, the matrices whose column sums are convergent sequences form a ring. Analogously, the matrices whose row sums are convergent series also form a ring.

Infinite matrices can also be used to describe operators on Hilbert spaces, where convergence and continuity questions arise, which again results in certain constraints that must be imposed. However, the explicit point of view of matrices tends to obfuscate the matter,[72] and the abstract and more powerful tools of functional analysis can be used instead.

An empty matrix is a matrix in which the number of rows or columns (or both) is zero.[73][74] Empty matrices help to deal with maps involving the zero vector space. For example, if A is a 3-by-0 matrix and B is a 0-by-3 matrix, then AB is the 3-by-3 zero matrix corresponding to the null map from a 3-dimensional space V to itself, while BA is a 0-by-0 matrix. There is no common notation for empty matrices, but most computer algebra systems allow creating and computing with them. The determinant of the 0-by-0 matrix is 1 as follows regarding the empty product occurring in the Leibniz formula for the determinant as 1. This value is also consistent with the fact that the identity map from any finite-dimensional space to itself has determinant 1, a fact that is often used as a part of the characterization of determinants.

There are numerous applications of matrices, both in mathematics and other sciences. Some of them merely take advantage of the compact representation of a set of numbers in a matrix. For example, in game theory and economics, the payoff matrix encodes the payoff for two players, depending on which out of a given (finite) set of strategies the players choose.[75] Text mining and automated thesaurus compilation makes use of document-term matrices such as tf-idf to track frequencies of certain words in several documents.[76]

Complex numbers can be represented by particular real 2-by-2 matrices via

under which addition and multiplication of complex numbers and matrices correspond to each other. For example, 2-by-2 rotation matrices represent the multiplication with some complex number of absolute value 1, as above. A similar interpretation is possible for quaternions[77] and Clifford algebras in general.

Early encryption techniques such as the Hill cipher also used matrices. However, due to the linear nature of matrices, these codes are comparatively easy to break.[78] Computer graphics uses matrices to represent objects; to calculate transformations of objects using affine rotation matrices to accomplish tasks such as projecting a three-dimensional object onto a two-dimensional screen, corresponding to a theoretical camera observation; and to apply image convolutions such as sharpening, blurring, edge detection, and more.[79] Matrices over a polynomial ring are important in the study of control theory.

Chemistry makes use of matrices in various ways, particularly since the use of quantum theory to discuss molecular bonding and spectroscopy. Examples are the overlap matrix and the Fock matrix used in solving the Roothaan equations to obtain the molecular orbitals of the Hartree–Fock method.

The adjacency matrix of a finite graph is a basic notion of graph theory.[80] It records which vertices of the graph are connected by an edge. Matrices containing just two different values (1 and 0 meaning for example "yes" and "no", respectively) are called logical matrices. The distance (or cost) matrix contains information about the distances of the edges.[81] These concepts can be applied to websites connected by hyperlinks or cities connected by roads etc., in which case (unless the connection network is extremely dense) the matrices tend to be sparse, that is, contain few nonzero entries. Therefore, specifically tailored matrix algorithms can be used in network theory.

The Hessian matrix of a differentiable function ƒ: Rn → R consists of the second derivatives of ƒ concerning the several coordinate directions, that is,[82]

It encodes information about the local growth behavior of the function: given a critical point x = (x1, ..., xn), that is, a point where the first partial derivatives of ƒ vanish, the function has a local minimum if the Hessian matrix is positive definite. Quadratic programming can be used to find global minima or maxima of quadratic functions closely related to the ones attached to matrices (see above).[83]

Another matrix frequently used in geometrical situations is the Jacobi matrix of a differentiable map f: Rn → Rm. If f1, ..., fm denote the components of f, then the Jacobi matrix is defined as[84]

If n > m, and if the rank of the Jacobi matrix attains its maximal value m, f is locally invertible at that point, by the implicit function theorem.[85]

Partial differential equations can be classified by considering the matrix of coefficients of the highest-order differential operators of the equation. For elliptic partial differential equations this matrix is positive definite, which has a decisive influence on the set of possible solutions of the equation in question.[86]

The finite element method is an important numerical method to solve partial differential equations, widely applied in simulating complex physical systems. It attempts to approximate the solution to some equation by piecewise linear functions, where the pieces are chosen concerning a sufficiently fine grid, which in turn can be recast as a matrix equation.[87]

Stochastic matrices are square matrices whose rows are probability vectors, that is, whose entries are non-negative and sum up to one. Stochastic matrices are used to define Markov chains with finitely many states.[88] A row of the stochastic matrix gives the probability distribution for the next position of some particle currently in the state that corresponds to the row. Properties of the Markov chain-like absorbing states, that is, states that any particle attains eventually, can be read off the eigenvectors of the transition matrices.[89]

Statistics also makes use of matrices in many different forms.[90] Descriptive statistics is concerned with describing data sets, which can often be represented as data matrices, which may then be subjected to dimensionality reduction techniques. The covariance matrix encodes the mutual variance of several random variables.[91] Another technique using matrices are linear least squares, a method that approximates a finite set of pairs (x1, y1), (x2, y2), ..., (x N, y N), by a linear function

which can be formulated in terms of matrices, related to the singular value decomposition of matrices.[92]

Random matrices are matrices whose entries are random numbers, subject to suitable probability distributions, such as matrix normal distribution. Beyond probability theory, they are applied in domains ranging from number theory to physics.[93][94]

Linear transformations and the associated symmetries play a key role in modern physics. For example, elementary particles in quantum field theory are classified as representations of the Lorentz group of special relativity and, more specifically, by their behavior under the spin group. Concrete representations involving the Pauli matrices and more general gamma matrices are an integral part of the physical description of fermions, which behave as spinors.[95] For the three lightest quarks, there is a group-theoretical representation involving the special unitary group SU(3); for their calculations, physicists use a convenient matrix representation known as the Gell-Mann matrices, which are also used for the SU(3) gauge group that forms the basis of the modern description of strong nuclear interactions, quantum chromodynamics. The Cabibbo–Kobayashi–Maskawa matrix, in turn, expresses the fact that the basic quark states that are important for weak interactions are not the same as, but linearly related to the basic quark states that define particles with specific and distinct masses.[96]

The first model of quantum mechanics (Heisenberg, 1925) represented the theory's operators by infinite-dimensional matrices acting on quantum states.[97] This is also referred to as matrix mechanics. One particular example is the density matrix that characterizes the "mixed" state of a quantum system as a linear combination of elementary, "pure" eigenstates.[98]

Another matrix serves as a key tool for describing the scattering experiments that form the cornerstone of experimental particle physics: Collision reactions such as occur in particle accelerators, where non-interacting particles head towards each other and collide in a small interaction zone, with a new set of non-interacting particles as the result, can be described as the scalar product of outgoing particle states and a linear combination of ingoing particle states. The linear combination is given by a matrix known as the S-matrix, which encodes all information about the possible interactions between particles.[99]

A general application of matrices in physics is the description of linearly coupled harmonic systems. The equations of motion of such systems can be described in matrix form, with a mass matrix multiplying a generalized velocity to give the kinetic term, and a force matrix multiplying a displacement vector to characterize the interactions. The best way to obtain solutions is to determine the system's eigenvectors, its normal modes, by diagonalizing the matrix equation. Techniques like this are crucial when it comes to the internal dynamics of molecules: the internal vibrations of systems consisting of mutually bound component atoms.[100] They are also needed for describing mechanical vibrations, and oscillations in electrical circuits.[101]

Geometrical optics provides further matrix applications. In this approximative theory, the wave nature of light is neglected. The result is a model in which light rays are indeed geometrical rays. If the deflection of light rays by optical elements is small, the action of a lens or reflective element on a given light ray can be expressed as multiplication of a two-component vector with a two-by-two matrix called ray transfer matrix analysis: the vector's components are the light ray's slope and its distance from the optical axis, while the matrix encodes the properties of the optical element. There are two kinds of matrices, viz. a refraction matrix describing the refraction at a lens surface, and a translation matrix, describing the translation of the plane of reference to the next refracting surface, where another refraction matrix applies. The optical system, consisting of a combination of lenses and/or reflective elements, is simply described by the matrix resulting from the product of the components' matrices.[102]

Traditional mesh analysis and nodal analysis in electronics lead to a system of linear equations that can be described with a matrix.

The behavior of many electronic components can be described using matrices. Let A be a 2-dimensional vector with the component's input voltage v1 and input current I1 as its elements, and let B be a 2-dimensional vector with the component's output voltage v2 and output current I2 as its elements. Then the behavior of the electronic component can be described by B = H · A, where H is a 2 x 2 matrix containing one impedance element (h12), one admittance element (h21), and two dimensionless elements (h11 and h22). Calculating a circuit now reduces to multiplying matrices.

Matrices have a long history of application in solving linear equations but they were known as arrays until the 1800s. The Chinese text The Nine Chapters on the Mathematical Art written in the 10th–2nd century BCE is the first example of the use of array methods to solve simultaneous equations,[103] including the concept of determinants. In 1545 Italian mathematician Gerolamo Cardano introduced the method to Europe when he published Ars Magna.[104] The Japanese mathematician Seki used the same array methods to solve simultaneous equations in 1683.[105] The Dutch mathematician Jan de Witt represented transformations using arrays in his 1659 book Elements of Curves (1659).[106] Between 1700 and 1710 Gottfried Wilhelm Leibniz publicized the use of arrays for recording information or solutions and experimented with over 50 different systems of arrays.[104] Cramer presented his rule in 1750.

The term "matrix" (Latin for "womb", "dam" (non-human female animal kept for breeding), "source", "origin", "list", and "register", are derived from mater—mother[107]) was coined by James Joseph Sylvester in 1850,[108] who understood a matrix as an object giving rise to several determinants today called minors, that is to say, determinants of smaller matrices that derive from the original one by removing columns and rows. In an 1851 paper, Sylvester explains:[109]

I have in previous papers defined a "Matrix" as a rectangular array of terms, out of which different systems of determinants may be engendered from the womb of a common parent.

Arthur Cayley published a treatise on geometric transformations using matrices that were not rotated versions of the coefficients being investigated as had previously been done. Instead, he defined operations such as addition, subtraction, multiplication, and division as transformations of those matrices and showed the associative and distributive properties held. Cayley investigated and demonstrated the non-commutative property of matrix multiplication as well as the commutative property of matrix addition.[104] Early matrix theory had limited the use of arrays almost exclusively to determinants and Arthur Cayley's abstract matrix operations were revolutionary. He was instrumental in proposing a matrix concept independent of equation systems. In 1858 Cayley published his A memoir on the theory of matrices[110][111] in which he proposed and demonstrated the Cayley–Hamilton theorem.[104]

The English mathematician Cuthbert Edmund Cullis was the first to use modern bracket notation for matrices in 1913 and he simultaneously demonstrated the first significant use of the notation A = [a I,j] to represent a matrix where a I,j refers to the ith row and the jth column.[104]

The modern study of determinants sprang from several sources.[112] Number-theoretical problems led Gauss to relate coefficients of quadratic forms, that is, expressions such as x2 + xy − 2y2, and linear maps in three dimensions to matrices. Eisenstein further developed these notions, including the remark that, in modern parlance, matrix products are non-commutative. Cauchy was the first to prove general statements about determinants, using as the definition of the determinant of a matrix A = [a i,j] the following: replace the powers ajk by a jk in the polynomial

where denotes the product of the indicated terms. He also showed, in 1829, that the eigenvalues of symmetric matrices are real.[113] Jacobi studied "functional determinants"—later called Jacobi determinants by Sylvester—which can be used to describe geometric transformations at a local (or infinitesimal) level, see above. Kronecker's Vorlesungen über die Theorie der Determinanten[114] and Weierstrass' Zur Determinantentheorie,[115] both published in 1903, first treated determinants axiomatically, as opposed to previous more concrete approaches such as the mentioned formula of Cauchy. At that point, determinants were firmly established.

Many theorems were first established for small matrices only, for example, the Cayley–Hamilton theorem was proved for 2×2 matrices by Cayley in the aforementioned memoir, and by Hamilton for 4×4 matrices. Frobenius, working on bilinear forms, generalized the theorem to all dimensions (1898). Also at the end of the 19th century, the Gauss–Jordan elimination (generalizing a special case now known as Gauss elimination) was established by Wilhelm Jordan. In the early 20th century, matrices attained a central role in linear algebra,[116] partially due to their use in the classification of the hypercomplex number systems of the previous century.

The inception of matrix mechanics by Heisenberg, Born and Jordan led to studying matrices with infinitely many rows and columns.[117] Later, von Neumann carried out the mathematical formulation of quantum mechanics, by further developing functional analytic notions such as linear operators on Hilbert spaces, which, very roughly speaking, correspond to Euclidean space, but with an infinity of independent directions.

The word has been used in unusual ways by at least two authors of historical importance.

Bertrand Russell and Alfred North Whitehead in their Principia Mathematica (1910–1913) use the word "matrix" in the context of their axiom of reducibility. They proposed this axiom as a means to reduce any function to one of lower type, successively, so that at the "bottom" (0 order) the function is identical to its extension:[118]

Let us give the name of matrix to any function, of however many variables, that does not involve any apparent variables. Then, any possible function other than a matrix derives from a matrix using generalization, that is, by considering the proposition that the function in question is true with all possible values or with some value of one of the arguments, the other argument or arguments remaining undetermined.

For example, a function Φ(x, y) of two variables x and y can be reduced to a collection of functions of a single variable, for example, y, by "considering" the function for all possible values of "individuals" ai substituted in place of a variable x. And then the resulting collection of functions of the single variable y, that is, ∀ai: Φ(ai, y), can be reduced to a "matrix" of values by "considering" the function for all possible values of "individuals" bi substituted in place of variable y:

Alfred Tarski in his 1946 Introduction to Logic used the word "matrix" synonymously with the notion of truth table as used in mathematical logic.[119]

{{citation}}: CS1 maint: unfit URL (link)