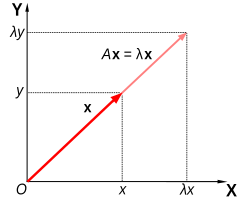

В линейной алгебре часто важно знать, направления каких векторов не изменяются при линейном преобразовании . Таким вектором является собственный вектор ( / ˈ aɪ ɡ ən -/ EYE -gən- ) или характеристический вектор . Таким образом, собственный вектор линейного преобразования масштабируется с постоянным коэффициентом , когда к нему применяется линейное преобразование: . Соответствующее собственное значение , характеристическое значение или характеристический корень является умножающим фактором .

Геометрически векторы представляют собой многомерные величины с величиной и направлением, часто изображаемые в виде стрелок. Линейное преобразование вращает , растягивает или сдвигает векторы, на которые оно воздействует. Его собственные векторы — это те векторы, которые только растянуты, без вращения или сдвига. Соответствующее собственное значение — это коэффициент, на который собственный вектор растягивается или сжимается. Если собственное значение отрицательное, направление собственного вектора меняется на противоположное. [1]

Собственные векторы и собственные значения преобразования служат для его характеристики и поэтому играют важную роль во всех областях применения линейной алгебры, от геологии до квантовой механики . В частности, часто бывает так, что система представлена линейным преобразованием, выходные данные которого подаются в качестве входных данных на одни и те же входные данные ( обратная связь ). В таком приложении наибольшее собственное значение имеет особое значение, поскольку оно определяет долгосрочное поведение системы после многих применений линейного преобразования, а соответствующий собственный вектор представляет собой устойчивое состояние системы.

Если T — линейное преобразование векторного пространства V над полем F в себя, а v — ненулевой вектор в V , то v — собственный вектор T , если T ( v ) — скаляр, кратный v . [2] Это можно записать как

Существует прямая связь между квадратными матрицами размером n × n и линейными преобразованиями из n -мерного векторного пространства в себя при любом базисе векторного пространства. Следовательно, в конечномерном векторном пространстве эквивалентно определять собственные значения и собственные векторы, используя либо язык матриц , либо язык линейных преобразований. [3] [4]

Если V конечномерно, приведенное выше уравнение эквивалентно [5]

где A — матричное представление T , а u — координатный вектор v .

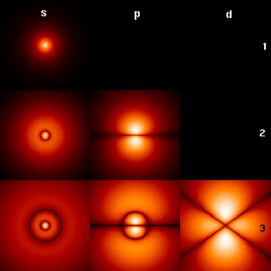

Собственные значения и собственные векторы играют важную роль при анализе линейных преобразований. Приставка eigen- заимствована из немецкого слова eigen ( родственного английскому слову own ) , означающего «собственный», «характерный», «собственный». [6] [7] Первоначально используемые для изучения главных осей вращательного движения твердых тел , собственные значения и собственные векторы имеют широкий спектр применений, например, в анализе устойчивости , анализе вибрации , атомных орбиталях , распознавании лиц и диагонализации матриц .

По сути, собственный вектор v линейного преобразования T — это ненулевой вектор, который при применении к нему T не меняет направления. Применение T к собственному вектору масштабирует собственный вектор только на скалярное значение λ , называемое собственным значением. Это условие можно записать в виде уравнения

Пример Моны Лизы , изображенный здесь, представляет собой простую иллюстрацию. Каждую точку на картине можно представить в виде вектора, указывающего из центра картины на эту точку. Линейное преобразование в этом примере называется отображением сдвига . Точки в верхней половине перемещаются вправо, а точки в нижней половине — влево пропорционально тому, насколько далеко они находятся от горизонтальной оси, проходящей через середину картины. Поэтому векторы, указывающие на каждую точку исходного изображения, наклоняются вправо или влево и в результате преобразования становятся длиннее или короче. Точки вдоль горизонтальной оси вообще не перемещаются при применении этого преобразования. Следовательно, любой вектор, указывающий прямо вправо или влево без вертикальной составляющей, является собственным вектором этого преобразования, поскольку отображение не меняет своего направления. Более того, все эти собственные векторы имеют собственное значение, равное единице, поскольку отображение также не меняет их длину.

Линейные преобразования могут принимать множество различных форм, отображая векторы в различных векторных пространствах, поэтому собственные векторы также могут принимать множество форм. Например, линейное преобразование может быть дифференциальным оператором типа , и в этом случае собственные векторы представляют собой функции, называемые собственными функциями , которые масштабируются этим дифференциальным оператором, например

Собственные значения и собственные векторы порождают множество тесно связанных математических понятий, и при их названии широко применяется префикс «собственный-» :

Собственные значения часто вводятся в контексте линейной алгебры или теории матриц . Однако исторически они возникли при изучении квадратных форм и дифференциальных уравнений .

В 18 веке Леонард Эйлер изучал вращательное движение твердого тела и обнаружил важность главных осей . [а] Жозеф-Луи Лагранж понял, что главные оси являются собственными векторами матрицы инерции. [11]

В начале 19 века Огюстен-Луи Коши увидел, как их работу можно использовать для классификации квадратичных поверхностей , и обобщил ее на произвольные размеры. [12] Коши также ввел термин racine caractéristique (характеристический корень) для того, что сейчас называется собственным значением ; его член сохраняется в характеристическом уравнении . [б]

Позже Жозеф Фурье использовал работы Лагранжа и Пьера-Симона Лапласа для решения уравнения теплопроводности путем разделения переменных в своей знаменитой книге 1822 года «Аналитическая теория де ла шалёр ». [13] Шарль-Франсуа Штурм развил идеи Фурье и представил их вниманию Коши, который объединил их со своими собственными идеями и пришел к тому факту, что реальные симметричные матрицы имеют действительные собственные значения. [12] Это было расширено Чарльзом Эрмитом в 1855 году до того, что сейчас называется эрмитовыми матрицами . [14]

Примерно в то же время Франческо Бриоски доказал, что собственные значения ортогональных матриц лежат на единичной окружности , [12] и Альфред Клебш нашел соответствующий результат для кососимметричных матриц . [14] Наконец, Карл Вейерштрасс прояснил важный аспект теории устойчивости , начатой Лапласом, осознав, что дефектные матрицы могут вызвать нестабильность. [12]

Тем временем Джозеф Лиувилл изучал проблемы собственных значений, аналогичные проблемам Штурма; дисциплина, выросшая из их работ, теперь называется теорией Штурма-Лиувилля . [15] Шварц изучал первое собственное значение уравнения Лапласа в общих областях в конце 19 века, а Пуанкаре изучал уравнение Пуассона несколько лет спустя. [16]

В начале 20-го века Дэвид Гильберт изучал собственные значения интегральных операторов , рассматривая операторы как бесконечные матрицы. [17] Он был первым, кто использовал немецкое слово eigen , что означает «собственный», [7] для обозначения собственных значений и собственных векторов в 1904 году, [c] хотя он, возможно, следовал родственному использованию Германа фон Гельмгольца . Некоторое время стандартным термином в английском языке было «собственное значение», но сегодня стандартом является более отличительный термин «собственное значение». [18]

Первый численный алгоритм вычисления собственных значений и собственных векторов появился в 1929 году, когда Рихард фон Мизес опубликовал степенной метод . Один из самых популярных сегодня методов, QR-алгоритм , был независимо предложен Джоном Фрэнсисом [19] и Верой Кублановской [20] в 1961 году. [21] [22]

Собственные значения и собственные векторы часто знакомятся студентам в контексте курсов линейной алгебры, посвященных матрицам. [23] [24] Кроме того, линейные преобразования в конечномерном векторном пространстве могут быть представлены с помощью матриц, [3] [4] что особенно распространено в числовых и вычислительных приложениях. [25]

Рассмотрим n -мерные векторы, которые формируются в виде списка из n скаляров, например трехмерные векторы

Говорят, что эти векторы скалярно кратны друг другу, параллельны или коллинеарны , если существует скаляр λ такой, что

В этом случае, .

Теперь рассмотрим линейное преобразование n -мерных векторов, определяемых матрицей A размером n на n ,

Если окажется, что v и w являются скалярными кратными, то есть если

тогда v — собственный вектор линейного преобразования A , а масштабный коэффициент λ — это собственное значение , соответствующее этому собственному вектору. Уравнение ( 1 ) является уравнением собственных значений матрицы A.

Уравнение ( 1 ) можно эквивалентно сформулировать как

где I — единичная матрица размера n на n , а 0 — нулевой вектор.

Уравнение ( 2 ) имеет ненулевое решение v тогда и только тогда, когда определитель матрицы ( A − λI ) равен нулю . Следовательно, собственные значения A являются значениями λ , которые удовлетворяют уравнению

Используя формулу Лейбница для определителей , левая часть уравнения ( 3 ) представляет собой полиномиальную функцию переменной λ , а степень этого многочлена равна n , порядку матрицы A. Его коэффициенты зависят от элементов A , за исключением того, что его член степени n всегда равен (−1) n λ n . Этот многочлен называется характеристическим многочленом A . Уравнение ( 3 ) называется характеристическим уравнением или вековым уравнением A.

Фундаментальная теорема алгебры подразумевает, что характеристический многочлен матрицы A размером n x n , являющийся многочленом степени n , может быть разложен в произведение n линейных членов:

где каждое λ i может быть вещественным, но, как правило, является комплексным числом. Числа λ 1 , λ 2 , ..., λ n , которые не все могут иметь разные значения, являются корнями многочлена и собственными значениями A .

В качестве краткого примера, который более подробно описан ниже в разделе примеров, рассмотрим матрицу

Взяв определитель ( A − λI ) , характеристический полином A равен

Приравнивая характеристический полином к нулю, он имеет корни в точках λ=1 и λ=3 , которые являются двумя собственными значениями A . Собственные векторы, соответствующие каждому собственному значению, можно найти, решив компоненты v в уравнении . В этом примере собственными векторами являются любые ненулевые скалярные кратные

Если все элементы матрицы A являются действительными числами, то коэффициенты характеристического многочлена также будут действительными числами, но собственные значения могут по-прежнему иметь ненулевые мнимые части. Поэтому элементы соответствующих собственных векторов также могут иметь ненулевые мнимые части. Точно так же собственные значения могут быть иррациональными числами , даже если все элементы A являются рациональными числами или даже если они все целые числа. Однако, если все элементы A являются алгебраическими числами , включая рациональные числа, собственные значения также должны быть алгебраическими числами (то есть они не могут волшебным образом стать трансцендентными числами ).

Невещественные корни вещественного многочлена с действительными коэффициентами можно сгруппировать в пары комплексно-сопряженных чисел , а именно, при этом два члена каждой пары имеют мнимые части, различающиеся только знаком, и одну и ту же действительную часть. Если степень нечетная, то по теореме о промежуточном значении хотя бы один из корней вещественный. Следовательно, любая действительная матрица нечетного порядка имеет хотя бы одно вещественное собственное значение, тогда как действительная матрица четного порядка может не иметь действительных собственных значений. Собственные векторы, связанные с этими комплексными собственными значениями, также являются комплексными и также появляются в комплексно-сопряженных парах.

Пусть λ i — собственное значение матрицы A размером n × n . Алгебраическая кратность µ A ( λ i ) собственного значения — это его кратность как корня характеристического многочлена, то есть наибольшее целое число k такое, что ( λ − λ i ) k делит этот многочлен нацело. [10] [26] [27]

Предположим, что матрица A имеет размерность n и d ≤ n различных собственных значений. В то время как уравнение ( 4 ) разлагает характеристический полином A на произведение n линейных членов с некоторыми потенциально повторяющимися членами, характеристический полином вместо этого может быть записан как произведение d членов, каждый из которых соответствует отдельному собственному значению и возведен в степень алгебраическая кратность,

Если d = n , то правая часть представляет собой произведение n линейных членов, и это то же самое, что уравнение ( 4 ). Размер алгебраической кратности каждого собственного значения связан с размерностью n как

Если µ A ( λ i ) = 1, то λ i называется простым собственным значением . [27] Если µ A ( λ i ) равно геометрической кратности λ i , γ A ( λ i ), определенной в следующем разделе, то λ i называется полупростым собственным значением .

Учитывая конкретное собственное значение λ матрицы A n x n , определите набор E как все векторы v , которые удовлетворяют уравнению ( 2 ),

С одной стороны, это множество является в точности ядром или нулевым пространством матрицы ( A − λI ). С другой стороны, по определению любой ненулевой вектор, удовлетворяющий этому условию, является собственным вектором A , связанным с λ . Итак, множество E представляет собой объединение нулевого вектора с набором всех собственных векторов A , связанных с λ , а E равно нулевому пространству ( A − λI ). E называется собственным пространством или характеристическим пространством A , связанным с λ . [28] [10] В общем случае λ — комплексное число, а собственные векторы представляют собой комплексные матрицы n на 1. Свойством нуль-пространства является то, что оно является линейным подпространством , поэтому E является линейным подпространством .

Поскольку собственное пространство E является линейным подпространством, оно замкнуто относительно сложения. То есть, если два вектора u и v принадлежат множеству E , записанные u , v ∈ E , то ( u + v ) ∈ E или, что эквивалентно, A ( u + v ) = λ ( u + v ) . Это можно проверить, используя распределительное свойство умножения матриц. Аналогично, поскольку E — линейное подпространство, оно замкнуто относительно скалярного умножения. То есть, если v ∈ E и α — комплексное число, ( α v ) ∈ E или, что то же самое, A ( α v ) = λ ( α v ) . В этом можно убедиться, заметив, что умножение комплексных матриц на комплексные числа коммутативно . Пока u + v и α v не равны нулю, они также являются собственными векторами A , связанными с λ .

Размерность собственного пространства E , связанного с λ , или, что эквивалентно, максимальное количество линейно независимых собственных векторов, связанных с λ , называется геометрической кратностью собственного значения . Поскольку E также является нулевым пространством ( A − λI ), геометрическая кратность λ является размерностью нулевого пространства ( A − λI ), также называемого нулевым пространством ( A − λI ), которое относится к размерности и рангу ( A − λI ) как

Из-за определения собственных значений и собственных векторов геометрическая кратность собственного значения должна быть не менее одной, то есть каждое собственное значение имеет хотя бы один связанный с ним собственный вектор. Более того, геометрическая кратность собственного значения не может превышать его алгебраическую кратность. Кроме того, напомним, что алгебраическая кратность собственного значения не может превышать n .

Чтобы доказать неравенство , рассмотрим, как из определения геометрической кратности следует существование ортонормированных собственных векторов , таких, что . Таким образом, мы можем найти (унитарную) матрицу , первые столбцы которой являются этими собственными векторами, а остальные столбцы могут быть любым ортонормированным набором векторов, ортогональных этим собственным векторам матрицы . Тогда имеет полный ранг и, следовательно, обратимо. Вычислив , мы получаем матрицу, верхний левый блок которой является диагональной матрицей . В этом можно убедиться, оценив, что левая часть делает с базисными векторами первого столбца. Реорганизуя и добавляя с обеих сторон, мы получаем , что . Другими словами, аналогично , и . Но из определения мы знаем, что содержит фактор , а это означает, что алгебраическая кратность должна удовлетворять .

Пусть имеет различные собственные значения , где геометрическая кратность равна . Полная геометрическая кратность ,

Пусть – произвольная матрица комплексных чисел с собственными значениями . Каждое собственное значение появляется в этом списке несколько раз, где — алгебраическая кратность собственного значения. Ниже приведены свойства этой матрицы и ее собственных значений:

Во многих дисциплинах векторы традиционно представляются в виде матриц с одним столбцом, а не в виде матриц с одной строкой. По этой причине слово «собственный вектор» в контексте матриц почти всегда относится к правому собственному вектору , а именно к вектору- столбцу , который умножает вправо матрицу в определяющем уравнении, уравнении ( 1 ),

Проблема собственных значений и собственных векторов также может быть определена для векторов- строок , которые оставили умножить матрицу . В этой формулировке определяющим уравнением является

где – скаляр, – матрица. Любой вектор-строка , удовлетворяющий этому уравнению, называется левым собственным вектором и является связанным с ним собственным значением. Транспонируя это уравнение,

Сравнивая это уравнение с уравнением ( 1 ), сразу следует, что левый собственный вектор совпадает с транспонированным правым собственным вектором с тем же собственным значением. Более того, поскольку характеристический многочлен совпадает с характеристическим полиномом , левый и правый собственные векторы связаны с одними и теми же собственными значениями.

Предположим, что собственные векторы A образуют базис, или, что то же самое, A имеет n линейно независимых собственных векторов v 1 , v 2 , ..., v n с соответствующими собственными значениями λ 1 , λ 2 , ..., λ n . Собственные значения не обязательно должны быть различными. Определите квадратную матрицу Q , столбцы которой представляют собой n линейно независимых собственных векторов A ,

Поскольку каждый столбец Q является собственным вектором A , умножение A справа на Q масштабирует каждый столбец Q на соответствующее ему собственное значение,

Имея это в виду, определите диагональную матрицу Λ, где каждый диагональный элемент Λ ii является собственным значением, связанным с i- м столбцом Q . Затем

Поскольку столбцы Q линейно независимы, Q обратима. Умножив справа обе части уравнения на Q −1 ,

или вместо этого умножив обе части слева на Q −1 ,

Таким образом, A можно разложить на матрицу, состоящую из ее собственных векторов, диагональную матрицу с собственными значениями вдоль диагонали и обратную матрицу собственных векторов. Это называется собственным разложением и представляет собой преобразование подобия . Такая матрица A называется подобной диагональной матрице Λ или диагонализируемой . Матрица Q представляет собой замену базовой матрицы преобразования подобия. По сути, матрицы A и Λ представляют собой одно и то же линейное преобразование, выраженное в двух разных базисах. Собственные векторы используются в качестве основы при представлении линейного преобразования как Λ.

Обратно, предположим, что матрица A диагонализуема. Пусть P — неособая квадратная матрица такая, что P −1 AP — некоторая диагональная матрица D. Левое умножение обоих на P , AP = PD . Поэтому каждый столбец P должен быть собственным вектором A , собственное значение которого является соответствующим диагональным элементом D . Поскольку для того, чтобы P был обратимым, столбцы P должны быть линейно независимыми , существует n линейно независимых собственных векторов A . Отсюда следует, что собственные векторы A образуют базис тогда и только тогда, когда A диагонализуемо.

Матрица, не диагонализируемая, называется дефектной . Для дефектных матриц понятие собственных векторов обобщается до обобщенных собственных векторов , а диагональная матрица собственных значений обобщается до жордановой нормальной формы . Над алгебраически замкнутым полем любая матрица A имеет жорданову нормальную форму и, следовательно, допускает базис из обобщенных собственных векторов и разложение в обобщенные собственные пространства .

В эрмитовом случае собственным значениям можно дать вариационную характеристику. Наибольшее собственное значение является максимальным значением квадратичной формы . Значение, реализующее этот максимум, является собственным вектором.

Рассмотрим матрицу

На рисунке справа показано влияние этого преобразования на координаты точки на плоскости. Собственные векторы v этого преобразования удовлетворяют уравнению ( 1 ), а значения λ , для которых определитель матрицы ( A − λI ) равен нулю, являются собственными значениями.

Взяв определитель, чтобы найти характеристический полином A ,

Приравнивая характеристический полином к нулю, он имеет корни в точках λ =1 и λ =3 , которые являются двумя собственными значениями A .

Для λ =1 уравнение ( 2 ) принимает вид

Любой ненулевой вектор с v 1 = − v 2 решает это уравнение. Поэтому,

Для λ =3 уравнение ( 2 ) становится

Любой ненулевой вектор с v 1 = v 2 решает это уравнение. Поэтому,

является собственным вектором A , соответствующим λ = 3, как и любое скалярное кратное этого вектора.

Таким образом, векторы v λ =1 и v λ =3 являются собственными векторами оператора A , связанными с собственными значениями λ =1 и λ =3 соответственно.

Рассмотрим матрицу

Характеристический полином A равен

Корнями характеристического многочлена являются 2, 1 и 11, которые являются единственными тремя собственными значениями A . Эти собственные значения соответствуют собственным векторам , и или любому их ненулевому кратному.

Рассмотрим циклическую матрицу перестановок

Эта матрица сдвигает координаты вектора на одну позицию вверх и перемещает первую координату вниз. Его характеристический многочлен равен 1 − λ 3 , корни которого равны

Для вещественного собственного значения λ 1 = 1 любой вектор с тремя равными ненулевыми элементами является собственным вектором. Например,

Для комплексно-сопряженной пары мнимых собственных значений

Затем

Следовательно, два других собственных вектора A являются комплексными и имеют собственные значения λ 2 и λ 3 соответственно. Два комплексных собственных вектора также появляются в комплексно-сопряженной паре:

Матрицы с элементами только по главной диагонали называются диагональными матрицами . Собственные значения диагональной матрицы сами являются диагональными элементами. Рассмотрим матрицу

Характеристический полином A равен

который имеет корни λ 1 = 1 , λ 2 = 2 и λ 3 = 3 . Эти корни являются диагональными элементами, а также собственными значениями A .

Каждый диагональный элемент соответствует собственному вектору, единственный ненулевой компонент которого находится в той же строке, что и этот диагональный элемент. В примере собственные значения соответствуют собственным векторам,

соответственно, а также скалярные кратные этих векторов.

Матрица, все элементы которой выше главной диагонали равны нулю, называется нижней треугольной матрицей , а матрица, все элементы которой ниже главной диагонали равны нулю, называется верхней треугольной матрицей . Как и в случае с диагональными матрицами, собственные значения треугольных матриц являются элементами главной диагонали.

Рассмотрим нижнюю треугольную матрицу:

Характеристический полином A равен

который имеет корни λ 1 = 1 , λ 2 = 2 и λ 3 = 3 . Эти корни являются диагональными элементами, а также собственными значениями A .

Эти собственные значения соответствуют собственным векторам,

соответственно, а также скалярные кратные этих векторов.

Как и в предыдущем примере, нижняя треугольная матрица

Корни этого многочлена и, следовательно, собственные значения равны 2 и 3. Алгебраическая кратность каждого собственного значения равна 2; другими словами, они оба являются двойными корнями. Сумма алгебраических кратностей всех различных собственных значений равна µ A = 4 = n , порядка характеристического многочлена и размерности A.

С другой стороны, геометрическая кратность собственного значения 2 равна всего 1, поскольку его собственное пространство натянуто только на один вектор и, следовательно, является 1-мерным. Точно так же геометрическая кратность собственного значения 3 равна 1, потому что его собственное пространство натянуто только на один вектор . Общая геометрическая кратность γ A равна 2, что является наименьшим значением для матрицы с двумя различными собственными значениями. Геометрические кратности определены в следующем разделе.

Для эрмитовой матрицы квадрат нормы j- го компонента нормализованного собственного вектора можно вычислить, используя только собственные значения матрицы и собственные значения соответствующей второстепенной матрицы :

Определения собственного значения и собственных векторов линейного преобразования T остаются в силе, даже если базовое векторное пространство является бесконечномерным гильбертовым или банаховым пространством . Широко используемый класс линейных преобразований, действующих в бесконечномерных пространствах, — это дифференциальные операторы в функциональных пространствах . Пусть D — линейный дифференциальный оператор в пространстве C∞ бесконечно дифференцируемых вещественных функций вещественного аргумента t . Уравнение собственных значений для D представляет собой дифференциальное уравнение

Функции, удовлетворяющие этому уравнению, являются собственными векторами D и обычно называются собственными функциями .

Рассмотрим производный оператор с уравнением собственных значений

Это дифференциальное уравнение можно решить, умножив обе части на dt / f ( t ) и проинтегрировав . Ее решение – показательная функция

В основной статье о собственных функциях приводятся и другие примеры.

Понятие собственных значений и собственных векторов естественным образом распространяется на произвольные линейные преобразования в произвольных векторных пространствах. Пусть V — любое векторное пространство над некоторым полем K скаляров , и пусть T — линейное преобразование, отображающее V в V ,

Мы говорим, что ненулевой вектор v ∈ V является собственным вектором T тогда и только тогда, когда существует скаляр λ ∈ K такой, что

Это уравнение называется уравнением собственных значений для T , а скаляр λ является собственным значением T , соответствующим собственному вектору v . T ( v ) — результат применения преобразования T к вектору v , а λ v — произведение скаляра λ на v . [37] [38]

Учитывая собственное значение λ , рассмотрим множество

который представляет собой объединение нулевого вектора с набором всех собственных векторов, связанных с λ . E называется собственным пространством или характеристическим пространством T , связанным с λ . [39]

По определению линейного преобразования,

для x , y ∈ V и α ∈ K. _ Следовательно, если u и v — собственные векторы T , связанные с собственным значением λ , а именно u , v ∈ E , то

Таким образом, и u + v, и α v являются либо нулевыми, либо собственными векторами T , связанными с λ , а именно u + v , α v ∈ E , и E замкнуто относительно сложения и скалярного умножения. Следовательно, собственное пространство E , связанное с λ , является линейным подпространством V . [40] Если это подпространство имеет размерность 1, его иногда называют собственной линией . [41]

Геометрическая кратность γ T ( λ ) собственного значения λ — это размерность собственного пространства, связанного с λ , т. е. максимальное количество линейно независимых собственных векторов, связанных с этим собственным значением. [10] [27] [42] По определению собственных значений и собственных векторов γ T ( λ ) ≥ 1, поскольку каждое собственное значение имеет хотя бы один собственный вектор.

Собственные пространства оператора T всегда образуют прямую сумму . Как следствие, собственные векторы разных собственных значений всегда линейно независимы. Следовательно, сумма размерностей собственных пространств не может превышать размерность n векторного пространства, в котором работает T , и не может быть более n различных собственных значений. [д]

Любое подпространство, натянутое собственными векторами T, является инвариантным подпространством T , и ограничение T на такое подпространство диагонализуемо. Более того, если все векторное пространство V может быть натянуто на собственные векторы T или, что то же самое, если прямая сумма собственных пространств, связанных со всеми собственными значениями T , является всем векторным пространством V , то базис V , называемый собственным базисом , может быть формируется из линейно независимых собственных векторов T . Когда T допускает собственный базис, T диагонализуемо.

Если λ является собственным значением T , то оператор ( T − λI ) не является взаимно однозначным , и, следовательно, его обратный ( T − λI ) −1 не существует. Обратное верно для конечномерных векторных пространств, но не для бесконечномерных векторных пространств. В общем, оператор ( T − λI ) может не иметь обратного, даже если λ не является собственным значением.

По этой причине в функциональном анализе собственные значения могут быть обобщены на спектр линейного оператора T как набор всех скаляров λ , для которых оператор ( T − λI ) не имеет ограниченного обратного. Спектр оператора всегда содержит все его собственные значения, но не ограничивается ими.

Можно обобщить алгебраический объект, действующий на векторное пространство, заменив один оператор, действующий на векторное пространство, представлением алгебры – ассоциативной алгеброй, действующей на модуль . Изучение таких действий является областью теории представлений .

Теоретико -представительная концепция веса является аналогом собственных значений, а весовые векторы и весовые пространства являются аналогами собственных векторов и собственных пространств соответственно.

Простейшие разностные уравнения имеют вид

Решение этого уравнения для x через t находится с помощью его характеристического уравнения

который может быть найден путем суммирования в матричную форму набора уравнений, состоящего из приведенного выше разностного уравнения и уравнений k – 1, дающих k -мерную систему первого порядка в векторе суммированной переменной с точки зрения его однократного значения, и взяв характеристическое уравнение матрицы этой системы. Это уравнение дает k характеристических корней для использования в уравнении решения

Аналогичная процедура применяется для решения дифференциального уравнения вида

Вычисление собственных значений и собственных векторов — это тема, где теория, изложенная в учебниках элементарной линейной алгебры, зачастую очень далека от практики.

Классический метод заключается в том, чтобы сначала найти собственные значения, а затем вычислить собственные векторы для каждого собственного значения. Во многих отношениях он плохо подходит для неточных арифметических операций, таких как операции с плавающей запятой .

Собственные значения матрицы можно определить, найдя корни характеристического многочлена. Для матриц это легко сделать , но сложность быстро возрастает с увеличением размера матрицы.

Теоретически коэффициенты характеристического многочлена можно вычислить точно, поскольку они представляют собой суммы произведений матричных элементов; и существуют алгоритмы, которые могут найти все корни многочлена произвольной степени с любой необходимой точностью . [43] Однако на практике этот подход нежизнеспособен, поскольку коэффициенты будут испорчены неизбежными ошибками округления , а корни полинома могут быть чрезвычайно чувствительной функцией коэффициентов (как показано на примере полинома Уилкинсона ). [43] Даже для матриц, элементы которых являются целыми числами, вычисление становится нетривиальным, поскольку суммы очень длинные; постоянный член — это определитель , который для матрицы представляет собой сумму различных произведений. [э]

Явные алгебраические формулы для корней многочлена существуют только в том случае, если степень равна 4 или меньше. Согласно теореме Абеля–Руффини не существует общей, явной и точной алгебраической формулы для корней многочлена степени 5 и более. (Общность имеет значение, поскольку любой многочлен со степенью является характеристическим многочленом некоторой сопутствующей матрицы порядка .) Следовательно, для матриц порядка 5 или более собственные значения и собственные векторы не могут быть получены с помощью явной алгебраической формулы и, следовательно, должны вычисляться приближенным методом. численные методы . Даже точная формула для корней многочлена степени 3 численно непрактична.

Как только (точное) значение собственного значения известно, соответствующие собственные векторы можно найти, найдя ненулевые решения уравнения собственных значений, которое становится системой линейных уравнений с известными коэффициентами. Например, если известно, что 6 — собственное значение матрицы

мы можем найти его собственные векторы, решив уравнение , то есть

Это матричное уравнение эквивалентно двум линейным уравнениям

Оба уравнения сводятся к одному линейному уравнению . Следовательно, любой вектор формы для любого ненулевого действительного числа является собственным вектором с собственным значением .

Матрица выше имеет еще одно собственное значение . Аналогичный расчет показывает, что соответствующие собственные векторы являются ненулевыми решениями , то есть любого вектора формы для любого ненулевого действительного числа .

Обратный подход, заключающийся в сначала поиске собственных векторов, а затем определении каждого собственного значения по его собственному вектору, оказывается гораздо более удобным для компьютеров. Самый простой алгоритм здесь состоит из выбора произвольного начального вектора и последующего многократного умножения его на матрицу (необязательно нормализуя вектор, чтобы сохранить его элементы разумного размера); это заставляет вектор сходиться к собственному вектору. Вариант состоит в том, чтобы вместо этого умножить вектор на ; это заставляет его сходиться к собственному вектору собственного значения, ближайшего к .

Если (хорошее приближение) собственный вектор , то соответствующее собственное значение можно вычислить как

где обозначает сопряженное транспонирование .

Эффективные и точные методы вычисления собственных значений и собственных векторов произвольных матриц не были известны до тех пор, пока в 1961 году не был разработан алгоритм QR . [43] Сочетание преобразования Хаусхолдера с LU-разложением приводит к получению алгоритма с лучшей сходимостью, чем алгоритм QR. [ нужна цитата ] Для больших эрмитовых разреженных матриц алгоритм Ланцоша является одним из примеров эффективного итеративного метода вычисления собственных значений и собственных векторов, среди нескольких других возможностей. [43]

Большинство числовых методов, вычисляющих собственные значения матрицы, также определяют набор соответствующих собственных векторов как побочный продукт вычислений, хотя иногда разработчики предпочитают отбрасывать информацию о собственных векторах, как только она больше не нужна.

Собственные векторы и собственные значения могут быть полезны для понимания линейных преобразований геометрических фигур. В следующей таблице представлены некоторые примеры преобразований на плоскости вместе с их матрицами 2 × 2, собственными значениями и собственными векторами.

Характеристическое уравнение вращения представляет собой квадратное уравнение с дискриминантом , который является отрицательным числом, если θ не является целым числом, кратным 180°. Следовательно, за исключением этих особых случаев, два собственных значения являются комплексными числами ; и все собственные векторы имеют недействительные элементы. Действительно, за исключением этих особых случаев, вращение меняет направление каждого ненулевого вектора в плоскости.

Линейное преобразование, которое переводит квадрат в прямоугольник той же площади ( отображение сжатия ), имеет обратные собственные значения.

Собственное разложение симметричной положительно-полуопределенной (PSD) матрицы дает ортогональный базис собственных векторов, каждый из которых имеет неотрицательное собственное значение . Ортогональное разложение матрицы PSD используется в многомерном анализе , где выборочные ковариационные матрицы представляют собой PSD. Это ортогональное разложение в статистике называется анализом главных компонент (PCA). PCA изучает линейные отношения между переменными. PCA выполняется на ковариационной матрице или корреляционной матрице (в которой каждая переменная масштабируется так, чтобы ее выборочная дисперсия была равна единице). Для ковариационной или корреляционной матрицы собственные векторы соответствуют главным компонентам , а собственные значения - дисперсии, объясняемой главными компонентами. Анализ главных компонентов корреляционной матрицы обеспечивает ортогональную основу для пространства наблюдаемых данных: в этом базисе наибольшие собственные значения соответствуют главным компонентам, которые связаны с большей частью ковариативности среди ряда наблюдаемых данных.

Анализ главных компонентов используется как средство уменьшения размерности при изучении больших наборов данных , например, тех, которые встречаются в биоинформатике . В Q-методологии собственные значения корреляционной матрицы определяют практическую значимость суждения Q-методолога (которое отличается от статистической значимости проверки гипотез ; ср. критерии определения числа факторов ). В более общем смысле анализ главных компонентов можно использовать как метод факторного анализа при моделировании структурными уравнениями .

В спектральной теории графов собственное значение графа определяется как собственное значение матрицы смежности графа или (все чаще) матрицы Лапласа графа из-за ее дискретного оператора Лапласа , который либо (иногда называется комбинаторным лапласианом ), либо (иногда называется нормализованным лапласианом ), где – диагональная матрица со степенью вершины , а в , -й диагональный элемент равен . Главный собственный вектор графа определяется как собственный вектор, соответствующий наибольшему или наименьшему собственному значению лапласиана. Первый главный собственный вектор графа также называется просто главным собственным вектором.

Главный собственный вектор используется для измерения централизации его вершин. Примером может служить алгоритм PageRank от Google . Главный собственный вектор модифицированной матрицы смежности графа Всемирной паутины определяет рейтинг страниц как ее компонентов. Этот вектор соответствует стационарному распределению цепи Маркова , представленному матрицей смежности, нормированной по строкам; однако сначала необходимо изменить матрицу смежности, чтобы обеспечить существование стационарного распределения. Второй наименьший собственный вектор можно использовать для разделения графа на кластеры посредством спектральной кластеризации . Для кластеризации также доступны другие методы.

Цепь Маркова представляется матрицей, элементами которой являются вероятности перехода между состояниями системы. В частности, записи неотрицательны, и сумма каждой строки матрицы равна единице, что является суммой вероятностей переходов из одного состояния в какое-то другое состояние системы. Теорема Перрона -Фробениуса дает достаточные условия для того, чтобы цепь Маркова имела единственное доминирующее собственное значение, которое определяет сходимость системы к устойчивому состоянию.

Проблемы собственных значений естественным образом возникают при анализе вибрации механических конструкций со многими степенями свободы . Собственные значения — это собственные частоты (или собственные частоты ) вибрации, а собственные векторы — это формы этих колебательных мод. В частности, незатухающая вибрация определяется

То есть ускорение пропорционально положению (т. е. мы ожидаем, что оно будет синусоидальным во времени).

В размерах становится матрицей масс и матрицей жесткости . Допустимые решения тогда представляют собой линейную комбинацию решений обобщенной проблемы собственных значений.

Это можно свести к обобщенной проблеме собственных значений путем алгебраических манипуляций за счет решения более крупной системы.

Свойства ортогональности собственных векторов позволяют разделить дифференциальные уравнения , так что систему можно представить как линейное суммирование собственных векторов. Проблема собственных значений сложных структур часто решается с использованием анализа методом конечных элементов , но аккуратно обобщает решение скалярных задач вибрации.

В механике собственные векторы тензора момента инерции определяют главные оси твердого тела . Тензор момента инерции — ключевая величина , необходимая для определения вращения твердого тела вокруг его центра масс .

В механике твердого тела тензор напряжений симметричен и поэтому может быть разложен на диагональный тензор с собственными значениями на диагонали и собственными векторами в качестве основы. Поскольку в этой ориентации он диагональный, тензор напряжений не имеет компонентов сдвига ; компоненты, которые у него есть, являются основными компонентами.

Примером уравнения на собственные значения, в котором преобразование представлено в терминах дифференциального оператора, является независимое от времени уравнение Шредингера в квантовой механике :

где гамильтониан — дифференциальный оператор второго порядка , а волновая функция — одна из его собственных функций, соответствующих собственному значению , интерпретируемому как его энергия .

Однако в случае, когда нас интересуют только решения уравнения Шредингера в связанном состоянии , поиск осуществляется в пространстве интегрируемых с квадратом функций. Поскольку это пространство является гильбертовым пространством с четко определенным скалярным произведением , можно ввести базисный набор , в котором и могут быть представлены как одномерный массив (т. е. вектор) и матрица соответственно. Это позволяет представить уравнение Шредингера в матричной форме.

В этом контексте часто используется обозначение брекет . Вектор, который представляет состояние системы, в гильбертовом пространстве квадратично интегрируемых функций представлен как . В этих обозначениях уравнение Шредингера имеет вид:

где является собственным состоянием и представляет собой собственное значение. — наблюдаемый самосопряженный оператор , бесконечномерный аналог эрмитовых матриц. Как и в матричном случае, в приведенном выше уравнении понимается вектор, полученный применением преобразования к .

Свет , акустические волны и микроволны беспорядочно рассеиваются множество раз при прохождении статической неупорядоченной системы. Несмотря на то, что многократное рассеяние многократно хаотизирует волны, в конечном итоге когерентный перенос волн через систему представляет собой детерминированный процесс, который можно описать матрицей передачи поля . [44] [45] Собственные векторы оператора передачи образуют набор входных волновых фронтов, специфичных для беспорядка, которые позволяют волнам соединяться с собственными каналами неупорядоченной системы: волны по независимым путям могут проходить через систему. Собственные значения соответствуют коэффициенту пропускания интенсивности, связанному с каждым собственным каналом. Одним из замечательных свойств оператора передачи диффузионных систем является их бимодальное распределение собственных значений с и . [45] Кроме того, одним из поразительных свойств открытых собственных каналов, помимо идеального коэффициента пропускания, является статистически надежный пространственный профиль собственных каналов. [46]

В квантовой механике , и в частности в атомной и молекулярной физике , в рамках теории Хартри-Фока атомные и молекулярные орбитали могут определяться собственными векторами оператора Фока . Соответствующие собственные значения интерпретируются как потенциалы ионизации посредством теоремы Купмана . В этом случае термин «собственный вектор» используется в несколько более общем смысле, поскольку оператор Фока явно зависит от орбиталей и их собственных значений. Таким образом, если кто-то хочет подчеркнуть этот аспект, говорят о нелинейных задачах собственных значений. Такие уравнения обычно решаются с помощью итерационной процедуры, называемой в этом случае методом самосогласованного поля . В квантовой химии уравнение Хартри-Фока часто представляют в неортогональном базисном наборе . Это конкретное представление представляет собой обобщенную проблему собственных значений , называемую уравнениями Рутана .

В геологии , особенно при изучении ледникового тилла , собственные векторы и собственные значения используются как метод, с помощью которого массу информации об ориентации и наклоне компонентов обломочной ткани можно суммировать в трехмерном пространстве с помощью шести чисел. В полевых условиях геолог может собрать такие данные для сотен или тысяч обломков в образце почвы, которые можно сравнить только графически, например, с помощью диаграммы Tri-Plot (Снид и Фолк) [47] [48] или в виде диаграммы Tri-Plot (Снид и Фолк) [47] [48] Стереосеть в сети Вульфа. [49]

Выходные данные для тензора ориентации находятся в трех ортогональных (перпендикулярных) осях пространства. Три собственных вектора упорядочены по их собственным значениям ; [50] тогда является первичной ориентацией/падением обломков, является вторичной и третичной с точки зрения прочности. Ориентация обломков определяется как направление собственного вектора на компасной розе 360 ° . Наклон измеряется как собственное значение, модуль тензора: он измеряется от 0 ° (нет наклона) до 90 ° (вертикаль). Относительные значения , и определяются природой структуры осадка. Если , ткань называется изотропной. Если , ткань называется плоской. Если , ткань называется линейной. [51]

Базовое число воспроизводства ( ) является фундаментальным числом при изучении распространения инфекционных заболеваний. Если одного заразного человека поместить в популяцию полностью восприимчивых людей, то это среднее число людей, которых заразит один типичный заразный человек. Время возникновения инфекции — это время от заражения одного человека до заражения следующего человека. В гетерогенной популяции матрица следующего поколения определяет, сколько людей в популяции заразятся по прошествии определенного времени. Тогда это значение является наибольшим собственным значением матрицы следующего поколения. [52] [53]

При обработке изображений обработанные изображения лиц можно рассматривать как векторы, компонентами которых являются яркости каждого пикселя . [54] Размерность этого векторного пространства равна количеству пикселей. Собственные векторы ковариационной матрицы , связанные с большим набором нормализованных изображений лиц, называются собственными лицами ; это пример анализа главных компонент . Они очень полезны для выражения любого изображения лица как линейной комбинации некоторых из них. В области биометрии распознавания лиц собственные лица предоставляют средства применения сжатия данных к лицам в целях идентификации . Также были проведены исследования, связанные с системами собственного зрения, определяющими жесты рук.

Подобно этой концепции, собственные голоса представляют собой общее направление изменчивости человеческого произношения конкретного высказывания, например слова в языке. На основе линейной комбинации таких собственных голосов можно построить новое голосовое произношение слова. Эти концепции оказались полезными в системах автоматического распознавания речи для адаптации говорящего.

![]() Викиверситет использует вводную физику для введения собственных значений и собственных векторов.

Викиверситет использует вводную физику для введения собственных значений и собственных векторов.